Clear Sky Science · ru

Масштабирование регуляторной науки медицинских устройств с помощью больших языковых моделей

Почему это важно для пациентов и врачей

Современная медицина быстро наполняется «умными» устройствами, использующими искусственный интеллект для чтения снимков, мониторинга жизненных показателей и помощи врачам в принятии решений. Только в Соединённых Штатах более тысячи таких инструментов уже были допущены или утверждены Управлением по контролю за продуктами и лекарствами США (FDA). За каждым устройством остаётся бумажный след из сложных отчётов и записей о безопасности. Сегодня большая часть этой информации по‑прежнему просматривается вручную — это медленно, дорого и вскоре отстаёт от реальности. Эта статья исследует, могут ли большие языковые модели — тот же класс ИИ, что стоит за продвинутыми чат‑ботами — надёжно читать такие документы в масштабе и превращать их в пригодные для анализа данные, чтобы помочь регуляторам, исследователям и общественности понять, насколько хорошо сделаны эти устройства и насколько безопасно они работают.

Проблема «слишком большого» объёма сложных документов

Каждое медицинское устройство с ИИ сопровождается объёмными решениями, отчётами по безопасности и уведомлениями об отзыве. Эти документы длинные, написаны плотным профессиональным жаргоном и часто содержат таблицы, изображения и непоследовательное форматирование. Предыдущие исследования показали, что на ответы на базовые вопросы — например, как устройство тестировали до одобрения или что именно пошло не так при его отказе — требуются команды экспертов, читающие сотни PDF‑файлов построчно. Простые поисковые инструменты и сопоставление шаблонов могут находить очевидные детали, такие как идентификаторы, но им трудно с более глубокими вопросами, требующими суждения: например, проводилось ли исследование в нескольких больницах или действительно ли устройство способствовало травме или смерти пациента. С ростом числа устройств с ИИ такой ручной подход стал невозможным для поддержания в масштабе.

Конвейер ИИ, читающий как эксперт

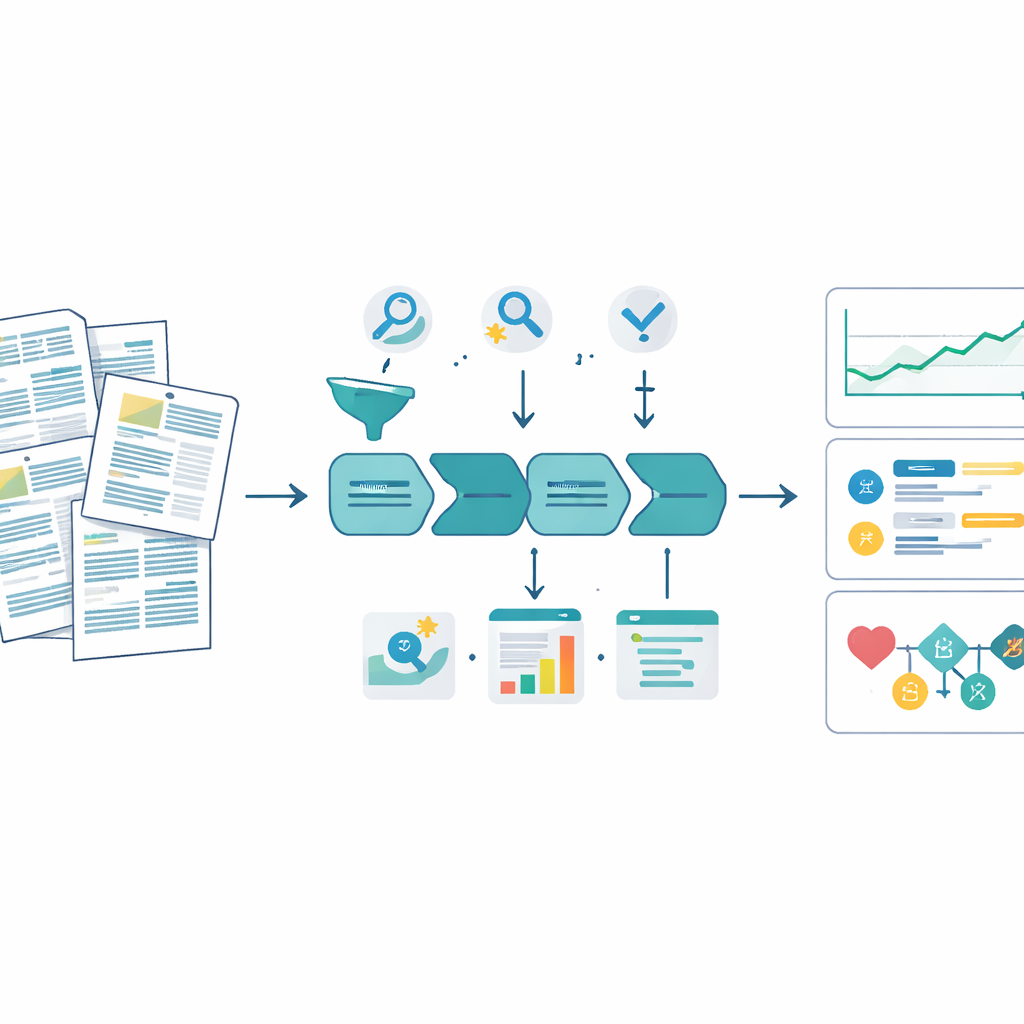

Авторы разработали общий конвейер на основе передовой большой языковой модели, чтобы решить эту задачу. Сначала они собрали все публично доступные решения FDA и отчёты по безопасности для 1 247 устройств с ИИ или машинным обучением и 1 852 связанных отчётов о нежелательных событиях по середину 2025 года, очистили PDF и при необходимости использовали оптическое распознавание символов. Затем вместо того, чтобы просить модель отвечать на широкие вопросы сразу, они разбили работу на более мелкие, чётко определённые подзадачи. Для каждого типа документа модель получала подробные инструкции, основанные на официальных руководствах FDA, а также примеры того, как люди маркировали информацию. У модели просили рассуждать шаг за шагом и выдавать ответы в строгом, структурированном формате, превращая свободный текст в ясные поля, такие как «количество исследовательских центров», «тип события безопасности» или «вид изменения устройства».

Проверка точности на реальных регуляторных задачах

Чтобы выяснить, можно ли доверять этой системе, команда провела три кейс‑исследования, где предыдущие исследователи уже месяцами занимались ручной проверкой. Сначала они пересмотрели, как устройства тестировались до одобрения, спросив, были ли испытания проспективными (сбор данных в будущем) и включали ли они несколько больниц. Сравнивая выводы модели с пометками экспертов, они увидели показатели совпадения часто выше 80–90 процентов, сопоставимые с согласованностью между самими аннотаторами‑людьми. Во‑вторых, модель использовали для перелицензирования отчётов о безопасности, описывающих отказ, травмы или смерти, и для классификации того, что именно пошло не так с устройством. Когда рецензенты‑люди сравнивали исходные коды производителя с предложениями модели — не зная, что к чему относится — они в подавляющем большинстве случаев предпочитали выбор модели, особенно для чувствительных категорий, таких как смерть против неисправности. В‑третьих, исследователи связали сведения из документов до одобрения с последующими отчётами о безопасности, чтобы изучить, какие ранние решения — например, выбор предшествующей модели с предыдущими отзывами или крупные аппаратные изменения — статистически связаны с повышенным риском будущих проблем.

Что показывают результаты о безопасности и надзоре

После валидации конвейер позволил команде масштабировать эти анализы от десятков устройств до всей известной популяции инструментов с ИИ. Они обнаружили, например, что проспективные клинические оценки оставались относительно редкими в течение трёх десятилетий, примерно в одном из десяти случаев, тогда как упоминания много‑центровых испытаний значительно возросли. В отчётах о безопасности модель выявила ситуации, когда тип проблемы, описанный в тексте, не соответствовал коду, отправленному в FDA — например, случаи, когда аппаратные неисправности были маркированы как проблемы с качеством изображения. Когда они связали характеристики до одобрения с последующими событиями безопасности, устройства, предшественники которых уже имели отзывы или историю нежелательных событий, показали значительно более высокий риск новых сообщений, тогда как устройства, подтверждённые клиническими испытаниями, как правило, имели более низкий риск. Эти результаты являются исследовательскими, но иллюстрируют тип вопросов, которые теперь можно задавать регулярно, а не как разовые проекты.

Ограничения, меры предосторожности и дальнейший путь

Авторы подчёркивают, что их подход не безошибочен и не должен заменять экспертное суждение. Точность около 80 процентов может быть более чем достаточной для анализа общих тенденций, но недостаточной для принятия решений в отношении конкретного устройства или пациента. Производительность может варьироваться в зависимости от типа устройства и года, а качество исходных документов FDA и баз данных безопасности остаётся серьёзным узким местом. Тем не менее исследование показывает, что тщательно спроектированные системы на базе языковых моделей могут превращать горы неструктурированного регуляторного текста в структурированные, проверяемые данные за дни вместо лет. Для неспециалистов вывод таков: те же ИИ‑технологии, которые работают в потребительских чат‑ботах, также могут помочь надзорным органам и исследователям отслеживать, как создаются, тестируются и контролируются медицинские устройства с ИИ — что потенциально ведёт к более быстрому обнаружению проблем и лучшим данным для разработки более безопасных правил и продуктов.

Цитирование: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Ключевые слова: AI медицинские устройства, регуляторная наука, большие языковые модели, отчёты о безопасности FDA, надзор за медицинскими технологиями