Clear Sky Science · ru

GWKNN: улучшенный алгоритм k-ближайших соседей с реконструкцией метрики G и оптимизатором Grey Wolf

Более умное распознавание образов для эпохи информационного потока

От медицинских снимков до банковских операций — современная жизнь генерирует океаны данных. Большую часть этой информации нужно автоматически распределять по категориям: здоровый или больной, мошенническая операция или нормальная, спам или настоящее письмо. Классическим инструментом для таких задач является алгоритм k-ближайших соседей (KNN), который присваивает метку новому случаю, ориентируясь на наиболее похожие прошлые примеры. Однако по мере роста объёмов, сложности и несбалансированности данных эта простая идея начинает давать сбои. В статье представлен GWKNN — переработанная версия KNN, призванная эффективнее использовать расстояния между точками и более справедливо относиться к редким, но важным случаям.

Почему простая мера сходства недостаточна

Обычный KNN предполагает, что все признаки точки данных вносят одинаковый вклад, и измеряет сходство стандартным евклидовым расстоянием. Это может работать при низкой размерности и чётком разделении классов, но реальные данные часто имеют высокую размерность, содержат шум и представляют собой смесь различных типов информации. В таких ситуациях привычное расстояние может вводить в заблуждение и приводить алгоритм к выбору нерелевантных соседей. Кроме того, многие наборы данных несбалансированы: распространённые классы доминируют, в то время как редкие, но критически важные классы, например ранняя стадия болезни, представлены плохо. Когда KNN голосует среди ближайших примеров, большинство обычно подавляет меньшинства, что приводит к смещённым и порой опасным решениям.

Обучение алгоритма лучшему чувству расстояния

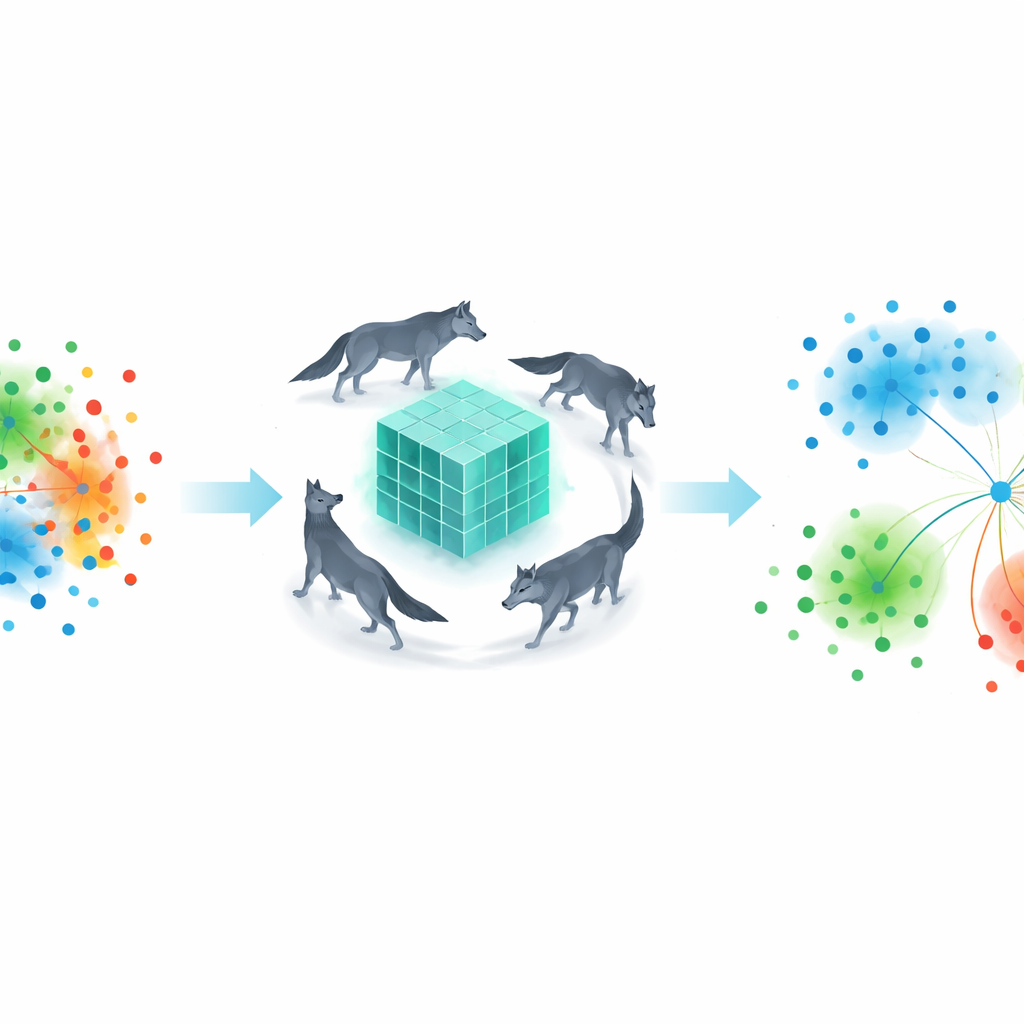

Первое ключевое нововведение в GWKNN — это обучаемая мера расстояния. Вместо того чтобы жестко задавать стандартное правило, авторы позволяют алгоритму самостоятельно определить, на каких расстояниях точки данных следует считать разными так, чтобы классы разделялись лучше. Это оформлено как гибкая «метрика G», которая преобразует пространство так, чтобы информативные признаки имели большее значение, а избыточные — меньшее. Для настройки этой метрики метод черпает вдохновение в охотничьем поведении серых волков. Процедура роевая оптимизации, называемая Grey Wolf Optimizer, исследует множество вариантов растяжения и сжатия пространства данных, оставляя те, которые уменьшают ошибки классификации и сохраняют математическую устойчивость. В ходе многочисленных итераций виртуальные «волки» сходятся к правилу расстояния, которое делает сходные точки более надёжно сгруппированными, даже в высокоразмерных и запутанных наборах данных.

Дать редким случаям более громкий голос

Второе улучшение направлено на смещение при голосовании. Стандартный KNN просто подсчитывает, сколько из k соседей принадлежат каждому классу, и выбирает большинство. GWKNN взвешивает каждый голос в зависимости от того, как часто этот класс встречается в обучающем наборе. Более редким классам даются более сильные веса; очень частым классам — более слабые. Небольшой сглаживающий член предотвращает ситуацию, когда экстремально редкие категории полностью доминируют при принятии решения. Таким образом, если новая точка данных близка к нескольким примерам из класса-миноритета и множеству примеров из класса-межности, сигналы меньшинства не будут автоматически подавлены. Схема проста в расчёте, но оказывает сильное влияние: она заставляет классификатор уделять больше внимания редким, но значимым паттернам, повышая справедливость и полноту для классов-миноритариев.

Испытание нового метода

Чтобы проверить, действительно ли GWKNN полезен на практике, авторы оценили его на 12 эталонных наборах данных из известного репозитория UCI. Эти коллекции охватывают финансовые данные, медицинские измерения, почерк, семена растений и несколько высокоразмерных наборов данных по раку и экспрессии генов, с задачами как двухклассовыми, так и многоклассовыми. Они сравнили четыре версии KNN: простой базовый вариант, версию только с новой метрикой расстояния, версию только с новыми весами при голосовании и полную GWKNN, сочетающую оба подхода. Также GWKNN противостоял семи широко используемым классификаторам, включая опорные векторы, деревья решений, случайные леса, логистическую регрессию, наивный байес и нейронную сеть. На повторных разбиениях на обучающую и тестовую выборки они отслеживали не только среднюю точность, но и разброс результатов.

Результаты: точнее и стабильнее

Комбинированный подход GWKNN показал лучшие или равные лучшие результаты на большинстве наборов данных, особенно на тех, где много признаков и размеры классов неравномерны. В относительно простых задачах все методы работали хорошо и прирост был скромным, но GWKNN по-прежнему обычно слегка улучшал точность и снижал вариативность. На более сложных наборах по экспрессии генов с тысячами признаков преимущества были более заметны: обучаемая метрика расстояния помогала формировать более содержательные соседства, а взвешенное голосование повышало распознавание недопредставленных классов. Статистические тесты по всем наборам подтвердили, что ранжирования GWKNN статистически значимо лучше, чем у стандартного KNN и некоторых классических моделей, что указывает на то, что улучшения устойчивы и не являются случайными флуктуациями.

Что это значит для повседневных решений на основе данных

Для неспециалистов вывод прост: GWKNN уточняет очень интуитивную идею — «смотри на похожие прошлые случаи» — так, чтобы она лучше соответствовала беспорядочной реальности современных данных. Обучаясь измерять сходство в данные-направленном виде и усиливая влияние редких категорий при голосовании, метод стремится быть и более точным, и более справедливым. Хотя такая дополнительная сложность требует больших вычислительных ресурсов, особенно для очень больших и высокоразмерных наборов данных, GWKNN показывает сильный потенциал для задач, где важно правильно классифицировать случаи-миноритарии, например раннее обнаружение болезней или выявление мошенничества. Работа демонстрирует, как классические алгоритмы можно модернизировать с помощью идей из оптимизации и справедливости, чтобы соответствовать масштабу и сложности современных данных.

Цитирование: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Ключевые слова: k-ближайших соседей, обучение метрики расстояния, несбалансированность классов, роевой интеллект, классификация данных