Clear Sky Science · ru

Уравновешивание справедливости и эффективности при прогнозировании степени глиомы с помощью методов снижения смещений

Почему важно справедливо относиться к пациентам с опухолями

Когда врачи используют искусственный интеллект для помощи в диагностике опухолей мозга, можно предположить, что компьютер нейтрален. Но если данные, на которых обучают эти инструменты, отражают существующее неравенство в здравоохранении, программное обеспечение невольно может относиться к некоторым пациентам менее справедливо. В этом исследовании рассматривается, как системы машинного обучения, прогнозирующие степень глиом — распространённого типа опухоли мозга у взрослых — могут ненамеренно отдавать предпочтение определённым расовым или половым группам, и проверяются практические способы сделать такие прогнозы справедливее без чрезмерной потери точности.

Опухоли мозга и компьютерные помощники

Глиомы — это опухоли мозга, которые варьируются от медленно растущих, более поддающихся лечению форм до очень агрессивных раков с плохим прогнозом выживаемости. Правильная градация этих опухолей жизненно важна, поскольку она направляет решение о хирургии, радиотерапии и медикаментозном лечении. Исследователи работали с публичным набором данных из 839 взрослых с низкозлокачественной глиомой или агрессивной глиобластомой. Для каждого пациента были доступны возраст, пол, раса и 20 распространённых генетических маркеров опухоли. Они обучили три стандартные модели предсказания — логистическую регрессию, случайные леса и градиентный бустинг — различать два класса опухолей по этим признакам, а затем оценили как общую точность моделей, так и то, как они обращаются с разными группами пациентов.

Поиск скрытого дисбаланса

Чтобы исследовать справедливость, команда сосредоточилась на двух «защищённых» признаках: раса (белые против небелых) и пол (мужчины против женщин). Сам набор данных был смещён — более 90 процентов пациентов были белыми, и мужчин заметно больше, чем женщин. Авторы использовали групповые меры справедливости, которые сравнивают, как часто разным группам ставится правильный «высокий» прогноз и как часто модель ошибается для каждой группы. Все три модели показывали высокую общую точность, при этом логистическая регрессия оказалась лучшей. Однако при более глубокой проверке выяснилось, что небелые пациенты в целом получали худшие результаты по сравнению с белыми, особенно в корректной идентификации менее агрессивных опухолей. Напротив, по полу результаты были гораздо более сбалансированными, с незначительными различиями между мужчинами и женщинами.

Попытки устранить смещение

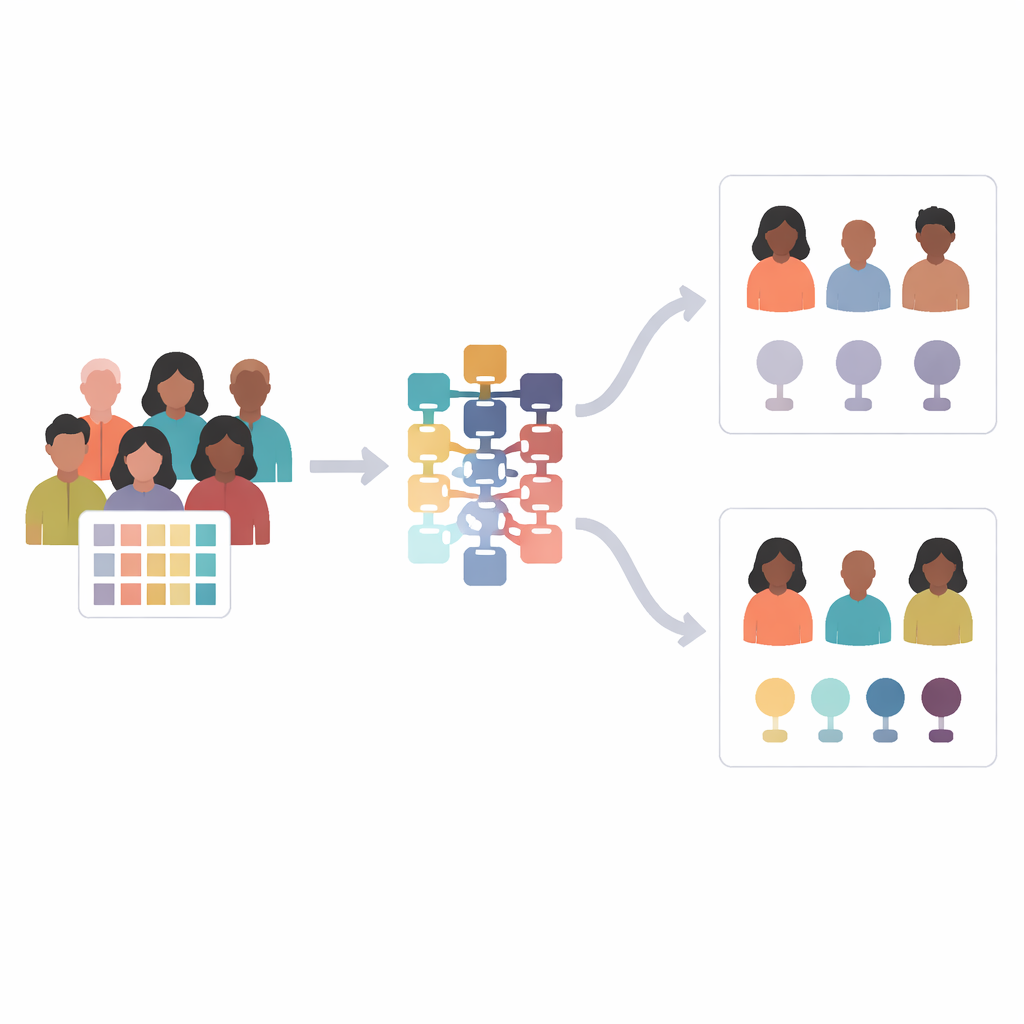

Затем исследователи задали вопрос, можно ли повысить справедливость, не существенно снижая медицинскую полезность модели. В качестве базовой модели выбрали логистическую регрессию, поскольку она была и самой точной, и наиболее справедливой из трёх. Они опробовали две распространённые стратегии декоррекции. Подход «дообработки» (pre-processing) под названием пере-взвешивание присваивал больше веса недостаточно представленным пациентам при обучении, чтобы модель сильнее учитывала их. Подход «пост-обработки» (post-processing), называемый равными шансами (equalized odds), оставлял обученную модель, но корректировал её выходы так, чтобы показатели ошибок стали более сопоставимыми между группами.

Что изменилось после настройки модели

Для пола обе стратегии в целом помогли: качество прогнозов для женщин улучшилось, и различия между мужчинами и женщинами в основном сократились. Для расы, где дисбаланс в данных был гораздо сильнее, картина оказалась сложнее. Пере-взвешивание иногда давало обратный эффект, незначительно ухудшая результаты для небелых пациентов и даже увеличивая несправедливость по некоторым метрикам. Напротив, метод пост-обработки существенно сократил расовые разрывы в показателях ошибок, сохранив при этом высокую общую точность модели, хотя он немного снизил показатели для доминирующей группы. Авторы также показали, что показатели справедливости для значительно меньшей группы небелых статистически нестабильны — изменение предсказания одного человека может заметно сместить оценки справедливости — поэтому эти результаты следует интерпретировать осторожно.

Что это значит для пациентов и врачей

Исследование делает вывод, что бесплатного обеда не существует: улучшение справедливости в медицинском ИИ часто сопряжено с компромиссами в производительности, и лучший способ зависит от того, насколько смещены данные и какая цель справедливости приоритетна. В этом примере с опухолями мозга корректировка выходов модели после обучения оказалась наиболее практичным способом сделать рекомендации по лечению более беспристрастными по расе и полу, сохранив при этом высокую предсказательную способность. Работа подчёркивает, что проверки на справедливость должны быть рутиной при внедрении ИИ в здравоохранение, особенно для серьёзных состояний, таких как глиома, и что существуют методы для повышения справедливости этих инструментов — но их нужно выбирать и интерпретировать осмотрительно.

Цитирование: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

Ключевые слова: градирование глиомы, справедливость медицинского ИИ, алгоритмическое смещение, опухоли мозга, минимизация смещения