Clear Sky Science · ru

Определение источника съёмки с помощью правиловой объяснимой сверточной нейронной сети

Почему ваши фото могут рассказать о вас больше, чем кажется

Каждое сделанное вами фото содержит скрытые подсказки о камере, которая его зафиксировала. Для цифровых следователей эти подсказки помогают подтвердить подлинность изображения, установить, с какого устройства оно пришло, или связать фотографии с разными местами преступлений. Сегодня мощные инструменты искусственного интеллекта (ИИ) видят такие закономерности лучше человека — но часто работают как загадочные «чёрные ящики». В этой статье предлагается способ открыть этот ящик: правиловой метод, который объясняет, как модель глубокого обучения приходит к выводу о том, какая камера сделала снимок, в форме, понятной и вызывающей доверие у человека-эксперта.

Проблема доверия к умным средствам криминалистики

Современная цифровая криминалистика вынуждена обрабатывать огромные объёмы данных — со смартфонов, облачных резервных копий и социальных сетей — гораздо больше, чем аналитики могут просмотреть вручную. Системы глубокого обучения быстро отмечают изображения или предлагают, какие из них важны, но их внутренняя логика остаётся непрозрачной. В чувствительных условиях, например в суде, фразы вроде «нейросеть так решила» недостаточно. Существующие инструменты объяснения обычно выделяют области изображения, важные для модели, что полезно при распознавании лиц или объектов. Однако для идентификации источника камеры ключевой сигнал — не видимая деталь, а тонкий отпечаток сенсора — слабые шумовые паттерны, незаметные глазу. Поэтому современные визуальные объяснения не показывают, почему модель считает, что снимок принадлежит конкретной камере, и не помогают экспертам понять, когда модель ошибается.

Новый способ «видеть», как думает нейросеть

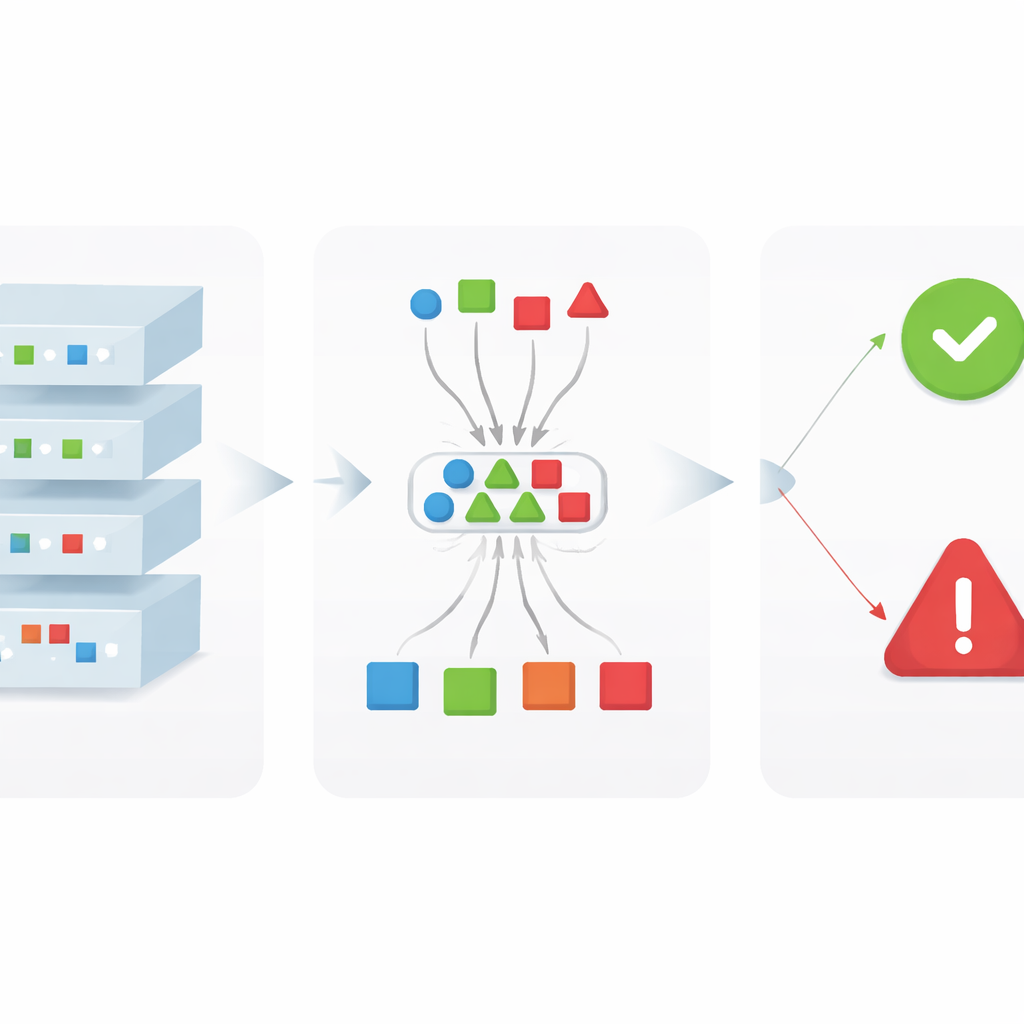

Авторы представляют xDFAI — фреймворк, разработанный специально для цифровой криминалистики, который объясняет решения сверточной нейронной сети (CNN) без изменения исходной модели. Вместо того чтобы рассматривать сеть как единый непрозрачный блок, xDFAI анализирует её послойно. Для каждого слоя и каждого класса камеры он выявляет набор повторяющихся внутренних паттернов, называемых «следами», которые стабильно активируются, когда модель считает изображение принадлежащим этой камере. Эти следы извлекаются из обученной модели с помощью существующих методов атрибуции, а затем фильтруются так, чтобы оставлять только те паттерны, которые надёжно появляются во множестве обучающих изображений. В совокупности эти следы создают структурированную карту того, как признаки принадлежности камере преобразуются по мере прохождения изображения через сеть.

Дать слоям голосовать и превратить голоса в правила

Когда следы известны, xDFAI использует их для анализа новых, невиданных изображений. Для конкретного тестового фото фреймворк измеряет, насколько похожи его внутренние активации на сохранённые следы каждой камеры на каждом слое. Каждый слой фактически отдаёт голос за те модели камер, чьи следы ему наиболее близки. Поперечный «голос большинства» по слоям суммирует, насколько сильно сеть в целом поддерживает каждую кандидатуру. Важно, что авторы не используют это голосование для замены предсказания модели; они применяют его как проверку. Простые логические правила сравнивают голос большинства с исходным предсказанием: если предсказанная камера также получает сильную поддержку от многих слоёв, решение подтверждается; если голоса разрозненны или склоняются в пользу другой камеры, поведение помечается как аномальное и показывается эксперту как возможная ошибка модели.

Проверка фреймворка

Чтобы продемонстрировать xDFAI, авторы применили его к семислойной CNN, обученной определять, какая из 27 моделей камер сделала изображение, используя известный судебно-экспертный датасет. Базовая CNN и без того показывает отличные результаты, правильно классифицируя около 97% тестовых изображений. Когда поверх неё применяют правила xDFAI, система автоматически помечает 27 из 37 неверных предсказаний как подозрительные. Такие помеченные случаи уже не учитываются как уверенные идентификации, что повышает точность — долю принятых решений, которые действительно верны — с 97,33% до 99,2%, при незначительном снижении общей точности. Для судебной практики, где одна неверная атрибуция может иметь серьёзные последствия, такой компромисс крайне желателен: меньше ложных выводов среди тех заключений, которым аналитики решают доверять.

Что это означает для реальных расследований

Эта работа показывает, что можно сохранить полную мощь современной модели глубокого обучения и при этом добавить понятные человеку объяснения, соблюдающие принципы судебной экспертизы — без дообучения, без вмешательства в исходную модель и без опоры лишь на расплывчатые тепловые карты. Выявляя стабильные внутренние следы, агрегируя их прозрачной схемой голосования и выражая результат в простых правилах, xDFAI даёт экспертам инструмент для подтверждения или оспаривания выводов ИИ об источнике съёмки. Хотя исследование сосредоточено на идентификации источника камеры, те же идеи могут быть расширены на другие задачи атрибуции в криминалистике. В перспективе такие подходы могут помочь сократить разрыв между высокоточными системами ИИ и требованиями по прозрачности и надёжности, необходимыми в судах и практике расследований.

Цитирование: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Ключевые слова: цифровая криминалистика, объяснимая ИИ, идентификация камеры, сверточные нейронные сети, экспертиза изображений