Clear Sky Science · ru

Интегрированная платформа для проактивного противодействия дипфейкам через водяные знаки на основе внимания и проверку подлинности в блокчейне

Почему поддельные видео — проблема для всех

Видео, которые выглядят и звучат по‑настоящему, теперь можно подделывать с помощью доступного программного обеспечения, размывая грань между правдой и вымыслом в сети. Так называемые дипфейки уже используются для мошенничества, преследований и политических манипуляций. Вместо того чтобы пытаться обнаружить подделки после их распространения, в этом исследовании задают другой вопрос: что если мы сможем незаметно защитить подлинные видео в момент их создания, чтобы любое последующее вмешательство стало очевидным?

От погонь за подделками к защите оригиналов

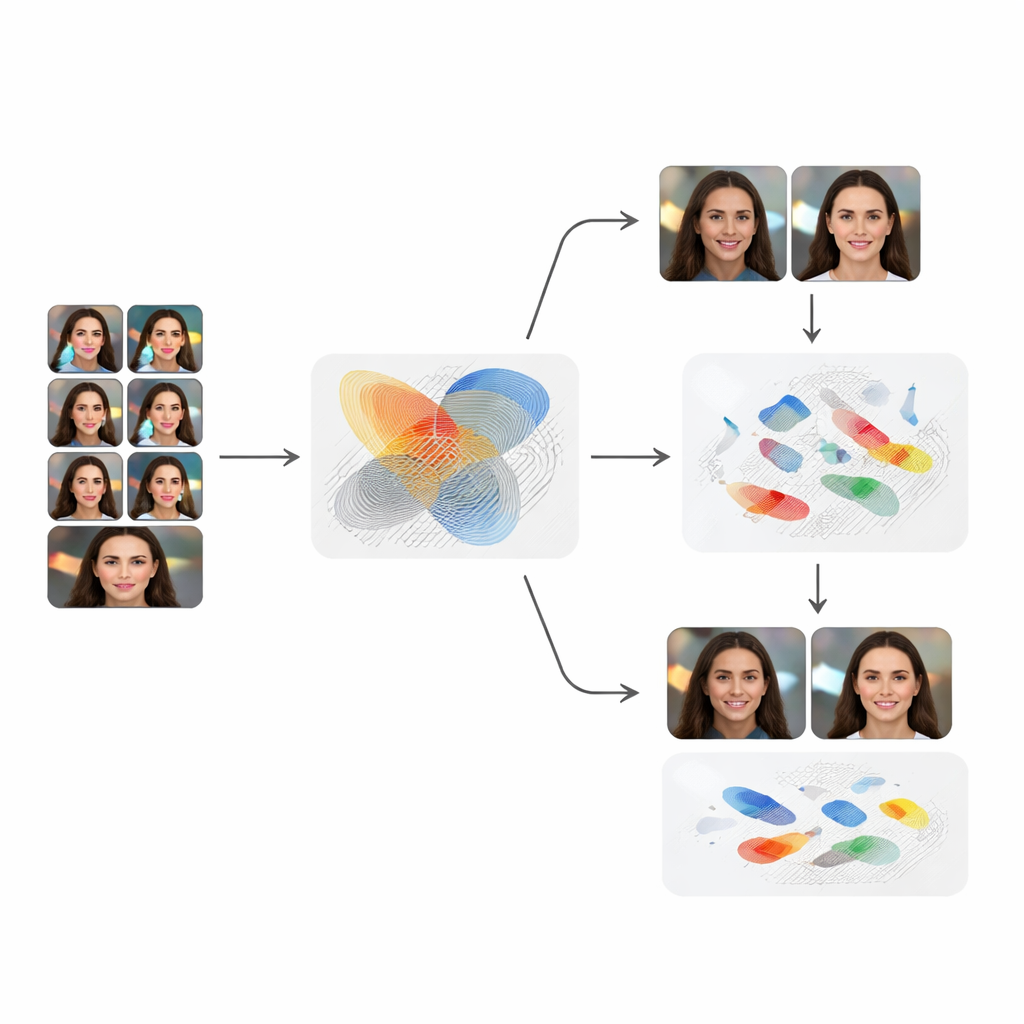

Большая часть текущих исследований пытается поймать дипфейки постфактум, обучая алгоритмы замечать крошечные артефакты, оставшиеся от генеративных моделей. Но по мере улучшения этих моделей эта игра кошки и мышки становится всё менее эффективной. Авторы предлагают проактивный подход: защищать аутентичные кадры сразу при их записи, чтобы зрители и платформы позже могли проверить, является ли увиденное нетронутым оригиналом. Их платформа объединяет три уровня: умный анализатор видео, который решает, где защита важнее всего; невидимый цифровой знак, вплетённый в каждый кадр; и запись в блокчейне, фиксирующая идентичность файла в целом.

Обучение системы тому, что действительно важно в видео

Первый уровень — модель внимания, которая учится определять, какие части видео содержат наиболее значимое движение и детали во времени. Команда обучает компактную, но мощную сеть на тысячах повседневных клипов с людьми, выполняющими действия. Одна часть сети рассматривает каждый кадр как статичную фотографию, другая — анализирует движение в фрагментах по 16 кадров. Вместе они достигают более 97% точности на стандартном тесте по распознаванию действий, что показывает, что система выучила богатые закономерности изменения людей и сцен во времени. Эти паттерны затем превращаются в карты внимания, которые выделяют области, где любое вмешательство сильнее всего повлияет на рассказ, который передаёт видео.

Скрытие секретного знака там, где фальсификаторы нанесут наибольший урон

Далее в каждый кадр внедряется невидимый цифровой знак — водяной знак — но не простым, равномерным способом. Генеративная сеть создаёт тонкий, похожий на шум паттерн, который сильнее встраивается в области, отмеченные моделью внимания как важные (например, лица или движущиеся руки), и слабее — в других местах, чтобы сохранить качество изображения. Зрители не замечают разницы, и оценки качества подтверждают, что помеченные кадры почти неотличимы от оригиналов. В то же время паттерн достаточно сильный и сложный, чтобы сопутствующая сеть‑декодер позже могла восстановить скрытую подпись из подлинного видео по кадрам.

Проверка на дипфейки и повседневные искажения

Чтобы понять, как защита работает в реальных условиях, авторы проводят серию стресс‑тестов. Сначала они наносят водяной знак на разнообразный набор коротких стоковых видео, а затем загоняют их в DeepFaceLab — один из наиболее распространённых инструментов для замены лиц — чтобы создать правдоподобные дипфейки. В каждом из 50 обработанных клипов скрытый знак либо уничтожается, либо сильно искажается, и система корректно помечает видео как поддельное. Метод также хорошо выдерживает типичные этапы обработки, такие как сильная рекомпрессия, изменение размеров и размытие, которые часто происходят при распространении клипов в интернете, хотя очень сильный случайный шум в конце концов может подавить скрытый сигнал. Тщательные эксперименты показывают, что как направляющая внимания, так и учёт движения во времени критически важны; удаление любого из компонентов заметно ослабляет защиту.

Фиксация доверия постоянным отпечатком

Последний уровень выходит за рамки содержимого кадров и защищает сам файл видео. После встраивания водяного знака полный файл пропускают через криптографическую функцию, которая производит короткий цифровой отпечаток. Этот отпечаток, вместе с базовой информацией о клипе, записывается в блокчейн‑реестр, где его нельзя изменить, не оставив следа. Позже любой может загрузить копию видео: система пытается восстановить водяной знак и также пересчитывает отпечаток. Если как скрытый знак, так и криптографический отпечаток совпадают с оригинальной записью, видео можно с высокой уверенностью считать подлинным; если хотя бы одно из них не проходит проверку, зрители узнают, что материал был изменён.

Что это значит для видео, которые вы видите

Проще говоря, работа демонстрирует, что мы можем перейти от угадываний, поддельное ли видео, к доказательству того, что видео действительно подлинное. Ненавязчиво вплетая интеллектуальный, трудно поддающийся подделке знак в наиболее значимые части каждого кадра и подкрепляя это записью в защищённом реестре, платформа обнаруживает все протестированные атаки по замене лиц и выдерживает многие повседневные искажения. Хотя метод всё ещё испытывает трудности при экстремальном визуальном шуме и требует более широких испытаний, он указывает на будущее, в котором камеры, платформы и редакции смогут выпускать видео с встроенным доказательством подлинности — что значительно осложнит попытки представить дипфейки как правду.

Цитирование: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Ключевые слова: защита от дипфейков, аутентичность видео, цифровое водяное клеймо, проверка в блокчейне, безопасность медиа