Clear Sky Science · ru

Надёжное распознавание мест при изменениях освещения с помощью псевдо‑LiDAR, получаемого из омнинаправленных изображений

Роботы, которые никогда не теряются в темноте

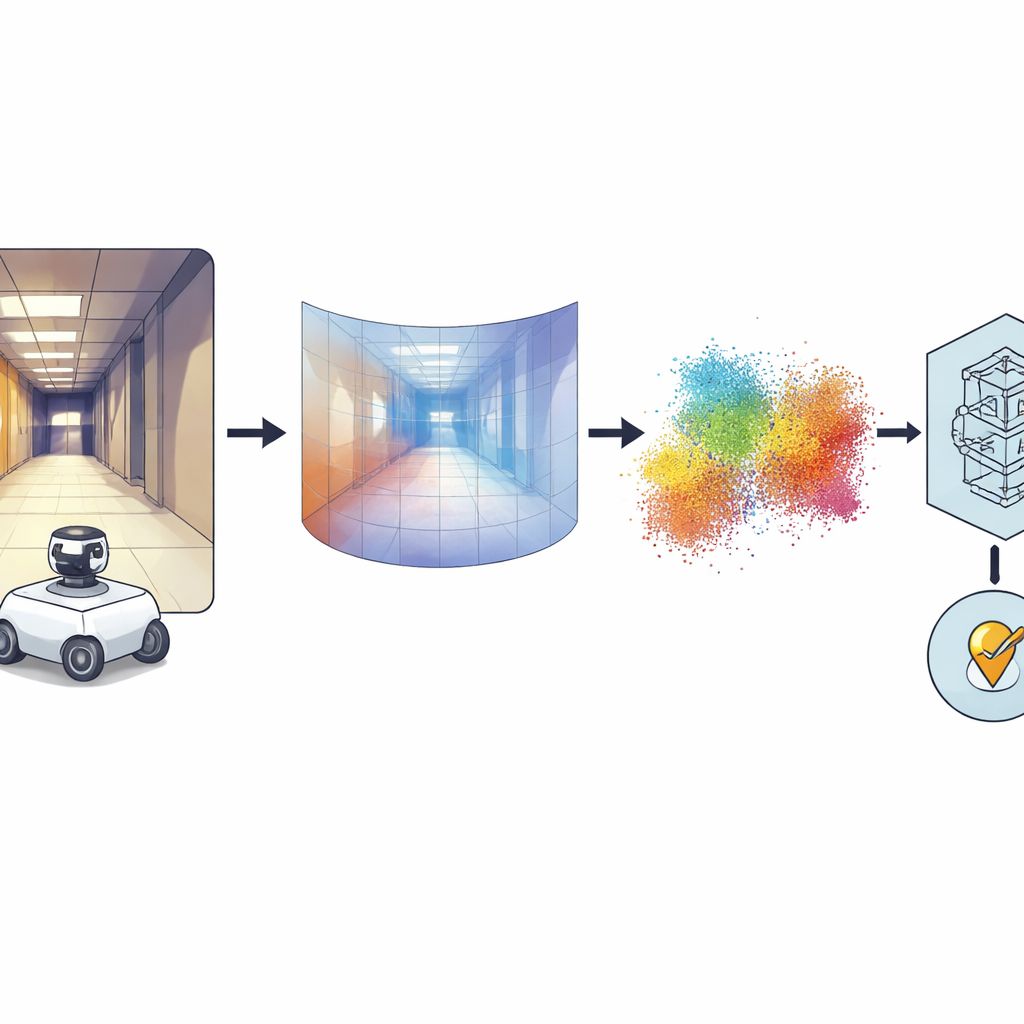

Представьте робота, который может определить своё местоположение в здании — будь то полдень с солнечными лучами, пробивающимися через окна, или глубокая ночь с несколькими включёнными лампами. В этой статье представлен новый способ обеспечить роботам такое надёжное чувство места, используя всего одну, относительно дешёвую камеру. Превращая плоские изображения в 3D‑информацию, исследователи делают навигацию робота значительно менее чувствительной к теням, бликам и другим сложным изменениям освещения, которые обычно сбивают с толку системы на основе зрения.

Почему сложно распознать одно и то же место дважды

Для робота «распознавание места» означает осознание: «Я здесь уже был», чтобы локализоваться на карте и двигаться безопасно. Традиционные системы опираются либо на обычные камеры, либо на лазерные дальномеры LiDAR. Камеры недорогие и захватывают богатую цветовую и текстурную информацию, но их изображение сильно меняется в пасмурную, солнечную или ночную погоду. LiDAR гораздо более стабилен, поскольку измеряет расстояние напрямую, но он громоздок и дорог. Некоторые роботы сочетают несколько датчиков, но это увеличивает стоимость и сложность системы. Авторы этой работы идут иным путём: они упрощают аппаратную часть, используя лишь одну омнинаправленную камеру, которая видит всё вокруг робота, и совершенствуют программное обеспечение, чтобы робот рассуждал о 3D‑структуре вместо необработанного внешнего вида.

От панорамных фото к 3D‑формам

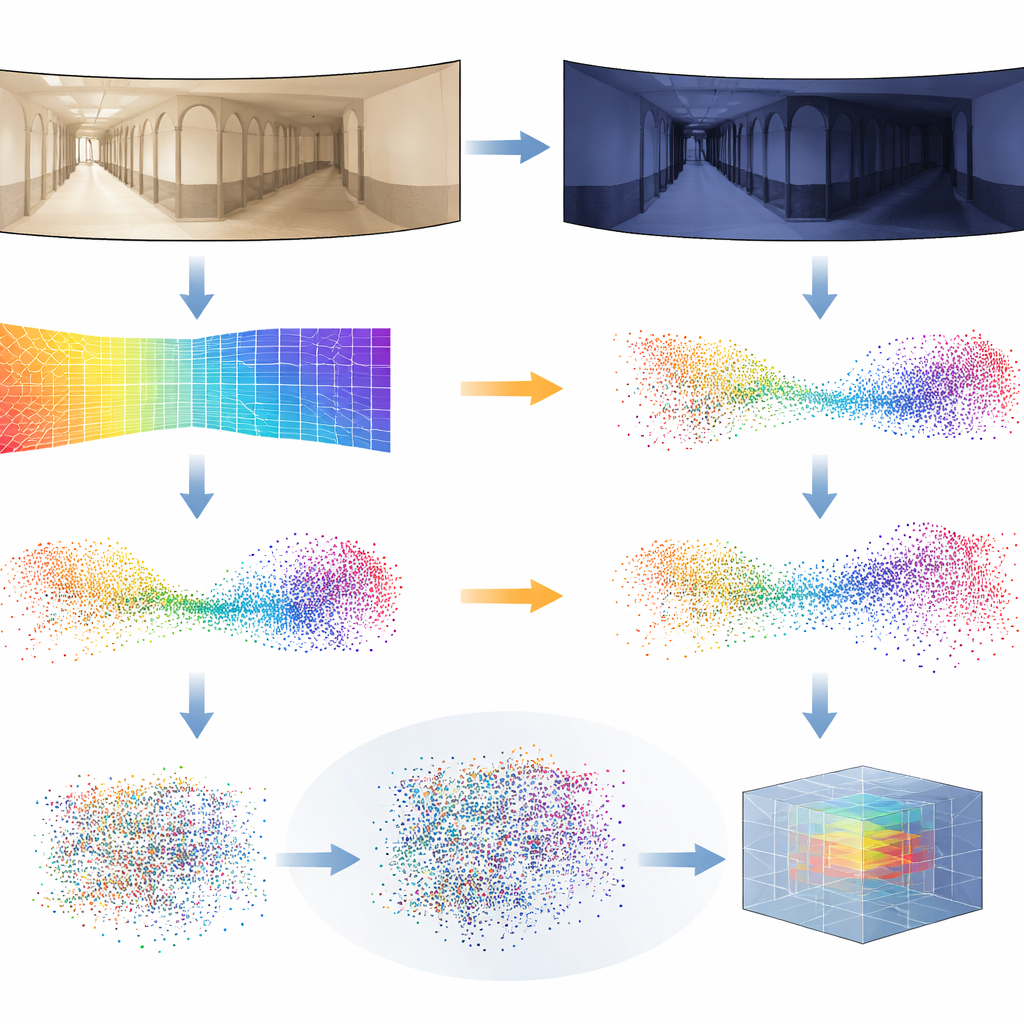

Ключевая идея заключается в преобразовании каждой панорамной фотографии в плотную карту глубины, где каждый пиксель кодирует, на каком расстоянии от камеры находится соответствующая часть сцены. Для этого авторы используют мощную «фундаментальную» модель под названием Distill Any Depth, которая научилась восстанавливать глубину по огромным коллекциям изображений. Полученная карта глубины затем преобразуется в облако 3D‑точек — своего рода виртуальный LiDAR, или псевдо‑LiDAR — без необходимости в реальном лазерном сканере. Дополнительная обработка устраняет артефакты, вызванные специальным зеркалом, используемым для 360‑градусной камеры, заполняя пропуски и области с окклюзиями. Наконец, нейросеть под названием MinkUNeXt, спроектированная для работы напрямую с 3D‑облаками точек, сжимает каждое облако в компактный отпечаток, отражающий общую планировку места.

Обучение системы не обращать внимания на трюки света

Оценки глубины не идеальны, особенно когда освещение резко меняется. Чтобы сделать систему устойчивой, исследователи вводят новый приём обучения, который они называют Distilled Depth Variations. Вместо того чтобы полагаться на одну модель глубины, они намеренно смешивают предсказания глубины от нескольких меньших, менее точных версий оценщика глубины. Этот контролируемый «шум» имитирует искажения, которые появляются при разных условиях освещения, вынуждая 3D‑сеть учиться выделять действительно важные геометрические признаки места и игнорировать то, что можно считать несущественным. Также авторы обогащают каждую 3D‑точку информацией об границах изображения и интенсивности текстуры — признаках, которые обычно более стабильны при изменениях освещения, чем сырые цвета.

Доказательства эффективности в реальном мире

Чтобы проверить свой подход, команда использовала требовательные публичные датасеты с поездками робota по внутренним помещениям. В этих наборах робот несколько раз проходит по коридорам и комнатам при пасмурной погоде, ярком солнце и ночью, при этом мебель и люди перемещаются. Авторы обучали свою систему только на пасмурных изображениях из одного здания, а затем оценивали её по всем зданиям и условиям освещения, включая сцены, которых она раньше не видела. Их метод псевдо‑LiDAR последовательно сопоставлял или превосходил ведущие 2D‑методы и другие 3D‑системы, особенно в самых сложных случаях, таких как ночные прогонки или переносы в совершенно новые окружения. Они также показали, что та же цепочка обработки работает и с обычными фронтальными камерами, а не только с панорамными, заменив соответствующую проекцию из глубины в 3D.

Что это значит для будущих роботов

Проще говоря, эта работа показывает, что робот может получить LiDAR‑подобное понимание окружающего пространства, используя всего одну камеру и продуманный софт. Сосредоточившись на 3D‑структуре вместо изменчивых деталей освещения и цвета, система способна надёжно распознавать места в разное время суток и при погодных изменениях, при этом аппаратная часть остаётся простой и доступной. Это может сделать устойчивую внутренняя навигацию более доступной для сервисных роботов, складских машин и вспомогательных устройств, а также открыть путь к будущим системам, которые объединят глубину с более высоким уровнем понимания сцены для ещё большей надёжности автономии.

Цитирование: Cabrera, J.J., Alfaro, M., Gil, A. et al. Robust place recognition under illumination changes using pseudo-LiDAR from omnidirectional images. Sci Rep 16, 8817 (2026). https://doi.org/10.1038/s41598-026-39848-y

Ключевые слова: локализация робота, 3D‑зрение, распознавание места, оценка глубины, омнинаправленные камеры