Clear Sky Science · ru

Калибровка глубоких классификаторов с помощью динамической передачи доверия и адаптивной нормализации

Почему важно доверять уверенности ИИ

Современные системы искусственного интеллекта не только называют то, что, по их мнению, изображено на фото или в показании датчика — они также выдают оценку своей уверенности. Эта самодекларируемая уверенность критична в сферах с высокими требованиями к безопасности, таких как медицинская визуализация, автономное вождение или промышленный мониторинг, где неверное ощущение уверенности может привести к опасным последствиям. Однако глубокие нейронные сети сегодня печально известны своей склонностью быть чрезмерно уверенными в ошибках, а существующие исправления часто не работают при несбалансированных данных или меняющихся условиях. В этой статье предложен новый метод, названный Dynamic Confidence Propagation with Alternating Normalization (DCP‑AN), который призван сделать оценки уверенности ИИ более честными, стабильными и эффективными в реалистичных, изменяющихся условиях.

Когда умные машины слишком уверены в себе

Большинство популярных моделей глубокого обучения обучаются предсказывать правильную метку, а не оценивать, насколько можно доверять каждому предсказанию. В результате сеть может быть на 99% «уверена», что на изображении кошка, хотя на самом деле это собака. Стандартные методы калибровки, такие как температурная шкалировка или разбиение предсказаний по бинам доверия, пытаются исправить это постфактум, применяя глобальные корректировки. Однако эти подходы обращаются со всеми классами и примерами одинаково. В реальном мире данные редко бывают сбалансированными: несколько распространённых «головных» классов имеют много примеров, тогда как редкие «хвостовые» классы могут встречаться лишь несколько раз. Сети склонны быть чрезмерно уверенными в распространённых классах и недостаточно уверенными в редких, разрыв, который статические, универсальные исправления не могут устранить — особенно когда распределение данных меняется между доменами, например от художественных эскизов к фотографиям реального мира.

Новый способ обмена информацией между данными и метками

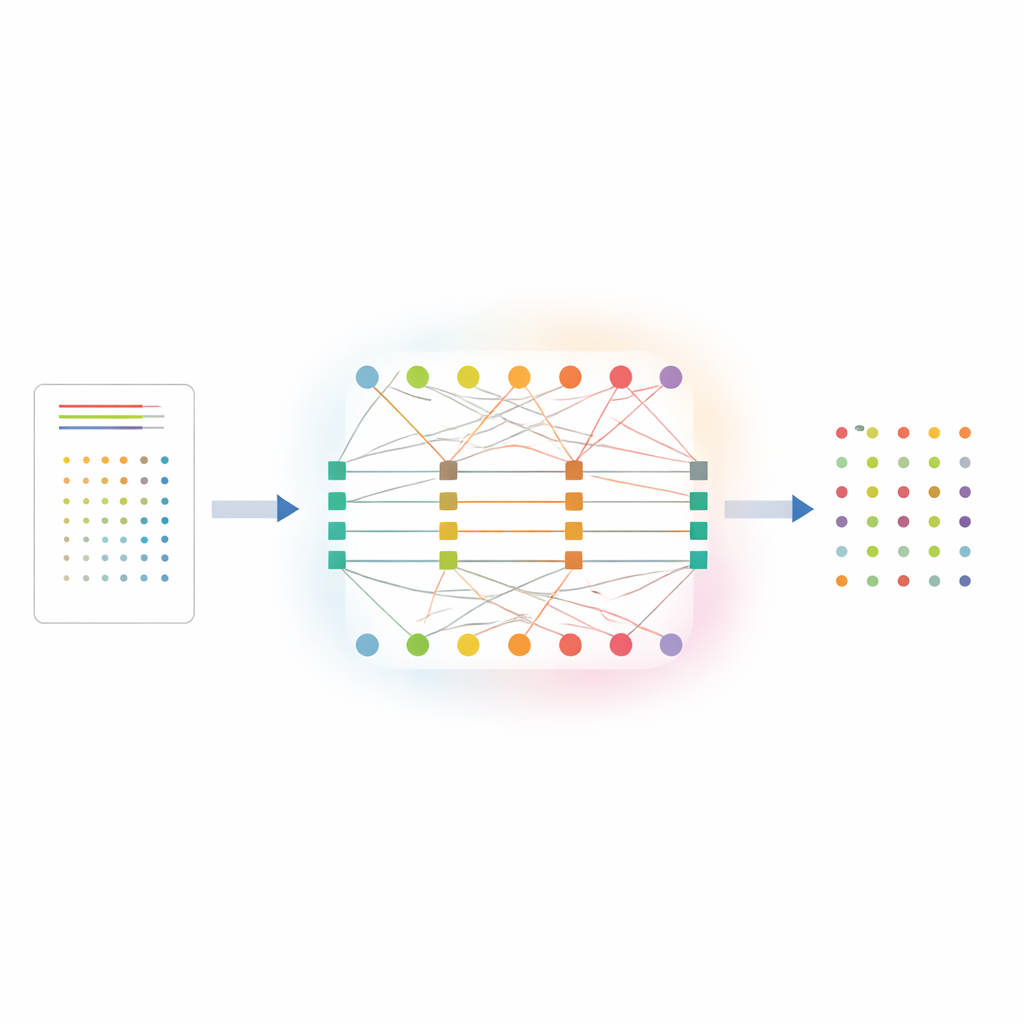

DCP‑AN решает эту проблему, явно моделируя, как уверенность должна течь между отдельными образцами и классами, которым они принадлежат. Метод представляет отношения между образцами и классами в виде двухслойной сети: один слой узлов — образцы, другой — классы, связанные взвешенными соединениями, кодирующими начительные силы предсказаний. Затем уверенность уточняется через двухэтапный обмен. На первом шаге информация течёт от образцов к классам, корректируя, насколько «размазанными» будут предсказания каждого класса, под управлением текущей неопределённости этого класса. На втором шаге информация возвращается от классов к образцам, подталкивая профиль уверенности каждого примера в соответствии с его согласованностью с ранними оценками. Повторяя этот процесс туда‑обратно ограниченное число раз, система поощряет лучшее «взаимодействие» между примерами и метками, так что редкие классы получают более ясные сигналы вместо того, чтобы тонуть в потоке сигналов от общих классов.

Регулировка силы вмешательства там, где это нужно

Ключевым новшеством DCP‑AN является адаптивное «поле температуры», которое изменяет, насколько сильно метод перераспределяет уверенность, в зависимости от локальной и глобальной неопределённости. Вместо одной единой температуры для всех предсказаний метод вычисляет отдельные силы корректировки для классов и для образцов на основе мер неопределённости и рассогласования во времени. Для «головных» классов, с которыми сеть уже уверенно справляется, эффективная температура мягко понижается, предотвращая чрезмерное сглаживание и сохраняя чёткие различия. Для «хвостовых» классов и неоднозначных образцов температура повышается, позволяя сильнее корректировать, что повышает их уверенность при обосновании и подавляет ложные всплески. Такое динамическое поведение вытекает из принципиального правила обновления и демонстрирует быструю реакцию при росте неопределённости, оставаясь стабильным, когда модель уже хорошо согласована.

Надёжное улучшение в разных задачах и на разном железе

Авторы тщательно оценивают DCP‑AN на нескольких широко используемых наборах изображений. На варианте ImageNet с длиннохвостым распределением, где некоторые категории имеют в сотни раз больше изображений, чем другие, метод повышает точность по редким хвостовым классам примерно на 10 процентных пунктов и сокращает стандартную меру ошибки калибровки более чем вдвое по сравнению с некорректированным базовым вариантом. В сквозном тесте переноса домена, где модель обучают на художественных изображениях, а затем применяют к фотографиям реального мира, DCP‑AN одновременно повышает точность в новом домене и уменьшает статистическую меру разрыва между исходными и целевыми данными. Важно, что эти улучшения не требуют значительных вычислительных затрат: при запуске на современной графической плате метод добавляет чуть более миллисекунды задержки и менее половины мегабайта дополнительной памяти, что делает его практичным для применения в реальном времени и на периферийных устройствах.

Что это значит для повседневного ИИ

Проще говоря, эта работа показывает, что мы можем сделать системы ИИ не только умнее, но и более самосознающими в вопросе того, когда они могут ошибаться. Позволяя информации о доверии течь туда и обратно между примерами и категориями и адаптируя агрессивность самокоррекции в зависимости от меняющейся неопределённости, DCP‑AN даёт вероятностные оценки, которые лучше соответствуют реальности — даже для редких событий и при смене окружения. Поскольку метод сопровождается математическим гарантом быстрого сходимого поведения итеративных обновлений и требует минимальных накладных расходов, его можно внедрить в существующие нейронные сети в таких областях, как здравоохранение, робототехника и мониторинг безопасности. В результате ИИ по‑прежнему будет допускать ошибки, но станет гораздо честнее в оценке своей уверенности — важный шаг к системам, на которые можно безопасно полагаться.

Цитирование: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Ключевые слова: калибровка доверия, глубокие нейронные сети, распознавание с длинным хвостом, оценка неопределённости, адаптация домена