Clear Sky Science · ru

Гибкая платформа для оптимизации гиперпараметров с использованием гомотопии и суррогатных моделей

Почему важно настраивать «ручки» ИИ

Современные системы искусственного интеллекта зависят не только от продуманных алгоритмов и огромных объёмов данных, но и от удивительно привередливого уровня настроек, называемых «гиперпараметрами». Это те самые ручки, которые определяют, какого размера должна быть модель, как быстро она учится и как она справляется с шумными данными. Ошибочная настройка может превратить многообещающую систему в неудачу. В этой статье представлен HomOpt — новый подход к настройке таких параметров более эффективно и надёжно, особенно когда пространство поиска огромное и хаотичное, что делает его полезным для всех, кто стремится улучшить работу ИИ с меньшим количеством проб и ошибок.

Новый способ направлять поиск

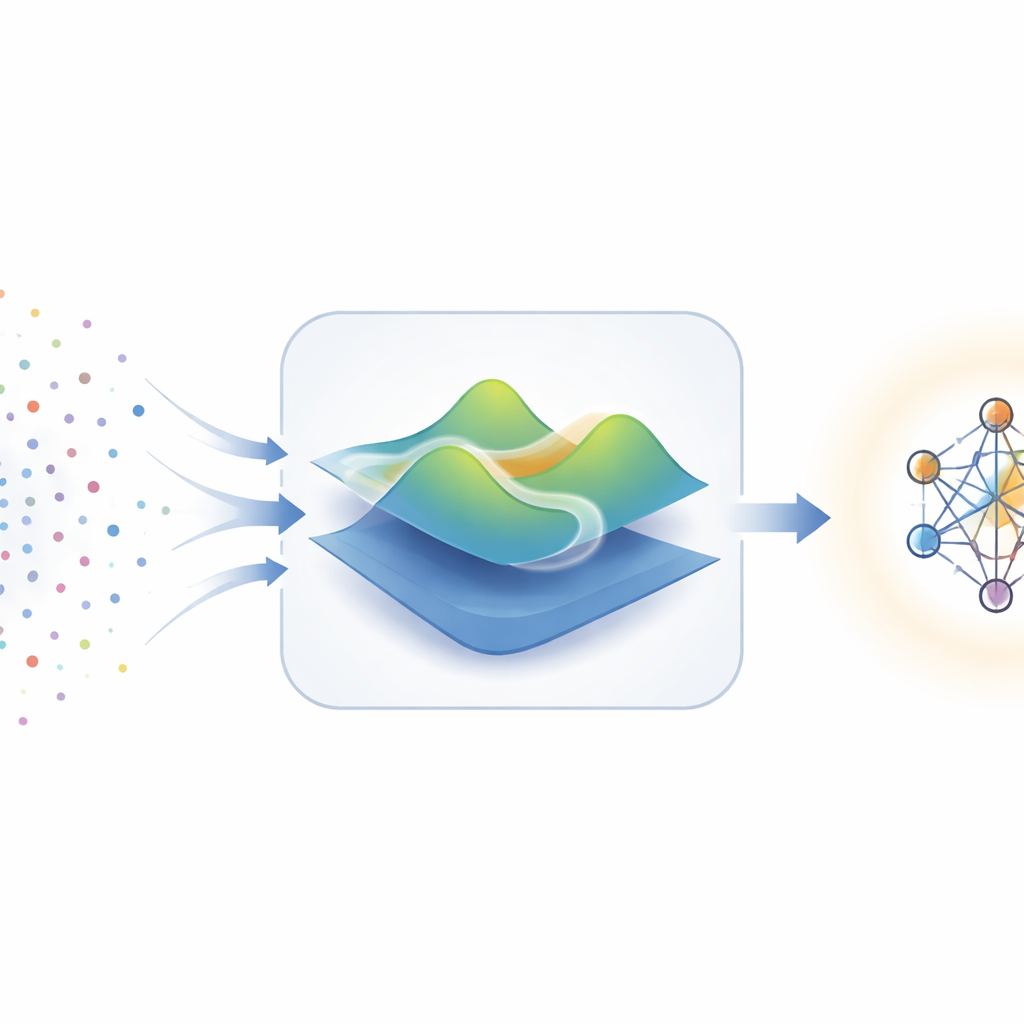

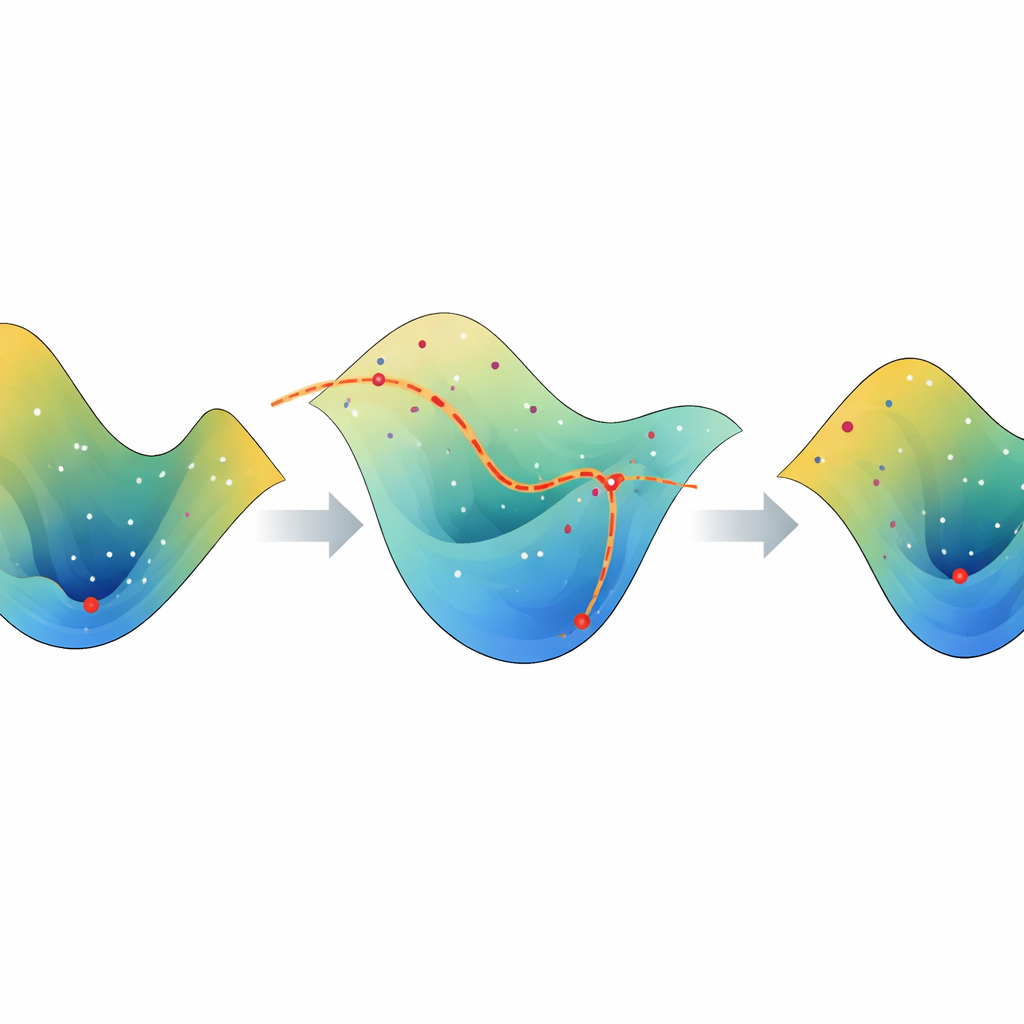

Традиционные подходы к тюнингу гиперпараметров, такие как перебор по сетке или случайный поиск, похожи на попытки готовить по рецепту, просто смешивая ингредиенты и надеясь, что получится вкусно. Более изощрённые методы, например байесовская оптимизация, пытаются действовать умнее: строят приближённую модель того, как настройки влияют на качество, и используют её, чтобы выбрать следующий набор параметров. Но эти методы предполагают, что «ландшафт» качества гладкий и хорошо себя ведёт, что в реальных задачах, полных особенностей, шума и резких скачков, часто неверно. HomOpt решает эту проблему, многократно строя приближённые заменители истинного ландшафта — так называемые суррогатные модели — и плавно преобразуя одну суррогатную модель в другую по мере поступления новых данных, при этом отслеживая, как лучший найденный пункт перемещается в ходе этого преобразования.

Плавная морфинга моделей вместо начала с нуля

Ключевая идея HomOpt заимствована из математической концепции гомотопии, которая, простыми словами, описывает постепенное превращение одной формы в другую без разрывов и скачков. В этой схеме каждая суррогатная модель представляет собой сглаженное изображение того, как разные настройки гиперпараметров влияют на качество модели. По мере накопления новых экспериментальных результатов HomOpt строит обновлённый суррогат и задаёт непрерывное преобразование между старой и новой версиями. Вместо того чтобы выбрасывать проделанную работу и заново запускать поиск, метод отслеживает, как наилучший пункт на старой поверхности скользит по этому изменяющемуся ландшафту, чтобы оказаться в хорошем пункте на новой поверхности. Такое направляемое движение делает поиск более целенаправленным и менее случайным, повышая шансы найти лучшие настройки за меньшее число шагов.

Гибкие инструменты для разных типов данных

Чтобы показать применимость идеи на практике, авторы подставляют в HomOpt две разные по сути суррогатные модели. Во-первых, они используют обобщённые аддитивные модели — гладкие и довольно интерпретируемые, полезные там, где связи между настройками и качеством меняются постепенно. Во-вторых, применяют CatBoost — мощный ансамблевый метод, хорошо подходящий для сложных задач с высокими размерностями, например в задачах распознавания изображений. HomOpt не привязан к одной суррогатной модели: выбор модели рассматривается как подключаемый компонент, который можно подобрать под сложность и структуру задачи. Фреймворк может работать с непрерывными, дискретными и категориальными настройками и накладываться на распространённые стратегии поиска, такие как случайный поиск, байесовская оптимизация или методы на деревьях, выступая слоем доработки, а не заменой.

Испытание метода на практике

Исследователи оценивают HomOpt на разнородном наборе эталонных тестов. На классических задачах машинного обучения с публичными табличными наборами данных они настраивают модели вроде опорных векторов, случайных лесов, логистической регрессии, многослойных перцептронов и градиентного бустинга. Также они изучают требовательные задачи распознавания открытых классов, где системе приходится иметь дело с ранее невиданными категориями, используя специализированный классификатор Extreme Value Machine. Наконец, HomOpt тестируют на таблицах поиска архитектур нейронных сетей для известных наборов изображений, таких как CIFAR-10 и коллекции в стиле ImageNet, где пространство возможных архитектур особенно велико и неровно. Во многих из этих сценариев HomOpt либо ускоряет движение к хорошим решениям, либо улучшает итоговое качество по сравнению с базовыми методами, часто требуя меньше дорогостоящих оценок моделей.

Что это значит для практики ИИ

Для практиков основной вывод таков: HomOpt предлагает структурированный способ сделать настройку гиперпараметров умнее, а не просто более исчерпывающей. Постоянно уточняя приближённую картину ландшафта качества и плавно отслеживая, как её наилучший пункт смещается по мере улучшения этой картины, метод сокращает напрасный поиск и эффективнее использует каждый запуск модели. Поскольку он совместим с широким спектром метрик потерь, типов моделей и стратегий поиска, HomOpt можно рассматривать как универсальное дополнение к существующим инструментам оптимизации. Проще говоря, он обещает получить более точные и надёжные ИИ-системы за те же вычислительные ресурсы — и сделать это как для небольших табличных задач, так и для крупных сложных задач в области компьютерного зрения.

Цитирование: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Ключевые слова: оптимизация гиперпараметров, суррогатные модели, методы гомотопии, автоматизированное машинное обучение, поиск архитектур нейронных сетей