Clear Sky Science · ru

AsynDBT: асинхронная распределённая bilevel-настройка для эффективного in-context обучения больших языковых моделей

Почему умные подсказки важны для повседневного ИИ

Большие языковые модели ныне питают чат-ботов, поисковые системы и помощников по написанию текстов, которыми многие пользуются ежедневно. Тем не менее получение полезных ответов по-прежнему во многом зависит от того, как мы формулируем вопросы и какие примеры показываем модели. В этой статье предложен новый способ автоматического улучшения этих подсказок и примеров на множестве устройств при сохранении приватности данных каждого пользователя. В результате получается ИИ-система, которая учится отвечать точнее и эффективнее, особенно для специализированных задач, таких как обслуживание телекоммуникационных сетей.

Обучать ИИ через показ, а не переобучение

Вместо постоянного переобучения огромных моделей растёт тренд учить их «на ходу», подавая в подсказке несколько тщательно подобранных примеров — процесс, известный как in-context обучение. Например, чтобы классифицировать отзывы о фильмах как положительные или отрицательные, можно показать модели небольшой набор размеченных примеров, а затем попросить пометить новый отзыв. Проблема в том, что выбор примеров и точная формулировка инструкций могут существенно менять качество работы модели. Находить хорошие комбинации вручную медленно и дорого, а обмен сырыми данными между организациями часто невозможен из‑за требований конфиденциальности.

Сотрудничать, не делясь приватными данными

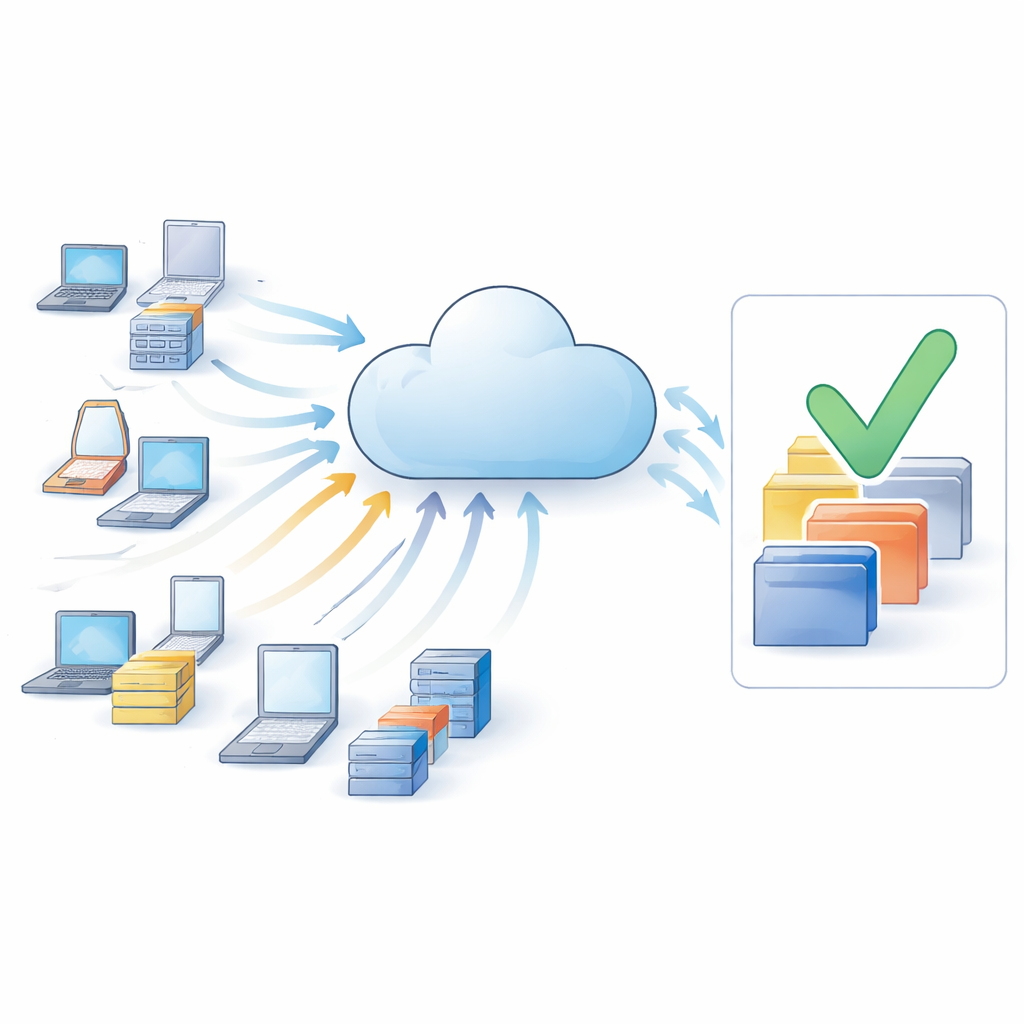

Чтобы обойти барьеры обмена данными, авторы опираются на федеративное обучение — схему, где множество независимых устройств или организаций хранят данные локально, но сотрудничают через центральный сервер. Каждый узел — например, базовая станция оператора или сервер компании — взаимодействует с одной и той же облачной языковой моделью, но никогда не выгружает исходные тексты. Вместо этого он отправляет только сигналы обратной связи о том, как хорошо работают разные подсказки и наборы примеров. Новый алгоритм AsynDBT (асинхронная распределённая bilevel-настройка) координирует эти узлы так, чтобы они совместно улучшали общую стратегию составления подсказок, при этом соблюдая приватность и справляясь с медленными или ненадёжными сетевыми соединениями.

Оптимизация и инструкции, и примеров

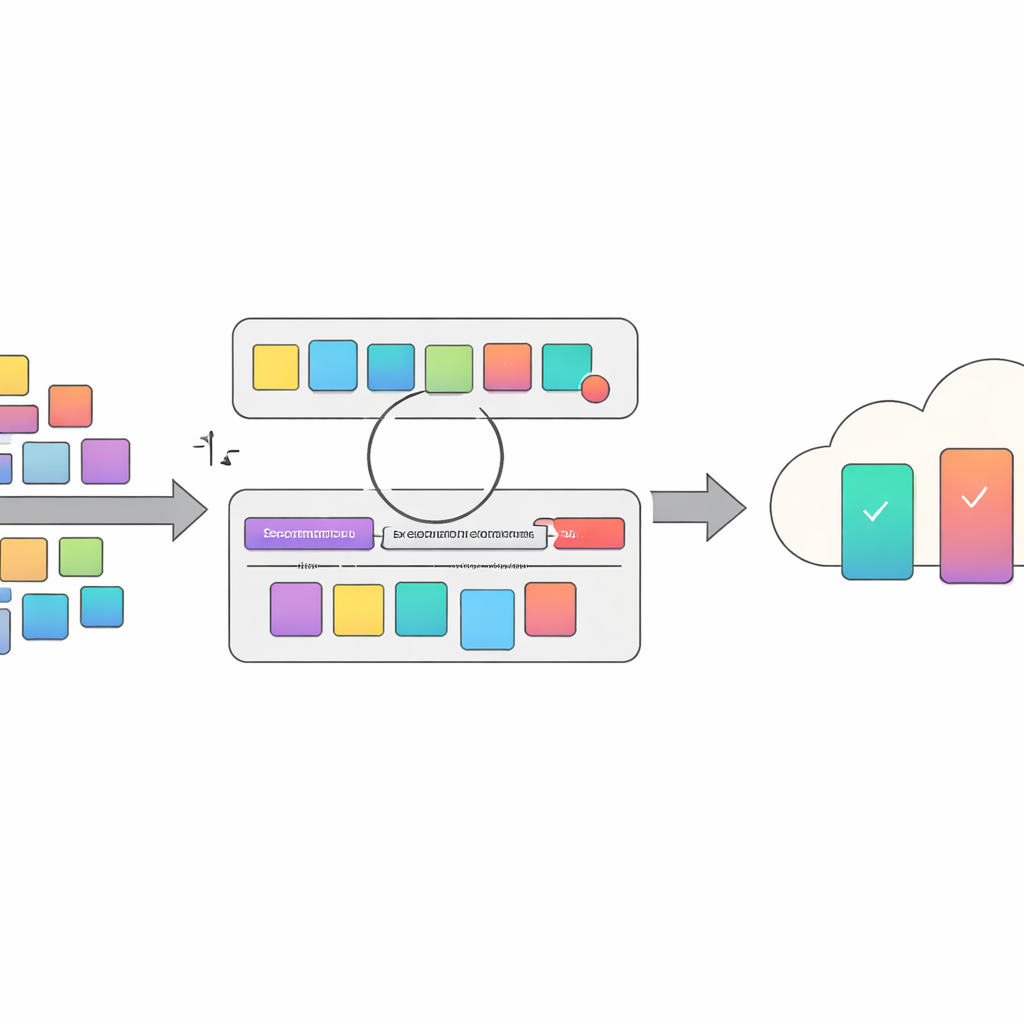

Ключевая идея работы — рассматривать проектирование подсказок как задачу оптимизации в два уровня. На нижнем уровне система корректирует короткие фрагменты, которые добавляются к инструкции по задаче — небольшие изменения формулировки, способные подтолкнуть модель к лучшему рассуждению. На верхнем уровне принимается решение о том, какие размеченные примеры включать в демонстрации. Эти два уровня взаимодействуют: разные наборы примеров требуют разных правок подсказки и наоборот. AsynDBT формализует это взаимодействие математически и использует эффективный приближённый метод, чтобы каждый узел мог постепенно обновлять свои локальные решения, в то время как центральный сервер поддерживает согласованное глобальное представление о решениях нижнего уровня.

Учет медленных устройств и злонамеренных участников

В реальных сетях некоторые устройства отвечают с опозданием или выпадают, создавая «отстающих», которые могут останавливать стандартное синхронное обучение. AsynDBT работает асинхронно: сервер обновляет свои переменные всякий раз, когда отчиталась часть узлов, не дожидаясь всех. Метод также защищает от узлов, которые могут отправлять вводящие в заблуждение обновления — намеренно или по ошибке. Комбинируя методы регуляризации с устойчивыми правилами агрегации, алгоритм снижает влияние поддельных или низкокачественных подборов примеров на глобальную стратегию, помогая системе оставаться стабильной и надёжной даже при атаке.

Доказанные улучшения на языковых и телеком-задачах

Исследователи протестировали AsynDBT на шести задачах классификации текстов, включая требовательный набор данных по 5G-сетям, где модели нужно было оценить, связаны ли специализированные технические термины, используя в качестве контекста лишь фрагменты телеком-стандартов. По сравнению с рядом существующих методов подсказок и отбора примеров новый подход показал лучшую или вторую по качеству точность почти по всем задачам. В частности для 5G‑задачи он улучшил точность примерно на десять процентных пунктов по сравнению с сильнейшим базовым методом. Одновременно асинхронная архитектура сократила время обучения примерно на 40 процентов относительно схожего централизованного метода, который не распределяет работу.

Что это значит для будущих инструментов ИИ

Для неспециалистов вывод таков: лучшие подсказки и более разумный выбор примеров могут заметно улучшать поведение ИИ-систем — без изменения самой модели. AsynDBT предлагает автоматизированный, сохраняющий приватность способ делать это на множестве сотрудничающих устройств, обеспечивая более точные и эффективные языковые инструменты для областей вроде эксплуатации телекоммуникаций, поддержки клиентов и других специализированных сфер. В перспективе авторы планируют объединить свою схему с графовыми механизмами поиска знаний, чтобы подсказки могли опираться на актуальную фактическую информацию, ещё больше снижая галлюцинации и делая ИИ‑ассистентов более надёжными в задачах с высокими ставками.

Цитирование: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

Ключевые слова: in-context обучение, оптимизация подсказок, федеративное обучение, большие языковые модели, конфиденциальный ИИ