Clear Sky Science · ru

Распознавание эмоций, доминирующих в видео, для портативных устройств на основе ЭЭГ

Почему ваши видео могут знать, что вы чувствуете

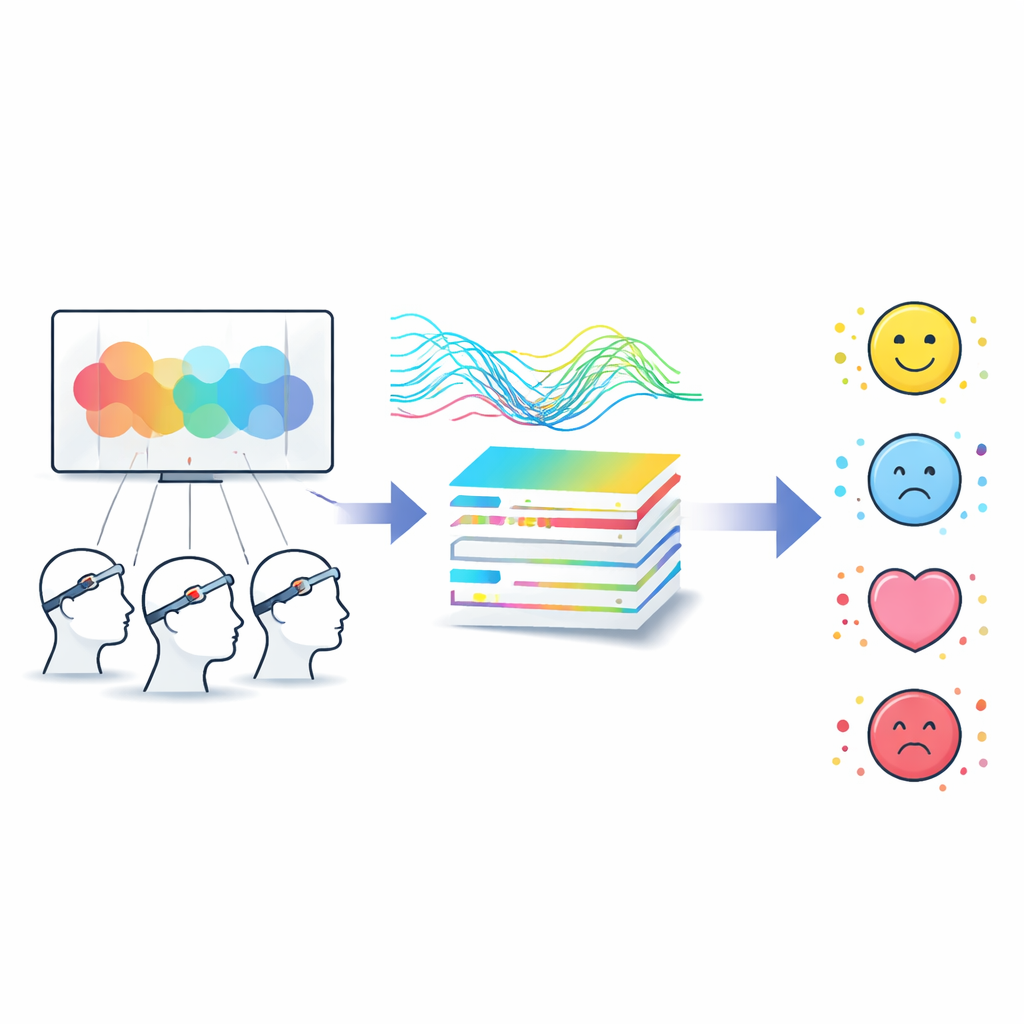

Представьте, что вы смотрите трейлер фильма, а лёгкая повязка на голове незаметно слушает ваш мозг и пытается угадать, чувствуете ли вы радость, расслабление, печаль или испуг. В этом исследовании рассматривается, как сделать такой сценарий реальным, используя небольшое портативное устройство для записи мозговых волн (ЭЭГ) вместо громоздкого лабораторного оборудования. Работа важна для всех, кто интересуется более интеллектуальными медиа: от рекламодателей, желающих понять реакцию аудитории, до стриминговых платформ, которые могли бы рекомендовать передачи на основе реальных чувств зрителей, а не только их кликов.

Чтение чувств по мозговым волнам

Наш мозг генерирует слабые электрические сигналы, которые можно регистрировать с поверхности головы с помощью электроэнцефалографии (ЭЭГ). Эти сигналы тонко меняются, когда мы испытываем разные эмоции. Популярный исследовательский набор данных DEAP записывал ЭЭГ людей во время просмотра музыкальных видео, а затем просил их оценить, насколько приятным, интенсивным, контролируемым и симпатичным показался каждый ролик. Большинство предыдущих работ стремились получить максимально высокую точность, используя множество электродов и мощные компьютеры, но в идеальных лабораторных условиях, не совпадающих с реальной жизнью. Эта статья задаёт более практичный вопрос: можно ли с недорогим портативным устройством и меньшим числом электродов по-прежнему зафиксировать основную эмоцию, которую видео вызывает у широкой аудитории?

Поиск общей эмоциональной истории

Одна из трудностей — в том, что люди по-разному описывают свои ощущения. Двое зрителей могут оценить один и тот же фрагмент: один назовёт его «волнующим», другой — «обычным». Исследователи решают эту проблему, построив пошаговую систему калибровки меток, которая ищет закономерности между зрителями, а не полагается на оценку одного человека. Сначала все оценки приводят к единой шкале и сжимают до нескольких ключевых измерений. Затем методом неконтролируемой кластеризации группируют похожие эмоциональные реакции, стремясь разделить видео на четыре широкие «угла» эмоционального пространства: радость (приятно и энергично), расслабление (приятно и спокойно), страх (неприятно и энергично) и печаль (неприятно и спокойно). Финальный этап доработки корректирует неуверенные случаи с учётом дополнительной информации об оценках, в результате чего каждой записи присваивается доминирующая метка эмоции, лучше отражающая общее впечатление группы.

Получать больше, используя меньше аппаратуры

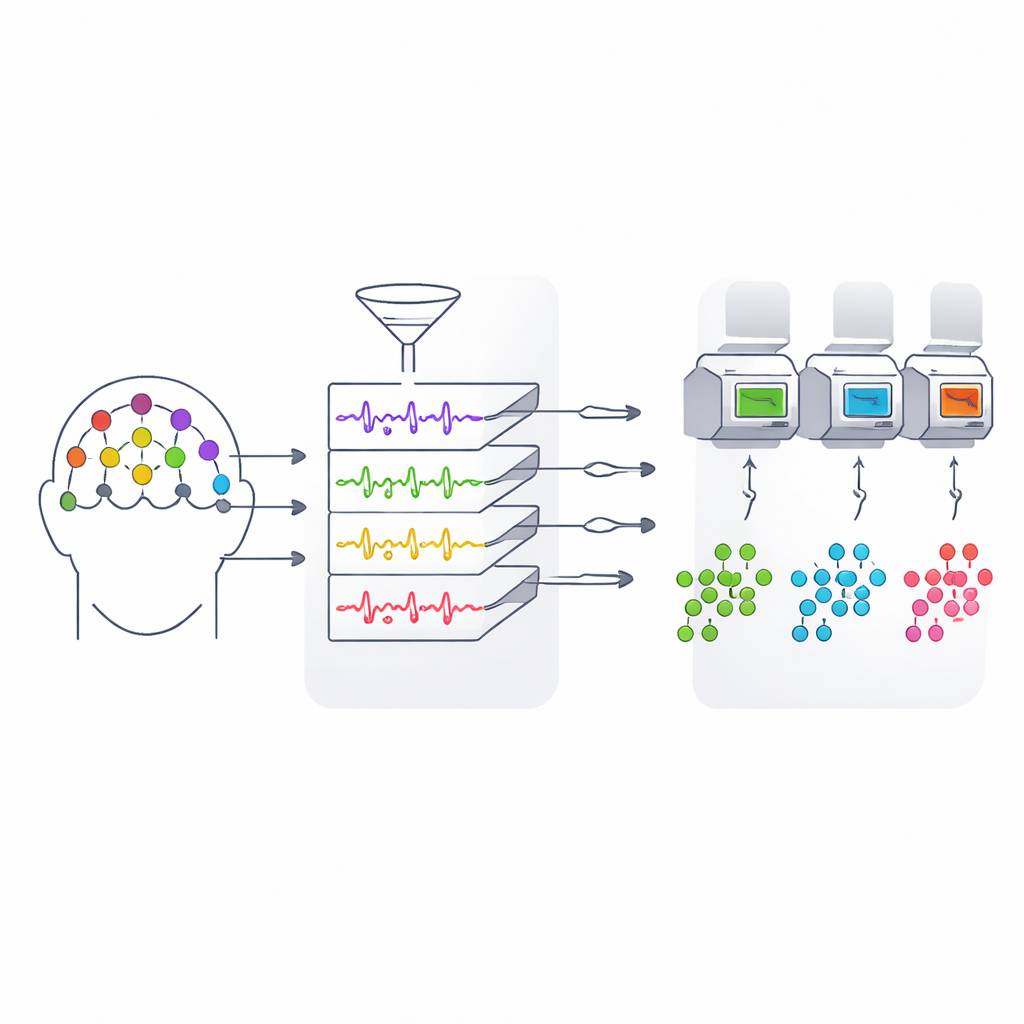

Ещё одна проблема — оборудование: полноразмерные шапочки ЭЭГ с 32 и более электродами неудобны и дороги. Команда разработала способ сократить это до 11 тщательно подобранных точек на лбу, в центре, по бокам и сзади головы — областей, связанных с управлением эмоциями, возбуждением, слухом, зрением и вниманием. Затем они проводят детальный анализ того, как энергия сигнала распределяется по классическим диапазонам мозговых ритмов (от медленных до быстрых) при разных эмоциональных состояниях. Сравнивая эти паттерны, они показывают, что определённые сочетания частот и расположений на скальпе несут особенно сильные подсказки о том, находится ли зритель, например, в состоянии высокого возбуждения или глубокой расслабленности. Подход с отношением энергий в нескольких полосах позволяет сохранить наиболее информативные сигналы и убрать большую часть избыточности.

Пусть данные укажут на важное

Даже при меньшем числе электродов каждую секунду записи сопровождает поток чисел. Чтобы не перегружать модели, авторы комбинируют несколько типов признаков — такие как меры энергии на основе вейвлет-преобразований, степень синхронности колебаний между различными областями мозга и изменение мощности в разных частотах со временем — в богатое, но структурированное описание каждого просмотра. Этап отбора, управляемый значимостью признаков, ранжирует эти характеристики по полезности для разделения эмоций, оставляя лишь компактное подмножество. На основе этого сокращённого представления тренируют три стандартные модели машинного обучения для распознавания одной из четырёх доминирующих эмоций, соответствующей данному видео. В строгих тестах, где система должна обобщать на полностью новых людей, лучшая модель достигает примерно 45% точности — достойный результат для четырёхклассной задачи с шумными мозговыми данными и всего 11 каналами.

Что это значит для повседневных технологий

Для неспециалистов главный вывод в том, что мы можем начинать оценивать, как группы людей реагируют на видео, используя небольшие портативные устройства для записи мозговых волн вместо полноценных лабораторных установок. Очищая эмоциональные метки, фокусируясь на наиболее информативных составляющих ЭЭГ-сигнала и выбирая лишь несколько удачно расположенных датчиков, авторы показывают, что возможно обнаружить доминирующий эмоциональный тон видео — радость, расслабление, страх или печаль — в среднем по зрителям. Система не идеальна, но она указывает путь к практическим инструментам для отслеживания настроений аудитории, тестирования контента и рекомендаций, учитывающих эмоции, основанные на объективных реакциях мозга, а не только на опросах или кликах.

Цитирование: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Ключевые слова: распознавание эмоций по ЭЭГ, интерфейс «мозг-компьютер», анализ влияния видео, носимая нейронаука, аффективные вычисления