Clear Sky Science · ru

Мультимодальные крупные языковые модели бросают вызов Image Challenge NEJM

Почему это важно для пациентов и врачей

Получить правильный диагноз вовремя может означать разницу между быстрой терапией и годами страданий. Тем не менее врачи, даже очень опытные, по‑прежнему пропускают или задерживают постановку диагноза, особенно при редких или необычных заболеваниях. Это исследование ставит поразительный вопрос: если медицинские изображения и клинические данные подать на вход современным передовым системам искусственного интеллекта, смогут ли они диагностировать сложные случаи лучше большого количества реальных врачей — и если да, что это значит для будущей медицинской помощи?

Огромная головоломка, собранная из реальных случаев

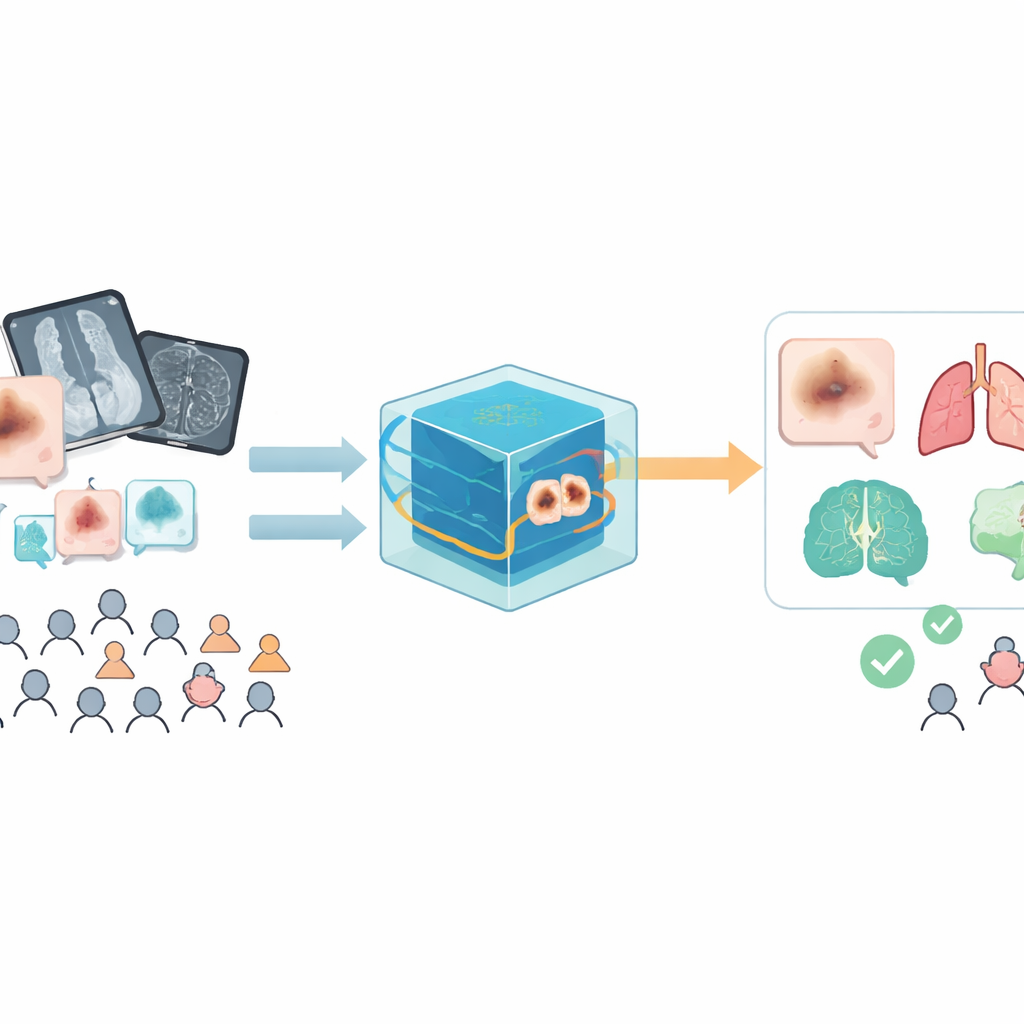

Исследователи обратились к долгосрочному разделу New England Journal of Medicine под названием «Image Challenge». Каждый вызов представляет медицинское изображение реального пациента — например, фото кожи, рентген, МРТ или микроскопический слайд — вместе с короткой клинической историей и пятью вариантами диагноза. С 2009 года накопилось более 16 миллионов ответов от более чем 60 000 врачей на каждый случай, что создало уникальный глобальный архив того, как врачи показывают себя на одинаково сложных вопросах. Из этого архива команда выбрала 272 случая, охватывающих все возрасты, оба пола и широкий спектр состояний — от инфекций и иммунных нарушений до рака, генетических заболеваний и травм.

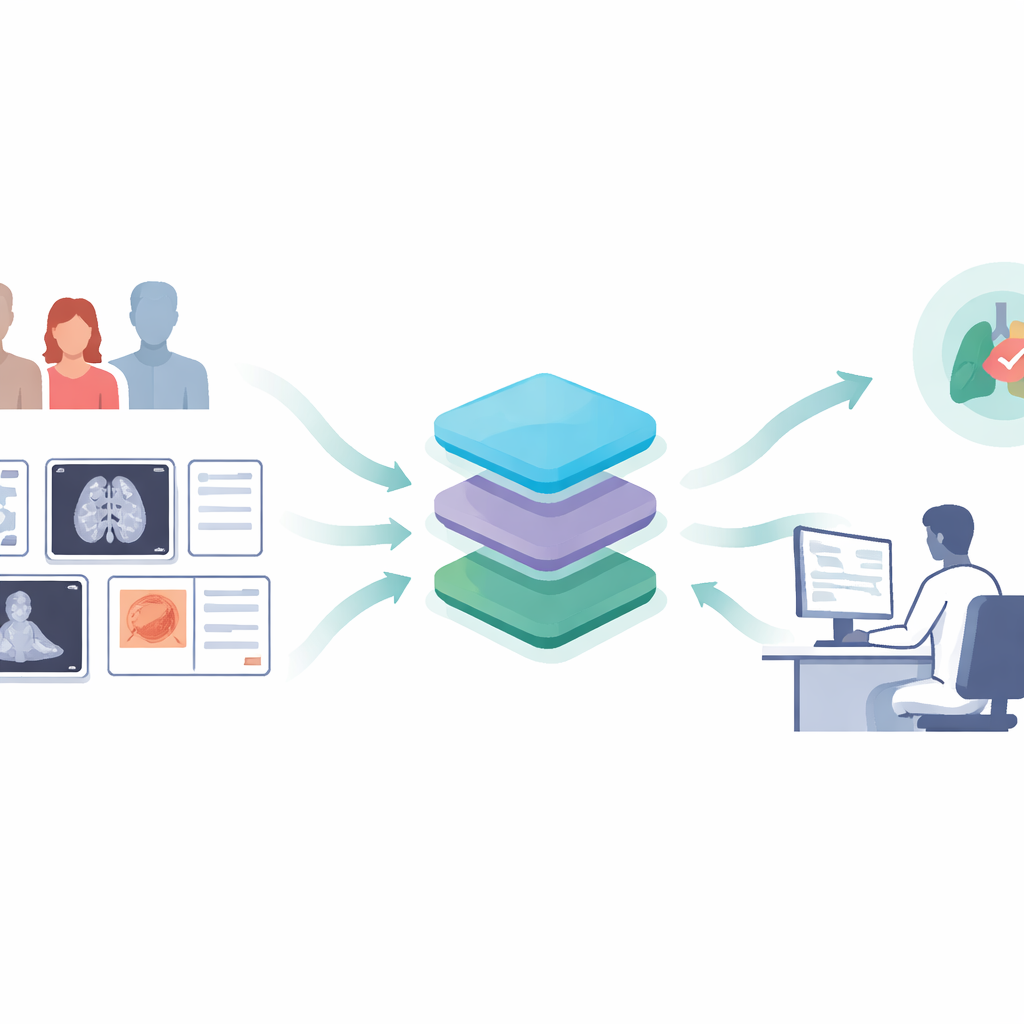

Сравнение ИИ и врачей на равных условиях

В исследовании протестировали три ведущие мультимодальные крупные языковые модели — системы, которые могут одновременно анализировать изображения и текст: GPT‑4o, Claude 3.7 и Doubao. В каждом случае модели сначала видели только изображение и должны были выбрать один из пяти вариантов с объяснением. Затем им показывали изображение вместе с клиническим описанием, и модели отвечали снова. Чтобы сохранить честность теста, системы использовали в стандартных настройках, с отключенным веб‑поиском и дополнительными инструментами рассуждения, а каждый случай запускался в новой сессии, чтобы избежать «загрязнения» предыдущими ответами. Два врача оценивали ответы ИИ по официальным решениям New England Journal, ориентируясь на то, совпадает ли окончательный выбор с истинным диагнозом, так же как и эталон из людей.

Суперчеловеческая точность по широкому кругу заболеваний и типов изображений

При предоставлении и изображения, и текста все три системы ИИ явно превосходили глобальную совокупность врачей. Claude 3.7 и GPT‑4o показали примерно 89–90% точности, по сравнению с 46.7% у большинства голосов врачей — разрыв более чем в 40 процентных пунктов. Даже в самых сложных случаях, где правильно отвечали менее 40% врачей, Claude 3.7 правильно диагностировал 86.5% случаев. Преимущество сохранялось для большинства типов заболеваний и форматов изображений: модели особенно хорошо справлялись с лекарственно‑обусловленными и генетическими состояниями, а также обрабатывали не только фотографии и рентгенограммы, но и эндоскопические, патологические и смешанные наборы изображений. Производительность была одинаково высокой для мужчин и женщин, и в некоторых из наиболее уязвимых групп, например у детей младше года, модели оказались значительно точнее врачей.

Иные умы, а не просто более быстрые

Возможно, самое удивительное — как часто модели оказывались успешнее там, где врачи ошибались. Почти в половине случаев Claude 3.7 был прав, тогда как большинство врачей ошибалось, и обратная ситуация — врачи правы, модель ошибается — встречалась редко. В целом для Claude 3.7 приходилось примерно пятнадцать случаев «преимущества модели» на каждый один случай «преимущества врача». При этом согласие между людьми и ИИ в выборе ответа было низким, что указывает на то, что системы не просто повторяют человеческие шаблоны, а приходят к правильным диагнозам иными путями. Добавление клинического текста обычно значительно помогало, повышая точность ИИ на 28–42 процентных пункта по сравнению с одними только изображениями. Тем не менее в небольшой доле случаев дополнительные детали смещали модели от правильного ответа, основанного на изображении, к неправильному — это намекает на новые виды смещений и режимов отказа, требующие тщательного изучения.

Что это может значить для будущей помощи

Авторы делают вывод, что мультимодальные крупные языковые модели достигли «суперчеловеческого» уровня по этому требовательному диагностическому тесту: они точнее среднего врачебного мнения и сохраняют преимущество даже в случаях, которые ставят в тупик большинство врачей. В то же время низкое совпадение с человеческими ответами говорит о том, что они действуют комплементарно, а не являются цифровыми копиями клиницистов. При разумном применении эти системы могут выступать мощными «вторыми читателями», предлагая независимые мнения по сложным или редким случаям и помогая обнаруживать проблемы, которые могут ускользнуть от врачей. Они еще не готовы заменить клиническое суждение, но вскоре могут стать ценными партнерами у постели больного и в кабинете для чтения изображений, незаметно проверяя нашу работу и расширяя сеть безопасности для пациентов.

Цитирование: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Ключевые слова: медицинская диагностика, искусственный интеллект, медицинская визуализация, редкие болезни, клиническая поддержка принятия решений