Clear Sky Science · ru

FedSCOPE: федеративная кросс-доменная последовательная рекомендация с декуплированным контрастивным обучением и семантическим усилением с сохранением конфиденциальности

Почему важны более умные и безопасные рекомендации

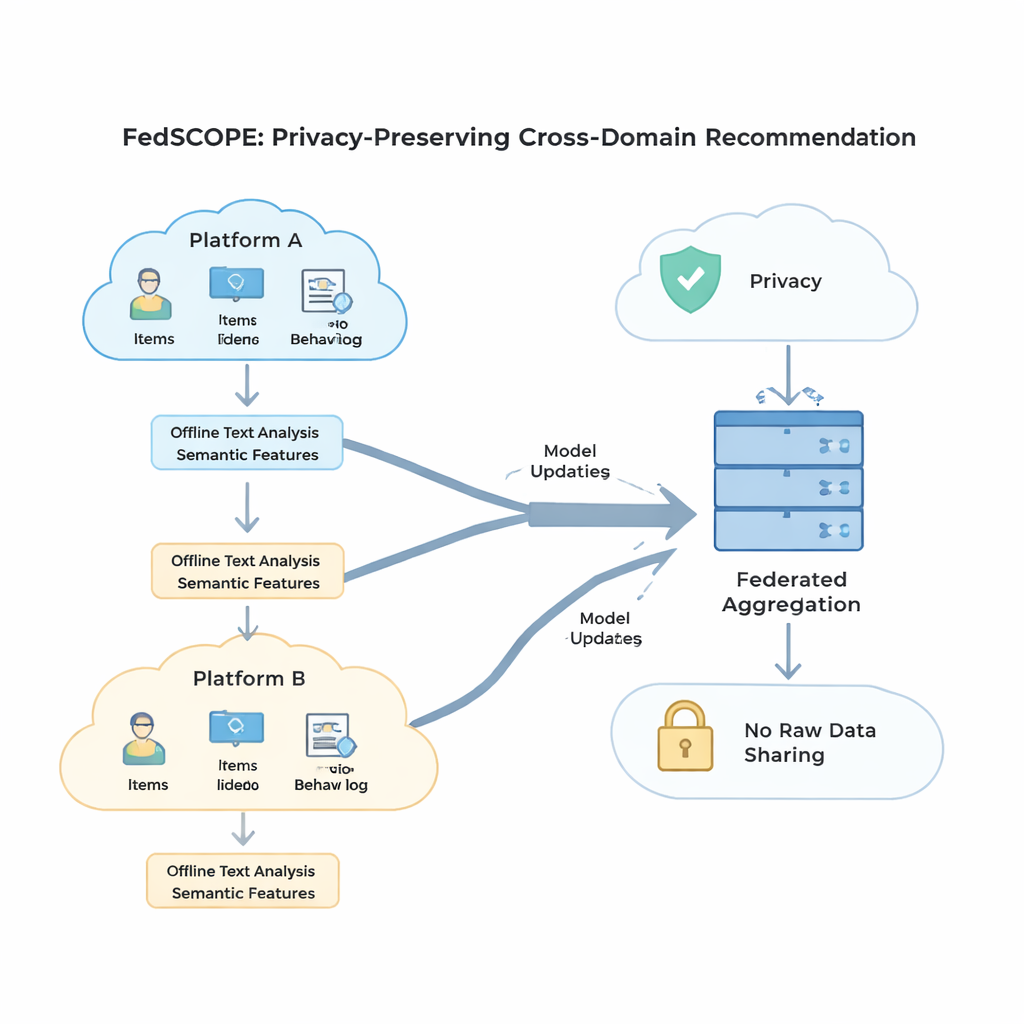

Каждый раз, когда вы просматриваете фильмы, делаете покупки в интернете или читаете отзывы, системы рекомендаций тихо решают, что показать вам дальше. По мере того как наша цифровая жизнь распределяется по множеству приложений и веб-сайтов, эти системы могли бы работать значительно лучше, если бы могли учиться на всей вашей активности сразу — не раскрывая при этом ваши личные данные. В этой статье представлен FedSCOPE, новый подход, позволяющий разным платформам сотрудничать в создании рекомендаций, которые одновременно точнее и более уважительны к приватности пользователей.

В чем проблема современных рекомендательных систем

Большинство существующих систем рекомендаций работают внутри одного приложения или сайта и видят лишь узкую часть вашего поведения. Это значит, что они испытывают трудности с новыми пользователями, у которых мало истории, или с нишевыми товарами, с которыми взаимодействует небольшое число людей. Когда компании пытаются объединить данные из разных доменов — например книги и фильмы или еда и кухонные принадлежности — они сталкиваются с тремя крупными проблемами: данные часто разрежены, разные платформы имеют очень разные типы пользователей и активности, а строгие правила конфиденциальности делают рискованным объединение необработанных данных в одном месте. Простые решения, такие как добавление одинакового уровня шума для всех ради приватности, как правило, либо ослабляют защиту, либо сильно ухудшают точность.

Как модели языка помогают заполнить пробелы

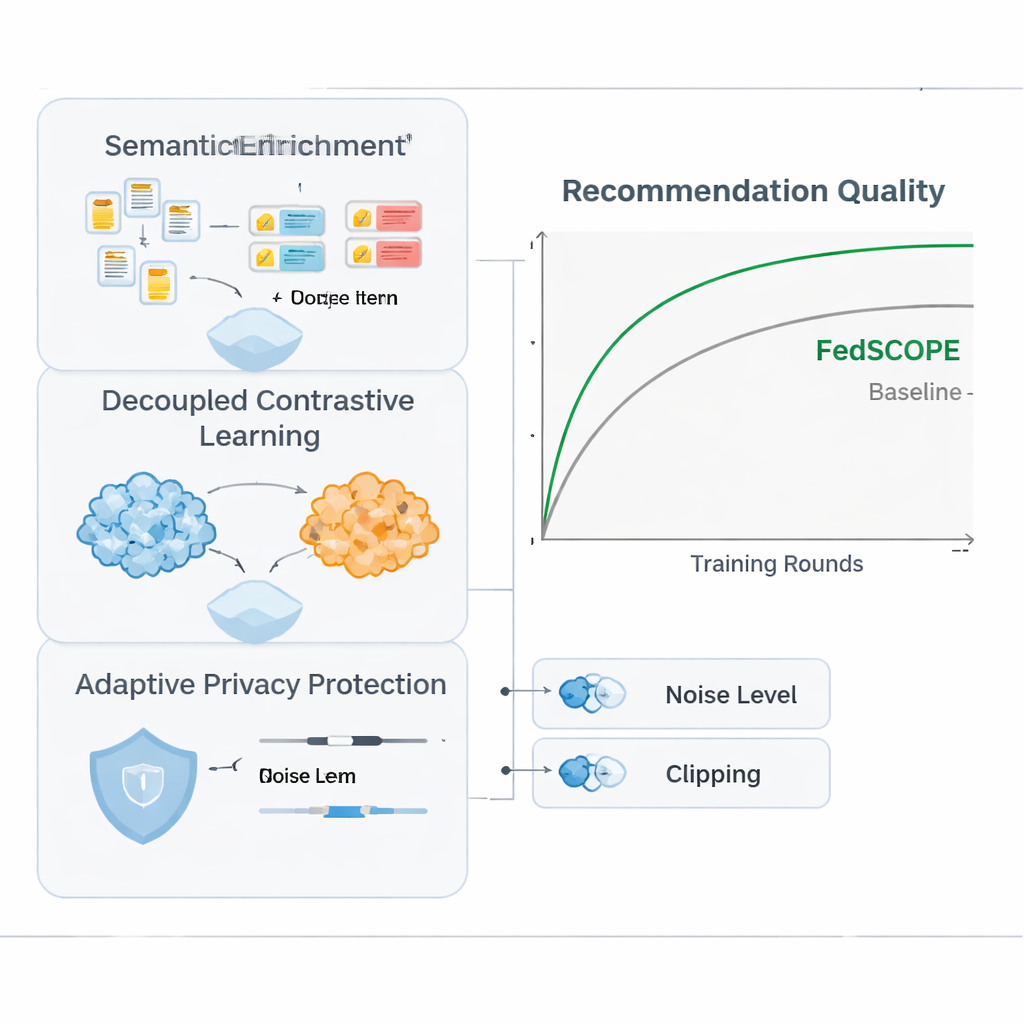

FedSCOPE решает проблему разреженности, предоставляя каждой платформе возможность обогащать свои данные с помощью большой языковой модели (LLM), но делает это необычным, ориентированным на приватность способом. Вместо того чтобы при каждой рекомендации отправлять пользовательские истории в удалённый сервис ИИ, каждый клиент выполняет одноразовую офлайн-операцию: он передаёт названия и базовую информацию об элементах (например, название фильма и жанр) в LLM и запрашивает структурированные описания, такие как вероятные темы, привычки просмотра или родственные интересы. Сгенерированные атрибуты остаются на локальном устройстве или сервере и объединяются с обычной историей кликов и просмотров с помощью лёгкой нейросети. Это даёт системе более богатое представление о пользователях и предметах, что особенно полезно при небольшом количестве записанных взаимодействий. Поскольку процесс происходит офлайн и локально, необработанное поведение никогда не покидает платформу, и нет постоянной зависимости от внешних сервисов ИИ.

Разделение личного и общего

Чтобы использовать поведение из нескольких доменов, не смешивая сигналы вредоносным образом, FedSCOPE вводит стратегию обучения, называемую декуплированным контрастивным обучением. Проще говоря, система учится двум вещам одновременно. Во‑первых, внутри каждого домена — например только в части, связанной с фильмами — она сближает пользователей с похожим поведением и раздвигает тех, кто ведёт себя иначе, уточняя представление о персональных вкусах в этой среде. Во‑вторых, между доменами она выравнивает представления одного и того же пользователя, при этом сохраняя различия между разными пользователями, чтобы то, что вы смотрите, могло помочь предсказать, что вы могли бы читать или покупать, без смешения вас с другими людьми. Обрабатывая цели «внутри домена» и «между доменами» отдельно, метод избегает типичной ошибки, когда принуждение всего к единой общей форме уничтожает тонкие предпочтения.

Защита приватности без утраты полезности

Строгая математическая приватность, известная как дифференциальная приватность, обычно подразумевает добавление случайного шума в обновления модели перед их отправкой на центральный сервер. Многие ранние системы использовали одинаковые настройки приватности для всех участников, что плохо подходит, когда у одних клиентов миллионы пользователей, а у других всего несколько тысяч. FedSCOPE вместо этого назначает каждому клиенту персонализированный бюджет приватности и адаптирует степень обрезки и искажения обновлений в зависимости от размера данных и прошлой активности. Крупные платформы с большим объёмом данных могут вносить более точную информацию без чрезмерного зашумления, в то время как меньшие защищаются более агрессивно. Все обновления затем объединяются с использованием безопасной агрегации, поэтому сервер никогда не видит отдельный вклад в открытом виде.

Что показывают эксперименты на практике

Авторы протестировали FedSCOPE на реальных данных о покупках с Amazon, комбинируя домены, такие как Фильмы и Книги, а также Еда и Кухня. Они сравнили его с рядом современных методов рекомендаций, включая другие подходы с защитой приватности и кросс-доменные методы. По нескольким показателям точности FedSCOPE последовательно занимал одно из ведущих мест. Он сходился быстрее в процессе обучения, лучше работал для пользователей с очень небольшим количеством прошлых взаимодействий и устойчиво проявлял себя при изменении числа участвующих клиентов или доли выборки в каждом раунде. Важно, что при ужесточении требований приватности адаптивная стратегия FedSCOPE сохраняла значительно более высокую производительность по сравнению с системами, использующими универсальную дифференциальную приватность.

Что это значит для повседневных пользователей

С точки зрения непрофессионала, FedSCOPE указывает на будущее, в котором ваши любимые приложения смогут совместно лучше понимать ваши вкусы, не объединяя при этом необработанные данные. Обогащая разреженные истории знаниями языковых моделей, аккуратно разделяя то, что специфично для домена, от общего, и настраивая приватность под каждого участника, эта система предоставляет рекомендации, которые одновременно более релевантны и больше уважают персональную информацию. На практике это может означать лучшие предложения о том, что посмотреть, прочитать или купить дальше — без необходимости жертвовать своей цифровой приватностью.

Цитирование: Zhao, L., Lin, Y., Qin, S. et al. FedSCOPE: Federated cross-domain sequential recommendation with decoupled contrastive learning and privacy-preserving semantic enhancement. Sci Rep 16, 7420 (2026). https://doi.org/10.1038/s41598-026-38628-y

Ключевые слова: федеративные рекомендации, ИИ с защитой конфиденциальности, кросс-доменные персонализация, модели больших языков, дифференциальная приватность