Clear Sky Science · ru

Прогнозирование нагрузки с использованием механизма внимания и динамическое распределение ресурсов в гетерогенных вычислительных средах

Почему умные компьютеры важны для всех

За каждым фильмом, который вы стримите, каждой картой, которую открываете, и каждым AI‑ассистентом, с которым общаетесь, стоят огромные хранилища компьютеров, тихо работающие круглосуточно. По мере роста возможностей искусственного интеллекта центры обработки данных испытывают всё большее давление: им приходится одновременно обслуживать разные типы задач на разных типах оборудования, при этом контролируя расходы, скорость и энергопотребление. В этой статье предлагается новый подход к прогнозированию потребностей таких систем в ближайшем будущем и к перераспределению работы между типами аппаратуры так, чтобы сервисы оставались быстрыми и надёжными, при этом тратя меньше электроэнергии.

Много задач, много машин

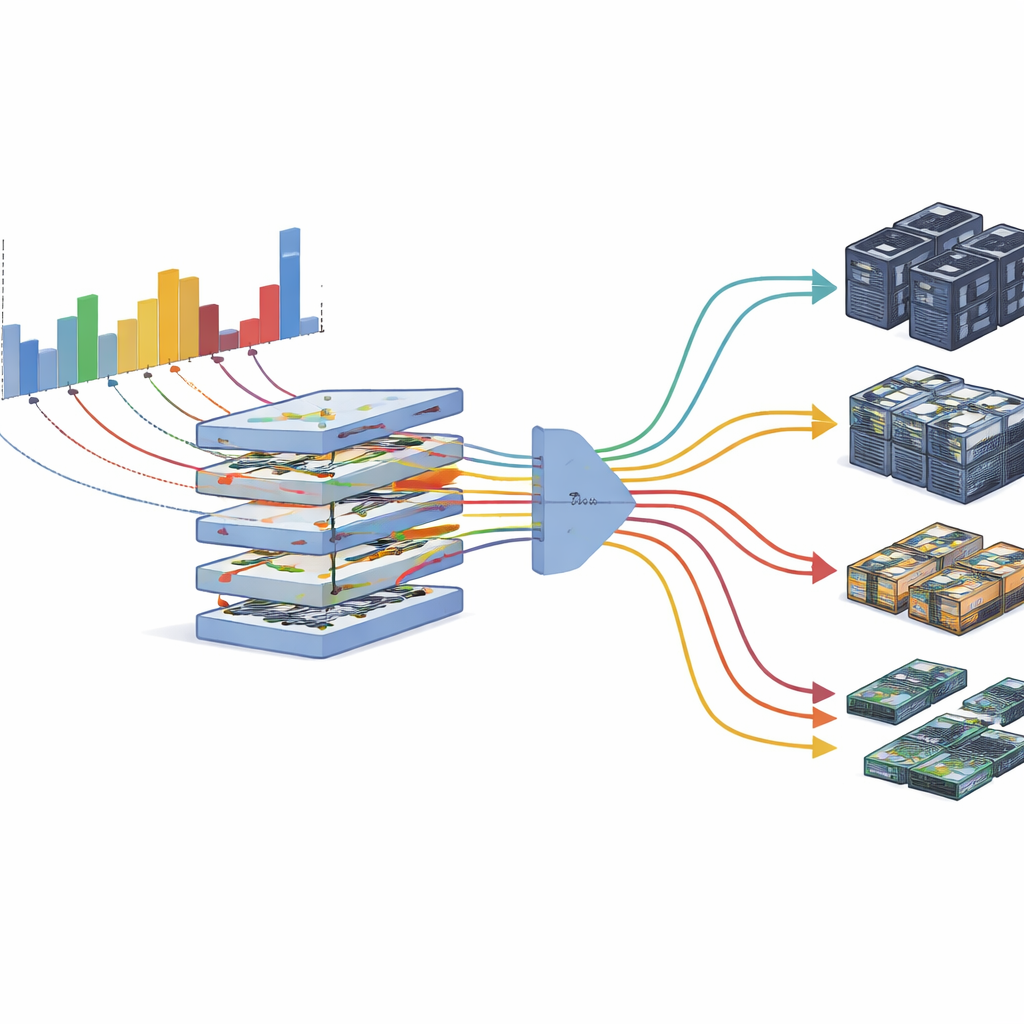

Современные центры обработки данных уже не полагаются на один тип серверов. Они объединяют традиционные процессоры с мощными графическими ускорителями, специализированными платами для AI и перепрограммируемыми логическими элементами. Разные AI‑задачи — например, обучение большой языковой модели, онлайн‑выдача рекомендаций или анализ изображений — по‑разному подходят для этой аппаратуры. Сегодня операторы часто распределяют ресурсы по фиксированным правилам или простым прогнозам, основанным на вчерашней загрузке. При внезапном всплеске спроса это приводит к замедлениям или нарушению соглашений об уровне сервиса; при падении спроса дорогое оборудование может простаивать, потребляя энергию и выполняя мало работы.

Учиться смотреть туда, где важно

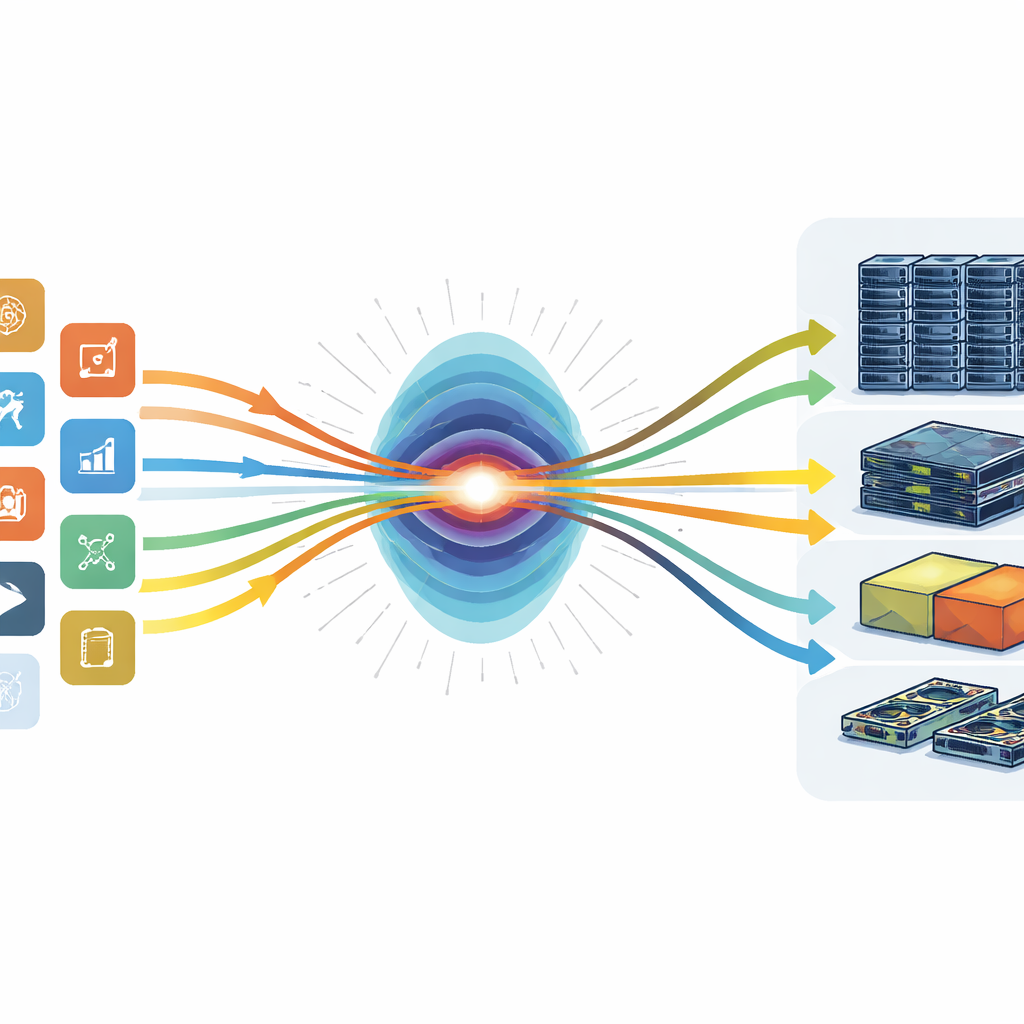

Авторы заимствуют концепт из современных AI‑моделей под названием «внимание» и применяют его к управлению центром обработки данных. Вместо того чтобы считать все исторические данные одинаково важными, их система учится выделять моменты времени и типы задач, которые наиболее полезны для предсказания будущего. Одна часть модели отслеживает, как меняется каждая рабочая нагрузка — например задача обучения или онлайн‑сервис — во времени. Другая часть смотрит «вширь» на разные нагрузки, выполняющиеся в один момент, чтобы обнаружить скрытые связи, например закономерность, когда завершение партии обучающих задач часто приводит к всплеску связанных онлайн‑запросов. Накладывая эти два взгляда, система способна точнее прогнозировать будущие потребности в процессорах, памяти и ускорителях по сравнению с предыдущими методами.

Превращение прогнозов в более разумные решения

Сам по себе прогноз недостаточен — центр обработки данных должен действовать на основе предсказаний. Вторая часть фреймворка превращает эти прогнозы в конкретные решения о том, где выполнять каждую задачу. Авторы рассматривают это как балансировку трёх целей: быстрое завершение задач, минимальное энергопотребление и загруженность машин вместо их простоя. Планировщик моделирует центр как сеть различных устройств и использует процедуру оптимизации, чтобы выбирать размещения, которые компромиссно учитывают эти цели в зависимости от предпочтений оператора. Поскольку прогнозы никогда не бывают идеальными, система также оценивает собственную неопределённость и оставляет запас прочности при необходимости, а затем в реальном времени отслеживает фактическую ситуацию и корректирует план — приостанавливая задачи низкого приоритета или перемещая работы, когда загрузка отклоняется от ожиданий.

Испытание системы

Чтобы проверить подход в реальных условиях, исследователи собрали тестовый кластер с реалистичным сочетанием процессоров, GPU и специализированного AI‑оборудования и запустили в него подробные записи активности из реальных центров обработки данных Google, Alibaba и академической лаборатории. Они сравнили свой метод с популярными инструментами прогнозирования и стратегиями планирования, включая приёмы, применяемые в промышленности, и контроллеры на основе обучения с подкреплением. Предиктор на основе механизма внимания последовательно давал более точные прогнозы, особенно для резких всплесков, часто возникающих в AI‑нагрузках. В паре с динамическим аллокатором система увеличила общую загрузку оборудования до примерно четырёх пятых от ёмкости, сократила среднее время выполнения задач примерно на четверть и снизила энергопотребление примерно на 15 процентов, при этом уровень нарушений сервиса остался очень низким.

Что это значит для обычных пользователей

Для неспециалистов основной вывод таков: более умная координация внутри центров обработки данных может сделать AI‑сервисы быстрее, дешевле и экологичнее без необходимости в новых чипах или зданиях. Обучаясь тому, где «сосредоточить внимание» в потоке данных о загрузке, этот фреймворк помогает существующему оборудованию выполнять больше полезной работы и реже простаивать. Это означает, что компании могут предлагать более отзывчивые приложения и более мощные AI‑инструменты, одновременно снижая счета за электроэнергию и углеродный след. По мере распространения и совершенствования подобных систем прогнозирования и распределения ресурсов невидимая инфраструктура интернета может стать не только более функциональной, но и более устойчивой.

Цитирование: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Ключевые слова: планирование в центрах обработки данных, прогнозирование AI-нагрузки, гетерогенные вычисления, энергоэффективные вычисления, распределение ресурсов