Clear Sky Science · ru

Ужесточённый аудит приватности DP-SGD в модели угроз с скрытым состоянием

Почему это важно для повседневных технологий

Современные приложения постоянно обучаются на наших данных — от фотографий и сообщений до медицинских записей. Один из ведущих способов сделать это обучение безопасным называется дифференциальной приватностью: к обновлениям модели добавляют тщательно настроенный шум, чтобы данные одного человека не выделялись. Но как убедиться, что эти механизмы действительно работают на практике, особенно для современных глубоких нейронных сетей? В этой статье исследуется именно этот вопрос и показано, когда скрытие «фильма обучения» модели действительно улучшает приватность — и когда нет.

Как должна работать приватная учеба

Дифференциально приватный стохастический градиентный спуск (DP-SGD) — основной алгоритм для обучения моделей с учётом приватности. Он по шагам обучает модель на небольших батчах данных, обрезая (clipping) градиенты на каждом шаге и добавляя случайный шум перед обновлением параметров. Теория даёт верхние оценки того, насколько данные одного человека могут повлиять на итоговую модель; это обычно выражается одним числом приватности, называемым эпсилон. Параллельно с этим «аудит приватности» пытается атаковать обученную модель и посмотреть, какую информацию можно реально извлечь на практике. Если теория и аудит сходятся, можно доверять расчёту приватности; если нет, значит что-то важное упущено.

Что меняется, когда раскрывают только финальную модель

Большинство ранних аудитов предполагали мощного противника, который видит каждую промежуточную контрольную точку модели в процессе обучения. На практике многие организации публикуют только финальную модель, а не всю историю обучения. Такое более реалистичное условие называется моделью угроз со скрытым состоянием. Недавние теоретические работы предполагали, что по крайней мере для простых выпуклых задач скрытие промежуточных моделей может усиливать приватность со временем: данные, использованные в начале обучения, «смываются» последующими зашумлёнными обновлениями. Однако современное глубокое обучение опирается на сильно невыпуклые модели с грубой и сложной поверхностью потерь. Было неясно, проявляется ли та же самая амплификация там — или существующие атаки просто были слишком слабы, чтобы выявить полный уровень потерь приватности.

Новый способ для противников воздействовать на модель

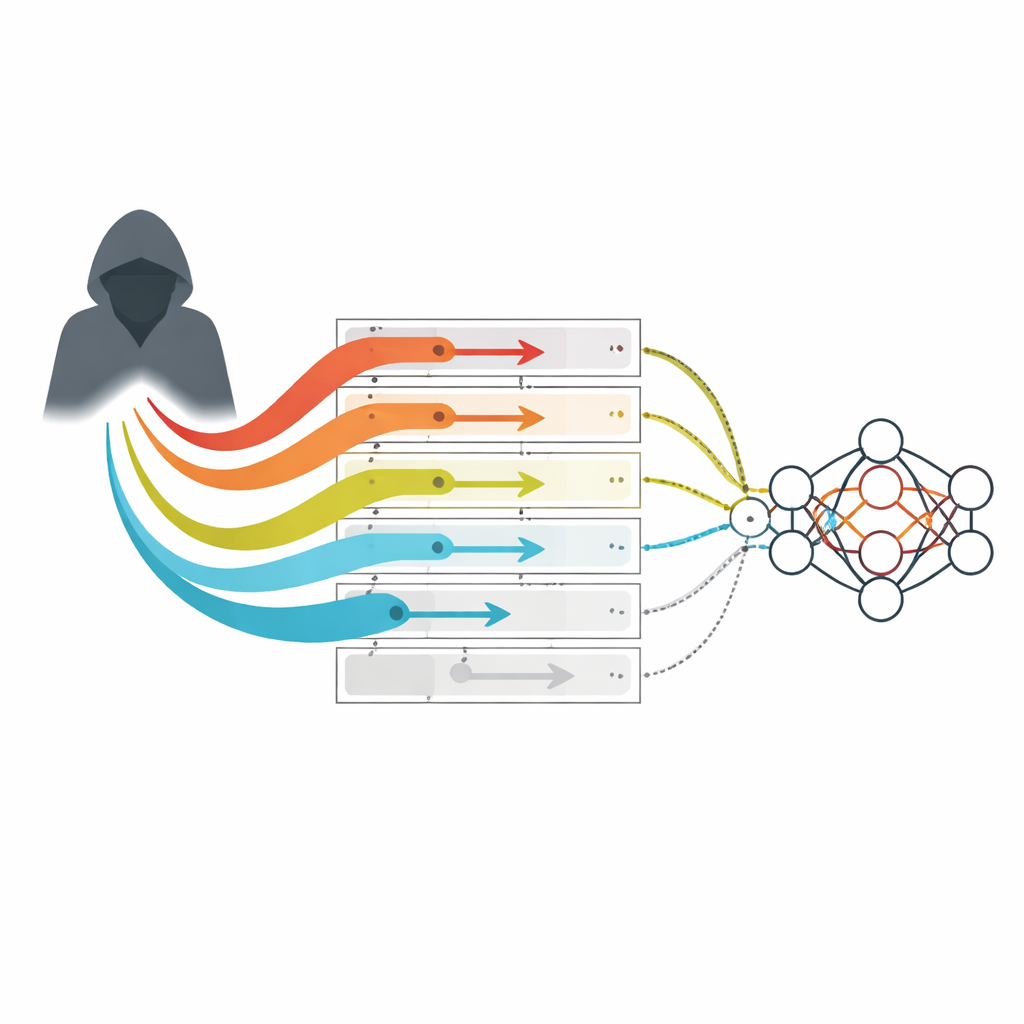

Автор предлагает новое семейство «создающих градиенты» (gradient-crafting) противников, адаптированных к модели со скрытым состоянием. Вместо того чтобы придумывать особую точку данных и следить за изменением её потерь в процессе обучения (как в традиционных атаках на основании потерь), такие противники прямо задают последовательность градиентов, которые были бы применены, если бы присутствовала наихудшая точка данных. Они выбирают градиенты, которые всегда достигают порога обрезки и выравниваются вдоль редко используемых направлений параметров, что облегчает обнаружение их влияния даже без просмотра промежуточных моделей. Исследуются две простые разновидности: одна случайным образом выбирает направление параметра, а другая моделирует процесс обучения, чтобы найти наименее обновляемое направление, а затем многократно и сильно вводит градиенты вдоль этого направления.

Чего эксперименты показывают о реальном риске приватности

В рамках этой методики статья проводит аудит DP-SGD на изображениях и табличных наборах данных с распространёнными архитектурами, такими как свёрточные и остаточные сети, а также на небольшой полностью связной модели. Когда созданный градиент применяется на каждом шаге обучения, новые противники достигают строгих теоретических границ приватности — хотя видят только финальную модель. Это означает, что в этом экстремальном случае скрытие промежуточных контрольных точек вовсе не даёт дополнительной приватности. Когда созданный градиент вставляется реже, картина меняется: при больших батчах относительно уровня шума аудиты остаются близки к теории (что снова указывает на малую амплификацию), но при меньших батчах и более высоком уровне шума появляется разрыв, указывающий на реальную, хотя и умеренную, амплификацию приватности в невыпуклых условиях.

Взгляд внутрь предельного варианта

Чтобы понять абсолютные пределы приватности в модели со скрытым состоянием, статья также рассматривает более экстримального теоретического противника, который не только конструирует градиенты, но и проектирует всю поверхность потерь, чтобы влияние особой точки данных сохранялось через итерации. В этой контролируемой постановке результаты чётко разделяют два режима: при больших размерах батча учёт приватности по стандартной теории по существу точен, а при маленьких батчах и значительном шуме ранняя информация о точке данных частично забывается со временем. Критично, что эта амплификация слабее, чем для простых выпуклых задач, и никогда полностью не стирает риск приватности.

Что это значит для пользователей и практиков

Для неспециалистов вывод таков: простое скрытие истории обучения модели глубокого обучения не даёт магически значительно большей приватности. Когда данные человека используются очень часто в процессе обучения, его риск близок к тому, что предсказывает сегодняшняя консервативная теория. Некоторая дополнительная защита действительно проявляется в более благоприятных режимах — при маленьких батчах и значительном шуме — но она умеренная и не сводит риск к нулю. Эти результаты одновременно подтверждают части существующих методов учёта приватности и подчёркивают их пределы, давая более ясную и реалистичную картину того, какую защиту может обеспечить DP-SGD, когда публикуется только финальная модель.

Цитирование: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Ключевые слова: дифференциальная приватность, DP-SGD, аудит приватности, безопасность машинного обучения, модель со скрытым состоянием