Clear Sky Science · ru

Эффективная по числу запросов решение-ориентированная adversarial-атака с низким бюджетом запросов

Почему крошечные дефекты в изображениях могут обмануть умные машины

Современный искусственный интеллект с впечатляющей точностью распознаёт лица, животных и повседневные объекты. Тем не менее те же самые системы можно ввести в заблуждение изменениями изображения, столь малыми, что люди едва их замечают. В этой работе предлагается новый способ создания таких «обманных» изображений с минимальным количеством обращений к модели, что показывает как хрупкость современных моделей, так и способы, которыми злоумышленники могут эксплуатировать её в реальных условиях.

Как злоумышленники исследуют ИИ-системы снаружи

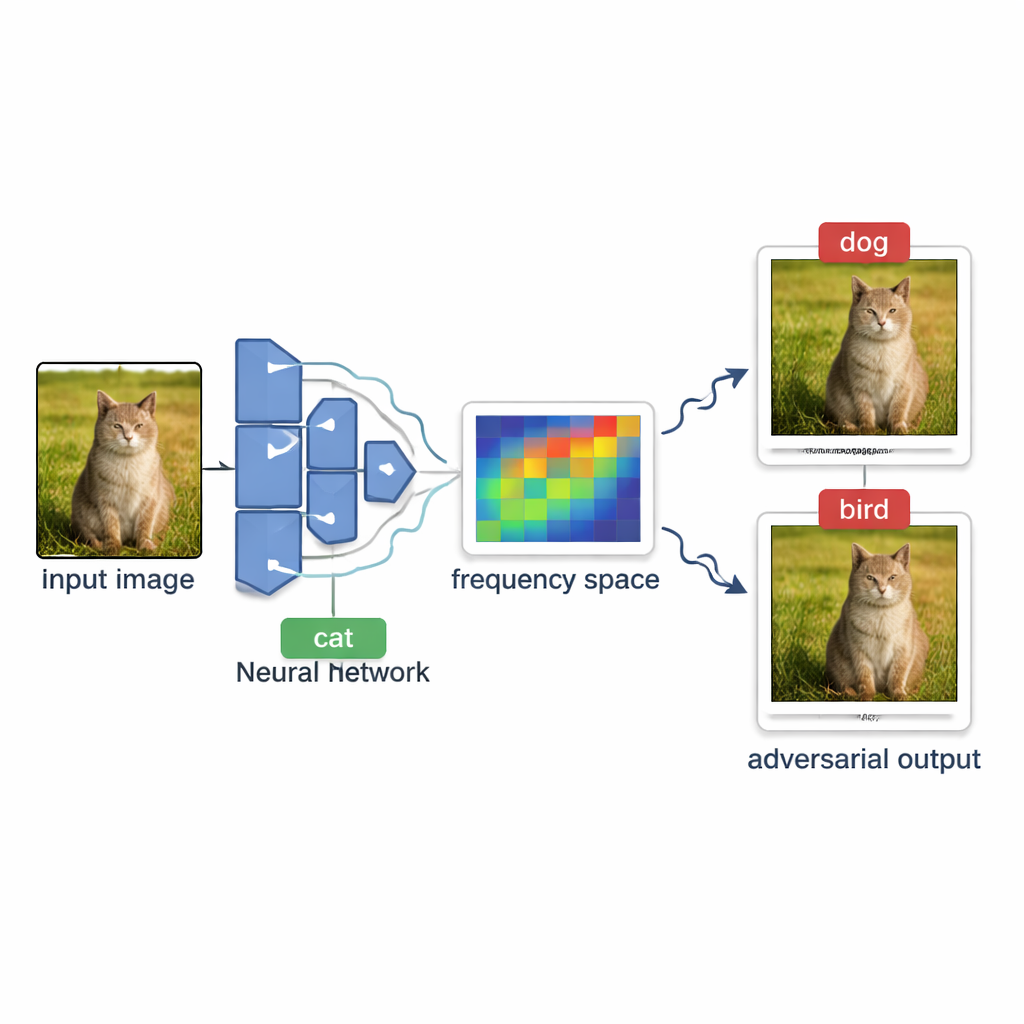

Во многих реальных сервисах — таких как онлайн-тегирование фото или фильтры контента — модель ведёт себя как чёрный ящик. Сторонние пользователи могут загрузить изображение и увидеть только окончательную метку, например «собака» или «знак стоп», но не внутренние оценки уверенности или структуру модели. Создание вводящего в заблуждение изображения в таких условиях называется решение-ориентированной (decision-based) атакой по черному ящику. Задача состоит в том, чтобы осторожно подправить обычную картинку до тех пор, пока модель не ошибётся, не имея возможности видеть, насколько «близка» она к смене решения, и не делая так много запросов, чтобы система заметила подозрительную активность или расходы на запросы стали неприемлемыми.

Новый способ поиска с очень небольшим числом вопросов

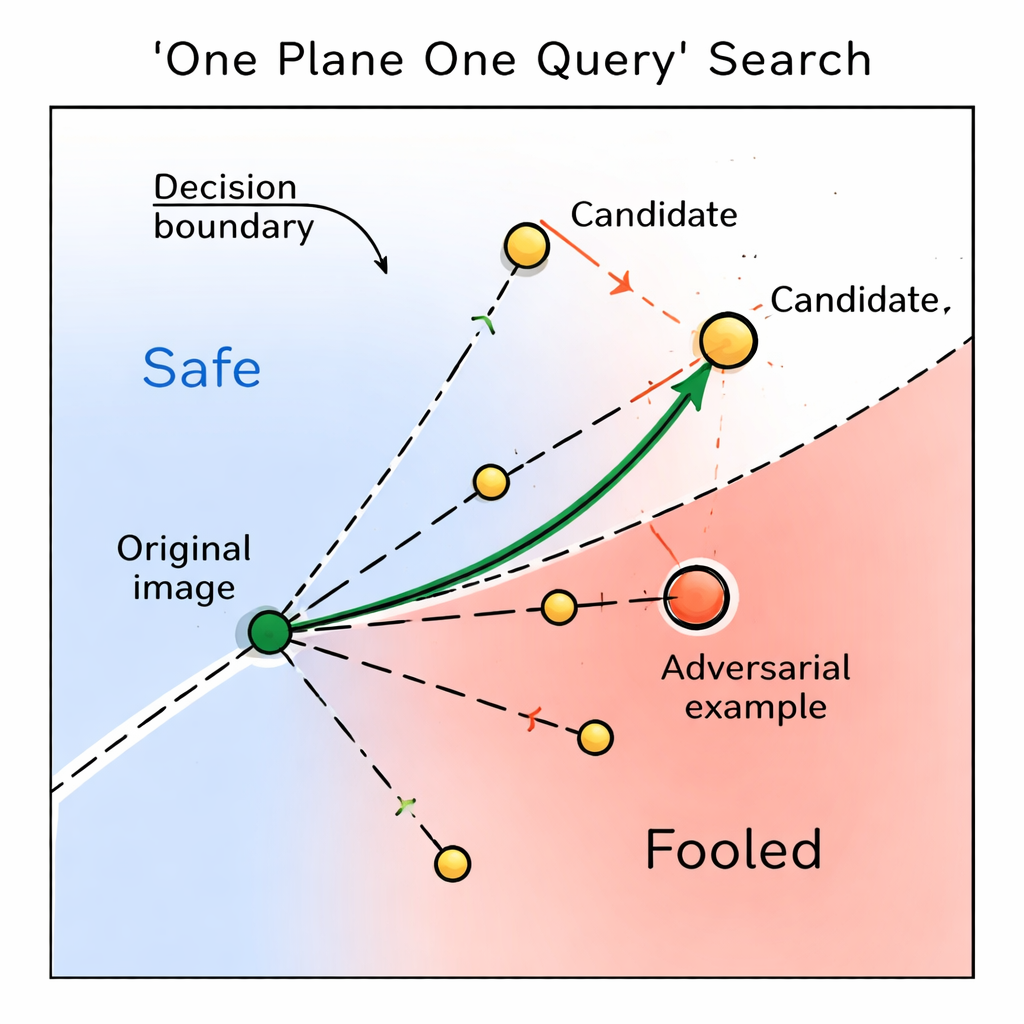

Авторы представляют OPOQA (One Plane One Query Attack) — метод, спроектированный экономно расходовать запросы, сохраняя при этом способность создавать качественные адверсариальные изображения. Вместо многократного зондирования вдоль одной предполагаемой направляющей OPOQA работает раундами. В каждом раунде он начинает с уже вводящего в заблуждение изображения и исходного чистого изображения, затем предлагает несколько новых кандидатов, лежащих в тщательно подобранных направлениях. Существенно то, что каждое направление проверяется не более одного раза, что освобождает ограниченный бюджет запросов для исследования большего числа возможностей, а не для чрезмерного уточнения единственной догадки.

Езда по гладким волнам изображения

Чтобы выбирать перспективные направления, OPOQA опирается на идею, что наиболее эффективные и малозаметные изменения часто являются гладкими, широкими смещениями, а не резким шумом на уровне пикселей. Метод использует математический инструмент — дискретное косинусное преобразование — чтобы перейти в «частотное» представление изображения, где медленные, плавные вариации сосредоточены в компактной области. Он случайным образом выбирает несколько таких низкочастотных компонент, преобразует их обратно в обычные пиксельные изменения и использует их как базовые направления для исследования. Каждое выбранное направление помогает определить плоскую двумерную поверхность, соединяющую исходное изображение, текущее адверсариальное изображение и новый кандидат. На каждой из этих поверхностей OPOQA выбирает одну точку для теста, балансируя две цели: приблизиться к оригинальному изображению и при этом с высокой вероятностью спровоцировать ошибочное решение модели.

Выбор лучшего кандидата и адаптация на ходу

Когда OPOQA генерирует небольшой набор кандидатов, он измеряет, насколько каждый из них удалён от исходного изображения, и сортирует их от наименее к наиболее изменённым. Затем он запрашивает модель в этом порядке. Как только находится кандидат, который модель классифицирует неправильно, процесс останавливается, и это изображение принимается в качестве новой отправной точки для следующего раунда. Если ни один из кандидатов не обманывает модель, OPOQA сохраняет предыдущий лучший адверсариальный образец, но настраивает внутренний параметр, контролирующий, насколько консервативными или агрессивными будут следующие шаги. Эта «жадная» стратегия — всегда принимать лучший доступный неправильно классифицированный образ и динамически регулировать размер шага — позволяет атаке точно находить тонкие, эффективные возмущения, не тратя запросы на не перспективные направления.

Что показывают эксперименты о слабых местах ИИ

Исследователи протестировали OPOQA на 200 изображениях из масштабного бенчмарка ImageNet и на шести широко используемых нейронных моделях, включая Inception-v3, ResNet, VGG, DenseNet и визуальные трансформеры. При строгом лимите в 1000 запросов к модели на изображение OPOQA сопоставляла или превосходила несколько ведущих методов атак. Например, для Inception-v3 метод успешно ввёл модель в заблуждение в 94% случаев, сохраняя изменения настолько малыми, что они почти незаметны для человека, превзойдя предыдущий лучший метод на несколько процентных пунктов. По моделям в целом OPOQA чаще достигала высоких показателей раньше — используя меньше запросов — хотя некоторые конкурирующие методы догоняли или превосходили её при очень больших бюджетах запросов и времени на тонкую подгонку.

Что это значит для повседневной безопасности ИИ

Исследование показывает, что современные системы компьютерного зрения можно обмануть даже когда злоумышленники видят только окончательные решения и имеют ограниченные возможности для опроса модели. Умное исследование мягких, низкочастотных изменений и аккуратное распределение каждого запроса позволяют OPOQA создавать изображения, выглядящие одинаково для людей, но вводящие машины в серьёзную ошибку. Для неспециалистов вывод прост: «зрение» ИИ по-прежнему довольно хрупко — его можно незаметно сбить с курса. Признание и изучение таких эффективных атак — ключевой шаг к укреплению реальных систем, таких как камеры наблюдения, инструменты для анализа медицинских изображений и автономные транспортные средства, против манипуляций, которые в противном случае могли бы остаться незамеченными.

Цитирование: Tuo, Y., Yin, M. & Che, S. Query-efficient decision-based adversarial attack with low query budget. Sci Rep 16, 6886 (2026). https://doi.org/10.1038/s41598-026-38428-4

Ключевые слова: адверсариальные примеры, атаки по черному ящику, безопасность глубокого обучения, классификация изображений, эффективная по запросам атака