Clear Sky Science · ru

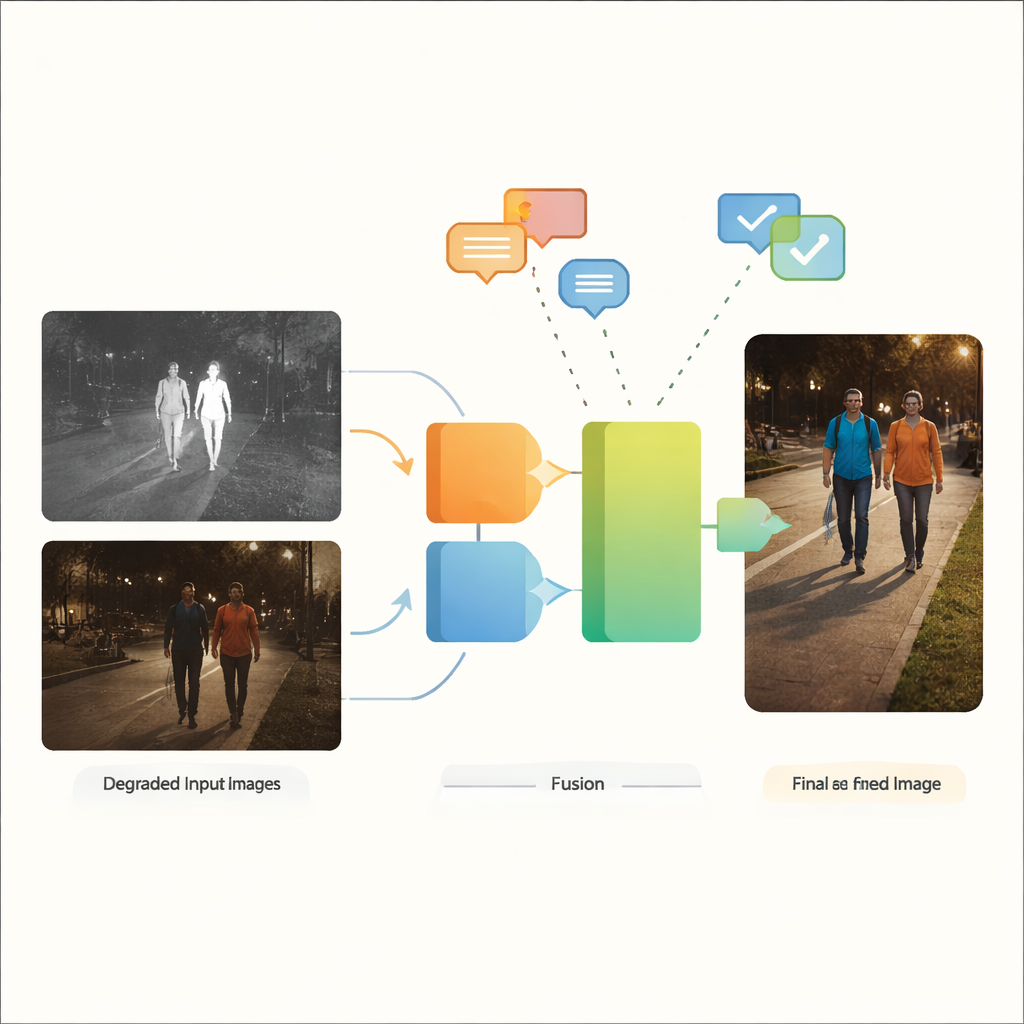

Моделирование деградации в связанной сети с управлением через VLM для осведомлённого о деградации слияния инфракрасных и видимых изображений

Чёткое ночное зрение для шумного мира

Современные камеры умеют видеть в темноте, «чувствовать» тепло и следить за дорогой — но их снимки часто далеки от идеала. Уличные фонари бликуют, тени поглощают детали, а датчики добавляют зернистый шум. В этом исследовании предложен новый способ объединения обычного цветного видео с тепловыми инфракрасными изображениями, чтобы итоговое изображение было чище и надёжнее, даже когда оба входа сильно деградированы. Метод может сделать автономные автомобили, системы видеонаблюдения и другие «умные» камеры более устойчивыми в тех условиях, где они нужны больше всего: ночью, в плохую погоду и в загруженных реальных сценах.

Почему два глаза лучше, чем один

Камеры видимого диапазона фиксируют богатые цвета и текстуры, к которым привык человек, но испытывают трудности при слабом освещении, засветках и глубоких тенях. Инфракрасные камеры, напротив, реагируют на тепло и легко выделяют тёплые объекты, такие как люди или транспорт в ночи, хотя их изображения часто выглядят плоскими и лишёнными мелких деталей. Слияние инфракрасных и видимых изображений направлено на сочетание лучших свойств обоих: чётких контуров тёплых целей из инфракрасного канала с контекстной детализацией и цветом видимого света. Традиционно большинство методов слияния предполагают, что оба входных изображения уже чисты и высокого качества — что плохо согласуется с реальными улицами, городами и промышленными площадками, где размытость, шум, тусклое освещение и пересветы скорее правило, чем исключение.

Когда предварительная обработка не справляется

Существующие системы обычно решают проблему плохих изображений в два разобщённых этапа. Сначала отдельные инструменты улучшения повышают яркость тёмных сцен, уменьшают шум или корректируют контраст. Только затем сеть слияния объединяет улучшенные изображения. Такой двухступенчатый подход имеет несколько недостатков. Он вынуждает инженеров выбирать и настраивать разные инструменты для каждого типа дефекта и каждого датчика, делая рабочие процессы хрупкими и сложными. Что важнее, любая информация, утраченная или исказившаяся при отдельной очистке, уже не может быть восстановлена на этапе слияния. Недавние исследования вводили специальные сети, настроенные на один конкретный тип деградации, или использовали языково-управляемые модели для работы с одной проблемной модальностью за раз. Однако когда и инфракрасные, и видимые изображения деградированы — и часто разными способами — такие стратегии всё ещё сильно зависят от ручной предварительной обработки и с трудом справляются со смешанными, реальными условиями.

Сеть слияния, понимающая деградацию

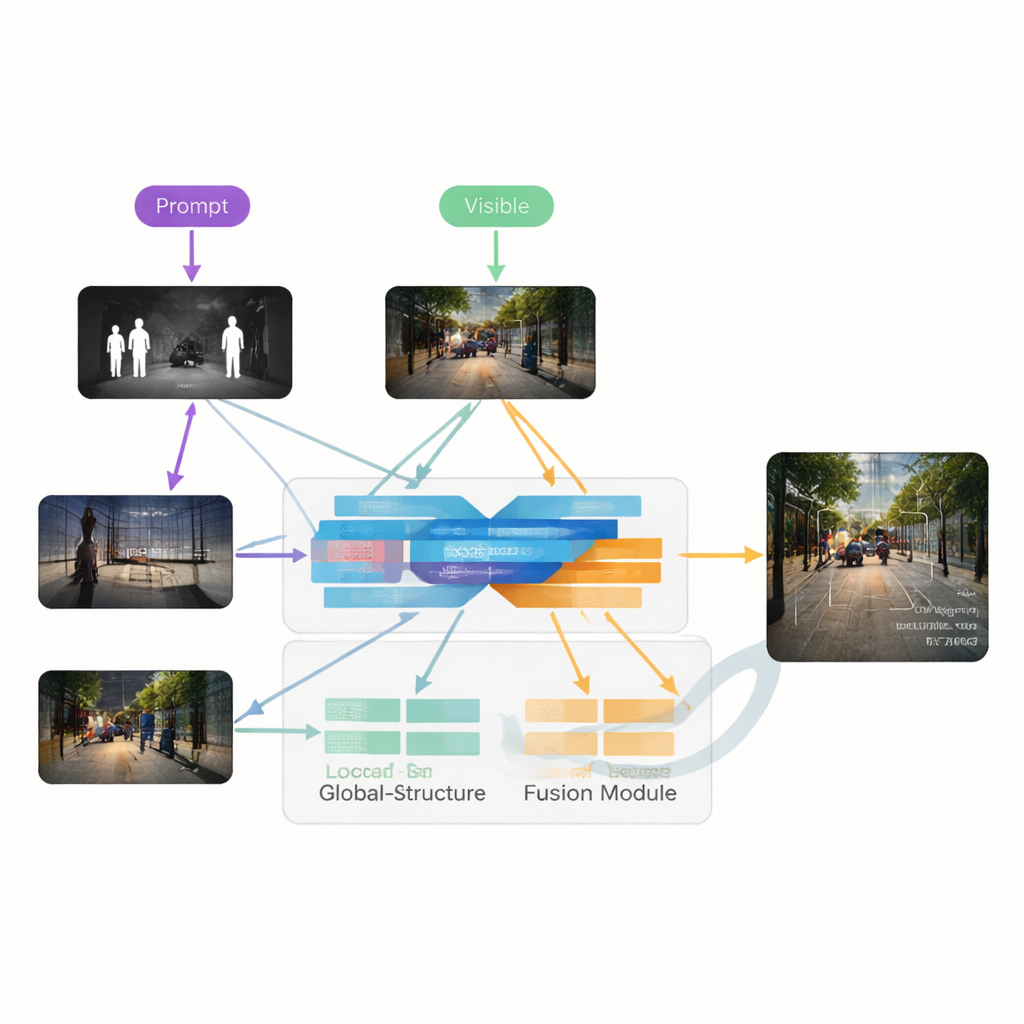

Авторы предлагают VGDCFusion — новую систему глубокого обучения, которая интегрирует обработку деградации непосредственно в процесс слияния. Ключевая идея — информировать сеть в текстовой форме о том, каких проблем следует ожидать, а затем использовать это знание на каждом этапе извлечения и объединения признаков. Короткие текстовые подсказки описывают задачу (слияние инфракрасного и видимого) и конкретные проблемы, например слабое освещение, пересвет, низкий контраст или шум. Мощная визуально-языковая модель — по сути аналогичная системам типа CLIP — преобразует эти подсказки в компактные числовые описания. Эти описания направляют два основных блока: Specific-Prompt Degradation-Coupled Extractor (SPDCE), работающий отдельно для каждой модальности, и Joint-Prompt Degradation-Coupled Fusion (JPDCF), который объединяет информацию между модальностями, при этом учитывая, какие виды деградации всё ещё присутствуют.

Как работает направленный процесс слияния

Внутри каждого модуля SPDCE руководство, полученное из подсказок, направляет сеть на признаки, имеющие значение, и отталкивает от артефактов. Многоуровневые свёрточные слои изучают небольшие окрестности, сохраняя грани и текстуры, в то время как слои Transformer улавливают структуру и контекст в более крупном масштабе. Вместе они обучаются выделять, например, важные тепловые сигнатуры в зашумлённом инфракрасном кадре или слабые дорожные разметки в недодержанном видимом изображении, одновременно подавляя шум датчика и дефекты освещения. Параллельно модули JPDCF берут очищенные признаки из обоих ветвей и комбинируют их, вновь используя подсказки. Они применяют пространственное и канальное внимание, чтобы выделить информативные области, отфильтровать оставшуюся деградацию и совместить дополнительные подсказки — например, сопоставить яркий инфракрасный контур пешехода с цветом и фоновыми структурами из видимой камеры — прежде чем реконструировать объединённое трёхканальное выходное изображение.

Проверка метода на практике

Чтобы продемонстрировать полезность, команда оценивала VGDCFusion на нескольких публичных наборах данных, включающих тусклые и пересвеченные видимые изображения, а также зашумлённые или с низким контрастом инфракрасные кадры. Они сравнили свой метод с рядом передовых методов слияния — от автоэнкодеров и свёрточных сетей до генеративных состязательных сетей и Transformer-архитектур. По стандартным метрикам качества изображения VGDCFusion постоянно выдавал слияния с более чёткими краями, лучшим контрастом и более естественной цветопередачей, даже когда соперникам давали преимущество в виде тщательно настроенной предварительной обработки. Новый подход улучшал ключевые метрики примерно на 15% в среднем в сильно деградированных сценариях. Когда объединённые изображения подавали на вход популярной системе обнаружения объектов, это также приводило к более высокой точности детекции по сравнению с использованием только инфракрасных или только видимых изображений, а также по сравнению с другими сетями слияния.

Более ясное зрение для безопасных систем

Проще говоря, работа показывает: если сообщить сети слияния, какие визуальные проблемы ожидать — и позволить ей одновременно исправлять и объединять данные в одном тесно связанном процессе — это может дать более чистые и информативные изображения, чем при раздельной обработке и слиянии. За счёт связывания моделирования деградации с процессом слияния и использования языково-направляемых подсказок на каждом слое VGDCFusion способен адаптироваться к разнообразным и смешанным формам деградации изображений без постоянной ручной перенастройки. Такой интеллектуальный, учитывающий деградацию подход к слиянию может помочь будущим системам зрения — от автопилотов до камер безопасности — надёжнее видеть в грязных и несовершенных условиях реального мира.

Цитирование: Zhao, J., Zhang, T. & Cui, G. A VLM guided network coupling degradation modeling for degradation aware infrared and visible image fusion. Sci Rep 16, 8249 (2026). https://doi.org/10.1038/s41598-026-38181-8

Ключевые слова: слияние инфракрасного и видимого, съёмка при слабом освещении, визуально-языковые модели, деградация изображений, восприятие для автономного вождения