Clear Sky Science · ru

Стабильный подход на основе диагональных рекуррентных квантовых нейронных сетей для идентификации нелинейных систем

Обучение машин пониманию сложных систем

Многие системы, которые влияют на нашу жизнь — от электромоторов в бытовой технике до турбулентного потока воздуха и даже некоторых медицинских процессов — ведут себя сложно и нелинейно. Это означает, что небольшие изменения входных сигналов могут вызвать внезапно большие или хаотичные отклики. Предсказывать и управлять такими системами трудно, но это важно для повышения эффективности, безопасности и экономии энергии. В этой статье представлен новый тип обучающей машины, который сочетает идеи квантовых вычислений, нейронных сетей и теории устойчивости, чтобы более точно и надежно моделировать такие сложные явления.

Почему обычные модели недостаточны

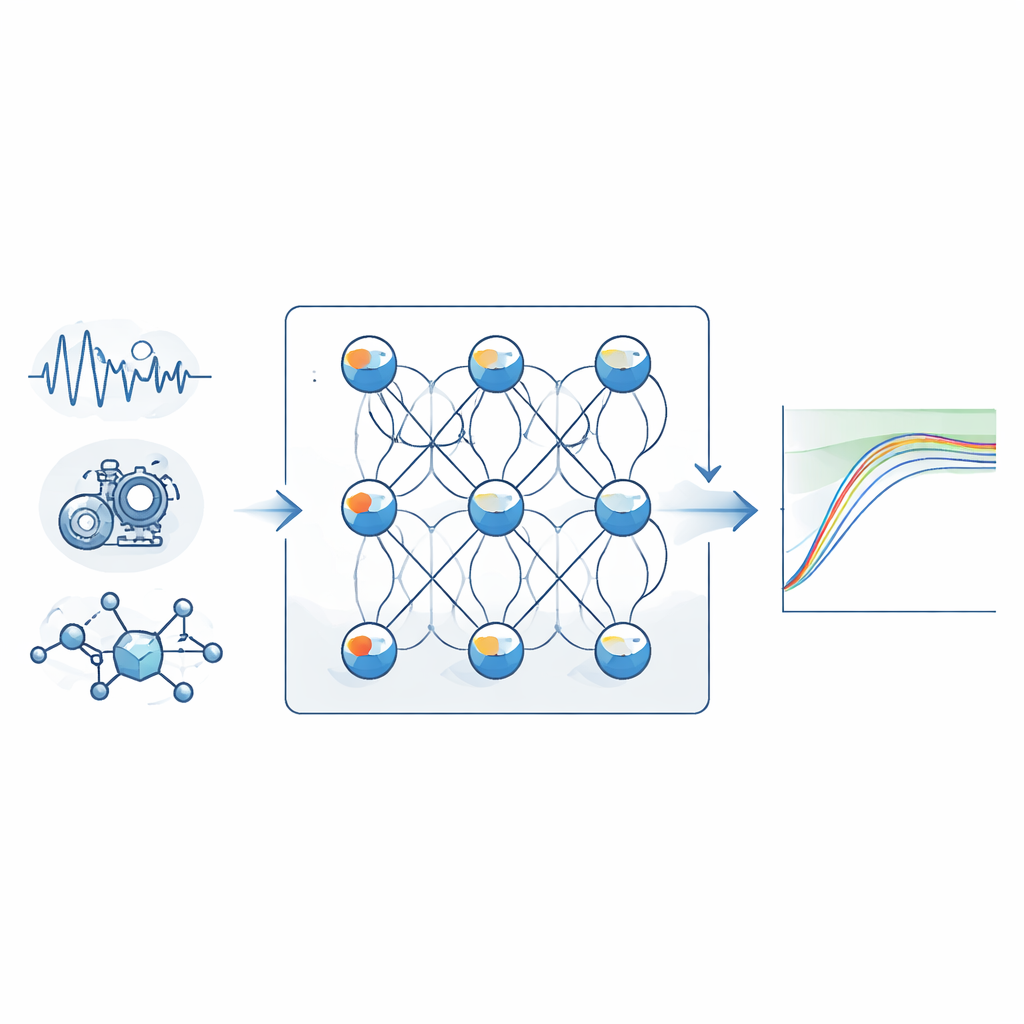

Традиционные инструменты моделирования часто предполагают, что причина и следствие упорядочены и пропорциональны, что хорошо работает для простых или почти линейных систем. Но в реальности многие системы обладают памятью, обратными связями и порогами, которые делают их поведение выраженно нелинейным. Классические нейронные сети помогли в некоторых задачах, но у них есть свои ограничения. Прямые (feed-forward) сети, где информация движется в одном направлении, хороши для статических задач, но испытывают трудности, когда важны прошлые сигналы. Рекуррентные сети, которые возвращают информацию обратно в сеть, чтобы формировать память, способны захватывать меняющееся во времени поведение, но их трудно обучать, они склонны к неустойчивости и вычислительно дороги, когда каждый нейрон соединён с каждым другим.

Сочетание квантовых идей с простыми петлями

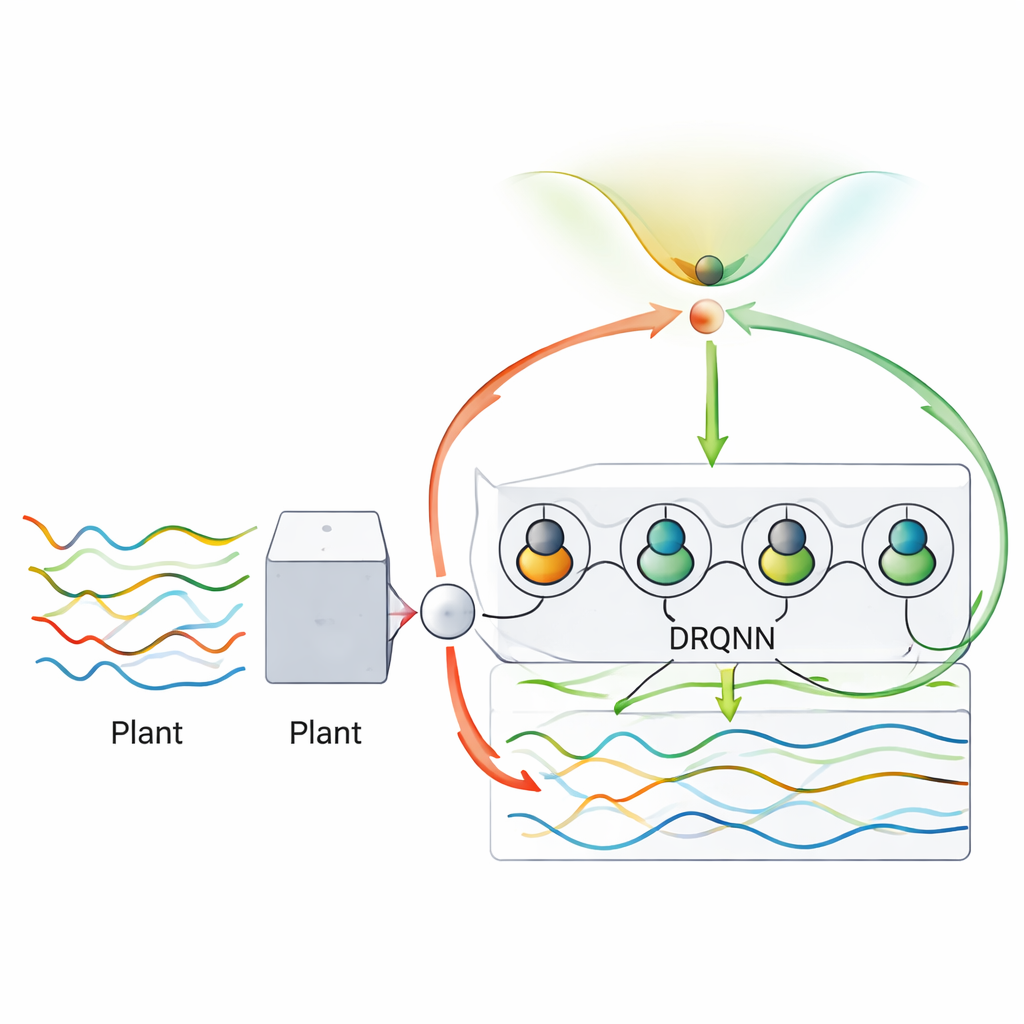

Авторы предлагают диагональную рекуррентную квантовую нейронную сеть с устойчивостью по Ляпунову, сокращённо DRQNN-LS. По сути сеть по-прежнему похожа на знакомую трёхслойную нейросеть: входы, скрытый слой и выход. Но есть два ключевых отличия. Во‑первых, скрытые элементы ведут себя как упрощённые кубиты: их внутренние состояния описываются величинами, похожими на фазы, а не обычными скалярными числами. Такое вдохновлённое квантовой механикой представление позволяет каждому элементу кодировать более богатую информацию в компактной форме, что улучшает способность сети аппроксимировать сложные зависимости. Во‑вторых, вместо путаницы обратных связей каждый скрытый нейрон возвращает сигнал только самому себе. Такая «диагональная» рекуррентность сохраняет необходимую память для отслеживания временно‑изменяющихся паттернов, при этом существенно сокращая количество настраиваемых соединений.

Обеспечение стабильности обучения и контроля

Главная сложность при обучении любых рекуррентных сетей — сохранить устойчивость процесса обучения: если веса меняются слишком резко, выход модели может взрываться или вступать в колебания; если изменения слишком медленные, обучение затягивается или застревает. В данной работе авторы опираются на теорию устойчивости по Ляпунову — математический аппарат, изначально разработанный для анализа безопасности физических систем. Они строят специальную функцию, похожую на энергию, которая объединяет ошибку моделирования и величины параметров сети. Внимательно исследуя изменение этой функции во времени, они выводят автоматические правила обновления весов и внутренних параметров сети так, чтобы общая «энергия» могла только уменьшаться. Это даёт адаптивные скорости обучения, которые сами ускоряются или замедляются, гарантируя сходимость без ручной тонкой настройки.

Проверка новой сети на практике

Чтобы показать, что DRQNN-LS — это не только красивая идея, авторы испытывают её на трёх существенно разных задачах. Сначала они моделируют математическую нелинейную систему с известным поведением, проверяя, насколько хорошо сеть может следовать её выходу. Затем исследуют хаотическую карту Хенона — классический эталон, где малые изменения начальных условий приводят к кардинально разным траекториям. Третья задача — применение метода к реальным данным с небольшого постоянного электромотора, шумного практического устройства с частично неизвестной внутренней структурой. В каждом случае они сравнивают новый подход с несколькими существующими нейронными моделями, включая классические диагональные рекуррентные сети и ранние квантово-вдохновлённые версии, обученные более простыми методами градиентного спуска.

Лучшая точность, устойчивость и стойкость к шуму

Во всех трёх примерах DRQNN-LS последовательно демонстрирует меньшие ошибки прогноза и лучшее соответствие истинным сигналам по сравнению с конкурирующими методами, даже когда данные намеренно засорены значительным шумом. Хотя новая модель требует несколько больших вычислительных затрат на шаг — поскольку отслеживает рекуррентные квантово‑вдохновлённые состояния и вычисляет обновления на основе функции Ляпунова — время работы остаётся достаточно малым для применения в реальном времени на современных процессорах. Результаты указывают на то, что сочетание упрощённой рекуррентной структуры, квантово‑стилизованных состояний нейронов и математически гарантированного стабильного обучения даёт мощный и практичный инструмент для понимания и предсказания нелинейной динамики в реальном мире.

Что это значит для будущего

Для неспециалистов вывод таков: мы учимся строить более умные и надёжные цифровые двойники сложных физических систем. DRQNN-LS позволяет машине изучать поведение сложного процесса непосредственно по данным, при этом гарантируя, что процесс обучения не «взорвётся» и не уйдёт в непредсказуемое блуждание. Такое сочетание гибкости и устойчивости может оказаться полезным в областях от промышленного управления и робототехники до энергетических систем и, возможно, биологических или медицинских моделей, где нелинейность и шумные измерения являются нормой.

Цитирование: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Ключевые слова: идентификация нелинейных систем, квантовая нейронная сеть, рекуррентная нейронная сеть, устойчивость по Ляпунову, моделирование хаотической динамики