Clear Sky Science · ru

Обнаружение объектов в реальном времени для беспилотных летательных аппаратов на основе vision transformer и edge computing

Более разумные «глаза» в небе

Беспилотные летательные аппараты — дроны — стремительно превращаются в повседневные инструменты для задач вроде инспекции мостов, мониторинга дорожного движения и поиска пропавших людей. Но чтобы дрон действительно помогал в задачах, где важна каждая секунда, он должен уметь не только снимать происходящее: ему нужно в реальном времени распознавать крошечные объекты при ограниченном запасе энергии и на малом бортовом компьютере. В этой статье предложен новый подход, который даёт дронам более чёткое и быстрое «зрение» — сочетание современного метода ИИ, называемого vision transformer, и разумного использования близлежащих edge‑серверов, чтобы небольшие объекты, такие как пешеходы, велосипеды и автомобили, можно было быстро и надёжно обнаруживать с воздуха.

Почему дроны плохо видят мелкие детали

С высоты люди и транспортные средства могут уменьшаться до всего нескольких десятков пикселей в кадре. Традиционные нейросетевые системы, используемые на дронах, спроектированы для быстрой работы на энергоэффективных чипах, но они часто пропускают такие мелкие объекты или ошибаются при изменении освещения или угла обзора. Новые модели vision transformer, позаимствованные из области обработки языка, гораздо лучше понимают всю сцену целиком и умеют выделять мелкие детали на загруженном фоне. Проблема в том, что они обычно требуют огромных вычислительных ресурсов, на которые летательная платформа не способна. Авторы поставили цель закрыть этот разрыв: сохранить чёткость трансформера, но сделать его достаточно компактным для реальной работы на дроне и переносить дополнительную обработку на ближайший edge‑сервер только когда это возможно.

Разделённый интеллект: дрон и edge работают вместе

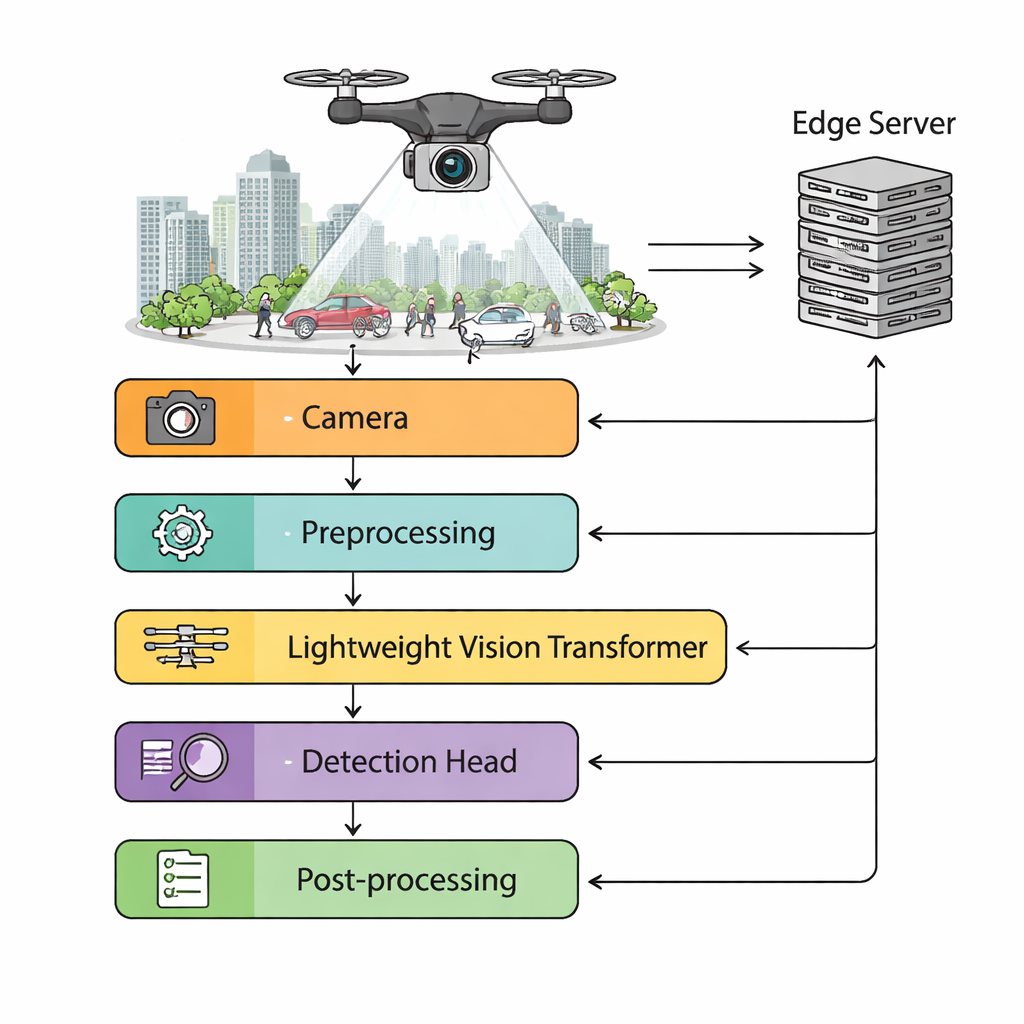

Предложенная архитектура распределяет задачи между дроном и наземным edge‑компьютером. Камера дрона потоково передаёт видео высокой чёткости в бортовой модуль предварительной обработки, который стабилизирует дрожание, корректирует яркость и динамически изменяет размер изображений в зависимости от доступных вычислительных ресурсов. Лёгкий vision transformer извлекает насыщенные признаки из каждого кадра и передаёт их в блок детекции, который предсказывает местоположение и класс объектов. Планировщик отслеживает задержки в беспроводной сети, уровень заряда батареи и загрузку процессора. Когда связь с наземным узлом быстрая и стабильная, более тяжёлые задачи — например, обработка батчей кадров или запуск дополнительных моделей для повышения точности — могут быть переданы на edge‑сервер. При ухудшении соединения система автоматически переключается на полностью автономную бортовую обработку, чтобы дрон никогда не оставался «слепым».

Уменьшаем модель, не теряя зрения

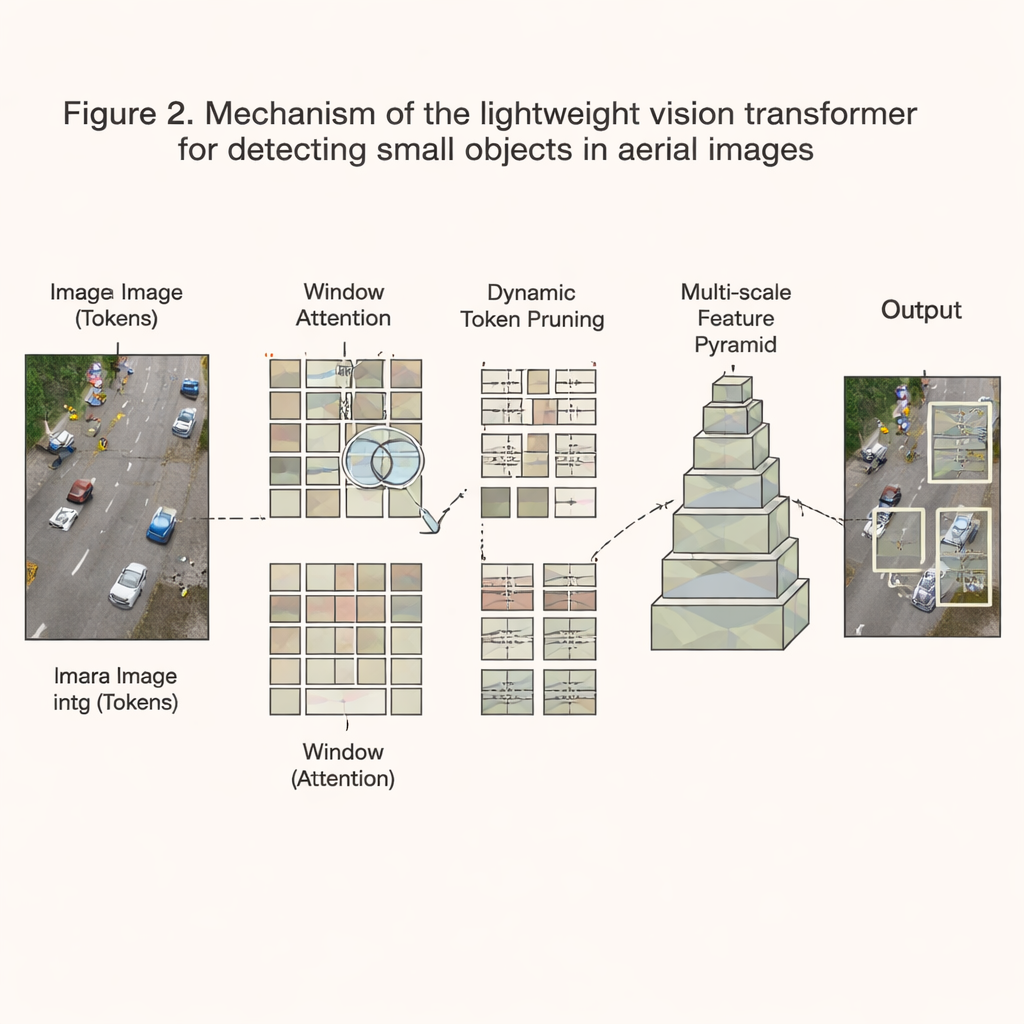

Чтобы сделать трансформер компактным и быстрым, авторы переработали его внутреннюю архитектуру. Вместо того чтобы позволять каждой части изображения сравниваться со всеми остальными — операция, масштабируемость которой взрывообразно растёт с разрешением — они ограничивают внимание локальными окнами, которые скользят по картинке, что снижает вычислительные затраты до приемлемого уровня. Кроме того, динамическая схема отсечения постоянно оценивает, какие области изображения содержат полезную информацию, а какие — в основном пустой фон. Токены, признанные неинформативными, отбрасываются на ранних стадиях, экономя время и память, в то время как сложные, загруженные сцены сохраняют больше деталей. Модель также строит многоуровневую пирамиду признаков, чтобы одновременно обнаруживать как крошечных пешеходов, так и более крупные транспортные средства в одном кадре. В сочетании с аккуратной квантованием (использованием меньшего числа бит на число), канал‑прюнингом и низкоуровневыми программными оптимизациями эти изменения сокращают требуемые вычисления примерно на две трети при сохранении более 94% исходной точности.

Проверка системы в полевых условиях

Команда оценила свою систему на большом аэроснимочном датасете, собранном из публичных бenchмарков для дронов и тысяч новых изображений, снятых над городами, пригородами и сельской местностью в разное время года и при различном освещении. На популярном встроенном компьютере для дронов NVIDIA Jetson Xavier NX их система работает примерно на 39 кадров в секунду — достаточно быстро для работы в реальном времени — при этом демонстрируя более высокую точность по сравнению с широко используемыми лёгкими детекторами, такими как вариации YOLO. В частности, она значительно лучше обнаруживает мелкие объекты, показывая примерно семипроцентный прирост средней точности по сравнению с традиционными свёрточными сетями. Недельные полевые испытания на коммерческой платформе дрона показали, что система сохраняет производительность несмотря на вибрацию камеры, изменение освещения и колебания беспроводной связи, и что она может плавно переключаться между режимами с поддержкой edge и полностью бортовой обработкой во время реальных полётов.

Что это означает для реальных миссий дронов

Проще говоря, эта работа показывает, что дронам можно дать более чёткое и надёжное зрение без того, чтобы вешать на них вычислительный центр. Путём переработки vision transformer для компактности, выборочного фокусирования на самых информативных частях изображения и совместной работы дрона с ближайшим edge‑сервером, авторы предлагают детектор, который видит больше, реже промахивается и при этом работает в реальном времени в жёстких рамках по энергии и памяти. Это делает такие задачи, как поиск и спасение, оценка ущерба после катастроф и инспекция инфраструктуры, безопаснее и эффективнее, поскольку дроны лучше замечают мелкие критически важные детали — например, оставшегося в беде человека или повреждённый кабель — именно в тот момент, когда каждая секунда на счету.

Цитирование: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Ключевые слова: дроны, обнаружение объектов, edge computing, vision transformer, изображения в реальном времени