Clear Sky Science · ru

RiemannInfer: улучшение вывода трансформеров с помощью римановой геометрии

Почему это важно для повседневных пользователей ИИ

Современные чат‑боты и ассистенты умеют решать математические задачи, писать эссе и даже объяснять медицинские темы, но мы всё ещё плохо понимаем, как они приходят к своим выводам — и как сделать их рассуждения более надёжными. В этой работе представлен «RiemannInfer», новый способ заглянуть внутрь больших языковых моделей (LLM), рассматривая их внутреннюю активность как движение по изогнутой геометрической поверхности. Такая перспектива не только даёт более наглядное представление о том, как эти системы «думают», но и делает их рассуждения быстрее и точнее.

Преобразование «мышления» ИИ в геометрическое путешествие

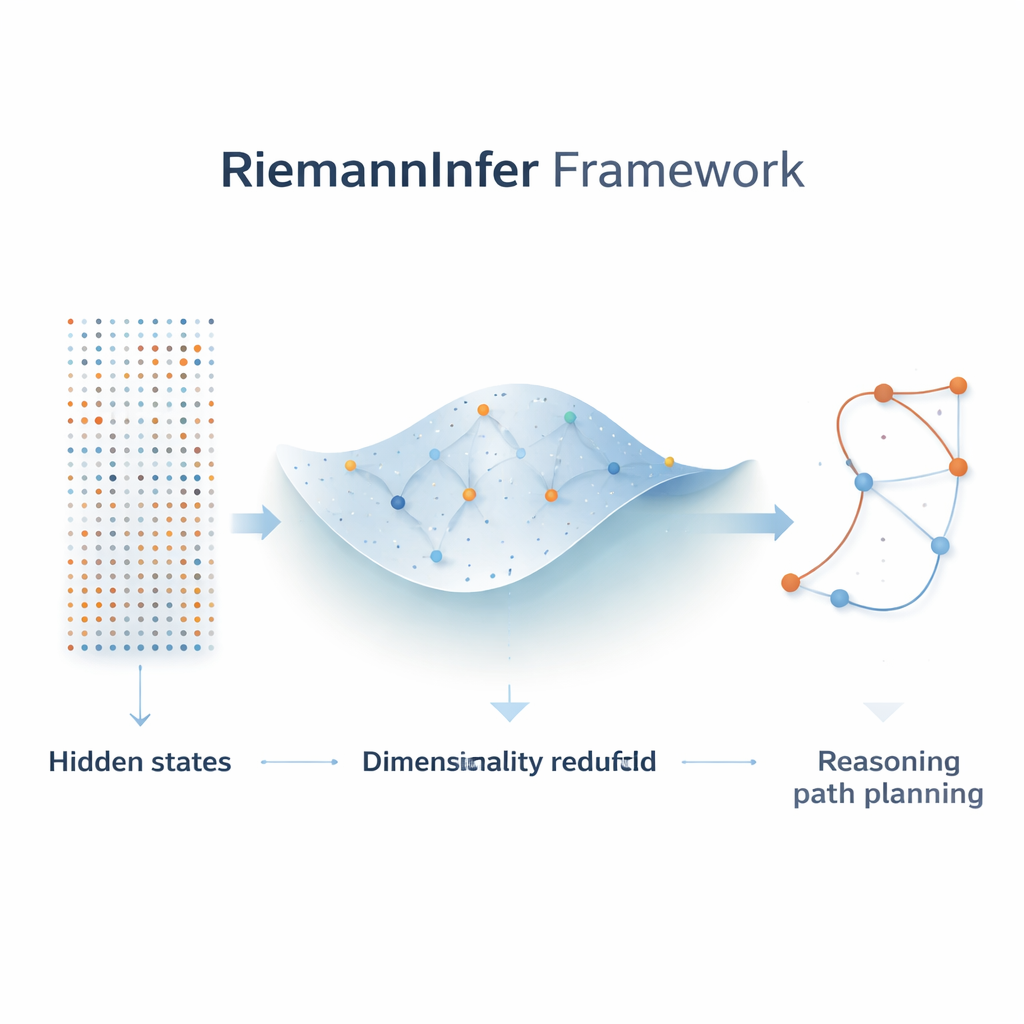

Внутри LLM, таких как GPT‑4 или Llama, каждое слово в предложении представлено вектором высокой размерности, а слои «внимания» определяют, насколько сильно слова влияют друг на друга. Авторы отмечают, что эти скрытые состояния можно рассматривать как точки в огромном пространстве, форма которого кодирует понимание языка моделью. Вместо того чтобы трактовать рассуждение как серию вычислений вероятностей по тексту, они переосмысливают его как задачу поиска пути: модель перемещается от начального состояния (вопроса) к конечному (ответу) по маршруту в этом пространстве. Используя инструменты римановой геометрии — математики изогнутых поверхностей — они строят изогнутое многообразие, которое фиксирует, как шаблоны внимания сгибают и растягивают этот внутренний ландшафт.

Сжатие сложности без потери общей картины

Поскольку исходное внутреннее пространство LLM огромно, первый шаг в RiemannInfer — уменьшить его размер, сохранив при этом ключевую структуру. Авторы комбинируют методы топологии, изучающей способы связности точек, с популярным алгоритмом понижения размерности UMAP. Перед сокращением числа измерений они анализируют «форму» облака скрытых состояний, чтобы убедиться, что важные паттерны связности переживут компрессию. В результате получается пространство меньшей размерности, где значимые взаимоотношения между токенами — например, какие слова сильно обращают внимание друг на друга — в целом сохраняются. Эта компактная геометрическая карта позволяет выполнять точные вычисления расстояний, кратчайших путей и кривизны.

Построение изогнутой карты на основе внимания

Ключевое новшество заключается в переводе весов внимания в геометрическую меру расстояния. Когда модель уделяет сильное внимание между двумя токенами, RiemannInfer рассматривает их как близкие на многообразии; слабое внимание размещает их дальше друг от друга. Из этих отношений авторы определяют метрический тензор — математическое правило, определяющее длины и углы — и используют его для вычисления геодезических, изогнутого аналога прямых линий, а также кривизны, измеряющей, насколько резко пространство изгибается. Многоголовое внимание естественно становится смесью нескольких метрик, каждая из которых улавливает разные аспекты языковой структуры, такие как синтаксис или значение. С этой конструкцией решения модели можно интерпретировать как выбор конкретных путей через ландшафт, чьи вершины и впадины отражают области плотного или редкого накопления информации.

Планирование путей рассуждений с низкими затратами

После построения многообразия авторы формулируют рассуждение как поиск «лёгкого» пути от вопроса к ответу — такого, который минимизирует суммарную проделанную работу. Они заимствуют аналогию из альпинизма: подъём по крутой, зубчатой тропе требует больше энергии, чем следование более гладкому гребню к тому же пику. В контексте LLM кривизна играет роль крутизны, а работа рассуждения модели соответствует тому, насколько уменьшается её внутренняя неопределённость вдоль пути. Используя приближённые формулы для геодезических и кривизны в сочетании с эффективным алгоритмом поиска по графу (алгоритм Дейкстры), RiemannInfer быстро находит маршруты, минимизирующие эту работу, эффективно направляя модель к более эффективным цепочкам рассуждений.

Что показывают эксперименты на реальных моделях

Авторы тестируют RiemannInfer на нескольких передовых LLM, включая GPT‑4o, Llama‑3‑405B и DeepSeek‑V2‑400B, на сложных бенчмарках по математике и рассуждению, таких как GSM8K, MATH500, StrategyQA и AGIEval. В каждом случае обёртка моделей в рамки RiemannInfer повышает их точность на несколько процентных пунктов — небольшие величины, но значимые на границе производительности — при сохранении или небольшом улучшении скорости. Сравнение с более простым, чисто линейным методом показывает, что игнорирование изогнутой геометрии скрытых состояний резко ухудшает результаты, подчёркивая важность взгляда через призму многообразия.

Общая картина: придание рассуждениям ИИ физического смысла

Для непрофессионального читателя главный вывод в том, что авторы превратили непрозрачную внутреннюю работу больших языковых моделей во что‑то более осязаемое: путешествие по изогнутому ландшафту, где хорошее рассуждение соответствует следованию плавным, малоэнергозатратным тропам. Оперируя геометрическими и физическими понятиями — расстоянием, кривизной и работой — RiemannInfer предлагает как практический способ повышения качества ответов, так и концептуальный мост между ИИ и физикой непрерывных пространств. Хотя текущие методы приближённы и многие детали требуют доработки, эта рамочная модель указывает путь к будущим системам ИИ, мыслительные процессы которых можно будет анализировать, оптимизировать и, возможно, проектировать с помощью языка геометрии и физики.

Цитирование: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Ключевые слова: большие языковые модели, геометрическое глубокое обучение, риманова многообразие, механизмы внимания, эффективность рассуждений