Clear Sky Science · ru

Когда LLM говорят на ZigBee: исследование моделей с низкой задержкой и рассуждением для генерации сетевого трафика

Умным домам нужны правдоподобные репетиции

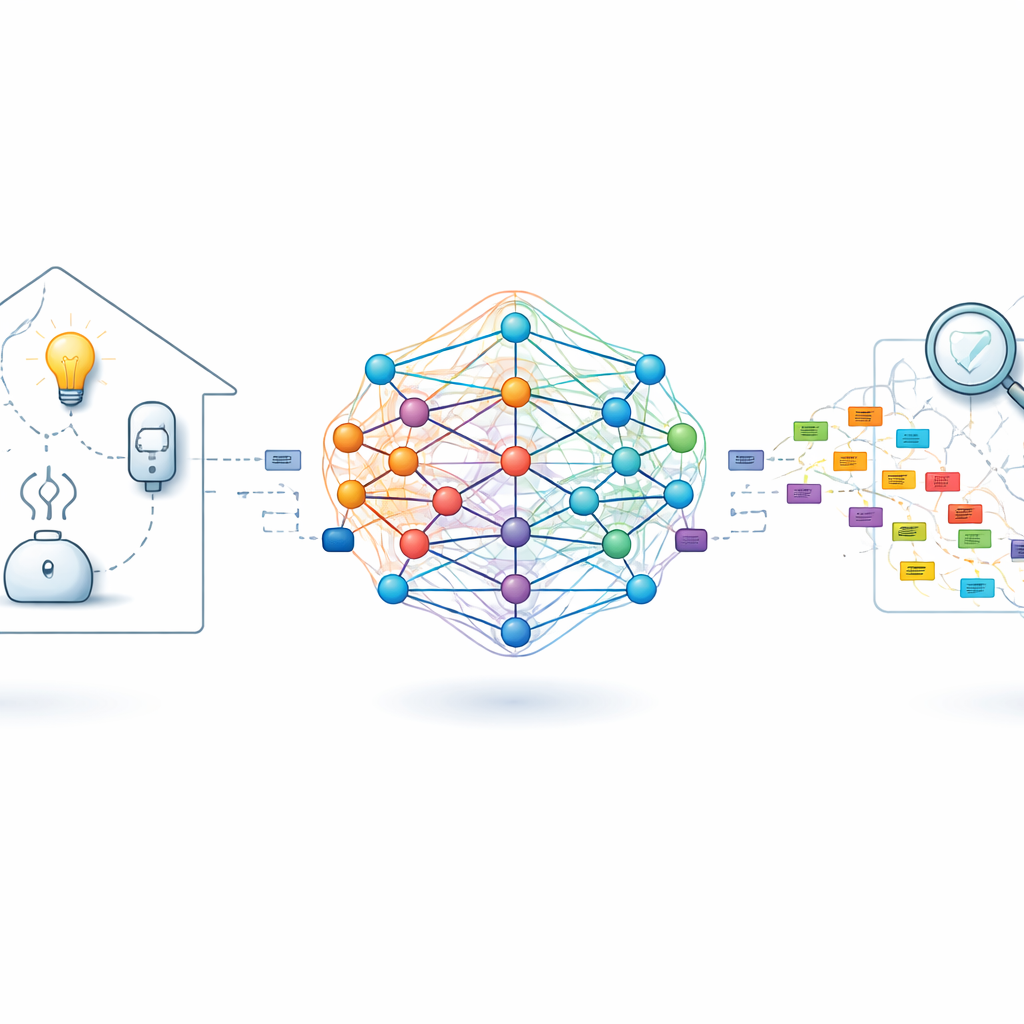

По мере того как в наших домах появляются умные лампы, розетки и датчики, невидимый обмен данными между ними становится одновременно удобством и потенциальным слабым местом. Инженерам, создающим и защищающим эти системы, нужны безопасные способы «репетировать», как сети ведут себя в реальных условиях, включая редкие сбои и кибератаки. В этой работе исследуется, можно ли переназначить современные языковые модели ИИ — те же, что используются в чат-ботах — для генерации реалистичного трафика умного дома, предоставив исследователям мощную тестовую среду без необходимости записывать каждый возможный сценарий из реальных домов.

От человеческого языка к разговорам устройств

Исследование сосредоточено на ZigBee — популярном беспроводном стандарте, используемом в умных лампочках, розетках и датчиках движения. Вместо генерации обычного текста авторы подаёют образцы пакетов ZigBee — с отметками времени, кто кому отправил и какие поля протокола использовались — в большие языковые модели (LLM) от OpenAI, в частности GPT‑4.1 и GPT‑5. Эти модели рассматривают каждый пакет как структурированное «предложение» и учатcя закономерностям в том, как устройства и центральный хаб обмениваются сообщениями во времени. Цель — не только подражать базовой статистике, например среднему размеру пакета, но и создавать новый трафик, который соблюдает строгие правила ZigBee, использует корректные адреса устройств и сохраняет реалистичную синхронизацию и паттерны запрос–ответ.

Два эксперимента: односторонний поток и полноценный диалог

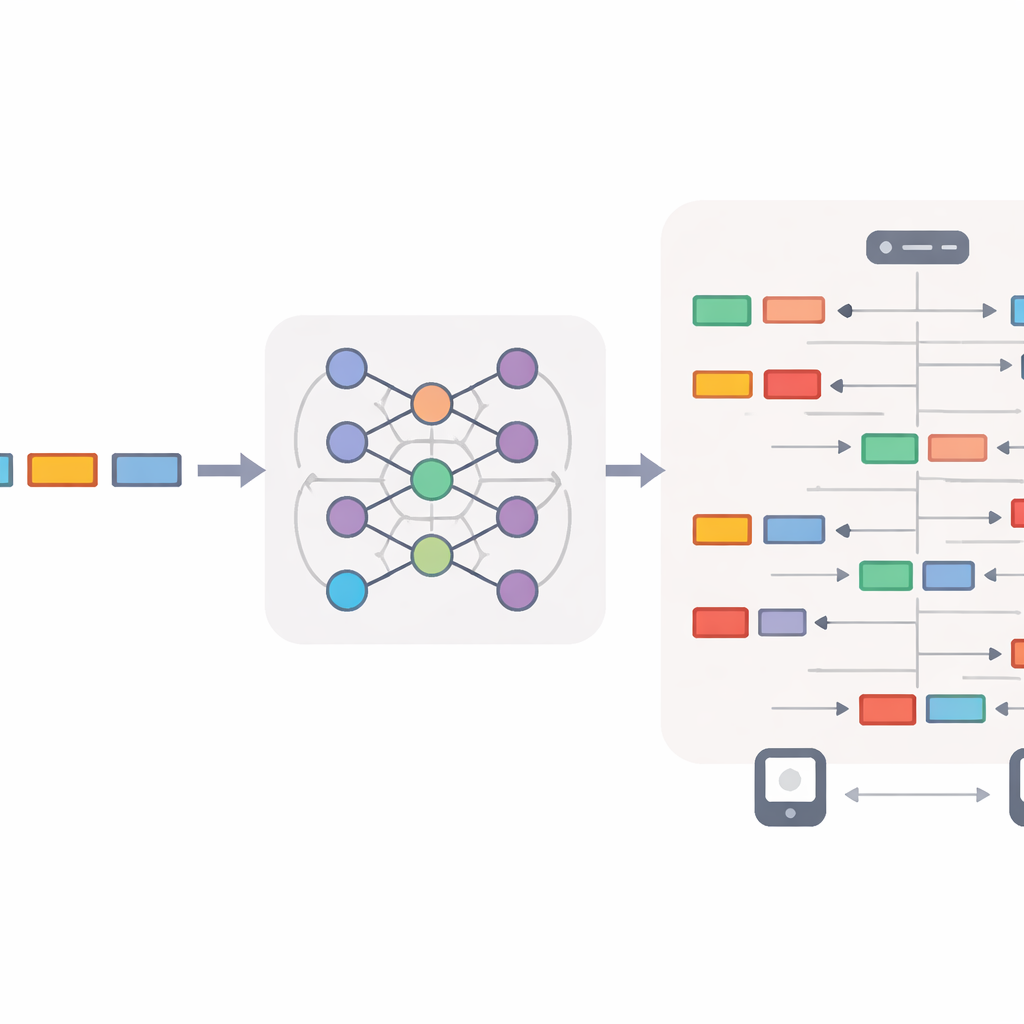

Чтобы проверить эту идею, исследователи разработали два основных эксперимента, используя большой реальный набор данных умного дома под названием ZigBeeNet, содержащий около 25 миллионов пакетов, собранных с 15 устройств в течение 20 дней. В первом эксперименте они изучают одностороннюю связь от одной умной лампочки к хабу, обучая LLM лишь на первых десяти минутах реального трафика в качестве примеров. Во втором эксперименте они переходят к более правдоподобной обстановке, где лампочка и хаб обмениваются сообщениями в обоих направлениях, включая широковещательные сообщения от хаба. В обоих случаях небольшой набор примерных пакетов показывают модели в подсказке (few‑shot learning), и от модели требуется сгенерировать более длинные участки совершенно нового трафика, которые можно преобразовать обратно в стандартные файлы захвата пакетов и проанализировать привычными сетевыми инструментами.

Направление модели правилами и проверками эксперта

Поскольку неправильно заданное поле или несоответствующая последовательность временных меток могут разрушить иллюзию реалистичности, команда создала тщательную систему подсказок и обратной связи. Сначала они фильтруют и экспортируют реальные пакеты, затем составляют подсказки, в которых перечислены допустимые адреса устройств, типы сообщений и форматы времени. На начальном этапе эксперт-человек просматривает вывод модели, выявляя проблемы, такие как недопустимые адреса, невозможные номера последовательностей или разрывы во времени. Вместо ручного исправления пакетов эти замечания переводят в более строгие правила подсказки — например, запретить устройству отправлять пакеты самому себе или требовать, чтобы число пакетов оставалось в реалистичных пределах. Когда правила стабилизируются, подсказки «замораживают» и повторно используют без изменений, чтобы дальнейшие эксперименты были полностью автоматизированы и воспроизводимы.

Противостояние LLM и старых генераторов

Чтобы понять, действительно ли LLM приносят пользу, авторы сравнивают GPT‑4.1 и GPT‑5 с двумя классическими подходами глубокого обучения: рекуррентными нейронными сетями (RNN) и генеративно-состязательными сетями (GAN), адаптированными для генерации последовательностей в стиле ZigBee. Они оценивают все модели по множеству показателей: насколько близко времена межприхода совпадают с реальным трафиком, декодируются ли пакеты корректно в стандартных инструментах, соблюдаются ли правила протокола и роли устройств, как часто повторяются пакеты и как часто они точно копируют обучающие примеры. Результаты показывают, что обе модели GPT генерируют почти полностью декодируемый и соответствующий протоколу трафик с низким отклонением от реальных временных паттернов, в то время как RNN испытывают сложности с долгосрочной упорядоченностью, а GAN часто создают нереалистично плотный или семантически неверный трафик, особенно в двухсторонней связи и на длительных интервалах.

Когда больше «размышлений» не помогает

Исследование также затрагивает неожиданный вопрос: улучшает ли реалистичность сети увеличение внутреннего «времени на обдумывание» в ориентированной на рассуждение модели GPT‑5? Увеличивая усилия рассуждения у GPT‑5 от низкого до высокого, авторы выясняют, что большее усилие делает модель медленнее и более многословной, но не улучшает, а иногда ухудшает близость сгенерированного трафика к реальности. GPT‑4.1, более быстрая модель без ориентации на сложные рассуждения, последовательно сравнима или превосходит GPT‑5 по ключевым метрикам качества, при этом используя меньше вычислительных ресурсов. В длительных 30‑минутных симуляциях обе LLM сохраняют корректное поведение ZigBee, тогда как классические базовые модели RNN и GAN значительно расходятся по времени и корректности протокола.

Что это значит для более безопасных умных домов

Для неспециалистов главный вывод в том, что современные языковые модели могут изучать не только человеческие разговоры, но и «язык» устройств умного дома, генерируя правдоподобный трафик, соблюдающий правила, по запросу. Работа показывает, что относительно быстрая, с низкой задержкой модель, такая как GPT‑4.1, уже может служить генератором трафика высокой точности для тестирования и оценки безопасности, потенциально сокращая потребность в захвате чувствительных реальных данных. Также подчёркивается, что более сложные модели с тяжёлым рассуждением не всегда лучше: для строго структурированных технических задач более простые и эффективные модели могут быть разумнее. После публикации кода и данных этот подход может помочь исследователям по всему миру стресс‑тестировать системы умного дома, улучшать обнаружение вторжений и изучать новые сетевые архитектуры в безопасной синтетической среде.

Цитирование: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Ключевые слова: умный дом IoT, генерация трафика ZigBee, большие языковые модели, тестирование сетевой безопасности, синтетические сетевые данные