Clear Sky Science · ru

Тонкая оценка больших языковых моделей в медицине с использованием непараметрического когнитивного диагностического моделирования

Почему это важно для будущих визитов к врачу

Системы искусственного интеллекта, которые говорят и пишут, известные как большие языковые модели, быстро переходят из исследовательских лабораторий в больницы. Они уже могут помогать врачам интерпретировать сложные данные, предлагать варианты лечения и отвечать на медицинские вопросы. Но большинство тестов этих систем дают лишь одну итоговую оценку, подобно баллу за выпускной экзамен, что может скрывать опасные пробелы. В этом исследовании показан новый способ проникнуть внутрь этих оценок и выявить, в каких именно областях медицины модели действительно обладают знаниями, а где они всё ещё могут представлять риск для пациентов.

За пределами единого балла теста

Сегодня большинство медицинских ИИ оценивают по тому, сколько вопросов они отвечают правильно на экзаменах, моделирующих врачебные лицензионные тесты. Такой подход прост, но груб. Модель может получить высокий общий балл, оставаясь при этом слабой в критической области, например в анализе сердечного ритма или при заболеваниях печени. В реальной клинической практике такие пробелы могут иметь последствия для жизни и смерти. Авторы утверждают, что безопасное использование ИИ в медицине требует более глубокого, детализированного тестирования — такого, которое сможет составить подробный профиль навыков вместо выдачи одной, возможно вводящей в заблуждение, оценки.

Более умный способ проверить медицинские знания

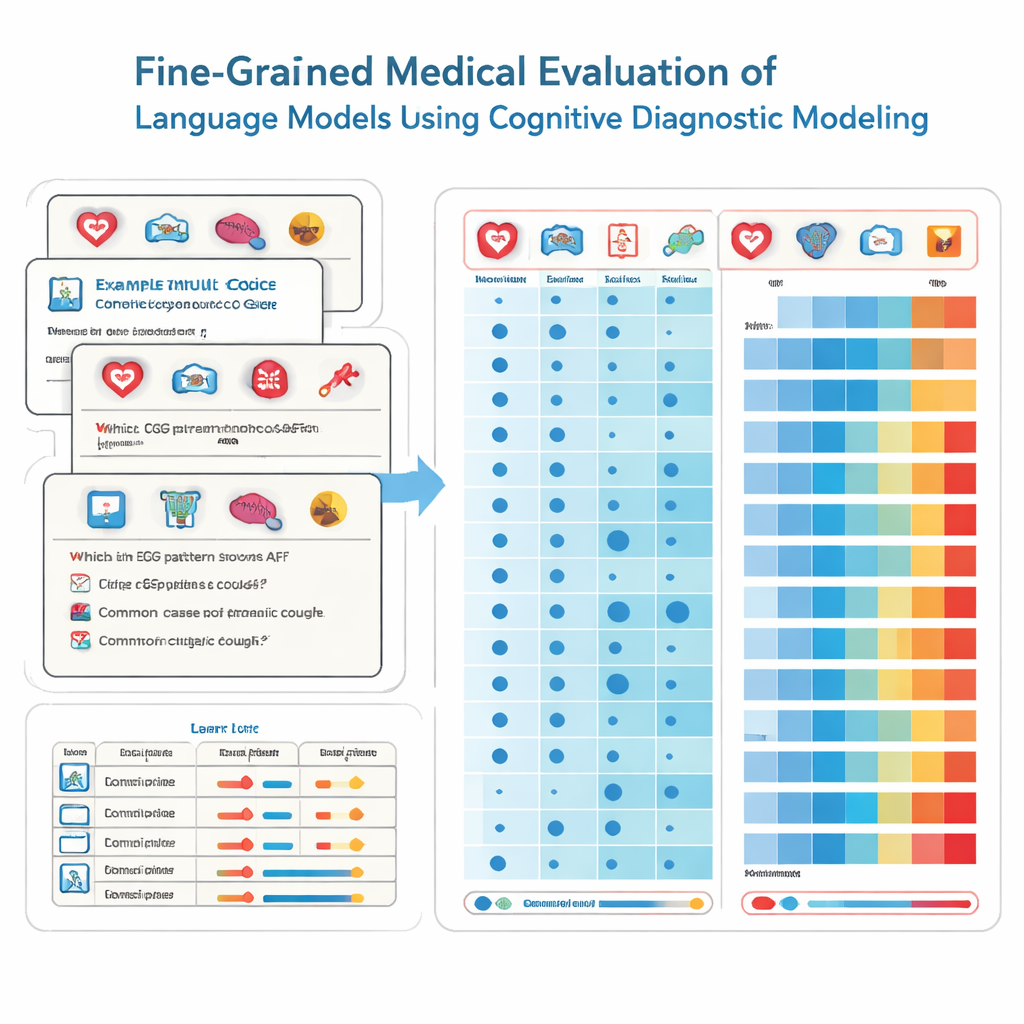

Для этого исследователи используют инструменты образовательной психологии, называемые когнитивной диагностической оценкой. Вместо того чтобы рассматривать каждый экзаменационный вопрос как измеряющий одну и ту же расплывчатую способность, этот метод разбивает медицинские знания на конкретные строительные блоки — кардиология, радиология, неотложная помощь и т. п. Каждый вопрос с несколькими вариантами ответа помечен точной смесью навыков, которые он требует. Применяя непараметрическую статистическую технику, команда сравнивает ответы модели на тысячи таких вопросов с идеальными шаблонами ответов. На этом основании они выводят, «овладела» ли модель каждым базовым навыком, как детализованный табель покажет сильные и слабые стороны по школьным предметам.

Проверка 41 модели ИИ на медицинском экзамене

Команда протестировала 41 широко используемую языковую модель, включая коммерческие системы и модели с открытым исходным кодом, на 2809 тщательно отобранных вопросах из базы национальных медицинских тестов Китая. Эти вопросы охватывают 22 медицинские поддоменa и предназначены для студентов, готовящихся к сдаче лицензионного экзамена врача. Каждый вопрос имеет один правильный ответ и помечен экспертами, указывающими, какие специальности он затрагивает. С помощью своей диагностической методики исследователи оценили для каждой модели, сколько из этих 22 медицинских атрибутов она фактически «овладела», а не просто сколько вопросов ответила правильно случайно.

Сильные общие знания, но резкие слепые зоны

Результаты одновременно впечатляют и вызывают опасения. Лучшие модели, включая несколько ведущих коммерческих систем, правильно отвечали на большинство вопросов и продемонстрировали владение 20 из 22 медицинских областей. Во многих распространённых специализациях уровень оказался высоким: в 15 областях, включая кардиологию, дерматологию и эндокринологию, было достигнуто полное владение. Однако тонкий анализ выявил резкие пробелы в других областях. Радиология отставала с заметно низкими показателями освоения, а два поддомена — интерпретация ЭКГ и вопросы гипертонии/липидов и заболевания печени — не были освоены ни одной моделью. Важно, что некоторые небольшие модели обладали теми же освоенными навыками, что и значительно большие, что показывает: сама по себе масштабность не гарантирует широких и надёжных медицинских знаний.

Выбор правильного инструмента для конкретной задачи

Эти детализированные профили важны, потому что модели с очень похожими общими результатами могут демонстрировать совершенно разные сочетания сильных и слабых сторон. Одна система может быть сильна в неврологии, но слаба в фармакологии; другая — наоборот. Для руководителей больниц это значит, что нельзя безопасно выбирать помощника ИИ, опираясь только на его итоговый экзаменационный балл или количество параметров. Необходимы диагностические результаты, как в этом исследовании, чтобы сопоставить каждую модель с конкретными клиническими задачами и выстроить рабочие процессы, в которых специалисты-человеки перепроверяют выводы ИИ в областях высокого риска, где модель известна своими слабостями.

Что это значит для пациентов и клиницистов

Проще говоря, исследование делает вывод: высокий «балл» на медицинских тестах не гарантирует, что система ИИ безопасна для использования во всех областях медицины. Новый подход работает скорее как тщательное медицинское обследование самого ИИ, выявляя «органи» — в данном случае медицинские специальности — которые здоровы и которые требуют внимания. Обнаруживая скрытые пробелы в критических областях, таких как интерпретация ЭКГ и заболевания печени, метод даёт больницам, регуляторам и разработчикам практическую дорожную карту: использовать модели только там, где их силы подтверждены, удерживать людей в цикле принятия решений в областях с известными слабостями и фокусировать дальнейшее обучение на самых рискованных слепых зонах. Авторы утверждают, что такого рода тонкая оценка не просто полезна — она необходима перед доверием ИИ в уходе за пациентами.

Цитирование: Zheng, T., Liu, J., Feng, S. et al. Fine-grained evaluation of large language models in medicine using non-parametric cognitive diagnostic modeling. Sci Rep 16, 6460 (2026). https://doi.org/10.1038/s41598-026-36627-7

Ключевые слова: медицинский ИИ, большие языковые модели, клиническая безопасность, оценка моделей, диагностическое тестирование