Clear Sky Science · ru

Научные отчёты: многореляционный двойной внимательный графовый трансформер для тонкой сентимент-анализа

Почему в обзорах важны крошечные подсказки

Онлайн‑отзывы полны смешанных чувств: в ресторане может быть «отличная еда, но медленное обслуживание», а у телефона — «красивый экран, но ужасная батарея». Компаниям и исследователям нужно, чтобы компьютеры понимали такие детальные мнения, а не только общий тон отзыва. В этой статье предложена новая модель искусственного интеллекта, которая фокусируется на конкретных частях предложения — например, «обслуживание» или «время работы батареи» — и точно определяет, как пользователи относятся к каждой из них, даже когда подсказки разбросаны и тонки.

Взгляд за пределы универсального подхода к сентименту

Традиционный анализ сентимента рассматривает предложение или отзыв как единый текстовый фрагмент и решает, в целом он положительный или отрицательный. Это работает для простых комментариев, но терпит неудачу, когда в одном предложении хвалят один аспект и критикуют другой. Область анализа сентимента по аспектам решает эту проблему, задавая вопрос: какое отношение выражено к каждому конкретному объекту, например «обслуживанию», «атмосфере» или «персоналу» в отзыве о ресторане. Ранние методы опирались на вручную созданные правила или простые алгоритмы, подсчитывающие слова; затем появились нейросети, читающие текст последовательно, слева направо. Эти последовательные модели повысили точность, но всё ещё пропускали дальние связи и тонкие сигналы, особенно когда важные слова находятся далеко друг от друга или связаны словами контраста, такими как «но» и «хотя».

Преобразование предложений в связанные карты

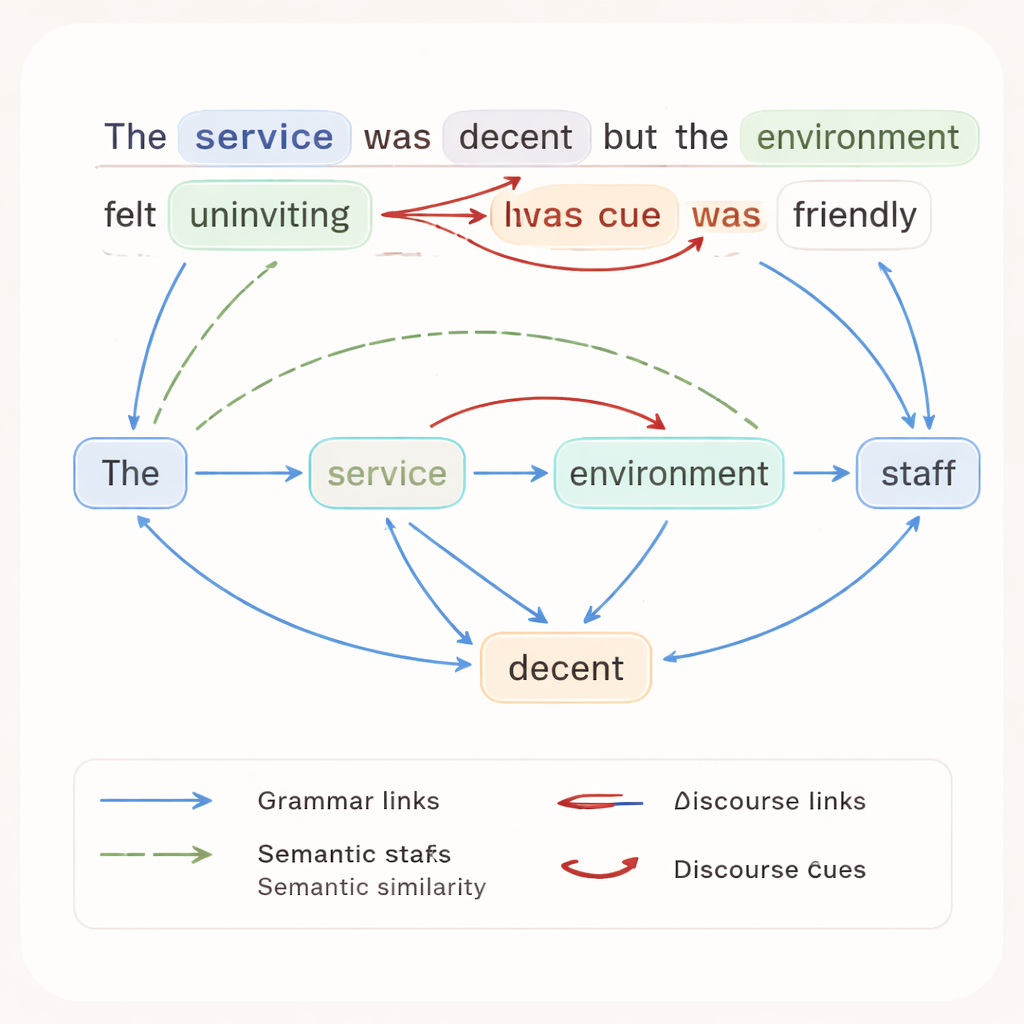

Авторы утверждают, что для реального понимания тонких мнений компьютер должен видеть предложение как сеть, а не как прямую линию. В их подходе каждое слово становится узлом в графе, а разные типы отношений — рёбрами. Один набор рёбер фиксирует грамматику, например, какое слово является субъектом или дополнением. Другой набор связывает слова, схожие по смыслу, даже если они не соседствуют. Третий набор отмечает дискурсивные маркеры — слова вроде «но», «однако» или «хотя», которые часто сигнализируют об изменении мнения. В предложении типа «Обслуживание было приличным, но атмосфера казалась неприветливой, хотя персонал был дружелюбен» такой граф показывает, как похвала и критика переплетаются вокруг разных аспектов.

Двойной прожектор на контекст и целевые объекты

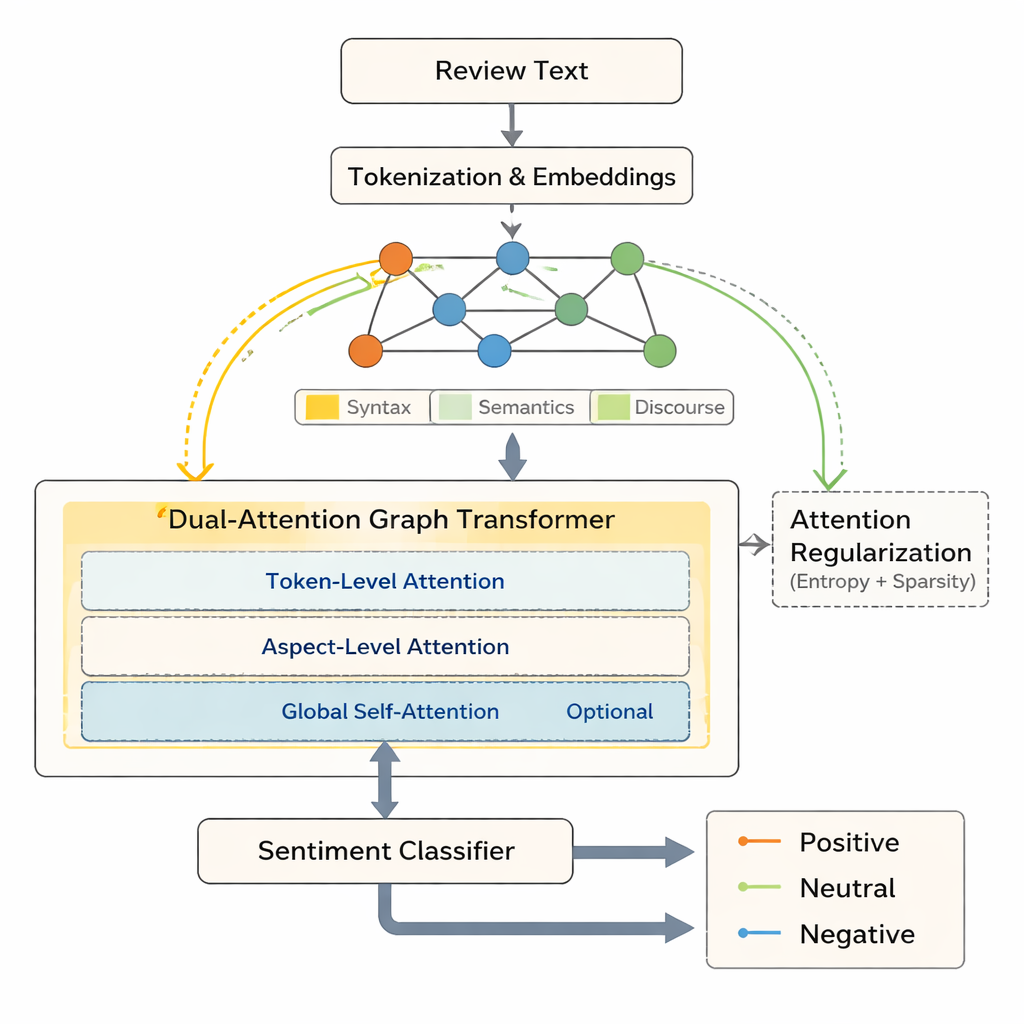

Исходя из представления в виде графа, статья представляет Многореляционный Двойной Внимательный Графовый Трансформер (MRDAGT). Эта модель использует механизм внимания в стиле трансформера, адаптированный для графов. Одна голова внимания смотрит широко на то, как все слова в предложении соотносятся друг с другом, собирая полезный локальный контекст. Вторая голова внимания фокусируется конкретно на рассматриваемом аспекте — например «обслуживание» или «атмосфера» — и усиливает влияние слов, формирующих мнение об этом объекте, таких как «приличное» или «неприветливое». Когда в одном предложении несколько аспектов, опциональный слой глобального внимания помогает модели взвешивать их взаимодействия. По сути система включает два скоординированных прожектора: один на общей структуре предложения, другой — прямо на аспекте, чей сентимент она пытается оценить.

Сделать машинное внимание более избирательным и объяснимым

Ключевая проблема современных ИИ в том, что веса внимания — числа, показывающие, на какие слова модель обращает внимание — могут быть слишком размытыми, что усложняет интерпретацию решений. MRDAGT решает это с помощью двух регуляризующих факторов. Штраф по энтропии препятствует чрезмерно ровному распределению внимания, подталкивая модель сосредотачиваться сильнее на нескольких важных словах. Одновременно L1‑терм разреживания подталкивает многие связи внимания к нулю, отсекая слабые, шумные связи. Вместе эти силы создают «фокусированную разреженность»: модель склонна ставить явные, высокие веса на действительно релевантные пары слово–аспект и игнорировать отвлекающие элементы. Эксперименты на трёх эталонных наборах данных — формальные отзывы о ноутбуках, сложные многофразовые отзывы и неформальные посты в Twitter — показывают, что MRDAGT стабильно превосходит сильные существующие системы примерно на один‑два процентных пункта в точности, при этом давая более чистые, интерпретируемые карты внимания.

Что это значит для практического извлечения мнений

Для неспециалистов вывод прост: эта модель предлагает более точный и надежный способ извлекать мнения из неряшливого, реального текста. Вместо того чтобы просто заявить, что отзыв «в основном положительный», MRDAGT может отдельно сообщить, что пользователям нравится скорость устройства, но не нравится батарея, или что посетители ценят персонал кафе, но жалуются на шум. Поскольку паттерны внимания модели соответствуют человеческой интуиции — фокусируясь на словах контраста, прилагательных с сентиментом и терминах аспектов — аналитикам легче понять, почему модель вынесла то или иное суждение. Авторы предполагают, что этот подход может поддерживать лучшие решения по дизайну продукта, более точный мониторинг в социальных сетях и будущие расширения на многие языки и даже мультимодальные данные, такие как аудио и изображения, при сохранении относительно прозрачного процесса рассуждения.

Цитирование: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Ключевые слова: анализ сентимента по аспектам, графовые нейронные сети, внимание трансформера, извлечение мнений, обработка естественного языка