Clear Sky Science · ru

Глубокая модель сентимент-анализа, объединяющая контекст на базе ALBERT и архитектуру, оптимизированную EHO

Почему важно умнее распознавать настроения

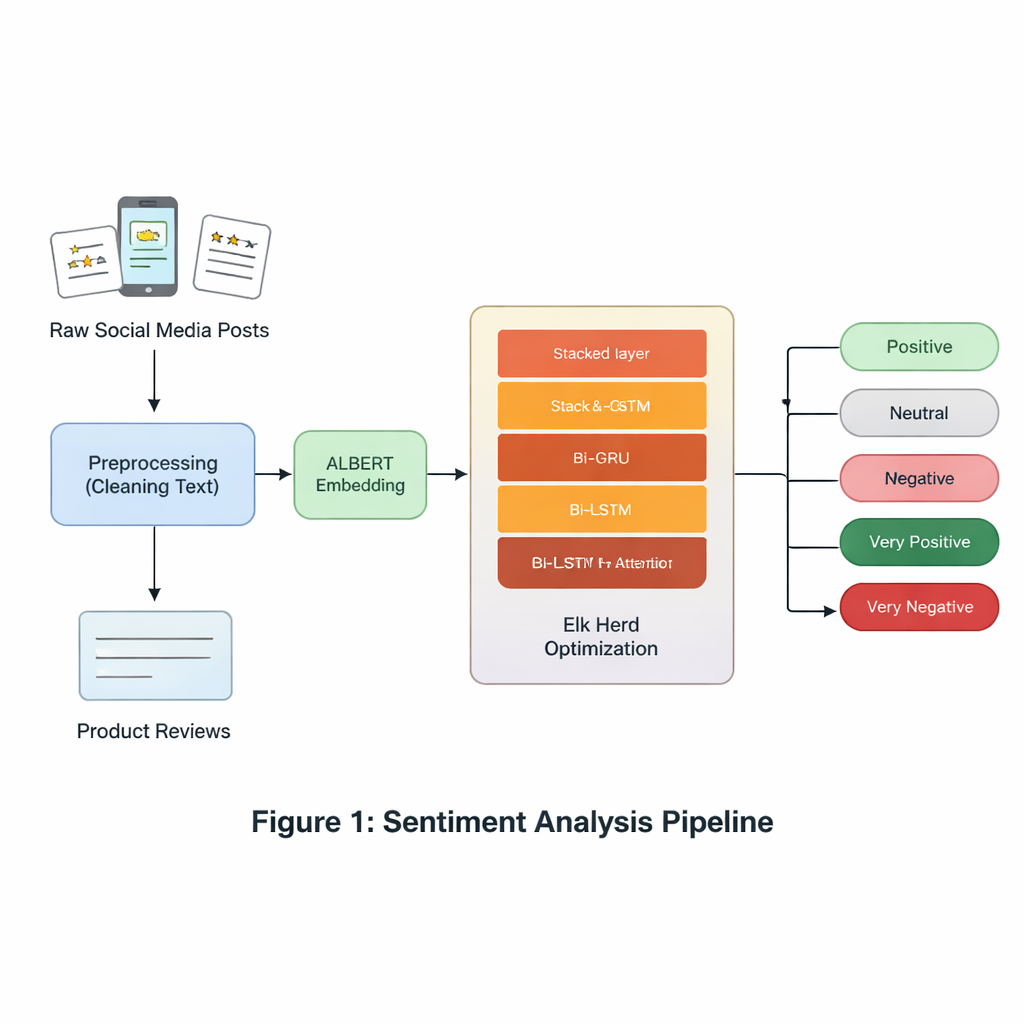

Каждый день миллионы людей публикуют мнения о товарах, услугах, политике и событиях в интернете. Превращать этот поток текстов в надежные выводы жизненно важно для компаний, органов власти и исследователей. При этом наш онлайн-язык запутан: сарказм, жаргон, опечатки и редкие эмоции легко сбивают компьютеры с толку. В этой работе предлагается новая система сентимент-анализа, которая стремится точнее считывать такие эмоции, затрачивая при этом меньше вычислительных ресурсов, чем многие современные модели искусственного интеллекта.

От простого подсчета слов к учету контекста

Ранние инструменты сентимент-анализа рассматривали текст как мешок разрозненных слов, подсчитывая, как часто встречаются такие термины, как «хорошо» или «ужасно». Этот подход игнорировал порядок слов и тонкие нюансы контекста, например «не плохо», что по смыслу ближе к «довольно хорошо». Методы глубокого обучения улучшили ситуацию, обрабатывая текст как последовательности, но они часто требовали огромных размеченных наборов данных и значительных вычислительных ресурсов. Трансформерные модели вроде BERT подняли точность еще выше, но их большой размер делает их дорогими в эксплуатации в реальных условиях, таких как сервисы поддержки клиентов или системы мониторинга социальных сетей. Авторы этой статьи ответили на эту проблему, объединив несколько более легких, но мощных компонентов в одном оптимизированном решении.

Более экономный «мозг» для понимания текста

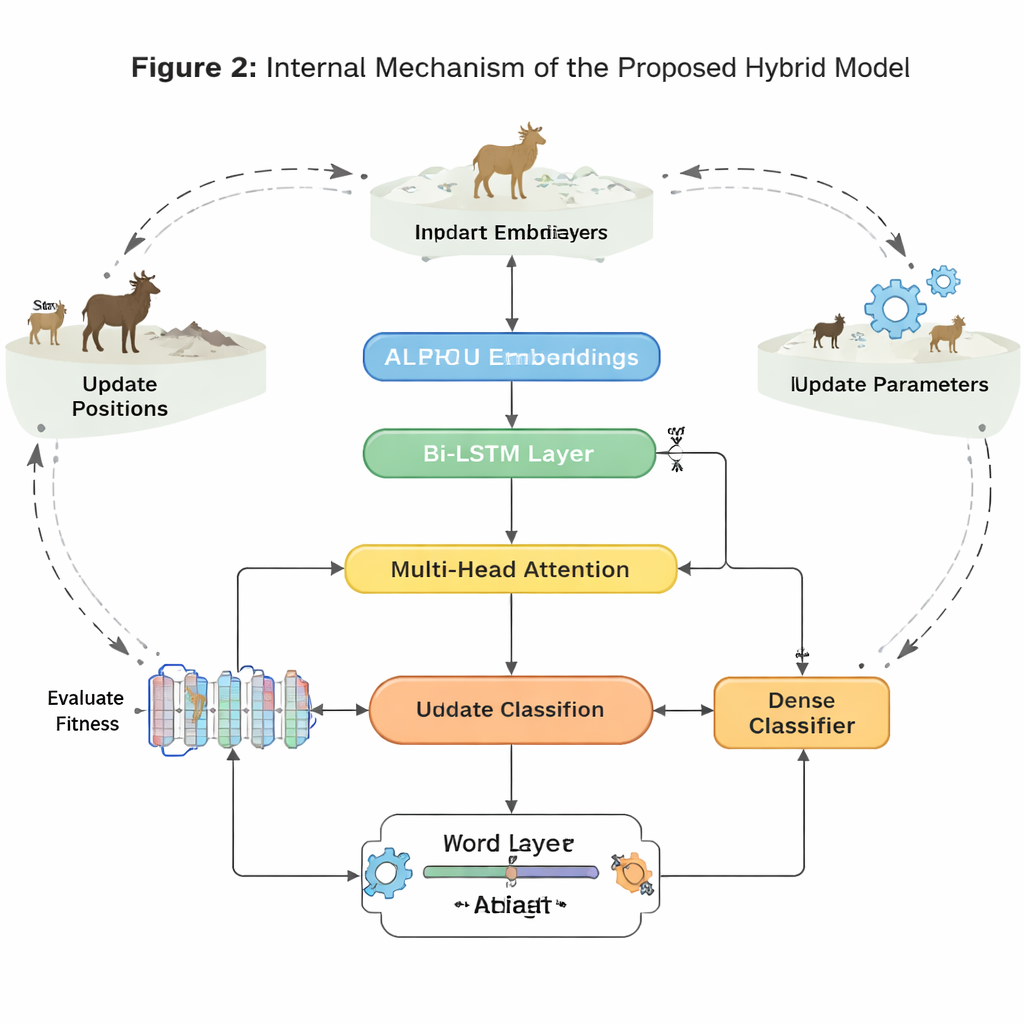

В основе модели лежит ALBERT — компактный «родственник» языковой модели BERT. ALBERT преобразует каждое слово в предложении в контекстно-зависимое числовое представление, фиксируя, как меняется значение в зависимости от соседних слов. В отличие от более крупных моделей, ALBERT снижает требования к памяти за счет совместного использования параметров между слоями и сжатия словаря. Это упрощает запуск на стандартном оборудовании без значительной потери понимания. Эти представления слов на базе ALBERT становятся входом в цепочку специализированных слоев, которые фокусируются на том, как эмоции разворачиваются по ходу предложения.

Две системы памяти, работающие вместе

Чтобы отслеживать, как значение меняется от слова к слову, система использует два типа рекуррентных сетей: GRU (Gated Recurrent Units) и LSTM (Long Short-Term Memory), каждая из которых запускается в прямом и обратном направлениях. GRU эффективны для отслеживания коротких фраз при меньшем количестве параметров, тогда как LSTM лучше запоминают информацию на более длинных отрезках текста. Накладывая двунаправленный слой GRU поверх двунаправленного слоя LSTM и добавляя механизм внимания, модель может выделять наиболее насыщенные эмоцией части предложения — например фразу «кроме времени работы батареи» в в остальном положительном отзыве. Этот гибридный дизайн нацелен на улавливание как быстрых изменений тона, так и более дальних контекстных связей, которые могут изменить общий сентимент.

Настройка, вдохновленная природой, для сложных случаев

Помимо архитектуры, авторы решают ключевую практическую проблему: наборы данных по настроениям часто несбалансированы и шумны. Эмоции вроде отвращения или удивления, а также нейтральные высказывания встречаются реже, чем явно положительные или отрицательные, из‑за чего многие модели их игнорируют. Чтобы противостоять этому, в работе используется Elk Herd Optimization — стратегия поиска, вдохновленная поведением лосей, моделирующая их перемещения, конкуренцию и групповые взаимодействия. После того как нейросеть формирует внутренние векторы настроений, этот этап оптимизации тонко настраивает представления каждого класса, особенно редких, итеративно улучшая «фитнес»-оценку. Этот процесс помогает модели избегать поверхностных решений и улучшает способность различать тонкие или недостаточно представленные эмоции.

Проверка модели в деле

Авторы оценивают свою систему на шести широко используемых наборах данных, включая посты в Twitter, отзывы о ресторанах и ноутбуках, а также пятиуровневый эталонный набор рецензий на фильмы, который разделяет крайне положительные и крайне отрицательные мнения от более умеренных. По этим разным источникам новый подход стабильно превосходит несколько передовых граф- и трансформер-ориентированных конкурентов как по точности, так и по F1-мере — метрике, балансирующей пропущенные и корректно обнаруженные случаи. Прирост особенно заметен в задаче с пятью классами рецензий на фильмы и по недостаточно представленным классам настроений, что показывает способность метода работать с тонкими эмоциями и несбалансированными данными. Абляционное исследование, в котором компоненты поочередно удаляются, подтверждает, что ALBERT, комбинированная архитектура GRU–LSTM, внимание и оптимизация, вдохновленная поведением лосей, каждый вносят вклад в итоговую производительность.

Что это значит для повседневных приложений

Для неспециалистов главный вывод в том, что это исследование предлагает более эффективный и надежный способ интерпретации больших объемов онлайн‑мнений. Сочетая компактную языковую модель с дополняющими слоями памяти и биологически вдохновленной стадией настройки, система более точно «читает между строк», особенно когда настроения тонкие или данные смещены. Это делает подход перспективным для реальных применений, таких как отслеживание удовлетворенности клиентов, мониторинг общественного здоровья или оценка реакций на политики и события, где важны как точность, так и вычислительные затраты.

Цитирование: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Ключевые слова: анализ настроений, ALBERT, глубокое обучение, классификация текста, метаэвристическая оптимизация