Clear Sky Science · ru

CRFusion: новая сеть слияния LiDAR и камеры для построения BEV-карт

Умнее цифровые карты для автономных автомобилей

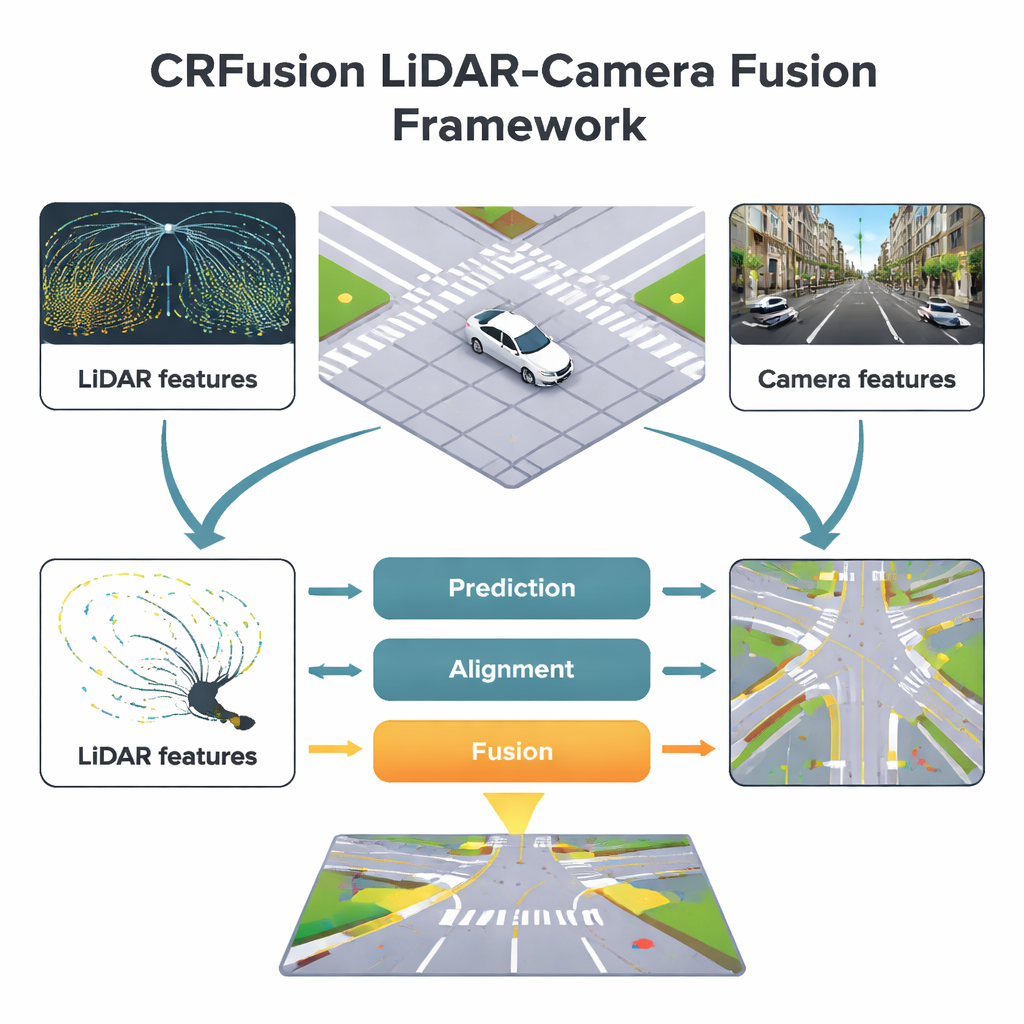

Для самоуправляемого автомобиля понимание предстоящей дороги похоже на чтение постоянно меняющейся карты. Транспортное средство должно точно знать, где расположены полосы, пешеходные переходы и края проезжей части, даже когда темно, идёт дождь или что-то закрывает обзор. В этой работе представлен CRFusion — новая система, которая объединяет лазерные сканеры и камеры, чтобы строить более чистые и надёжные карты сверху для городских улиц, помогая автономным автомобилям увереннее держаться в полосе и избегать пешеходов.

Почему два «электронных глаза» лучше, чем один

Современные автономные автомобили в значительной степени полагаются на два основных датчика. Камеры захватывают насыщенные цветные изображения, что облегчает обнаружение дорожной разметки, знаков и пешеходных переходов на дальнем плане. Лазерные сканеры, или LiDAR, посылают световые импульсы и измеряют их отражение, строя точную трёхмерную картину расстояний и форм вокруг автомобиля. У каждого из них есть недостатки: изображения камеры уязвимы к плохому освещению или погоде, тогда как данные LiDAR становятся разреженными и неполными с увеличением расстояния. CRFusion разработан так, чтобы объединить сильные и слабые стороны обоих датчиков в единый вид сверху — карту, где каждый пиксель представляет небольшой участок поверхности, помеченный как полоса, разделительная линия или пешеходный переход.

Заполнение пробелов в дальнем обзоре

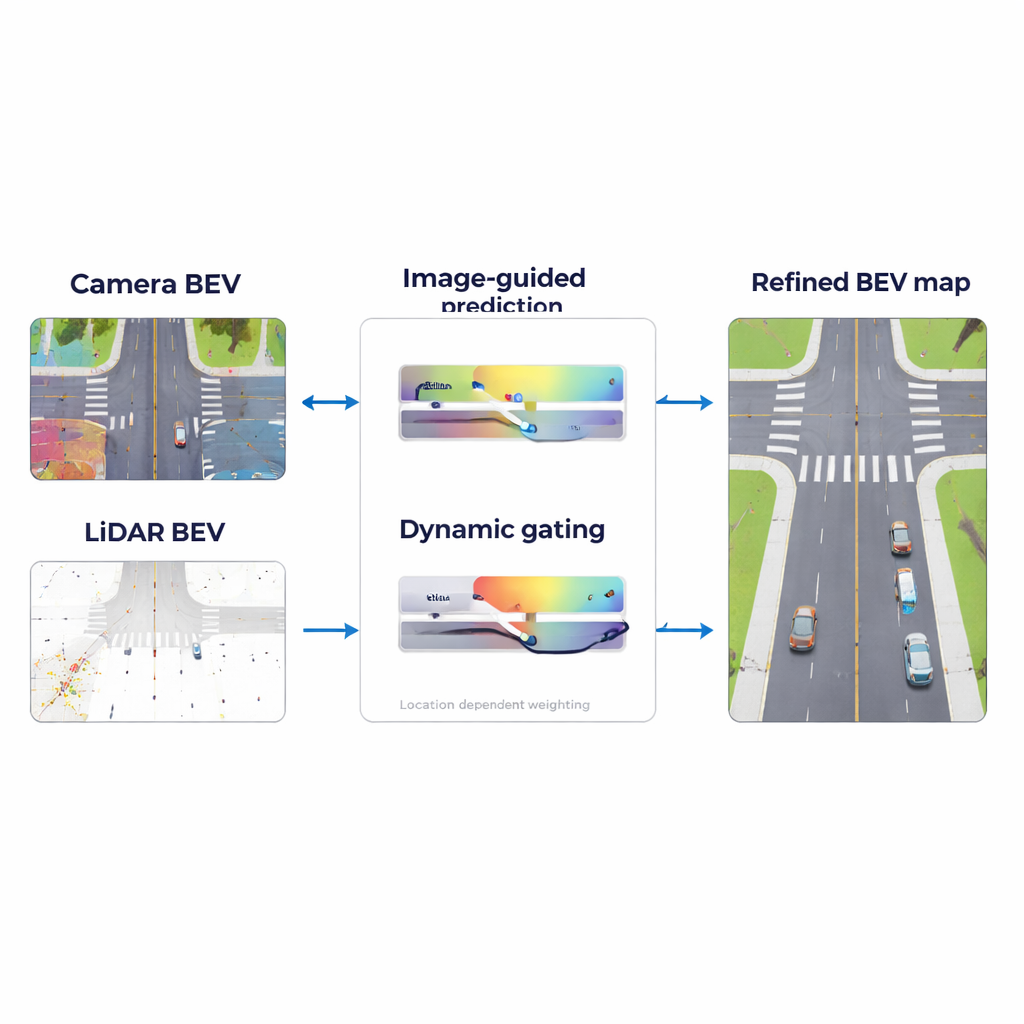

Ключевая проблема в картировании дорог заключается в том, что LiDAR часто пропускает детали далеко от автомобиля, как раз там, где важно заранее планировать движение. CRFusion решает это с помощью «предсказателя дальности LiDAR». Проще говоря, система смотрит, что камера видит далеко по ходу движения, и использует эту информацию, чтобы предположить, какие показания дал бы LiDAR, если бы они были плотными и полными. Механизм внимания помогает модели определить, какие части изображения камеры лучше всего объясняют пустые или неопределённые участки на карте, основанной на LiDAR. Затем система уточняет это предсказание, сравнивая соседние области карты, усиливая согласованные паттерны, такие как непрерывные линии полос, и уменьшая случайный шум.

Добиться согласия между датчиками

Даже когда камера и LiDAR оба работают, их данные не всегда идеально совмещены. Небольшие ошибки в оценке расстояний или в размещении датчиков могут вызвать смещение дорожной разметки, видимой камерой, по сравнению с показаниями LiDAR. CRFusion вводит этап выравнивания, который аккуратно «искажает» топ‑даун признаки камеры, чтобы они лучше соответствовали виду LiDAR. Для этого используется лёгкая корректирующая сеть, предсказывающая, на сколько нужно сдвинуть каждую точку на карте камеры. В результате два представления датчиков описывают одни и те же физические позиции на дороге, что делает последующее слияние гораздо более надёжным.

Адаптация к дню, ночи и плохой погоде

После выравнивания двух представлений система всё ещё должна решать, кому и в какой степени доверять в каждой точке карты. Солнечная шоссе с чёткой разметкой сильно отличается от дождливой ночи в переполненном городе. CRFusion решает эту задачу с помощью модуля «динамического управляемого слияния» (Dynamic Gated Fusion), который назначает гибкие веса признакам камеры и LiDAR по всей карте. Там, где возвраты LiDAR сильны — например, у близких краёв дороги или у твёрдых объектов — система опирается больше на LiDAR. Где визуальные подсказки более информативны — например, яркие полосы пешеходного перехода на расстоянии — она больше полагается на камеру. Эти веса обучаются автоматически на данных, что позволяет стратегии слияния плавно менять при изменении условий.

Доказательство преимуществ на реальных данных

Исследователи протестировали CRFusion на широко используемом наборе данных для автономного вождения NuScenes, который включает множество сцен в разных городах, погоде и временных промежутках суток. По сравнению с передовыми ранними методами CRFusion дал более точные границы полос, разделителей и пешеходных переходов, особенно на средних и больших расстояниях до 90 метров. Он улучшил стандартные метрики качества как по перекрытию с эталонными картами, так и по способности обнаруживать отдельные сегменты полос, а абляционный анализ показал, что каждый крупный компонент — предсказание дальности, сеть выравнивания и динамическое слияние — вносит существенный вклад. Визуальные примеры показали более плавную непрерывность полос и чёткие пешеходные переходы, подтверждая, что карты системы больше похожи на аккуратно нарисованные планы дорог.

Что это значит для повседневного вождения

Для неспециалистов главный вывод в том, что CRFusion помогает автономным автомобилям строить чище и надёжнее уличные карты, позволяя камерам и LiDAR «обмениваться» информацией более разумным способом. Предсказывая недостающие данные LiDAR по изображениям камер, выравнивая две перспективы датчиков и регулируя степень доверия к каждому из них в зависимости от ситуации, система уменьшает слепые зоны и догадки. Это приближает автономные транспортные средства к тому, чтобы уверенно справляться со сложными, загромождёнными городскими улицами так же, как аккуратный водитель, следующей хорошо обозначенным полосам и переходам.

Цитирование: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Ключевые слова: автономное вождение, слияние LiDAR и камеры, HD семантические карты, вид сверху (bird’s-eye view), картирование городских дорог