Clear Sky Science · ru

Мульти‑модальный подход к распознаванию фейковых новостей и выявлению влиятельных узлов, распространяющих их, с использованием глубокого обучения и анализа сетей

Почему это важно в повседневной жизни

Каждый день миллионы людей листают социальные сети и видят посты о здоровье, политике, деньгах и многом другом. В потоке полезной информации встречаются слухи и фейковые новости, которые могут сеять страх, путаницу или наносить реальный вред. В этом исследовании предложен мощный способ решить сразу две задачи: во‑первых, автоматически обнаруживать ложные или вводящие в заблуждение сообщения, а во‑вторых, картировать тех, кто наиболее отвечает за их распространение в онлайн‑сообществе. Работа сосредоточена на твитах о Covid‑19, но идеи могут помочь платформам, журналистам и широкой публике быстрее и точнее реагировать на вредную дезинформацию в разных сферах жизни.

Как слухи распространяются в онлайне

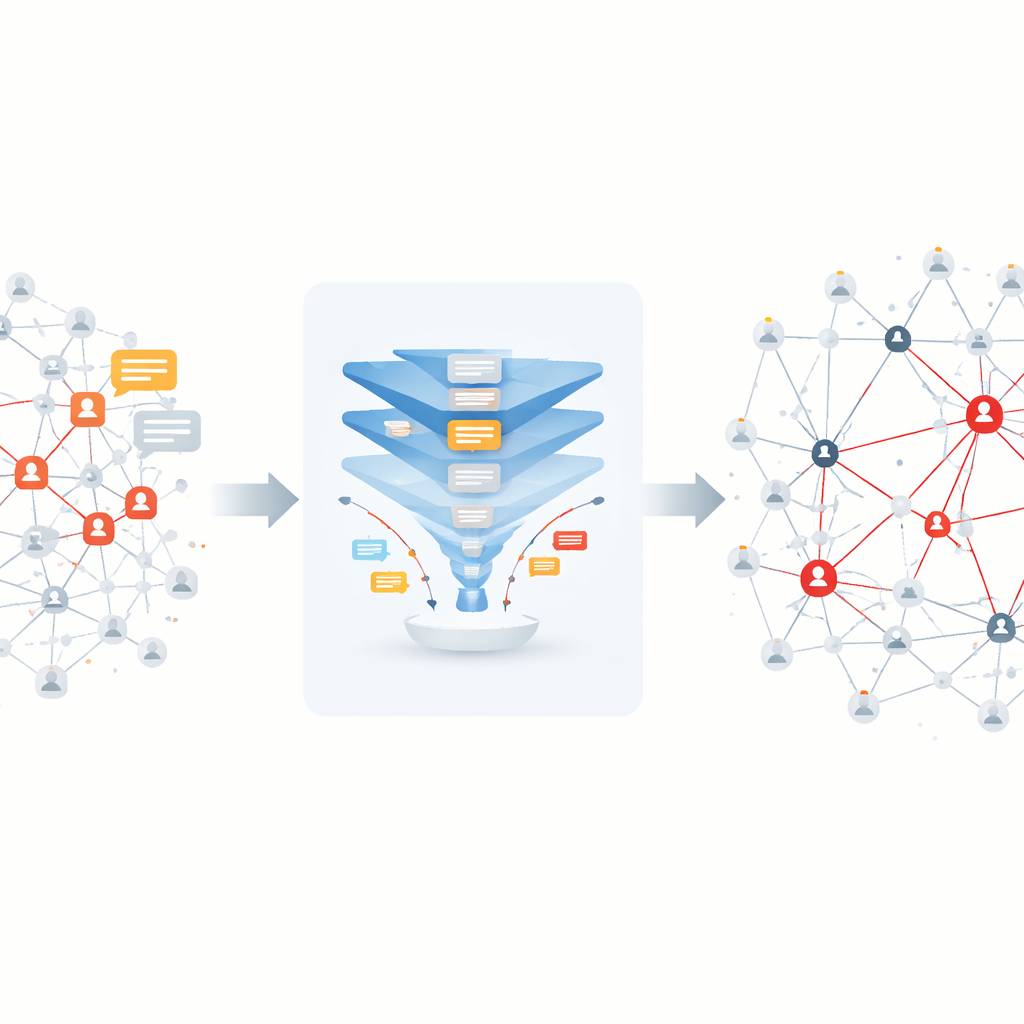

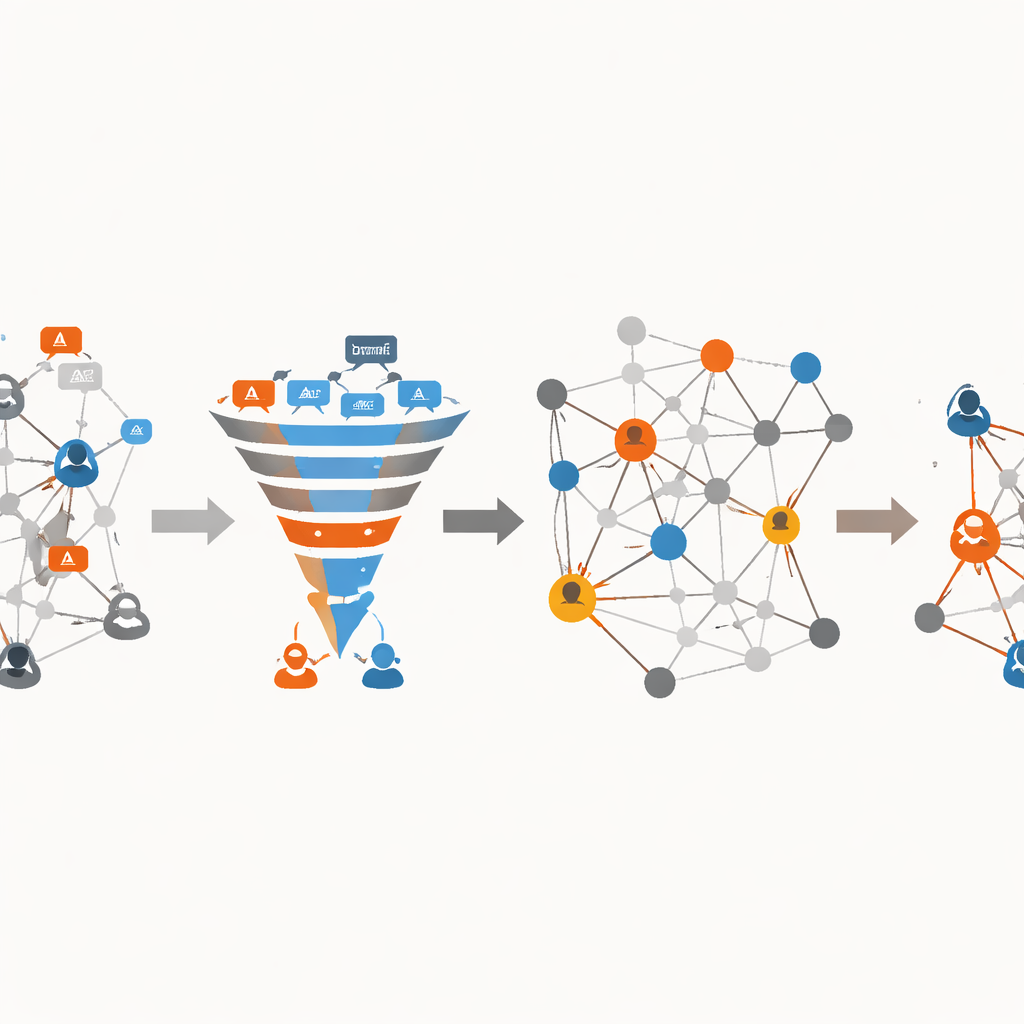

Социальные сети вроде Twitter, Facebook или мессенджеров можно представить как огромную сеть людей (узлов), связанных взаимодействиями (ребрами). Когда один пользователь публикует сообщение, а другие отвечают или репостят, информация быстро расходится по сети. Слухи — непроверенные или ложные утверждения — ведут себя по‑разному, похожему на заразные болезни: они перепрыгивают от человека к человеку, растут быстро и их трудно остановить. Предыдущие исследования часто рассматривали два вопроса отдельно: как определить, является ли данное сообщение слухом, и как найти ключевых «распространителей», помогающих слуху достигнуть многих людей. Авторы утверждают, что совместный подход к этим вопросам с учётом структуры сети и динамики активности даёт гораздо более ясную картину движения ложных историй.

Обучение компьютера распознавать сомнительные сообщения

Первая часть метода ориентирована на содержимое каждого твита. Исследователи рассматривают каждый твит как короткий документ и очищают его: удаляют лишние символы, заменяют веб‑ссылки и адреса электронной почты простыми метками и убирают распространённые служебные слова, мало добавляющие смысла. Затем каждое слово переводят в числовой вектор с помощью широко используемой техники GloVe, которая фиксирует, как слова обычно соотносятся в больших корпусах текста. Усредняя эти векторы слов, каждый твит превращается в компактное числовое представление смысла. Эти представления подаются на вход одномерной сверточной нейронной сети — типу модели глубокого обучения, способной выявлять тонкие закономерности — которая решает, является ли твит правдивым сообщением или слухом.

Поиск ключевых распространителей в сети

После того как система разделила твиты‑слухи и реальные сообщения, вторая часть подхода обращается к структуре самой социальной сети. Каждый пользователь рассматривается как вершина в ориентированном взвешенном графе, а ответ или ретвит становятся ребром, чья сила отражает частоту реакций одного пользователя на сообщения другого. Используя эту информацию, авторы сначала группируют пользователей в сообщества — кластеры, внутри которых взаимодействия интенсивнее, чем с внешними узлами — строя специальное древовидное представление сети и затем объединяя тесно связанные подгруппы на основе степени их соответствия друг другу. Внутри этих сообществ они вычисляют, как часто каждый пользователь лежит на важнейших путях между другими, меру, известную как промежуточность (betweenness). Пользователи, которые часто встречаются на путях с высокой значимостью, рассматриваются как влиятельные распространители. Затем веса связей обновляются с учётом и частоты взаимодействий, и центральности связанных пользователей, что выявляет наиболее вероятные маршруты прохождения слухов через сеть во времени.

Что показал кейс по Covid‑19

Для проверки рамочной модели исследователи применили её к огромному набору твитов о Covid‑19: почти 100 миллионов твитов с участием более 150 000 пользователей, из которых они выделили свыше 14 000 уникальных сообщений, помеченных как достоверная информация или слухи. На этих данных их модель глубокого обучения корректно классифицировала примерно 99 процентов твитов, превзойдя несколько существующих методов, включая другие продвинутые детекторы фейков. На втором этапе они сравнили список влиятельных пользователей со знаменитой математической моделью распространения информации и нашли наибольшее совпадение среди протестированных методов. Они также показали, что при анализе более длинных временных периодов — 120, 240 и 360 дней — модель лучше определяет ключевых распространителей и основные маршруты слухов, и делает это с меньшим временем обработки по сравнению с конкурирующими методиками на основе сетей.

Что это значит для борьбы с дезинформацией

Проще говоря, исследование демонстрирует, что можно построить систему, которая не только с очень высокой точностью обнаруживает вероятные фейковые новости, но и прослеживает, как они распространяются и кто больше всего способствует их распространению. Вместо того чтобы считать всех пользователей и связи одинаково значимыми, метод выделяет более узкий набор сообществ и людей, поведение которых наиболее важно для контроля вредных историй. Хотя работа выполнена на анонимизированных данных Twitter о Covid‑19 и не обязательно напрямую обобщается на каждую платформу или тему, она указывает путь к более целенаправленным, основанным на данных ответам на онлайн‑слухи — например, к приоритетной проверке фактов, предупреждениям или вмешательствам платформ там, где они принесут наибольшую пользу, учитывая при этом приватность и этичное использование данных.

Цитирование: Zhang, W., Qian, M. & Zhang, Q. A multi-modal approach for recognizing fake news and influential nodes in spreading them using deep learning and network analysis. Sci Rep 16, 9775 (2026). https://doi.org/10.1038/s41598-026-35342-7

Ключевые слова: фейковые новости, социальные сети, распространение слухов, глубокое обучение, влиятельные пользователи