Clear Sky Science · ru

Улучшенный YOLOv11n для обнаружения мелких объектов в UAV-изображениях: выше точность при меньшем числе параметров

Почему важно замечать крошечные объекты с высоты

Малые летающие роботы быстро становятся частью повседневной жизни — от мониторинга трафика и реагирования при ЧС до доставки посылок. Но существует упорная проблема: когда дрон смотрит вниз с сотен метров, люди, автомобили и лодки уменьшаются до нескольких пикселей. Стандартные системы компьютерного зрения часто пропускают эти точки или путают их с фоном. В статье предложена более умная и компактная версия популярной детекционной системы YOLOv11n, специально настроенная для поиска таких крошечных объектов на изображениях с дронов при одновременной возможности работать на слабых бортовых компьютерах.

Уловить больше в крохотных, размытых деталях

Изображения с дронов — суровая среда для алгоритмов. Большинство целей меньше 32×32 пикселей, многие — менее 16 пикселей в поперечнике. Движение, вибрация, меняющееся освещение, дымка и загруженные городские фоны делают эти крошечные цели ещё труднее различимыми. При этом дроны часто полагаются на скромные процессоры и ограниченную энергию, поэтому тяжёлые модели непрактичны. Авторы берут за основу компактный детектор в реальном времени YOLOv11n и перерабатывают его внутренние компоненты, чтобы извлекать больше полезной информации из мелких, низкоконтрастных областей без раздувания модели. Их цель проста, но требовательна: заметно повысить точность по мелким объектам при сохранении равного или меньшего числа обучаемых параметров и приемлемой скорости на edge‑железе.

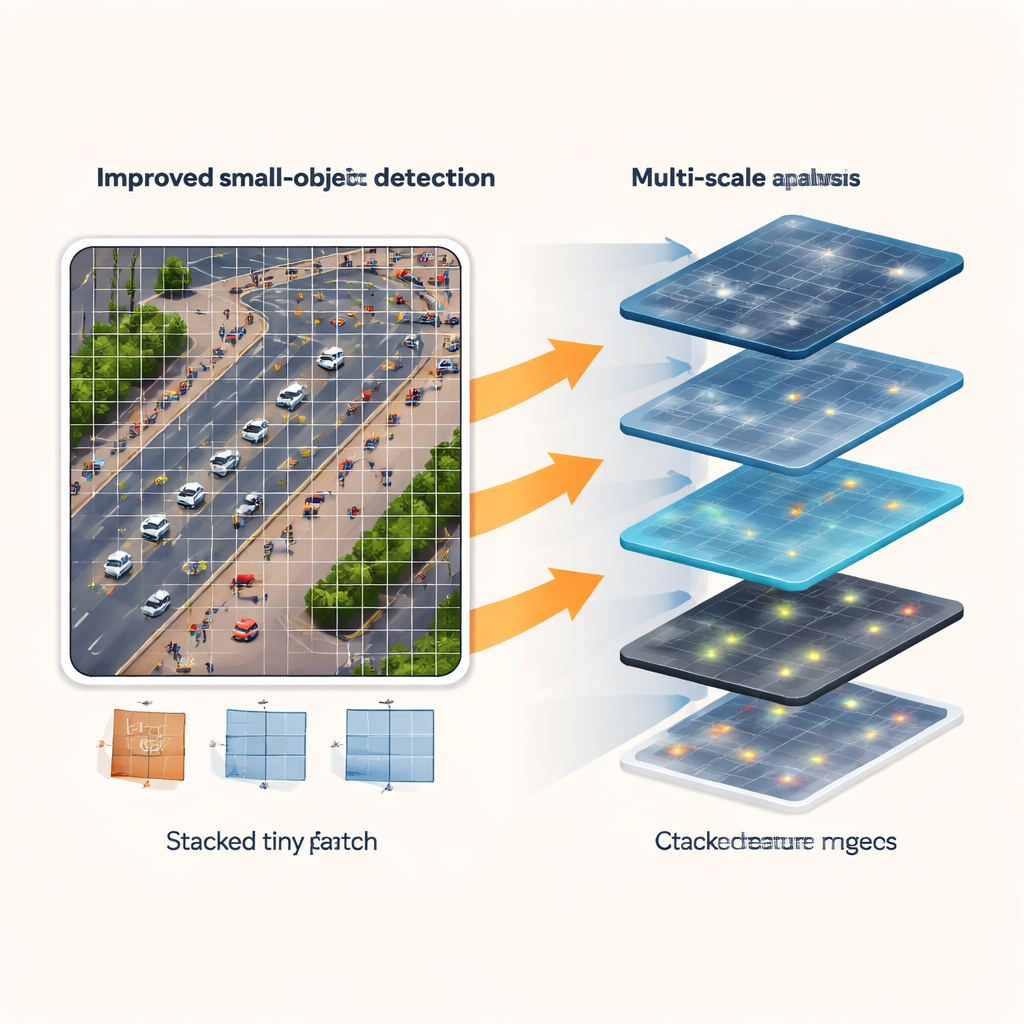

Учиться на сцене в нескольких масштабах

Первое улучшение касается того, как сеть «видит» сцену. Вместо просмотра через одно фиксированное окно новый модуль Multiscale Edge-Feature Adaptive Selection (MSEAF) наблюдает изображение одновременно на нескольких масштабах. Грубые представления фиксируют общую планировку дорог, зданий и толп, тогда как более мелкие — позволяют отслеживать отдельные машины или людей. Шаг усиления краёв подчёркивает границы и формы, которые легко различимы человеку, но часто теряются в крошечных фрагментах изображения. Умный механизм слияния затем усиливает наиболее информативные области и подавляет фоновый шум. Такое многомасштабное, чувствительное к краям представление даёт остальной части сети более богатый отправной материал для поиска трудновидимых объектов.

Сохранять мелкие объекты живыми на всём пути обработки

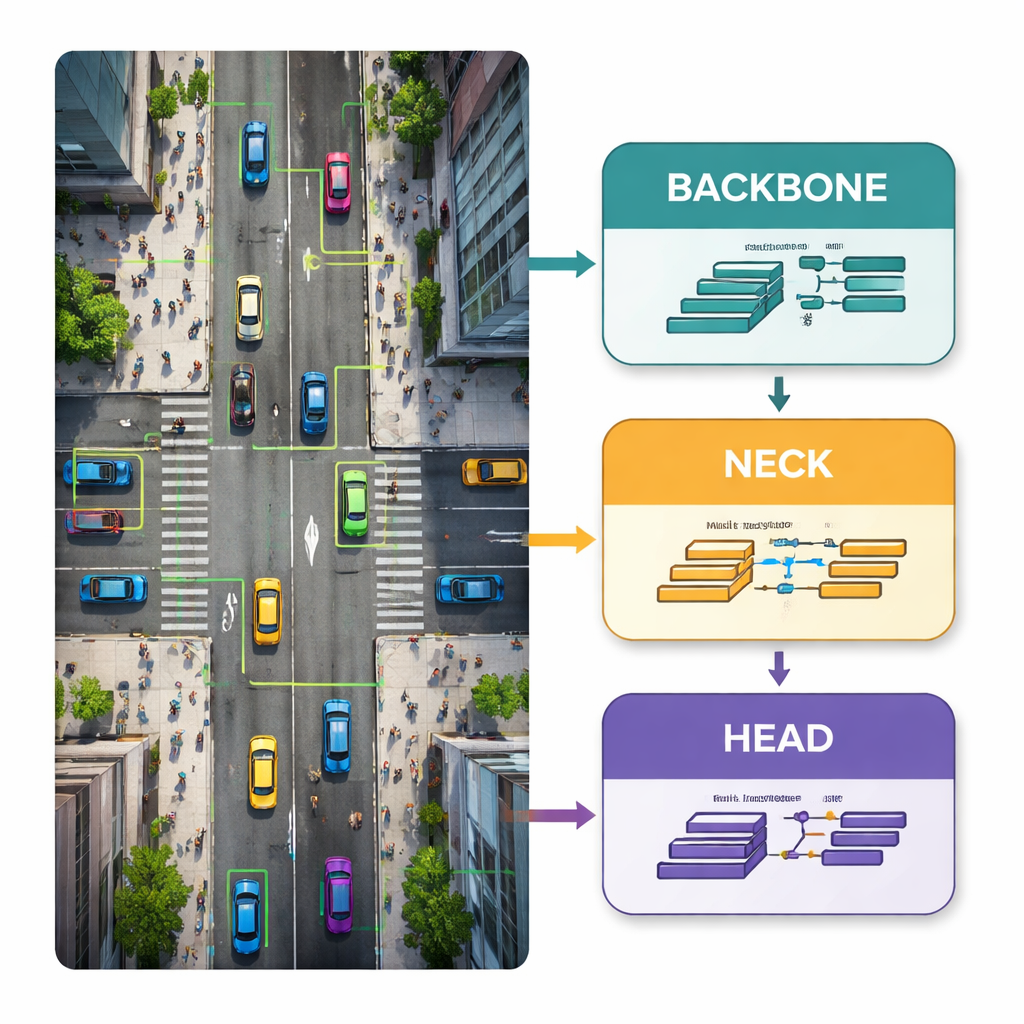

Традиционные сети YOLO многократно уменьшают карты признаков по мере передачи информации от входа к выходу. Для крупных объектов это обычно приемлемо, но для крошечных это может быть фатальным: после нескольких раундов даунсемплинга пешеход может занимать в внутренней карте лишь один–два пикселя или полностью исчезнуть. Чтобы этого избежать, авторы перестраивают среднюю «шею» сети и добавляют новую голову обнаружения P2, работающую с более высокоразрешёнными признаками. Пользовательские модули ScalCat и Scal3DC аккуратно комбинируют информацию из разных слоёв так, чтобы тонкие детали из поверхностных слоёв и более богатый контекст из глубоких слоёв усиливали друг друга. В результате получается детектор, который отслеживает мелкие автомобили и людей на нескольких масштабах, вместо того чтобы жертвовать ими ради скорости.

Более чёткие решения с меньшим числом настроек

Заключительный шаг — упрощение стадии предсказания, известной как detection head. В исходном дизайне более глубокие слои с большим количеством каналов в основном работали с крупными объектами, которые на сценах с дронов встречаются сравнительно редко. Новая голова Shared Re-parameterized Detection (SRepD) выравнивает число каналов между масштабами и использует хитрый приём в обучении: в процессе обучения несколько специализированных свёрточных ветвей исследуют разные способы выделения признаков; на этапе инференса эти ветви математически объединяются в одну, простую свёртку. Такая разделяемая, репараметризованная конструкция улучшает качество слияния признаков, одновременно снижая число параметров и сохраняя вычислительную нагрузку приемлемой для edge‑устройств.

Что говорят числа в реальных испытаниях

Улучшенная модель протестирована на трёх сложных публичных наборах данных: VisDrone2019 (смешанные городские сцены), TinyPerson (очень маленькие люди на суше и на море) и HazyDet (транспортные средства в плотной дымке с точки зрения дрона). На VisDrone2019 новая архитектура повышает ключевую метрику точности (mAP50) и precision на 4,6 процентных пункта по сравнению с оригинальным YOLOv11n, при этом сокращая число параметров примерно на 8,5%. На TinyPerson улучшения ещё существеннее — около 5,9 процентных пункта в mAP50 и 5,6 в precision — с аналогичным сокращением параметров, а компактная модель даже превосходит гораздо более крупный YOLOv11s с четырёхкратным числом параметров. В условиях дымки модернизированный детектор также превосходит базовую модель по показателям точности и надёжности, при этом сохраняя работу в реальном времени на маломощной плате Huawei Atlas 200 DK.

Почему это важно для повседневного использования дронов

Для неспециалистов главный вывод таков: исследование демонстрирует, что дроны могут одновременно стать и зорче, и экономнее в использовании ресурсов. Переосмыслив, где и как сеть ищет детали, сохранив высокоразрешённую информацию для мелких целей и упростив механизм предсказания, авторы разрушают привычный компромисс между точностью и размером. В результате система лучше обнаруживает мелких, удалённых людей и транспорт в плотных, дымных или сложных сценах без требования громоздкого аппаратного обеспечения. Такой прогресс приближает надёжный мониторинг в реальном времени для безопасности движения, поисково‑спасательных операций и экологического наблюдения к повседневному применению.

Цитирование: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Ключевые слова: обнаружение объектов с дронов, распознавание мелких объектов, нейросеть YOLO, анализ аэрофотоснимков, edge AI для БПЛА