Clear Sky Science · ru

Точная сегментация подводных объектов в реальном времени с улучшенной двухдоменной YOLOv11-UOS, физически направленным адаптивным улучшением и усилением внимания

Глубже под водой с более острыми цифровыми глазами

Наши океаны исследуются все чаще не только дайверами и подводными аппаратами, но и интеллектуальными камерами, установленными на подводных роботах. Эти камеры помогают искать кораблекрушения, осматривать морские трубопроводы и мониторить рифы и популяции рыб. Однако подводные снимки часто мутные, сине‑зеленые и полны визуального шума, что затрудняет распознавание объектов даже человеку, не говоря уже о компьютере. В этой работе предложена новая система компьютерного зрения, которая сначала очищает подводные изображения, а затем быстро обнаруживает и обводит объекты на них, достаточно быстро для управления роботами в реальном времени.

Почему видеть под водой так сложно

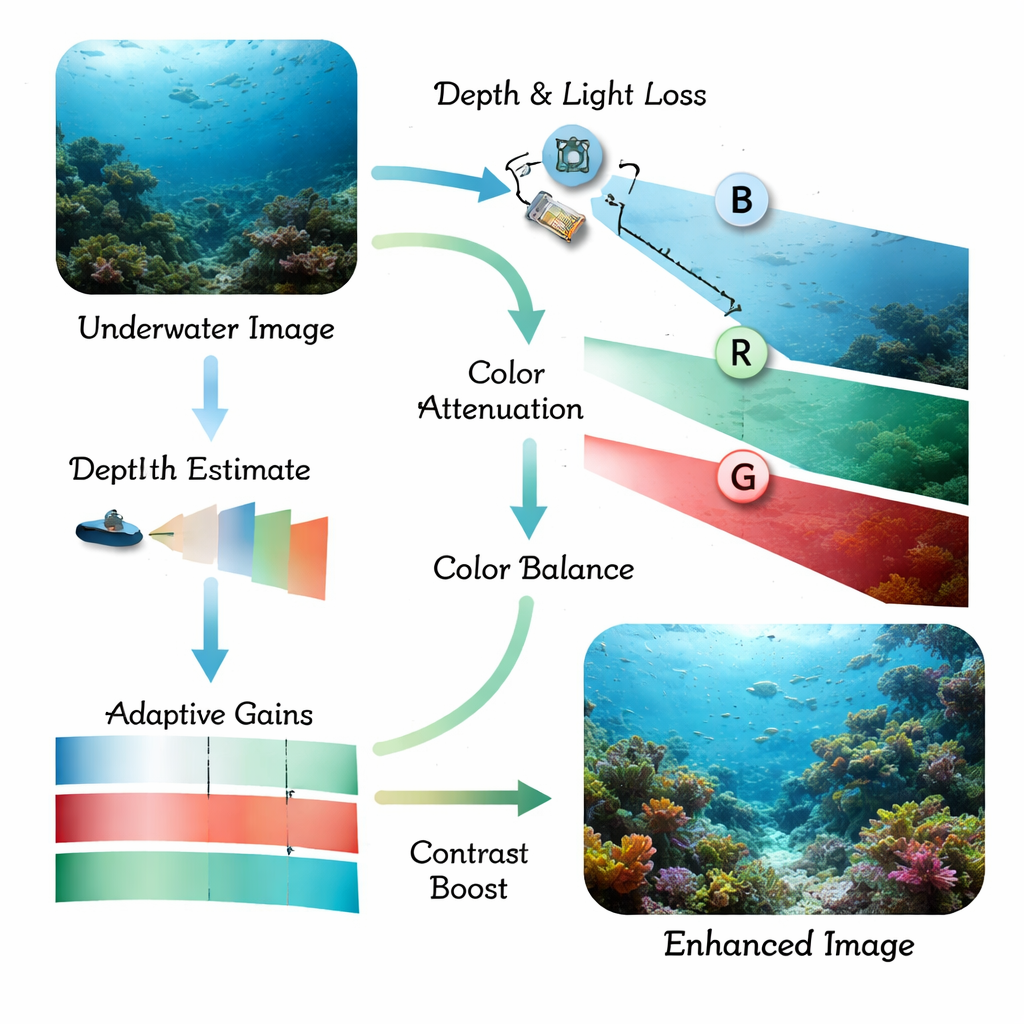

Свет ведет себя в воде совсем иначе, чем в воздухе. По мере того как солнечный свет проникает вниз, красные оттенки исчезают первыми, затем зеленые, оставаясь с голубоватым оттенком и низкой контрастностью сцены. Мельчайшие частицы в воде рассеивают свет, создавая дымку, которая размывает края и скрывает мелкие детали. Традиционные программы обнаружения объектов и даже современные модели глубокого обучения испытывают трудности с такими искаженными изображениями: рыбы сливаются с кораллами, искусственные конструкции теряются на фоне, а сцены при слабом освещении становятся почти нечитаемыми. Ранее исследования обычно решали либо задачу очистки изображений, либо задачу обнаружения объектов по отдельности, что часто делало систему слишком медленной, ненадежной или все еще бесполезной в особо мутной воде.

Двухэтапная стратегия: сначала очистка, затем фокус

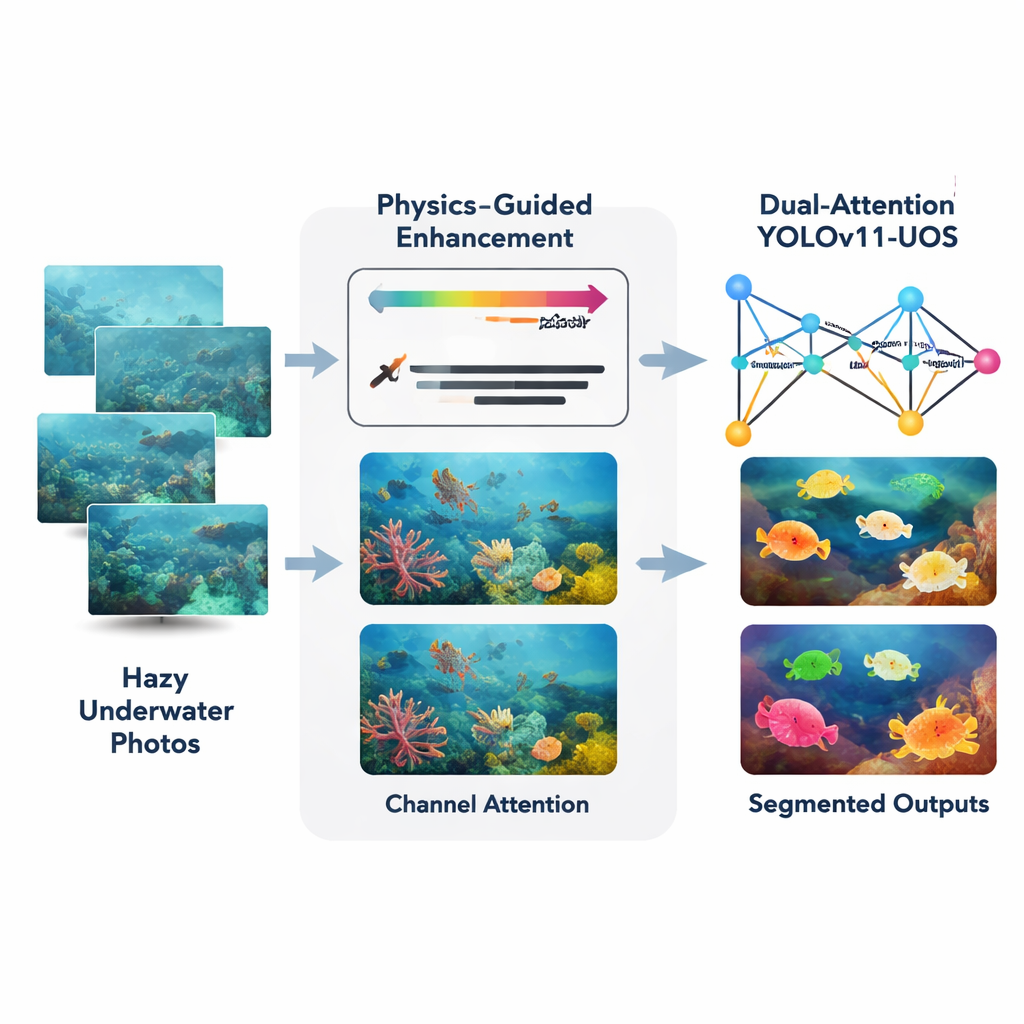

Авторы предлагают комбинированный подход, основанный на современном детекторе в реальном времени YOLOv11, адаптированном здесь для подводных сцен и инстанс‑сегментации (построения точного контура каждого объекта). Сначала фронтальный модуль под названием Адаптивное физически-направленное улучшение принимает сырые подводные фотографии и корректирует их с использованием упрощенной физической модели поглощения и рассеяния света в воде. Он оценивает, насколько удалена та или иная часть сцены от камеры, затем компенсирует более сильную потерю красного света по сравнению с зелеными и синими каналами. Это восстанавливает более натуральные цвета и повышает локальную контрастность, а тщательный гистограммный этап усиливает резкость краев без усиления шума, даже в темных или мутных областях.

Обучение сети, куда смотреть

После очистки изображение передается в усовершенствованный бэкенд YOLOv11, дополненный механизмами внимания. Эти добавленные модули работают как прожектор и цветовой фильтр. Пространственное внимание подсказывает сети, на какие области следует обращать больше внимания — например, на контур рыбы или край затопленного артефакта — и игнорировать отвлекающий фон вроде песка или колышущихся растений. Канальное внимание регулирует, с какой силой система учитывает различные цветовые и текстурные признаки, так что полезные визуальные сигналы выделяются, а несущественные — подавляются. В совокупности эти двойные стадии внимания помогают сети строить более четкие внутренние представления до того, как она решит, где находятся объекты и что они собой представляют.

Тестирование в реальных океанах и в сложных условиях

Чтобы проверить работу системы на практике, исследователи обучали и тестировали ее на нескольких публичных наборах подводных изображений, а также на новом собственном датасете более чем из 7000 тщательно размеченных фотографий прибрежных вод с разной глубиной и мутностью. Они измеряли стандартные метрики обнаружения и сегментации и сравнивали свой метод с широко используемыми моделями, такими как U‑Net, DeepLab, сегментеры на основе трансформеров и базовая система YOLOv11 без новых модулей. Комбинация улучшения изображения и внимания повысила среднюю точность обнаружения примерно на 6.5 процентных пункта по сравнению с базовой YOLOv11, при заметно более чистых контурах объектов и меньшем числе пропусков и ложных срабатываний. Важно, что система по‑прежнему работает примерно на 38 кадрах в секунду на современном графическом процессоре, что достаточно быстро для почти реального времени на роботизированных платформах.

Что это значит для океанических роботов и исследований

Проще говоря, исследование показывает, что умная предобработка и целенаправленное внимание позволяют компьютерам заметно лучше «видеть» под водой. Сначала частично обращая вспять физические эффекты, портящие подводные снимки, а затем направляя сеть обнаружения на наиболее информативные области и цвета, метод обеспечивает более четкие и надежные контуры рыб, кораллов и искусственных объектов. Это может помочь автономным подводным аппаратам безопасно ориентироваться, мониторить хрупкие морские экосистемы и инспектировать критическую подводную инфраструктуру без постоянного вмешательства человека. Проблемы сохраняются в крайне мутной воде или на большой глубине при нехватке красного света, но предложенная архитектура представляет практический шаг к устойчивому зрению в реальном времени, способному поддержать будущие 3D‑картографирование и многодатчиковые исследования океана.

Цитирование: Deluxni, N., Sudhakaran, P., Alroobaea, R. et al. An accurate realtime underwater object segmentation using improved dual-domain YOLOv11-UOS with physics guided adaptive enhancement and attention-boosting. Sci Rep 16, 4804 (2026). https://doi.org/10.1038/s41598-026-35001-x

Ключевые слова: подводное зрение, морская робототехника, улучшение изображений, сегментация объектов, компьютерное зрение