Clear Sky Science · ru

Исследование зависимости человека от искусственного интеллекта при принятии решений

Почему важно, доверяем ли мы умным машинам

От рекомендаций фильмов до отбора соискателей и уголовного правосудия — искусственный интеллект (ИИ) всё чаще помогает людям принимать решения. Многие из нас предполагают, что компьютеры менее предвзяты и точнее, чем люди. Но что на самом деле происходит, когда люди получают совет от системы ИИ — используют ли они его разумно или полагаются на него слишком сильно? В этом исследовании изучают, как люди реагируют на рекомендации ИИ по сравнению с советами других людей и что это значит для растущей роли ИИ в повседневных решениях.

Проверка реальных людей на реальных и фальшивых лицах

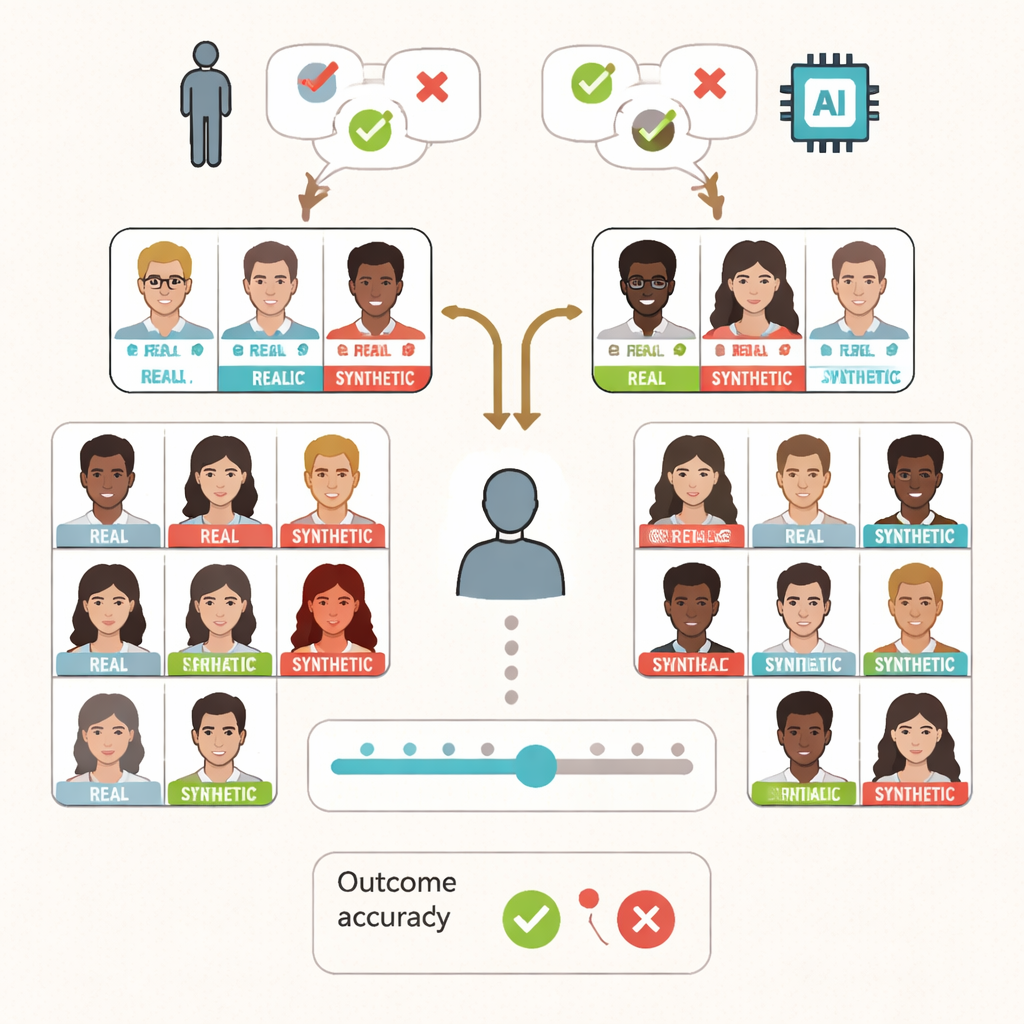

Исследователи попросили 295 взрослых выполнить, казалось бы, простую задачу: определить, является ли лицо на экране фотографией реального человека или сгенерированным ИИ фейком. Каждый участник увидел 80 лиц — половина реальных, половина синтетических — которые были тщательно отобраны в предыдущих работах так, чтобы большинство людей справлялось в основном правильно, но не идеально. Рядом с каждым лицом участники видели краткое указание, утверждающее, что лицо «реально» или «синтетическое». Им сообщили, что этот совет исходит либо от группы человеческих экспертов, либо от системы ИИ, хотя на самом деле все указания были заранее запрограммированы и оказывались верными только в половине случаев.

Использование советов, но не слепо

Ключевой вопрос заключался в том, будут ли люди просто следовать указаниям или думать самостоятельно. Результаты показывают, что участники не вели себя как пассивные нажиматели кнопок. Они гораздо больше полагались на совет, когда он был верен, и чаще игнорировали его, когда он был неверен, независимо от того, исходил ли он якобы от людей или от ИИ. Общая точность в распознавании реальных и синтетических лиц оставалась около двух третей правильных ответов — очень похоже на отдельную группу из предыдущего исследования, которая выполняла ту же задачу без какой-либо подсказки. Иными словами, присутствие «помощника» ИИ в среднем не улучшало и не разрушало производительность драматически.

Когда позитивное отношение к ИИ сказывается во вред

Однако под этими средними показателями выявилась более тонкая картина. Участники также заполняли опросы о том, насколько они в целом доверяют другим людям и каково их отношение к ИИ. Тех, кто имел более позитивное отношение к ИИ, на самом деле хуже справлялись с отличием реального от фальшивого при получении советов от ИИ. Они хуже различали настоящие и синтетические лица по сравнению с участниками, более осторожно настроенными или негативно относящимися к ИИ. Этот эффект не проявлялся, когда люди думали, что советы исходят от людей, что предполагает: советы ИИ могут по‑особенному формировать и иногда искажать наше принятие решений. Исследование также показало, что те, кто утверждал, что всегда полагается на советы, выступали хуже, чем те, кто говорил, что использует их лишь иногда или вовсе не использует.

Люди по‑прежнему принимают решения

Исследователи углубились в то, как люди уравновешивали собственное суждение и внешние подсказки. В среднем участники демонстрировали склонность помечать лица как реальные, и эта склонность немного усиливалась у тех, кто сообщал о большей склонности доверять другим людям. Тем не менее способ, которым люди использовали подсказки, выглядел «стратегическим»: они, по-видимому, обращались к ним особенно тогда, когда были менее уверены. Оценки уверенности сопоставлялись с результатами достаточно хорошо — когда люди чувствовали себя более уверенно, они в целом были точнее — что указывает на то, что участники имели разумное представление о том, когда они правы или ошибаются, даже с участием ИИ.

Что это значит для повседневных инструментов на базе ИИ

Для непрофессионального читателя ключевое послание в том, что ИИ не волшебным образом устраняет человеческие искажения и не автоматически подавляет наше суждение. Люди часто относятся к советам ИИ похоже на человеческие советы и могут игнорировать их, когда они кажутся бесполезными. Но когда кто‑то уже чрезвычайно положительно настроен к ИИ, он может более склонно полагаться на него так, что это снижает точность. По мере того как системы ИИ проникают в критически важные области, такие как здравоохранение, безопасность и правосудие, разработчикам и политикам придется учитывать эти человеческие тенденции. Это исследование предполагает, что эффективное использование ИИ зависит не только от лучших алгоритмов, но и от информированных людей, которые знают, когда доверять машине — и когда доверять себе.

Цитирование: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Ключевые слова: искусственный интеллект, человеческое принятие решений, доверие к ИИ, смещение в пользу автоматизации, лица-дипфейки