Clear Sky Science · ru

Надёжные оценки неопределённости в глубоком обучении с эффективными алгоритмами Метрополиса–Хастингса

Почему важно умнее оценивать неопределённость

От медицинских снимков до самоуправляемых автомобилей — современные системы ИИ часто принимают решения, в которых уверенная ошибка может быть опасной. Стандартные модели глубокого обучения отлично распознают шаблоны, но плохо сообщают, насколько они в этом уверены. В этой статье решается этот разрыв: предложены новые подходы, позволяющие снабдить глубокие нейронные сети надёжными мерами неопределённости, при этом сдерживая высокие вычислительные затраты традиционных байесовских методов.

От догадок к измеримой уверенности

В повседневном глубоком обучении модель обучают один раз и затем используют как есть. Она выдаёт единственное наилучшее предположение, но почти не даёт понимания, насколько этому предположению можно доверять. Байесовские нейронные сети идут другим путём: вместо фиксации единственного набора параметров они рассматривают параметры как случайные величины и пытаются описать целое распределение правдоподобных моделей. Усреднение предсказаний по этому множеству может показать как наиболее вероятный ответ, так и степень доверия модели к нему. Проблема в том, что точная выборка из этого распределения с помощью эталонных методов, таких как гамильтоновский MCMC, чрезвычайно затратна для современных крупных сетей и наборов данных.

Более быстрая сэмплинг без потери картины в целом

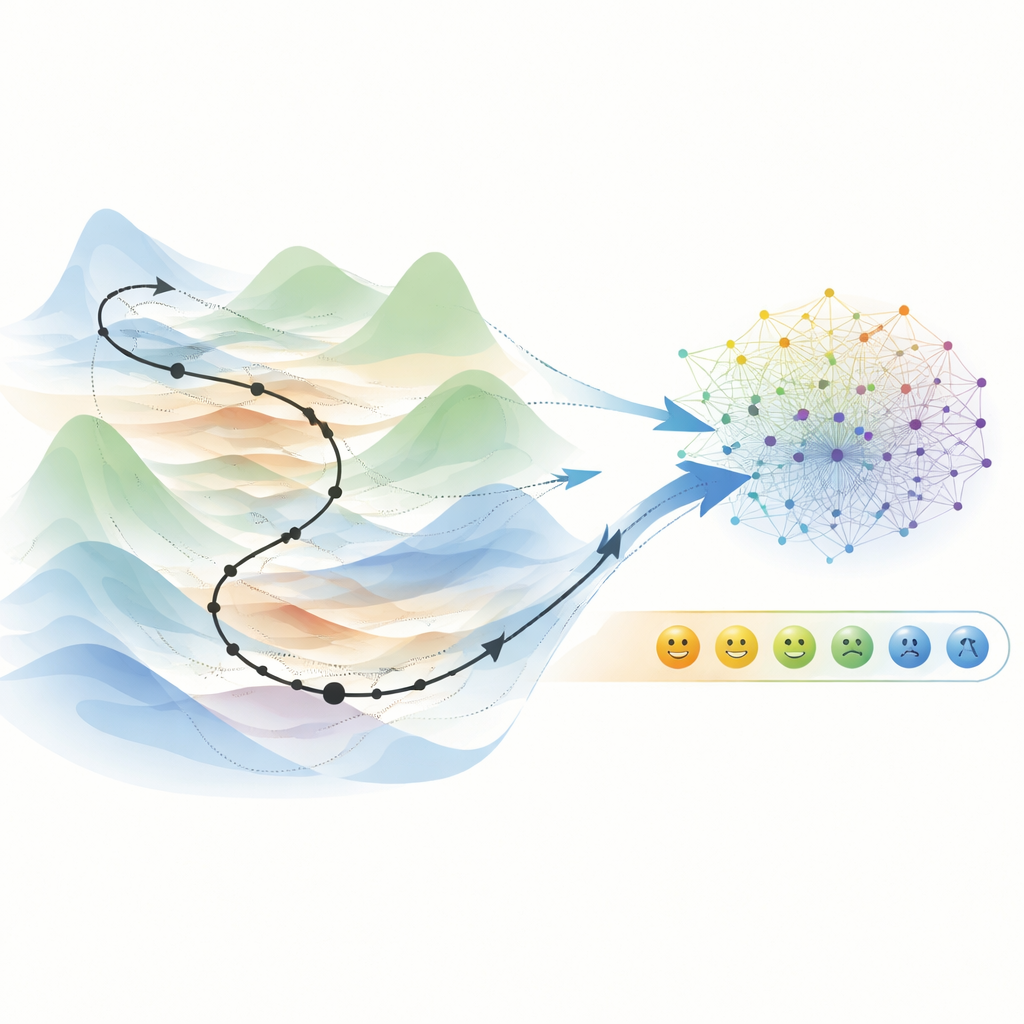

Авторы сосредотачиваются на семействе методов, называемых стохастическим градиентным гамильтоновским методом Монте-Карло, которые уже заимствуют идеи из стандартного обучения — минибатчи и зашумлённые градиенты — чтобы ускорить сэмплинг. Отсутствующим элементом является надёжный «фильтр», который решает, какие пробные обновления параметров сохранять. В классическом гамильтоновском MCMC эту роль выполняет шаг приёма по алгоритму Метрополиса–Хастингса, который корректирует численные ошибки и не даёт сэмплеру дрейфовать в неверные области. Внедрить этот шаг приёма в шумный мир минибатчей глубокого обучения трудно, поскольку он обычно требует оценок по всему датасету и может тормозить прогресс при слишком низких коэффициентах принятия.

Два новых способа исследовать ландшафт

В статье представлены две дополняющие друг друга стратегии. Первая, названная обобщённым стохастическим градиентным гамильтоновским MCMC (GSGHMC), разрабатывает тест приёма, который выполняется на минибатчах при сохранении важного свойства: истинные оптимумы всей задачи по-прежнему корректно распознаются. Для этого используется тщательно подобранный численный интегратор, чтобы шаги приёма оставались стабильными, несмотря на то, что на каждом шаге видна лишь часть данных. Это даёт эффективный сэмплер, близкий к истинной байесовской картине, который формирует ансамбли моделей с особенно хорошо калиброванными оценками уверенности.

Длинные траектории для лучших предсказаний

Второй метод, Ансамбль Гамильтоновых Траекторий (HTE), делает осознанный компромисс: вместо настойчивого требования точного байесовского поведения он отдаёт предпочтение длинным, управляемым импульсом прогулкам по пространству параметров, напоминающим агрессивные циклы обучения. В конце каждой такой траектории тест в стиле Метрополиса решает, сохранить ли полученный снимок модели. Поскольку эти пути склонны сходиться в широких, хорошо обобщающихся ложбинах ландшафта потерь, собранные модели образуют разнообразный, но сосредоточенный ансамбль. На задачах классификации изображений, таких как EMNIST и CIFAR-10, HTE повышает точность примерно до шести процентных пунктов по сравнению с сильными байесовскими базовыми методами, а также на несколько пунктов превосходит обычное детерминированное обучение, при этом предоставляя полезную информацию об неопределённости и хорошо обнаруживая выходящие за рамки распределения примеры.

Меньшие ансамбли, более разумное использование

Сэмплинг сотен или тысяч моделей выглядит дорогостоящим на этапе тестирования, поэтому авторы также исследуют, сколько членов ансамбля действительно необходимо. Поступая жадно и отбрасывая модели, мало влияющие на производительность, они обнаруживают, что примерно треть ансамбля часто можно сохранить без потери точности, хотя для очень точной калибровки обычно требуется больше членов. По задачам с изображениями и хаотичной задаче прогнозирования временных рядов их методы последовательно превосходят или соответствуют популярным альтернативам, таким как вариационный вывод, Monte Carlo dropout и более простые глубокие ансамбли, хотя требуют более высокой стоимости обучения по сравнению с обычным детерминированным обучением.

Что это значит для реального ИИ

Для неспециалиста главный вывод таков: мы можем сделать глубокое обучение не только точным, но и честным в вопросе того, чего оно не знает, без необходимости суперкомпьютерных ресурсов. Тщательно сочетая классические идеи сэмплинга с современным обучением на минибатчах, два предложенных подхода дают лучшие предсказания и более надёжные оценки уверенности, чем многие существующие методы. Это сочетание эффективности, устойчивости и калиброванной неопределённости — важный шаг к безопасному применению глубокого обучения в чувствительных областях, где цена чрезмерной уверенности измеряется не процентными пунктами, а жизнями.

Цитирование: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Ключевые слова: Байесовские нейронные сети, оценка неопределённости, Гамильтоновский метод Монте-Карло, ансамбли глубокого обучения, стохастический градиентный MCMC