Clear Sky Science · ru

Трансферное обучение в DeepLC улучшает предсказание времени удерживания в ЖХ по сильно различающимся модификациям и условиям

Почему важно предсказывать время химии

Каждый раз, когда учёные исследуют белки в наших клетках, они опираются на методику, в которой крошечные фрагменты белков — пептиды — сначала проходят через заполненную жидкостью колонку, а затем взвешиваются в масс-спектрометре. Насколько долго каждый пептид задерживается в колонке — его «время удерживания» — чрезвычайно информативно: это помогает исследователям распознавать и подтверждать то, что они измеряют. Но поскольку в каждой лаборатории используются немного разные приборы и настройки, компьютерные модели, предсказывающие эти времена, часто ломаются при переносе на другую установку. В этой статье показано, как современный приём машинного обучения — трансферное обучение — может сделать такие предсказания гораздо более надёжными и гибкими при многих экспериментальных условиях.

Отсчёт времени для фрагментов белков

В исследовании белков жидкостная хроматография в комбинации с масс-спектрометрией — это базовый метод. Этап жидкостной хроматографии разделяет тысячи пептидов по их химическим свойствам, чтобы они не приходили к детектору одновременно. Полученное время удерживания вместе с измеренной массой пептида даёт учёным мощный двумерный отпечаток. За последнее десятилетие исследователи обучили компьютерные модели предсказывать время удерживания прямо по последовательности пептида. Эти предсказания повышают уверенность в идентификации пептидов, помогают проектировать лучшие эксперименты и необходимы для формирования больших автоматически сгенерированных спектральных библиотек, используемых в современных высокопроизводительных рабочих процессах.

Проблема меняющихся условий в лаборатории

К сожалению, время удерживания очень чувствительно к таким деталям, как кислотность растворителя, материал колонки, давление и температура. Даже небольшие изменения могут переставить порядок, в котором пептиды выходят из колонки. Традиционные подходы пытаются решить это путём «калибровки» модели, обученной в другом месте, на небольшом наборе эталонных пептидов, предполагая, что относительный порядок выхода пептидов остаётся неизменным. Когда это предположение нарушается — например, при изменении химии колонки или pH пробы — калибровка может резко провалиться. Другой вариант — обучать совершенно новую модель для каждой настройки, но это требует большого числа хорошо измеренных пептидов, которые не всегда доступны, особенно для редких или необычных химических модификаций.

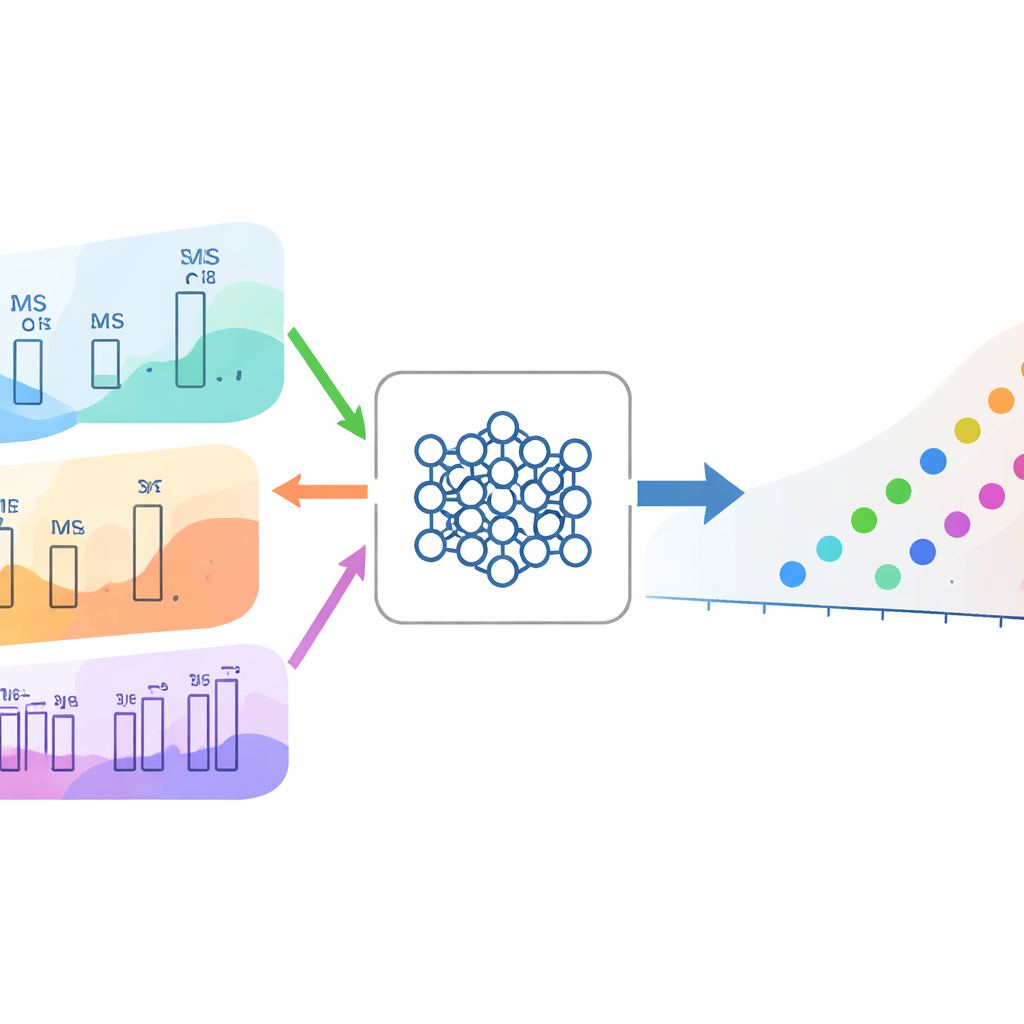

Повторное использование знаний с помощью трансферного обучения

Авторы опираются на DeepLC — модель глубокого обучения, которая уже предсказывает времена удерживания для многих типов пептидов. Вместо того чтобы начинать с нуля для каждой новой ситуации, они повторно используют модель, обученную на большом высококачественном наборе данных, и дообучают её на гораздо меньшей коллекции пептидов из новой установки. На 474 наборах данных, взятых из сотен публичных экспериментов, такая стратегия трансферного обучения практически всегда превосходит как простую калибровку, так и обучение новой модели с случайных начальных условий. При этом выигрыш особенно заметен, когда доступно лишь несколько сотен или тысяч обучающих пептидов — обычная ситуация в реальных исследованиях. Даже при большом числе примеров трансферное обучение, как правило, даёт чуть более высокую точность.

Работа с необычной химией и экстремальными условиями

Чтобы проверить пределы подхода, команда изучила очень сложные сценарии. В одном случае пептиды несли громоздкую химическую метку, делающую их гораздо более «жирными», что существенно смещает их времена удерживания. В другом случае раствор в колонке был щелочным, а не кислотным, что фундаментально меняет взаимодействие пептидов с колонкой. В обоих случаях простая калибровка старой модели проваливалась, и даже новая модель требовала многих примеров, чтобы достичь хорошей точности. Трансферное обучение, однако, адаптировалось быстро, достигая сопоставимой или лучшей производительности при в два–три раза меньшем числе обучающих пептидов. Метод также улучшал предсказания для широкого ряда посттрансляционных модификаций, которые не встречались в обучении, что указывает на то, что предшествующие знания модели о химии пептидов переносятся на новые модификации.

Что это означает для будущих исследований белков

Для неспециалистов главный вывод состоит в том, что повторное использование того, чему нейросеть уже научилась о поведении пептидов, значительно упрощает получение точных предсказаний времени удерживания в новых экспериментальных условиях. Вместо того чтобы трудоёмко собирать большие обучающие наборы или мириться с плохой работой простой калибровки, исследователи могут дообучать существующую модель DeepLC на скромном числе примеров и при этом получать высокоточные времена удерживания. Это делает передовые инструменты предсказания более надёжными и доступными, обеспечивая воспроизводимый анализ на разных приборах, при разных химических условиях и для редких модификаций пептидов, и в конечном счёте помогает учёным яснее и эффективнее прочитывать белковый мир.

Цитирование: Bouwmeester, R., Nameni, A., Declercq, A. et al. Transfer learning in DeepLC improves LC retention time prediction across substantially different modifications and setups. Nat Commun 17, 2601 (2026). https://doi.org/10.1038/s41467-026-68981-5

Ключевые слова: протеомика, жидкостная хроматография, предсказание времени удерживания, глубокое обучение, трансферное обучение