Clear Sky Science · ru

Рекуррентные связи облегчают распознавание закрытых объектов через объяснение-исключение

Как мозг видит то, чего нет

В повседневной жизни мы без усилий узнаём объекты, частично скрытые другими — кошку за занавеской, машину за деревом. В этой работе авторы задаются вопросом, как мозг и созданные по его образцу искусственные сети справляются с этой задачей. Они показывают, что схемы с обратными связями могут использовать информацию о перекрывающем объекте, чтобы мысленно «достроить» то, что за ним скрыто, выявляя ключевой приём, на который могла бы опираться наша визуальная система в условиях загромождённого и фрагментарного мира.

Почему скрытые объекты — сложная проблема

Когда объект частично закрыт, многие его обычные визуальные признаки отсутствуют или искажены. Простая прямопоточная визуальная система, где информация идёт прямо от глаз к центрам распознавания, вынуждена угадывать скрытый объект, опираясь лишь на видимые фрагменты. Биологические мозги, однако, наполнены рекуррентными связями — петлями, где более высокие области мозга возвращают сигналы к ранним. Давно предполагают, что такие петли помогают в сложных задачах вроде распознавания закрытых объектов, но было неясно, в чём именно их преимущество и как они меняют внутренние представления увиденного.

Испытание сетей, вдохновлённых мозгом

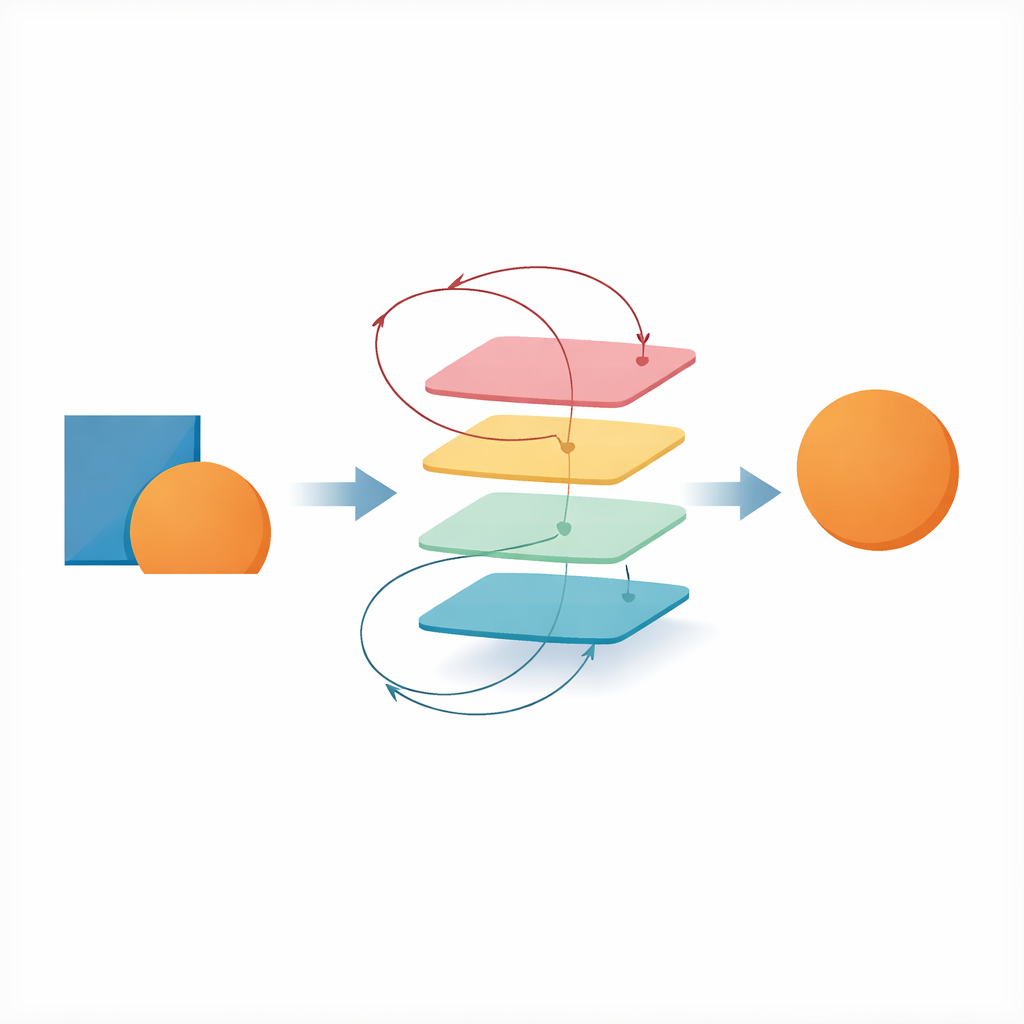

Авторы построили большую батарею глубоких сверточных сетей, имитирующих стадии визуальной обработки. Некоторые были чисто прямопоточными, другие — с рекуррентными петлями или дополнительной нисходящей обратной связью. Они обучили эти модели на специальных наборах изображений, где один предмет моды частично накрывал другой. Сетям нужно было определить как передний (закрывающий), так и задний (закрытый) объекты в разных настройках задач. Производительность зависела не столько от того, рекуррентна сеть или прямопоточная, сколько от её «вычислительной глубины» — числа последовательных шагов обработки, через которые проходит вход. Глубокие прямопоточные модели могли соперничать с рекуррентными или превосходить их в базовой задаче распознавания, показывая, что рекурренция сама по себе не даёт магического преимущества.

Особый приём: объяснение-исключение перекрывающего объекта

Хотя глубина имела решающее значение для сырой точности, рекуррентные сети продемонстрировали отличительную выгоду в том, как они использовали контекст. Когда у таких сетей сначала спрашивали определить передний объект, а затем уже скрытый, их точность по скрытому объекту улучшалась по сравнению с тем случаем, когда они классифицировали его сразу. Такой паттерн не наблюдался в обычных прямопоточных сетях, которые выдавали обе метки одновременно. Авторы интерпретируют это как «объяснение-исключение»: как только система распознала перекрывающий объект, она может считать странные, отсутствующие признаки на изображении вызванными именно этим перекрытием, а не свидетельством какого-то необычного нового объекта. В более реалистичных 3D-сценах и в модели, вдохновлённой приматами (CORnet), тот же порядок — сначала передний объект, затем скрытый — тоже улучшал распознавание.

Наблюдая тот же эффект у людей

Чтобы проверить, используют ли люди похожую стратегию, исследователи провели онлайн-эксперимент. Участники коротко видели одиночный предмет, затем сцену, где один объект закрывал другой, и в конце должны были выбрать, какой из двух вариантов был скрытым объектом. В некоторых испытаниях начальный одиночный предмет совпадал с последующим перекрывающим; в других он был не связан. Когда люди только что видели реальный перекрывающий объект, они точнее и быстрее определяли скрытый объект на разных уровнях перекрытия. Это указывает на то, что наш мозг, как и рекуррентные сети, выигрывает от того, что сначала обработает перекрывающий элемент, а затем использует эти знания для интерпретации фрагментарных улик о том, что находится за ним.

Воссоздание скрытых изображений «изнутри»

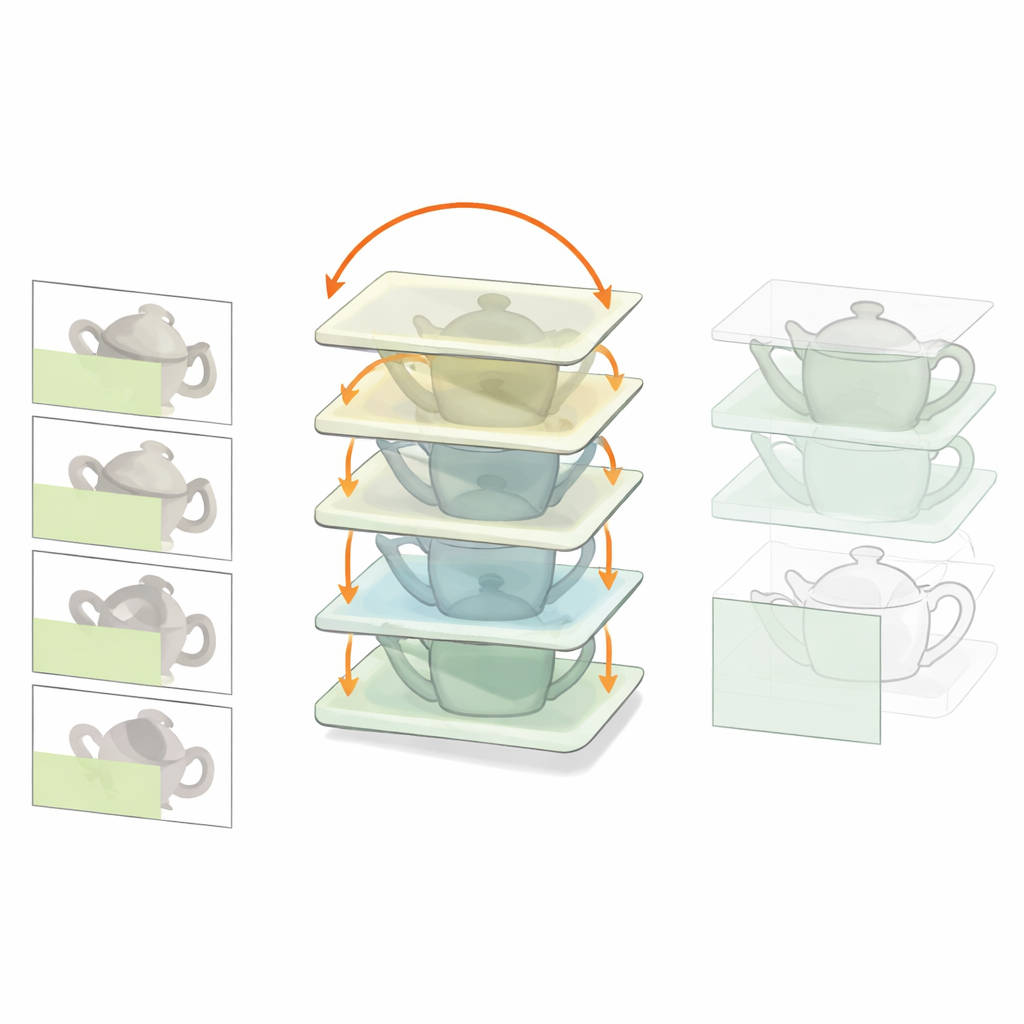

Чтобы глубже понять механизм, авторы спроектировали более биологически правдоподобную модель Recon-Net, отчасти основанную на взаимодействиях между зрительной корой и префронтальной корой. Recon-Net получает изображение с закрытым объектом и отдельный вид перекрывающего и итеративно преобразует внутреннее представление до тех пор, пока оно не станет соответствовать тому, как должен выглядеть незакрытый вариант скрытого объекта. Поразительно, что классификаторы, обученные только на чистых, незакрытых изображениях, смогли распознавать выходы Recon-Net почти так же хорошо, как если бы их обучали напрямую на закрытых примерах. Это означает, что рекуррентная обработка эффективно «восстанавливает» чистое внутреннее изображение скрытого объекта, несмотря на отсутствие пикселей.

Что это значит для мозга и машин

В целом исследование показывает, что обратные петли важны не столько для голой производительности, сколько как качественно другой способ использования контекста. Рекуррентные связи естественно поддерживают объяснение-исключение: они позволяют визуальной системе учитывать, как перекрывающий объект искажает увиденное, и восстанавливать стабильное внутреннее представление скрытого объекта. При этом авторы обнаружили, что обучение на сильно закрытых изображениях может не сильно менять реакции на чистые изображения, что потенциально облегчает обучение в реальных мозгах, избегая постоянной перестройки. Эти выводы указывают на общий принцип для нейронауки и искусственного интеллекта: когда мир скрывает информацию, умные системы не просто рассматривают ситуацию внимательнее — они выводят, почему она скрыта.

Цитирование: Kang, B., Midler, B., Chen, F. et al. Recurrent connections facilitate occluded object recognition by explaining-away. Nat Commun 17, 2225 (2026). https://doi.org/10.1038/s41467-026-68806-5

Ключевые слова: распознавание закрытых объектов, рекуррентные нейронные сети, визуальное восприятие, объяснение-исключение, вычислительная нейронаука