Clear Sky Science · ru

Мозаичная память больших языковых моделей

Почему важны почти‑совпадающие копии

Большие языковые модели, такие как ChatGPT, обучаются на океанах текста и иногда запоминают фрагменты этого текста. Это вызывает опасения по поводу приватности, авторских прав и корректности оценки реальных знаний таких систем. В этой работе показано, что запоминание — это не только точное копирование и вставка. Модели могут восстанавливать отрывки из множества слегка отличающихся версий, подобно сборке мозаики. Понимание этого скрытого типа памяти важно для всех, кто заботится о безопасном и надежном ИИ.

Новый взгляд на машинную память

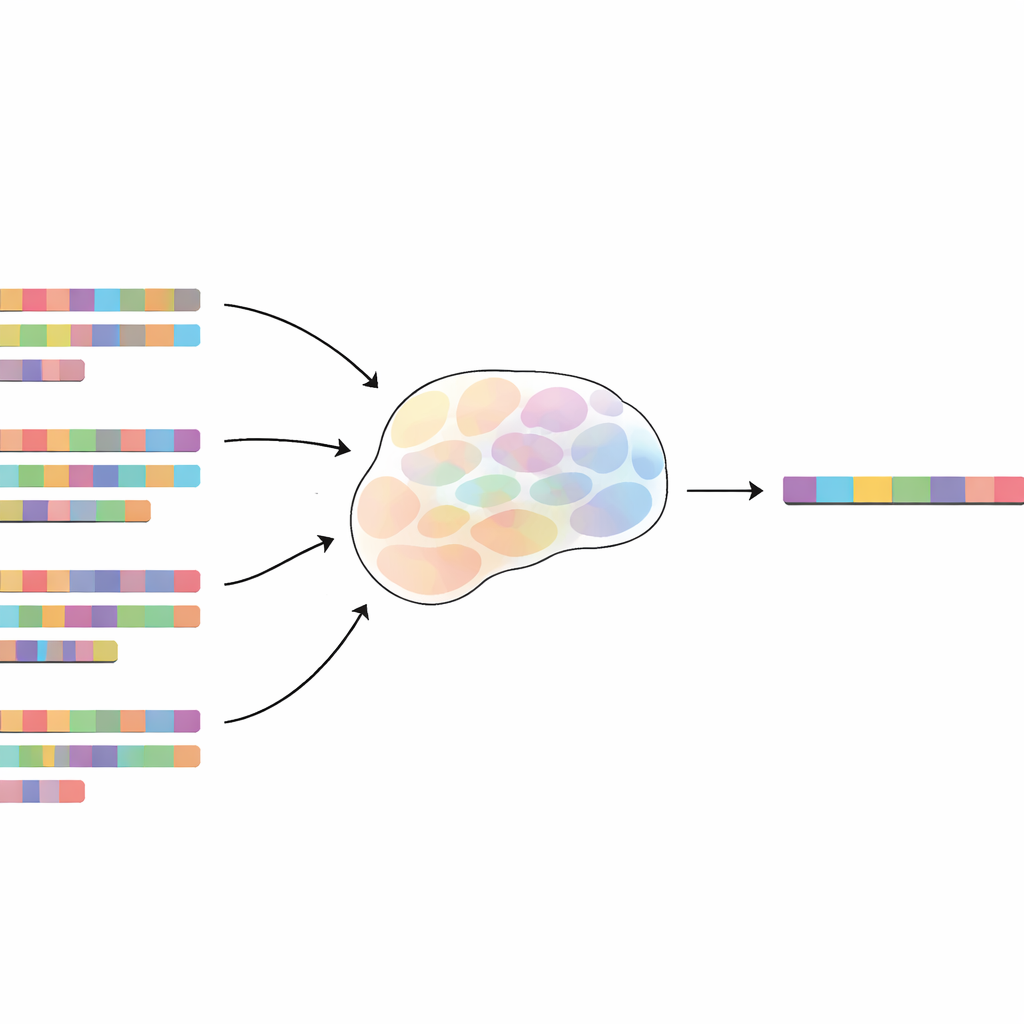

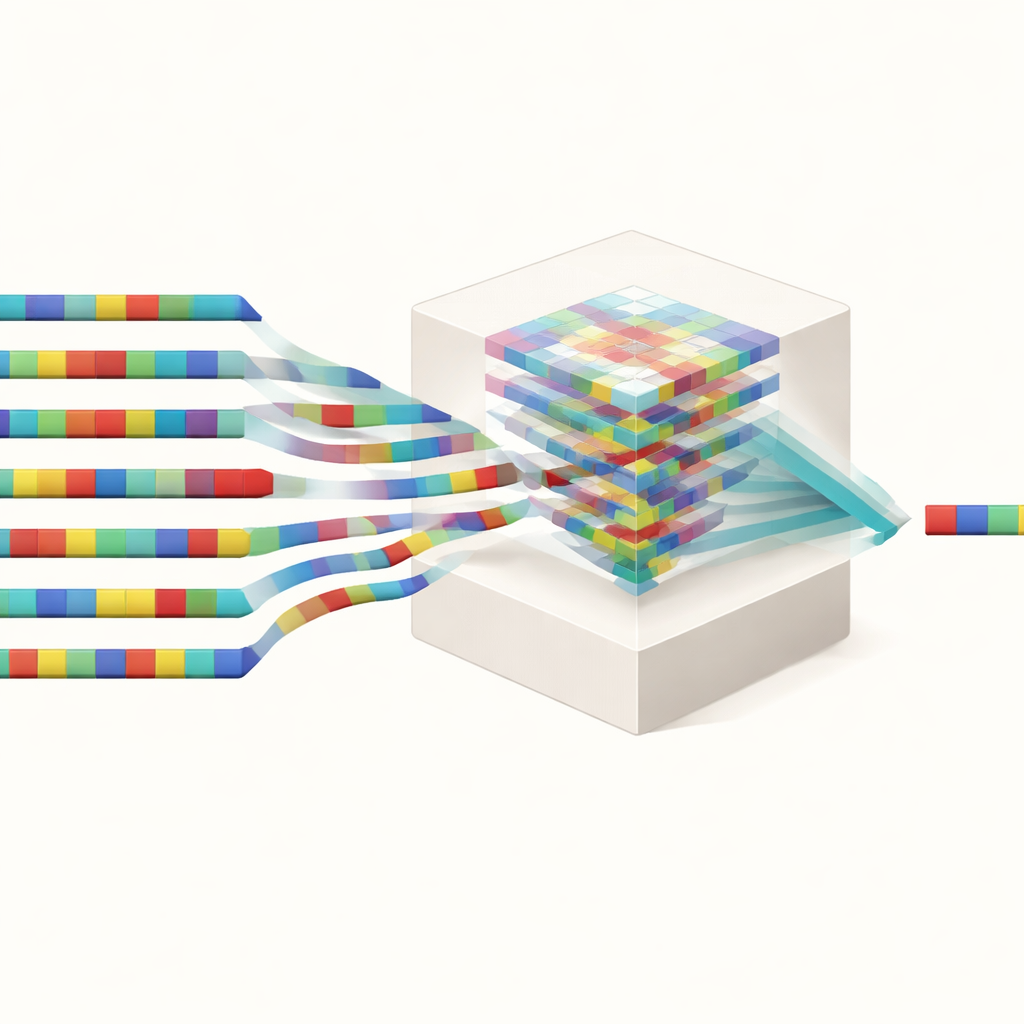

Большинство полагает, что модель запоминает нечто только если видит одну и ту же фразу много раз точно в таком виде. Авторы ставят под сомнение это представление, вводя понятие «мозаичной памяти». Согласно этому представлению, модель может запомнить 100‑словный отрывок не только из точных повторов, но и из множества неточных дубликатов — версий, где некоторые слова пропущены, изменены или перемешаны. Чтобы аккуратно изучить это явление, они внедряют искусственные тестовые фразы, названные канарейками, в обучающие данные модели вместе с множеством изменённых вариантов. После обучения они измеряют, насколько легко определить, была ли данная канарейка в обучающем наборе, с помощью теста приватности, называемого атакой на определение членства.

Как неточные копии всё равно оставляют ясный след

Сравнивая неточные дубликаты с точными повторами, исследователи вводят понятие «эквивалента точного дубликата»: какое вклад одной неточной копии в запоминание по сравнению с идеальной копией. Они обнаруживают, что даже очень лёгкие изменения почти не ослабляют запоминание. Если в каждом дубликате случайно заменяется примерно 10% слов, одна такая неточная копия всё ещё даёт примерно 60–65% эффекта точного дубликата. Даже при замене половины слов каждая изменённая версия по‑прежнему эквивалентна примерно 15–20% полной копии. Эффект устойчив: добавление случайных вставок между ключевыми фразами или перемешивание фрагментов предложения снижает запоминание, но не устраняет его. Похоже, модель умеет пропускать шум, фокусироваться на пересекающихся фрагментах и сшивать их вместе.

Форма важнее смысла в том, что модели хранят

Учитывая, что современные языковые модели умеют решать задачи по математике, следовать инструкциям и переводить между языками, можно было бы ожидать, что их память ориентирована на смысл. Удивительно, но исследование показывает обратное. Когда авторы заменяют слова на альтернативы, сохраняющие смысл предложения, запоминание улучшается лишь слегка по сравнению с заменой на случайные слова. Парафразы, сгенерированные другими ИИ — которые сохраняют идею, но меняют многие поверхностные детали — вносят относительно небольшой вклад в запоминание, если только они не разделяют множество коротких последовательностей токенов с исходным текстом. В серии тестов действительно определяющим фактором для памяти является совпадение точных токенов (базовых словоформ модели), а не общая идея. Иными словами, мозаичная память модели в основном про форму, а не про смысл.

Скрытые дубликаты в реальных обучающих данных

Затем авторы спрашивают, насколько распространены неточные дубликаты в популярном, тщательно очищенном веб‑наборе данных для обучения моделей, известном как SlimPajama. Хотя в этом датасете уже удаляли почти идентичные документы, команда находит, что многие 100‑токенные последовательности, которые встречаются ровно 1000 раз, также имеют тысячи почти‑совпадающих версий. Для небольших расстояний редактирования — примерно 10% изменённых символов — в среднем таких неточных дубликатов примерно в 4 раза больше, чем точных, и десятки тысяч дополнительных при больших, но всё ещё значимых расстояниях. Важно, что стандартные техники «удаления дубликатов», используемые в индустрии и обычно устраняющие только длинные точные совпадения, оставляют большинство этих неточных копий нетронутыми. Это означает, что модели всё ещё могут запоминать чувствительный или охраняемый авторским правом материал, собирая его по кусочкам из множества слегка изменённых источников.

Почему это важно для приватности, справедливости и контроля

Эти результаты имеют широкие последствия. С точки зрения приватности они показывают, что простого удаления точных повторов из обучающих данных недостаточно: личная или конфиденциальная информация может быть запомнена через семейства схожих отрывков. В контексте авторских прав и бенчмарков неточные дубликаты могут привести к воспроизведению защищённого текста или искусственному повышению результатов на тестах, которые модель фактически видела в замаскированной форме. Для попыток «разучить» конкретные данные недостаточно удалить один проблемный пример, если остаётся множество его вариантов. В целом работа показывает, что память языковых моделей — это сложная мозаика, собранная из множества небольших пересечений, что ставит под сомнение современные инструменты безопасности и требует более тонких методов очистки и аудита обучающих данных.

Цитирование: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Ключевые слова: запоминание языковой моделью, неточные дубликаты, конфиденциальность данных, удаление дубликатов в обучающих данных, контаминация бенчмарков