Clear Sky Science · pt

Copiloto cirúrgico RARP: um modelo de visão e linguagem para prostatectomia radical assistida por robô

Ajuda mais inteligente na sala de cirurgia

A cirurgia moderna do câncer de próstata é realizada com robôs e câmeras sofisticadas, ainda que os cirurgiões precisem lidar com decisões complexas, vistas que mudam rapidamente e perguntas constantes de residentes e equipe. Este artigo apresenta um “copiloto” de inteligência artificial que pode assistir ao vídeo cirúrgico em tempo real e responder a perguntas faladas no momento, como um assistente altamente conhecedor. Para os pacientes, isso aponta para operações mais seguras e consistentes; para os cirurgiões, sugere um futuro em que orientação especializada e ensino estejam disponíveis em toda sala de cirurgia.

Um assistente digital que pode ver e falar

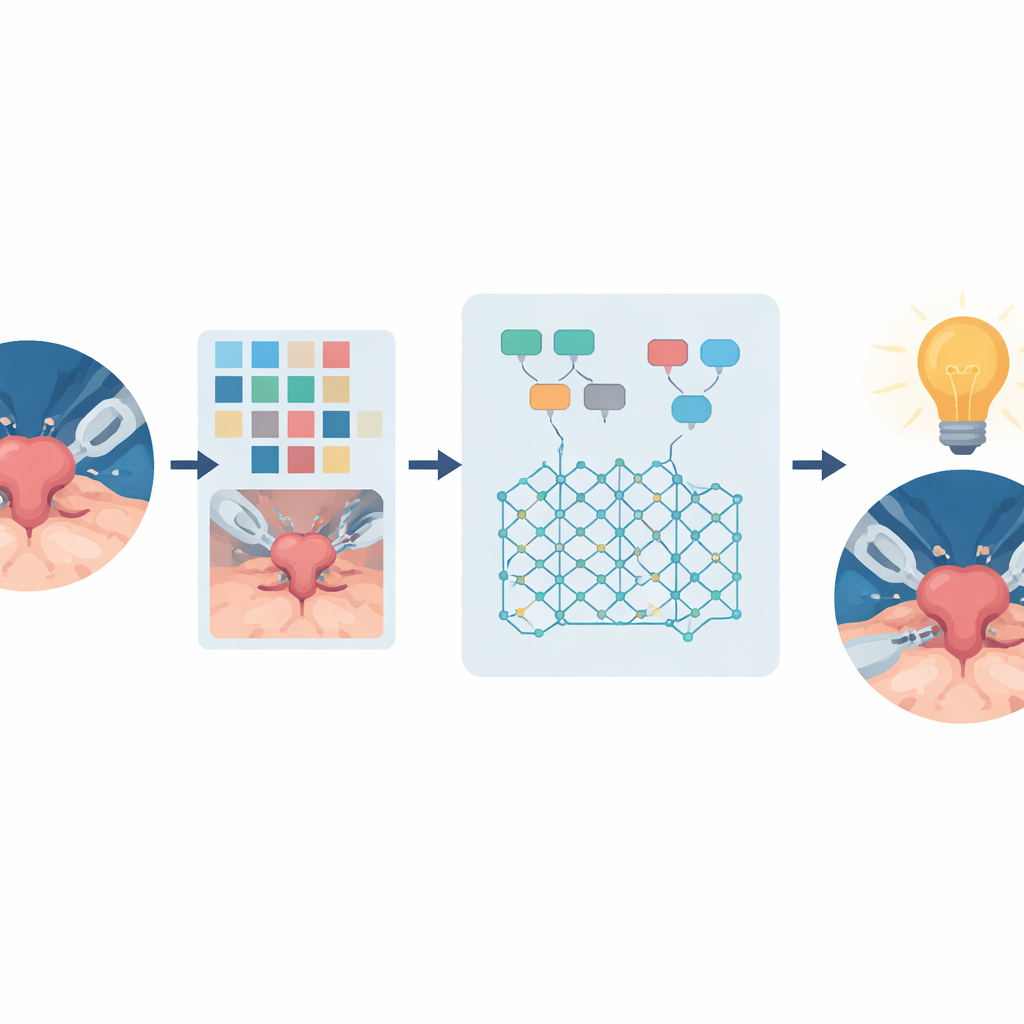

Os pesquisadores construíram o Surgical RARP Copilot para uma operação específica: a prostatectomia radical assistida por robô, a cirurgia padrão para muitos homens com câncer de próstata localizado. Nesse procedimento, um sistema robótico controlado pelo cirurgião remove a próstata por pequenas incisões, guiado por uma câmera em alta definição dentro do corpo. Sistemas de IA baseados apenas em texto não conseguem interpretar o que a câmera cirúrgica mostra. O Copilot, em vez disso, combina visão computacional com um grande modelo de linguagem, permitindo que “veja” o campo operatório e gere respostas em linguagem natural sobre o que está acontecendo, quais instrumentos estão à vista ou quais devem ser os próximos passos da operação.

Ensinando o conhecimento cirúrgico ao Copilot

Para dotar o Copilot de expertise cirúrgica relevante, a equipe montou um conjunto de dados de treinamento especializado em vez de depender de imagens gerais da internet. Reuniram quase 20.000 quadros rotulados de operações de próstata gravadas, marcando as posições de instrumentos, órgãos e a etapa corrente do procedimento. Também adicionaram informação de profundidade aproximada, para que o sistema pudesse inferir quais objetos estão à frente ou em contato entre si. Usando regras projetadas por especialistas, essas marcações foram convertidas em legendas detalhadas descrevendo o que cada quadro mostrava e em que ponto da operação ele ocorria. Grandes modelos de linguagem foram então solicitados, na voz de diferentes “personas” — de cirurgiões seniores a crianças curiosas — para gerar mais de um milhão de pares de pergunta–resposta baseados nessas legendas. Um modelo separado verificou esses pares quanto à consistência lógica, e exemplos com falhas foram filtrados antes do treinamento.

Desempenho do Copilot

Uma vez treinado, o Copilot foi testado de várias maneiras. Em um conjunto reservado de pares sintéticos pergunta–resposta, o ajuste fino aumentou a capacidade do modelo de fornecer respostas pelo menos parcialmente corretas de cerca de 61% para 83%, e respostas totalmente corretas de 0% para 59%. Revisores humanos então fizeram 650 perguntas sobre imagens cirúrgicas pré-gravadas; quase sete em cada dez respostas foram julgadas totalmente corretas. O sistema também resolveu tarefas clássicas de visão computacional sem re-treinamento adicional: identificou qual etapa da prostatectomia estava em andamento a partir de um único quadro de vídeo com 82% de acurácia e reconheceu instrumentos cirúrgicos com F1-score de 94%, além de estimar quanto tempo restava na operação. Esses resultados sugerem que um modelo único e unificado pode igualar ferramentas especializadas em múltiplas tarefas ao mesmo tempo em que participa de conversas abertas.

Colocando a IA em uma operação ao vivo

A demonstração mais marcante ocorreu em uma sala de cirurgia real. O Copilot foi implantado em um robusto computador de borda ligado diretamente ao feed de vídeo da cirurgia robótica. Durante uma prostatectomia ao vivo realizada em uma plataforma robótica diferente da usada no treinamento, uma plateia de cirurgiões e engenheiros submeteu 276 perguntas via smartphones. Após filtrar consultas irrelevantes e duplicadas, especialistas julgaram que o Copilot respondeu corretamente cerca de 77% das perguntas restantes — comparável ao seu desempenho offline. O sistema respondeu em cerca de meio segundo antes de iniciar a fala e produziu texto rápido o bastante para parecer interativo, tudo isso aplicando filtros de segurança e comportamento conservador quando havia incerteza.

O que isso significa para a cirurgia futura

Para leitores leigos, a mensagem principal é que um sistema de IA agora pode assistir a uma delicada operação oncológica em tempo real e fornecer respostas úteis e contextuais sobre o que está acontecendo e o que deveria acontecer em seguida. Embora o Copilot atual esteja limitado a um tipo de cirurgia, dependa de instantâneos em vez de memória de vídeo completa e ainda não acesse prontuários médicos inteiros, ele demonstra que IA multimodal pode ser levada com segurança à sala de cirurgia. Conforme sistemas semelhantes se expandirem para mais procedimentos, forem conectados a dados de pacientes mais completos e rigorosamente testados quanto ao impacto clínico, poderão apoiar o treinamento, melhorar a comunicação da equipe e, em última análise, ajudar a tornar a cirurgia complexa mais segura e transparente.

Citação: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Palavras-chave: cirurgia robótica, câncer de próstata, IA cirúrgica, modelo de visão e linguagem, assistência em sala de cirurgia