Clear Sky Science · pt

Detecção de comportamento de bovinos por vídeo para desenvolvimento de gêmeo digital em sistemas de precisão para laticínios

Por que observar vacas importa

Em fazendas leiteiras modernas, saber o que cada vaca está fazendo — comendo, descansando, bebendo ou ruminando — está diretamente ligado à produção de leite, à saúde e ao bem‑estar. Ainda assim, os produtores raramente têm tempo para vigiar todos os animais 24 horas por dia. Este estudo mostra como câmeras comuns do galpão, combinadas com visão computacional avançada, podem rastrear automaticamente a rotina diária das vacas e alimentar um “gêmeo virtual” digital do rebanho. Tais sistemas podem ajudar os produtores a ajustar a nutrição, detectar doenças mais cedo e gerir o rebanho de forma mais eficiente, tudo isso sem precisar fixar dispositivos nos animais.

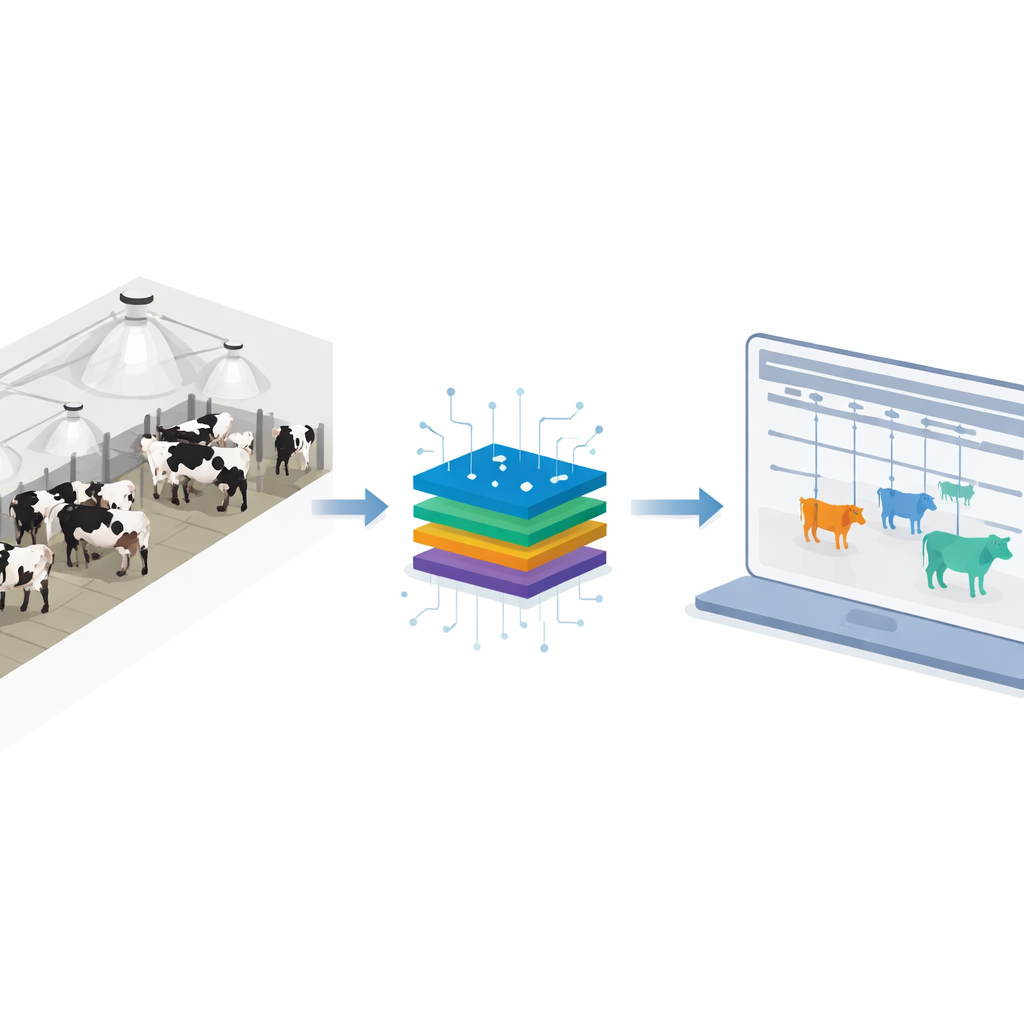

Do galpão real ao rebanho virtual

Os pesquisadores propuseram construir os “olhos e ouvidos” comportamentais para um gêmeo digital de laticínios — um modelo virtual de um galpão e suas vacas que se atualiza quase em tempo real. Focaram em sete atividades cotidianas que mais importam para a saúde e a produção: em pé, deitado, alimentando‑se em pé, alimentando‑se deitado, bebendo e ruminando (mastigando o bolo alimentar) tanto em pé quanto deitado. Em vez de depender de sensores vestíveis, usaram câmeras de segurança instaladas de cima e em ângulo em um galpão comercial do tipo baias fixas com cerca de 80 vacas Holandesas. Vídeo contínuo foi transformado em clipes curtos de 10 segundos centrados em vacas individuais, formando o material bruto para ensinar computadores a reconhecer o que cada animal estava fazendo.

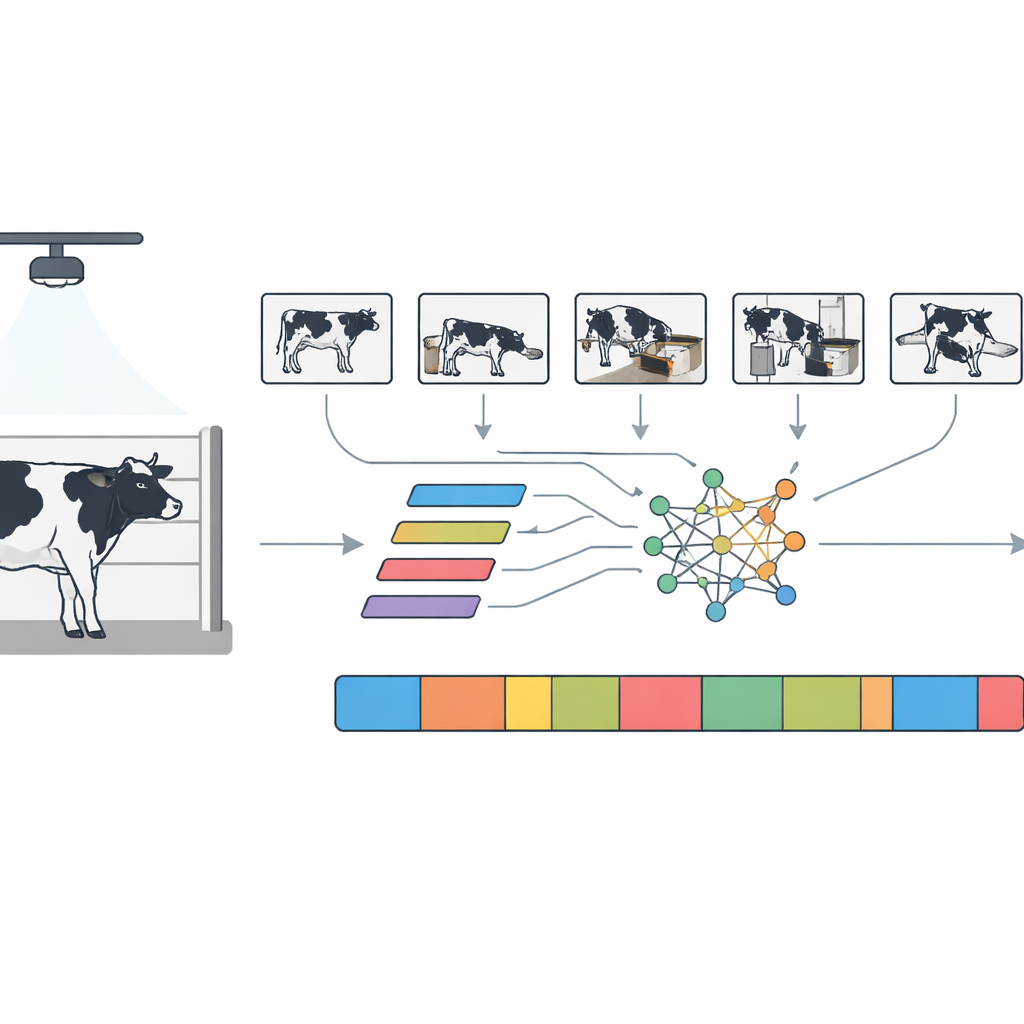

Ensinando computadores a reconhecer comportamento bovino

Converter as filmagens brutas em dados úteis exigiu várias etapas. Primeiro, um sistema de detecção de objetos encontrou automaticamente as vacas em cada quadro, e um algoritmo de rastreamento manteve a identidade de cada vaca consistente à medida que ela se movia, mesmo quando parcialmente oculta. O programa então recortou e redimensionou cada vaca em clipes de vídeo padronizados. Especialistas humanos rotularam quase 5.000 desses clipes com o comportamento correto, usando regras visuais claras e revisando o trabalho uns dos outros para garantir consistência. Como as vacas naturalmente passam mais tempo deitadas e em pé do que bebendo ou ruminando, a equipe expandiu cuidadosamente os comportamentos mais raros com “aumento” digital — flips sutis, recortes, ajustes de brilho e variações de tempo — para criar um conjunto de treinamento mais equilibrado de cerca de 9.600 clipes.

Como o sistema vê padrões ao longo do tempo

Para identificar comportamentos, a equipe comparou duas famílias líderes de modelos de análise de vídeo. Uma, chamada SlowFast, imita duas velocidades de visualização ao mesmo tempo: uma via “lenta” que percebe a postura em trechos mais longos e uma via “rápida” que foca em movimentos rápidos da cabeça. A outra, TimeSformer, usa mecanismos de atenção originalmente desenvolvidos para modelos de linguagem para analisar espaço e tempo, decidindo quais partes de cada quadro e quais momentos no clipe são mais importantes. Quando treinado com os vídeos do galpão, o TimeSformer teve desempenho ligeiramente superior ao do SlowFast, classificando comportamentos corretamente em cerca de 85% das vezes e rápido o suficiente para uso em tempo real em uma única placa gráfica moderna. Visualizações mostraram que o modelo naturalmente se concentrava na cabeça e no focinho durante a alimentação e a bebida, e no torso e nas pernas para deitado ou em pé, correspondendo ao que um observador humano usaria para julgar o comportamento.

De fluxos de comportamento a decisões na fazenda

Uma vez que o sistema conseguia reconhecer comportamentos clipe a clipe, os pesquisadores construíram um pipeline completo que roda continuamente sobre o vídeo do galpão. O programa acompanha cada vaca ao longo do tempo, aplica uma janela deslizante ao vídeo e suaviza falhas momentâneas para que pequenos glitches não apareçam como mudanças rápidas de estado. O resultado é uma linha do tempo limpa para cada animal: quando ela estava alimentando‑se, deitada, em pé, bebendo ou ruminando, junto com quanto tempo cada episódio durou e quão confiante o sistema estava. Esses registros estruturados podem ser lidos diretamente por modelos nutricionais da fazenda que estimam a ingestão de ração a partir do tempo de alimentação, e podem alimentar um gêmeo digital 3D em um ambiente tipo jogo que mostra vacas virtuais espelhando as ações de suas contrapartes reais. Em um estudo de caso de 24 horas com uma vaca, o sistema reconstruiu seu dia completo de atividades e usou a duração da alimentação mais informações básicas do animal para estimar quanto concentrado seco ela provavelmente consumiu.

O que isso significa para fazendas leiteiras futuras

O estudo demonstra que câmeras baratas e modelos de vídeo bem projetados podem fornecer registros contínuos de comportamento por vaca, precisos o suficiente para servir como camada sensorial de um gêmeo digital de laticínios. Embora o trabalho ainda não automatize decisões — como trocar rações ou alertar a equipe sobre doenças —, ele fornece o fluxo de entrada crucial do qual essas ferramentas de nível superior dependem. À medida que a abordagem for estendida para projetos de galpões mais abertos e combinada com outros sensores, os produtores poderão obter uma visão detalhada e sempre ativa dos ritmos diários de seus animais, permitindo uma gestão mais suave e precisa que beneficia tanto as vacas quanto o meio ambiente.

Citação: Rao, S., Garcia, E. & Neethirajan, S. Video-based cattle behaviour detection for digital twin development in precision dairy systems. npj Vet. Sci. 1, 3 (2026). https://doi.org/10.1038/s44433-026-00004-x

Palavras-chave: pecuária de precisão, visão computacional, comportamento de bovinos leiteiros, gêmeo digital, monitoramento do bem‑estar animal