Clear Sky Science · pt

Rumo a sistemas autônomos de manejo de plantas daninhas em canaviais e uma avaliação da prontidão tecnológica

Combater plantas daninhas sem inundar as lavouras de químicos

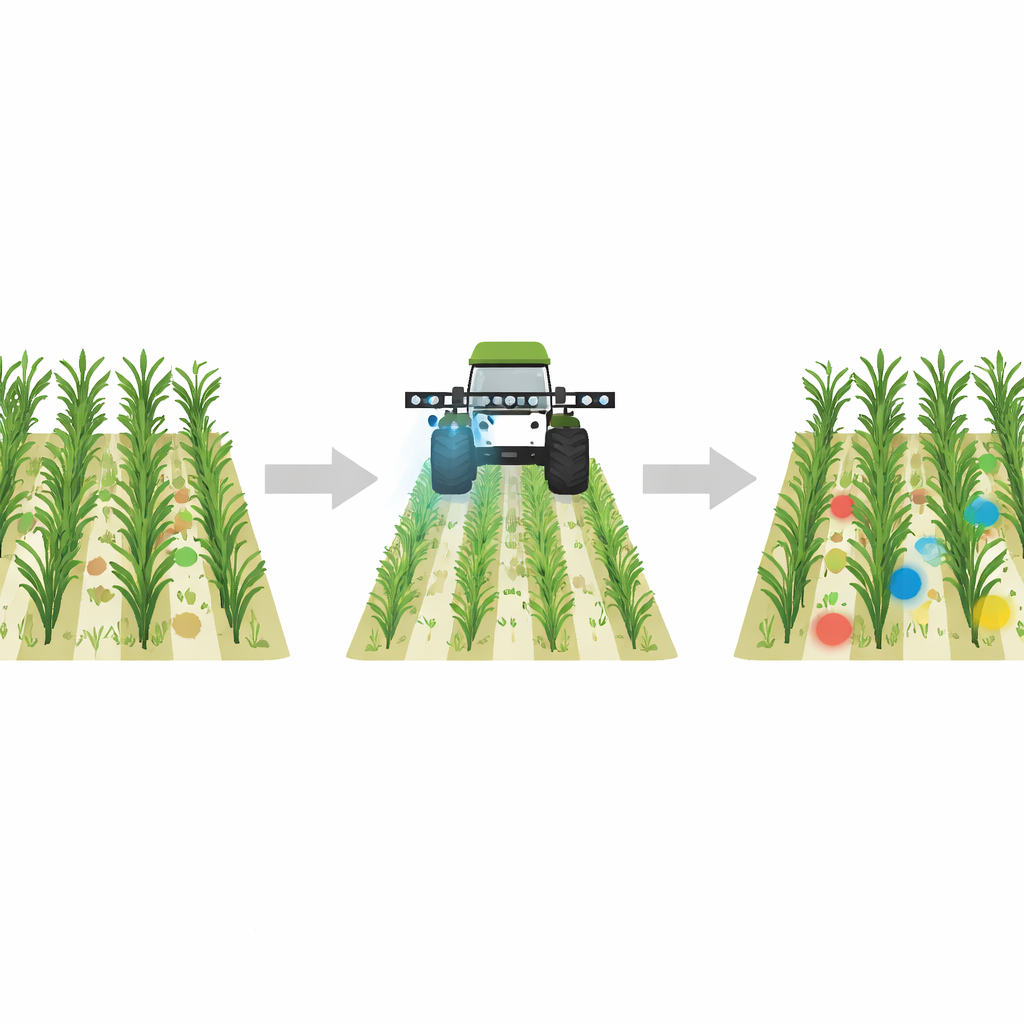

As plantas daninhas são os convidados indesejados da agricultura, roubando água, luz e nutrientes das culturas. Na cana-de-açúcar, uma cultura-chave para açúcar e bioenergia, esses oportunistas podem reduzir a produtividade em um terço e levar os produtores a pulverizar grandes quantidades de herbicidas por campos inteiros. Este artigo explora se a inteligência artificial moderna pode dar aos tratores "olhos" — câmeras inteligentes que detectam em tempo real as plantas daninhas que crescem entre a cana — para que os químicos sejam aplicados somente onde realmente necessário.

Por que os canaviais são especialmente desafiadores

Muitos sistemas de IA recentes já conseguem distinguir culturas de plantas daninhas quando as plantas se destacam claramente contra solo descoberto ou quando as imagens são feitas de cima. Mas os canaviais apresentam um quebra-cabeça mais difícil. A cana é uma gramínea perene e alta; suas folhas e colmos se parecem muito com várias daninhas gramíneas, e ambas crescem como um tapete denso e emaranhado de verde. Em vez de cenas simples de verde sobre marrom, a câmera vê verde sobre verde, com folhas sobrepostas, luz variável, poeira, lama e chuva. Estudos anteriores usaram majoritariamente imagens de drones ou parcelas experimentais organizadas, onde as daninhas estavam visualmente separadas da cultura. Os autores argumentam que isso não reflete a realidade desordenada que os agricultores enfrentam e que é necessário um referencial mais realista.

Uma nova visão realista das daninhas na cana

Para enfrentar essa lacuna, a equipe construiu um novo conjunto de dados a partir de canaviais na Louisiana usando uma câmera ao nível do solo, mantida cerca da altura do peito, imitando um sensor montado em trator ou pulverizador. Eles coletaram mais de duas mil imagens em alta resolução e as agruparam em três tipos de cena: apenas cana, apenas daninhas e cenas mistas onde ambos aparecem. Para um subconjunto das imagens mistas mais desafiadoras, especialistas em plantas daninhas desenharam retângulos em torno dos maciços de ervas para que os modelos computacionais pudessem aprender onde, e não apenas se, as daninhas estão presentes. Crucialmente, as imagens capturam condições realistas: muitos brotos pequenos, daninhas entrelaçadas com a cana e amplas manchas de crescimento de daninhas, frequentemente com limites visuais pouco claros mesmo para anotadores humanos.

O que a IA atual pode e não pode fazer

Os pesquisadores então testaram modelos de aprendizado profundo de ponta em três tarefas. Primeiro, na classificação simples ao nível da cena — decidir se uma imagem mostra cana, daninhas ou ambos — as redes modernas tiveram desempenho excelente, com os melhores modelos baseados em transformers alcançando cerca de 99% de acurácia. Isso significa que, em termos gerais, a IA pode identificar com fiabilidade quando há daninhas em uma imagem de canavial. Segundo, eles avaliaram a detecção de objetos, em que os modelos precisam desenhar caixas em torno de agregados individuais de daninhas. Aqui, o desempenho caiu drasticamente: seu melhor detector, uma rede convolucional moderna chamada RTMDeT com backbone ConvNeXt e uma função de perda sensível à geometria, alcançou uma pontuação AP50 de 44,2, muito distante do necessário para pulverização automática confiável. Eles também constataram que simplesmente aumentar a resolução das imagens ou misturar características de transformers e convoluções não ajudou e às vezes piorou a detecção.

Focando nas formas das daninhas, não apenas nos pixels verdes

A terceira tarefa foi segmentação: delimitar os pixels exatos das daninhas dentro de cada região detectada. A equipe comparou três estratégias sem treinar nenhum modelo especificamente para essa tarefa: um índice simples baseado em cor que enfatiza o verde, um modelo geral de "segment anything" e um método fracamente supervisionado que aprende a partir de pistas grosseiras. Cada um teve pontos fortes e fracos. Métodos baseados em cor deram contornos nítidos quando as daninhas se destacavam, mas falharam quando plantas de fundo tinham tons similares. O modelo de segmentação geral capturou bem a estrutura, mas às vezes perdeu folhas finas ou incluiu grandes pedaços de fundo. O método fracamente supervisionado frequentemente localizou mais da daninha em cenas difíceis de verde sobre verde, mas tendia a marcar em excesso solo e outras áreas não daninhas. Junto com as moderadas pontuações de detecção, esses resultados destacam o quão difícil ainda é para a IA separar cana de daninhas semelhantes sob condições reais de campo.

Quão próximos estamos de pulverizadores mais inteligentes?

Do ponto de vista do agricultor, a mensagem é mista. A boa notícia é que a IA já pode decidir, com acurácia quase perfeita, se uma cena de cana contém daninhas, e alguns detectores são rápidos o suficiente para rodar em máquinas de campo. A má notícia é que os sistemas atuais ainda têm dificuldade em identificar com precisão onde cada daninha está quando as plantas estão emaranhadas e visualmente similares — justamente nos casos em que a pulverização direcionada é mais importante. Os autores concluem que, embora seu novo conjunto de dados e análise sejam passos importantes rumo ao controle autônomo de daninhas na cana, sistemas confiáveis e prontos para o campo exigirão melhores dados de treinamento, maneiras mais inteligentes de lidar com limites de plantas ambíguos e modelos que equilibrem precisão e velocidade em hardware embarcado limitado. Em suma, estamos mais próximos do que antes — mas ainda não no ponto em que um trator possa assumir com segurança o controle das plantas daninhas por conta própria.

Citação: Papa, J.P., Manesco, J.R.R., Schoder, M. et al. Toward autonomous weed management systems in sugarcane crops and an assessment of technological readiness. npj Artif. Intell. 2, 40 (2026). https://doi.org/10.1038/s44387-026-00096-0

Palavras-chave: agricultura de precisão, detecção de plantas daninhas, cana-de-açúcar, visão computacional, pulverização autônoma