Clear Sky Science · pt

Quadro explicável de raciocínio por atribuição multigranular para detecção de notícias falsas

Por que identificar notícias falsas está ficando mais difícil

Todos os dias, milhões de publicações que combinam palavras e imagens circulam pelas redes sociais. Algumas são inofensivas, outras são verdadeiras e outras são falsificações cuidadosamente criadas para atrair atenção, provocar emoções ou influenciar opiniões. À medida que ferramentas de edição de imagem e geradores de IA ficam mais baratos e fáceis de usar, as notícias falsas tornaram‑se mais polidas e mais perigosas. Este artigo apresenta uma nova maneira de analisar internamente sistemas de detecção de notícias falsas, de modo que possamos ver não apenas se uma publicação provavelmente é falsa, mas também por quê.

Como as notícias falsas enganam nossos olhos e mente

Os criadores de notícias falsas exploram a forma como as pessoas passam rapidamente por manchetes e imagens. Podem forjar ou alterar fotos, entrelaçar detalhes parcialmente verdadeiros em uma história impossível, unir trechos de eventos diferentes ou mesclar locais e cronologias que não pertencem juntos. Uma única publicação sobre um evento em destaque pode mostrar uma imagem dramática de outro incidente ocorrido anos antes, ou uma foto convincente pode ser gerada inteiramente por IA. Sistemas tradicionais de detecção geralmente tratam todas as publicações falsas da mesma forma e comprimem texto e imagem em uma única “sopa de características”. Essa abordagem pode funcionar razoavelmente bem, mas age como uma caixa preta: é difícil para jornalistas, plataformas ou usuários comuns entenderem quais pistas específicas dispararam o alerta.

Uma nova pergunta: “Por que isto é falso?”

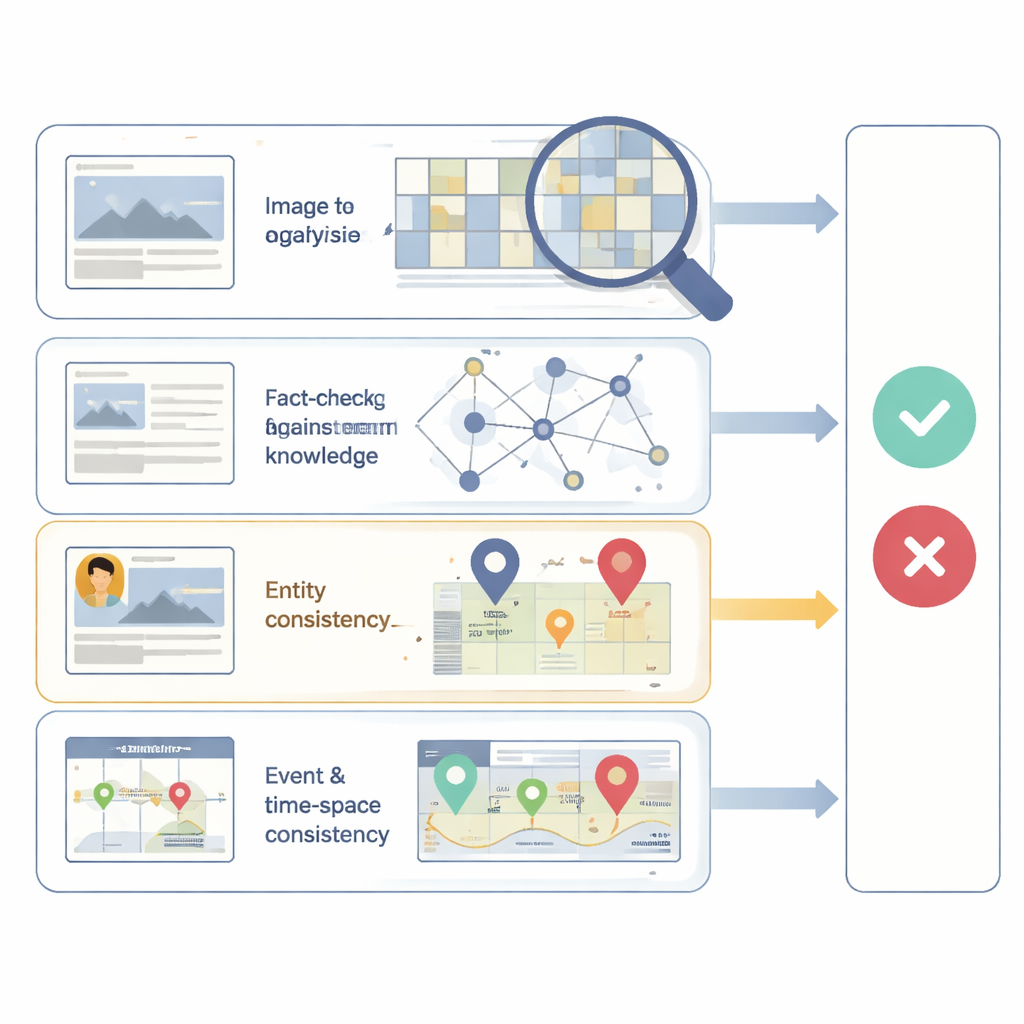

Os autores propõem um quadro explicável chamado EMAR‑FND que examina publicações de notícias a partir de quatro ângulos distintos, cada um ligado a uma maneira comum de se fabricar fakes. Primeiro, avalia se a própria imagem mostra sinais de manipulação ou geração sintética, concentrando‑se em padrões sutis de ruído de câmera que mudam quando uma foto é alterada. Segundo, verifica se os fatos da história se alinham com conhecimentos externos confiáveis, como relações conhecidas entre pessoas, lugares e eventos. Terceiro, inspeciona se as entidades-chave mencionadas no texto — como uma figura pública ou uma cidade — correspondem ao que aparece na imagem acompanhante. Quarto, avalia se o evento descrito se encaixa no tempo e no espaço, por exemplo detectando uma discrepância entre um local alegado e pistas visuais na foto, ou entre uma linha do tempo reportada e outras evidências.

Montando pistas a partir de vários ângulos

Cada um desses quatro verificadores é tratado por um módulo de raciocínio próprio, que emite um juízo parcial sobre se aquele aspecto específico parece confiável. Um módulo foca em adulteração visual; outro raciocina sobre grafos de conhecimento externos; um terceiro constrói uma rede rica que liga palavras, objetos da imagem e eventos extraídos; e um quarto compara a publicação com evidências relacionadas ao longo do tempo e do espaço. Em vez de esconder esses sinais dentro de uma única representação fundida, o EMAR‑FND mantém suas contribuições separadas e depois as combina por meio de um passo final de decisão que pode ponderar quão importante cada visão é para um caso particular. O resultado não é apenas uma pontuação final de verdadeiro ou falso, mas também uma atribuição que mostra, por exemplo, que uma publicação foi sinalizada principalmente porque a imagem aparenta ter sido forjada, ou porque o evento descrito nunca se encaixa nos fatos conhecidos.

Testando o sistema em condições reais

Para avaliar a eficácia dessa abordagem, os pesquisadores aplicaram o EMAR‑FND a duas coleções públicas de publicações reais e falsas que incluem texto e imagens. Nesses conjuntos de dados, o método superou vários sistemas fortes existentes, alcançando maior precisão e melhor equilíbrio entre detectar publicações falsas e evitar falsos positivos. Ao analisar como as publicações se agrupavam dentro do modelo, notícias verdadeiras tendiam a formar grupos coesos e consistentes, enquanto notícias falsas eram mais dispersas — refletindo os muitos truques diferentes que os forjadores usam. As saídas de atribuição também se mostraram úteis em exemplos difíceis do mundo real: publicações em que o texto e a imagem pareciam consistentes à primeira vista foram expostas como falsas porque a imagem mostrava traços ocultos de manipulação ou porque conhecimentos externos contradiziam os fatos alegados.

O que isso significa para leitores comuns

Em termos simples, o estudo mostra que é possível construir detectores de notícias falsas que agem menos como oráculos e mais como investigadores cuidadosos. Em vez de dar uma resposta seca de sim ou não, o EMAR‑FND destaca qual parte de uma publicação é suspeita: a imagem, os fatos, as pessoas mencionadas ou o próprio evento. Esse tipo de explicação pode ajudar verificadores de fatos, plataformas e leitores a confiar nas decisões do sistema e a aprender a reconhecer padrões comuns de engano. À medida que as notícias falsas continuam a evoluir, ferramentas que possam tanto identificar quanto explicar manipulações serão cruciais para manter os ecossistemas de informação online mais saudáveis e transparentes.

Citação: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Palavras-chave: detecção de notícias falsas, desinformação multimodal, IA explicável, integridade em redes sociais, análise de falsificação de imagens