Clear Sky Science · pt

Desvendando o surgimento de comportamento coletivo em redes de agentes cognitivos

Por que enxames pensantes importam

De coletivos de robôs a comunidades online, grupos de unidades simples podem exibir comportamentos surpreendentemente ricos. Mas o que acontece quando cada unidade não é simples — e em vez disso possui raciocínio poderoso baseado em linguagem, como os grandes modelos de IA atuais? Este estudo explora como enxames desses “agentes cognitivos” se comportam em comparação com partículas tradicionais que seguem regras, e o que isso implica para tarefas como resolução de problemas e simulação de sociedades.

De partículas simples a agentes que conversam

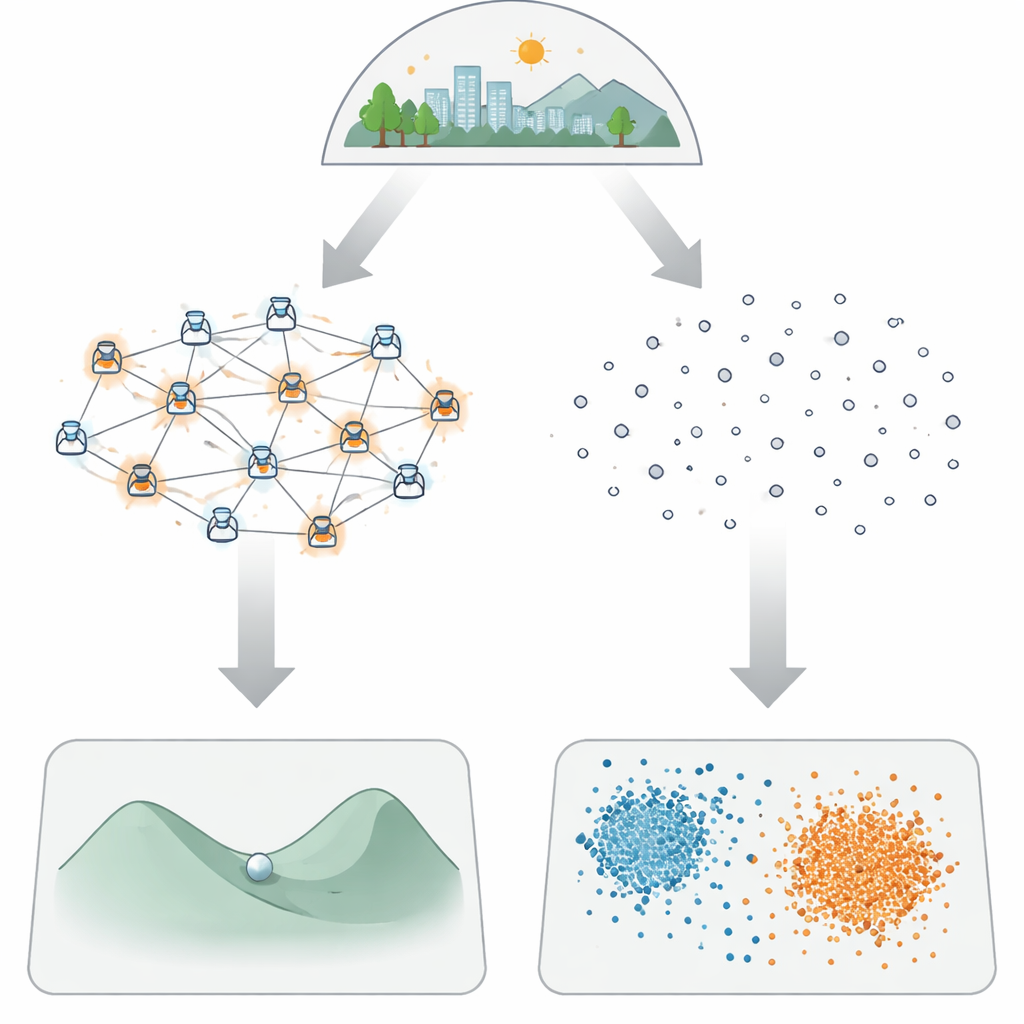

Modelos tradicionais de multidões, bandos ou enxames tratam os indivíduos como partículas básicas que seguem regras fixas: mover-se em direção a um vizinho, evitar colisões, preferir vizinhos semelhantes etc. Em contraste, os agentes estudados aqui são alimentados por grandes modelos de linguagem (LLMs). Eles percebem o entorno em palavras, raciocinam sobre o que fazer a seguir, lembram experiências passadas e até conversam entre si. Os autores fazem uma pergunta central: quando cada unidade tem essa “inteligência” embutida, os padrões gerais que emergem no nível do grupo mudam, e em caso afirmativo, como?

Testando enxames em problemas difíceis

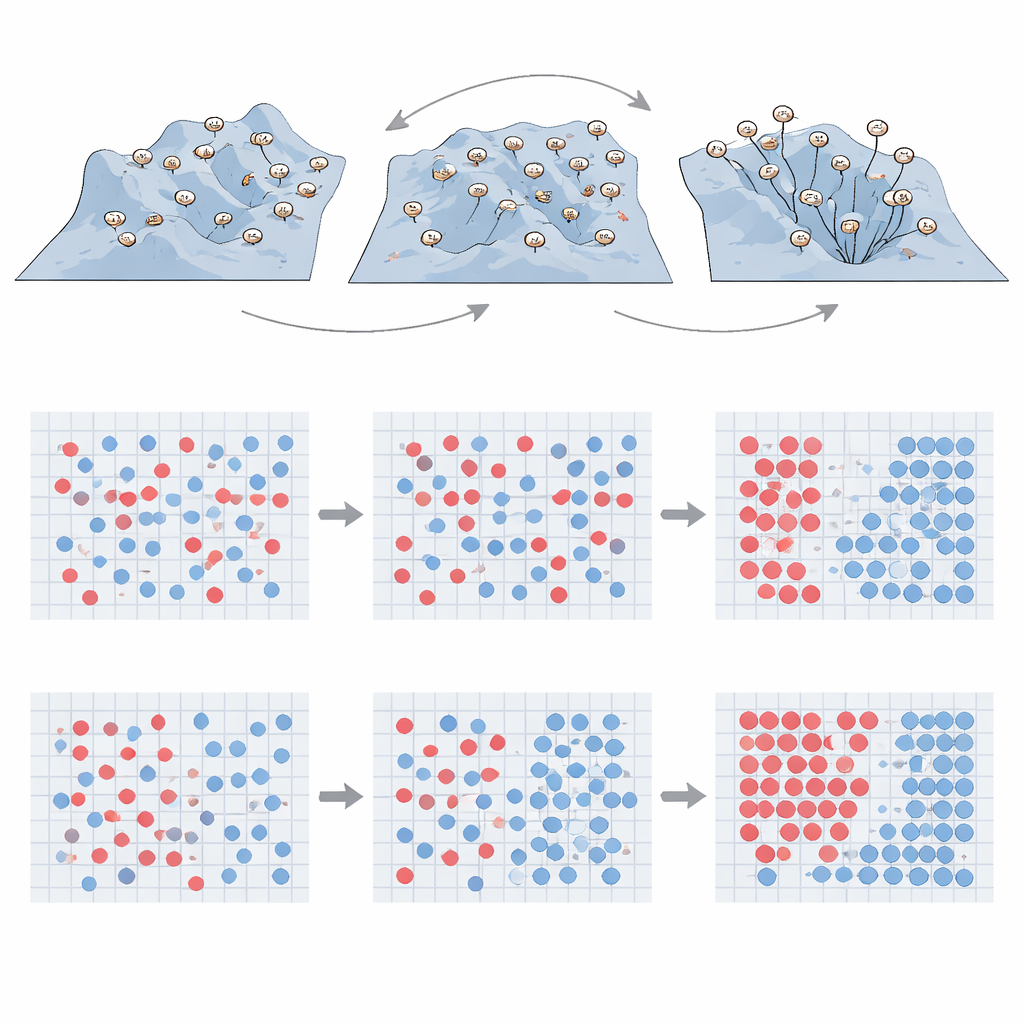

Para investigar essa questão, os pesquisadores comparam agentes cognitivos com partículas clássicas em dois desafios muito diferentes. O primeiro é a otimização de funções, um substituto para problemas difíceis de busca em que o objetivo é encontrar a melhor solução em uma paisagem acidentada repleta de armadilhas locais. Eles introduzem o LLM Agent Swarm Optimization (llmASO), em que uma rede de agentes LLM propõe e compartilha soluções candidatas em linguagem natural. Isso é comparado contra um método conhecido baseado em partículas chamado Particle Swarm Optimization, assim como contra um único otimizador LLM que atua sozinho. Em paisagens mais simples, agentes LLM solos encontram rapidamente boas respostas ao perceber padrões em tentativas passadas. Mas em terrenos mais rugosos, com muitos vales locais, agentes isolados tendem a se acomodar rápido demais em pontos “bons o suficiente” próximos. Enxames de agentes que conversam, por outro lado, descobrem de forma confiável a região verdadeiramente ótima — embora o façam mais lentamente e sejam sensíveis a como a informação flui por sua rede de comunicação.

Como a conversa altera padrões sociais

O segundo teste revisita o modelo clássico de segregação de Schelling, que mostra como preferências brandas por vizinhos semelhantes podem levar a separação marcada entre grupos. Aqui, os agentes se movem em uma grade e pertencem a um de dois tipos; eles ficam “satisfeitos” se poucos vizinhos forem diferentes deles. Para partículas padrão que seguem regras simples de realocação, três fases familiares aparecem conforme a tolerância muda: um estado misto com constante agitação, um estado segregado com clusters distintos e um estado congelado em que o movimento praticamente cessa. Agentes cognitivos obedecem à mesma regra básica de satisfação, mas decidem para onde se mover depois de trocar mensagens com outros agentes. Quando todo agente pode conversar com qualquer outro, o resultado em larga escala parece surpreendentemente semelhante ao caso das partículas, sugerindo que simplesmente adicionar linguagem e raciocínio não derruba automaticamente padrões de segregação bem conhecidos.

Redes e efeitos de “pássaros do mesmo bico”

A história muda quando a estrutura das conversas é tornada mais realista. Os autores reconfiguram a rede de comunicação para que agentes falem majoritariamente com pares próximos, ou para que as conexões sigam padrões vistos em muitos sistemas sociais reais com alguns hubs altamente conectados. Eles também experimentam homofilia (agentes preferindo conversar com o mesmo tipo) e heterofilia (preferindo o tipo oposto). Esses ajustes têm consequências fortes: quando agentes conversam principalmente com semelhantes, eles coordenam rapidamente, formam clusters de forma eficiente e podem até evitar a fase eternamente mista. Quando conversam majoritariamente entre tipos diferentes, o caminho para a satisfação é mais lento e complexo, mas uma forte segregação ainda pode surgir — mesmo que toda conversa atravesse linhas de grupo. No geral, conversas locais e tendências de “pássaros do mesmo bico” remodelam a forma como a segregação emerge, de maneiras inacessíveis a partículas sem cognição.

O que isso significa para futuros enxames de IA e simulações sociais

Os autores concluem que dotar cada agente de habilidades avançadas baseadas em linguagem não torna grupos universalmente melhores. Em vez disso, essas capacidades introduzem novas forças — como consenso rápido e exploração de padrões — que podem ser úteis ou prejudiciais dependendo de como os agentes estão conectados. Em tarefas de otimização, redes mal projetadas podem levar agentes inteligentes a concordar rápido demais em soluções medíocres; limitar cuidadosamente o fluxo de informação ajuda-os a explorar mais amplamente, ao custo de velocidade. Em simulações sociais, padrões de comunicação realistas e homofilia podem gerar comportamentos diferentes dos modelos clássicos e podem refletir melhor as sociedades humanas. À medida que enxames de robôs guiados por IA e redes de agentes virtuais se tornam mais comuns, entender e ajustar esses efeitos coletivos será crucial para projetar sistemas seguros e eficazes.

Citação: Zomer, N., De Domenico, M. Unraveling the emergence of collective behavior in networks of cognitive agents. npj Artif. Intell. 2, 36 (2026). https://doi.org/10.1038/s44387-026-00091-5

Palavras-chave: agentes cognitivos, grandes modelos de linguagem, otimização em enxames, dinâmica de segregação, topologia de rede