Clear Sky Science · pt

DeepKoopFormer: uma arquitetura baseada em transformer aprimorada pelo operador de Koopman para previsão de séries temporais

Por que previsões mais inteligentes importam

De planejamento meteorológico e energético a mercados financeiros, muitas das nossas decisões mais importantes dependem de prever como as coisas vão mudar ao longo do tempo. Essas “séries temporais” — fluxos de medições como velocidade do vento, produção de eletricidade ou preços de criptomoedas — estão ficando mais longas, ruidosas e complexas. Ferramentas modernas de IA chamadas Transformers conseguem processar esses dados, mas frequentemente funcionam como caixas-pretas e podem se tornar instáveis quando forçadas a prever em horizontes longos. Este artigo apresenta o DeepKoopFormer, um método de previsão que preserva o poder preditivo dos Transformers ao mesmo tempo em que adiciona estrutura matemática para tornar seu comportamento mais estável, interpretável e confiável em horizontes longos.

Uma nova forma de estabilizar modelos poderosos

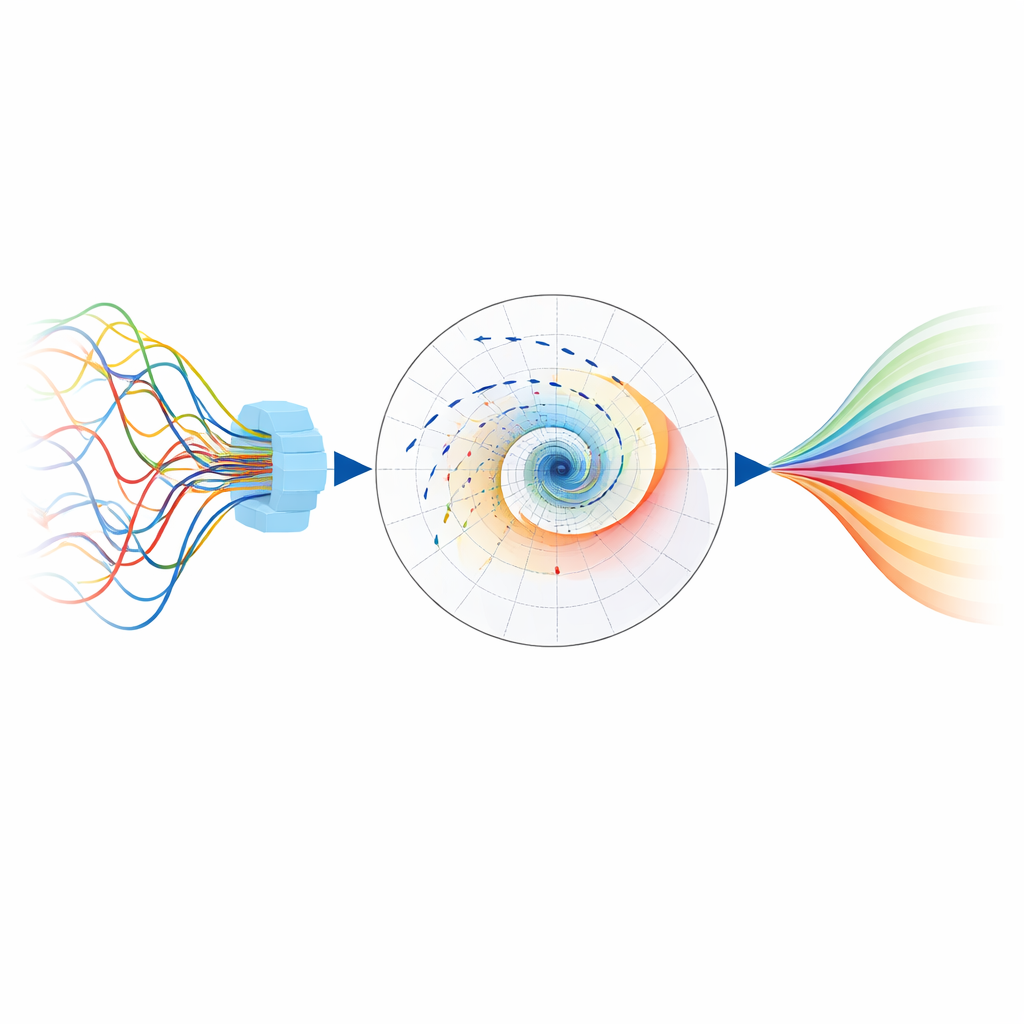

Os autores partem de uma ideia familiar na IA atual: usar um Transformer para transformar séries temporais brutas em uma representação interna rica. O DeepKoopFormer insere então uma camada intermediária cuidadosamente projetada, inspirada em um conceito da teoria de sistemas dinâmicos conhecido como operador de Koopman. Em vez de deixar o modelo evoluir de maneira complicada e completamente não linear, essa camada intermediária avança o estado interno usando uma transformação linear simples em um espaço oculto. Crucialmente, essa transformação é construída de modo que sua influência diminua gradualmente ao longo do tempo em vez de se amplificar descontroladamente, o que garante matematicamente que previsões de longo prazo não explodam nem oscilem sem controle.

Como o modelo mantém o equilíbrio

Para impor essa estabilidade, o DeepKoopFormer restringe a etapa linear de várias maneiras. A transformação é fatorada em três partes: duas matrizes ortogonais (que preservam comprimentos e ângulos) envolvendo uma matriz diagonal de fatores de escala que são todos forçados a ser menores que um. Isso significa que o estado oculto é suavemente contraído em vez de amplificado a cada atualização. Um segundo ingrediente, chamado regularização de Lyapunov, adiciona uma penalidade durante o treinamento sempre que a “energia” do estado oculto cresce de um passo para o seguinte. Juntos, esses mecanismos garantem que a dinâmica interna seja calma e bem-comportada, enquanto o Transformer antes e o decodificador linear após essa etapa permanecem livres para ser expressivos. A capacidade do modelo de aprender padrões ricos e sua estabilidade são controladas por configurações separadas, de modo que os usuários podem ajustar uma sem comprometer a outra.

Colocando o método à prova

Os pesquisadores avaliam o DeepKoopFormer em problemas controlados e do mundo real. Primeiro o testam em sistemas caóticos clássicos como o atrator de Lorenz, onde pequenas mudanças podem levar a futuros muito diferentes, e adicionam ruído aleatório para imitar medições reais. Em diferentes backbones Transformer, as versões aprimoradas com Koopman acompanham de perto as trajetórias reais enquanto mantêm comportamento interno estável em muitas previsões de curto prazo. Os autores avançam então para conjuntos de dados reais exigentes: projeções climáticas e reanálises sobre a Alemanha (velocidade do vento e pressão na superfície), preços de criptomoedas e geração de eletricidade a partir de múltiplas fontes na Espanha. Nesses casos, variantes do DeepKoopFormer são comparadas com uma rede padrão de memória de longo prazo (LSTM) e com linhas de base lineares mais simples, em muitas escolhas de comprimento da janela de entrada, horizonte de previsão e tamanho do modelo.

O que os experimentos revelam

Em tarefas climáticas, financeiras e energéticas, os modelos Transformer aumentados com Koopman geralmente alcançam erros de previsão menores e comportamento mais estável do que a linha de base LSTM, especialmente ao prever muitos passos à frente ou ao trabalhar com dados de alta dimensionalidade. Para vento e pressão sobre a Alemanha, e para geração de eletricidade, as versões PatchTST e Informer do DeepKoopFormer tendem a apresentar melhor desempenho, capturando de forma confiável tanto tendências suaves quanto flutuações rápidas. Em alguns casos especiais em que os padrões subjacentes são quase inteiramente lineares, um método linear muito simples ainda vence em acurácia no teste, ressaltando que nenhum modelo é universalmente ótimo. No entanto, os desenhos baseados em Koopman mostram consistentemente padrões de erro mais suaves à medida que os horizontes de previsão crescem, indicando melhor controle da incerteza de longo prazo e menor tendência a ajustar excessivamente detalhes peculiares dos dados de treinamento.

Por que essa abordagem é promissora

No fim, o DeepKoopFormer demonstra que é possível combinar a flexibilidade do aprendizado profundo com as garantias da teoria clássica de sistemas dinâmicos. Ao inserir uma etapa linear estruturada e estável em um pipeline Transformer de outra forma padrão, os autores obtêm previsões que são precisas, robustas ao ruído e matematicamente mais fáceis de analisar. Para praticantes que dependem de previsões de longo prazo em ciências climáticas, sistemas de energia ou finanças — onde estabilidade e interpretabilidade são tão importantes quanto precisão bruta — essa estrutura oferece uma maneira de confiar um pouco mais em modelos neurais poderosos e de entender como e por que suas previsões se comportam ao longo do tempo.

Citação: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Palavras-chave: previsão de séries temporais, modelos transformer, operador de Koopman, dinâmicas estáveis, dados climáticos e de energia