Clear Sky Science · pt

Um arcabouço variacional para adaptividade baseada em resíduo em solucionadores neurais de EDP e aprendizado de operadores

IA mais inteligente para equações difíceis

Muitos dos avanços científicos atuais — desde modelagem climática até o projeto de novos materiais — dependem de resolver equações complexas que descrevem como fluidos se movimentam, ondas se propagam ou frentes químicas evoluem. Redes neurais tornaram‑se recentemente ferramentas poderosas para enfrentar essas equações, mas costumam ter dificuldades quando a física é desafiadora: choques acentuados, estruturas muito pequenas e previsões em longo prazo podem fazê‑las falhar. Este artigo apresenta uma forma sistemática de fazer esses solucionadores de IA concentrarem seus esforços exatamente onde encontram mais dificuldade, tornando‑os ao mesmo tempo mais rápidos e mais precisos.

Por que redes neurais precisam de orientação

No aprendizado de máquina científico, redes neurais são treinadas tanto para reproduzir a solução de uma única equação (como nas redes neurais informadas pela física, ou PINNs) quanto para aprender um mapeamento inteiro de entradas para soluções (conhecido como aprendizado de operadores). Em ambos os casos, a rede é avaliada por um “resíduo”, uma medida de o quanto ela viola a equação subjacente em cada ponto no espaço e no tempo. O treinamento padrão trata todos os pontos igualmente, minimizando o erro médio. Isso funciona para problemas simples, mas para equações com gradientes íngremes, frentes móveis ou estruturas localizadas, uma média baixa pode mascarar erros graves em regiões críticas. Pesquisadores têm respondido com regras ad hoc que posicionam mais pontos de treinamento onde o resíduo é grande, mas até agora essas regras permaneceram heurísticas e pouco justificadas.

Uma receita unificada para atenção adaptativa

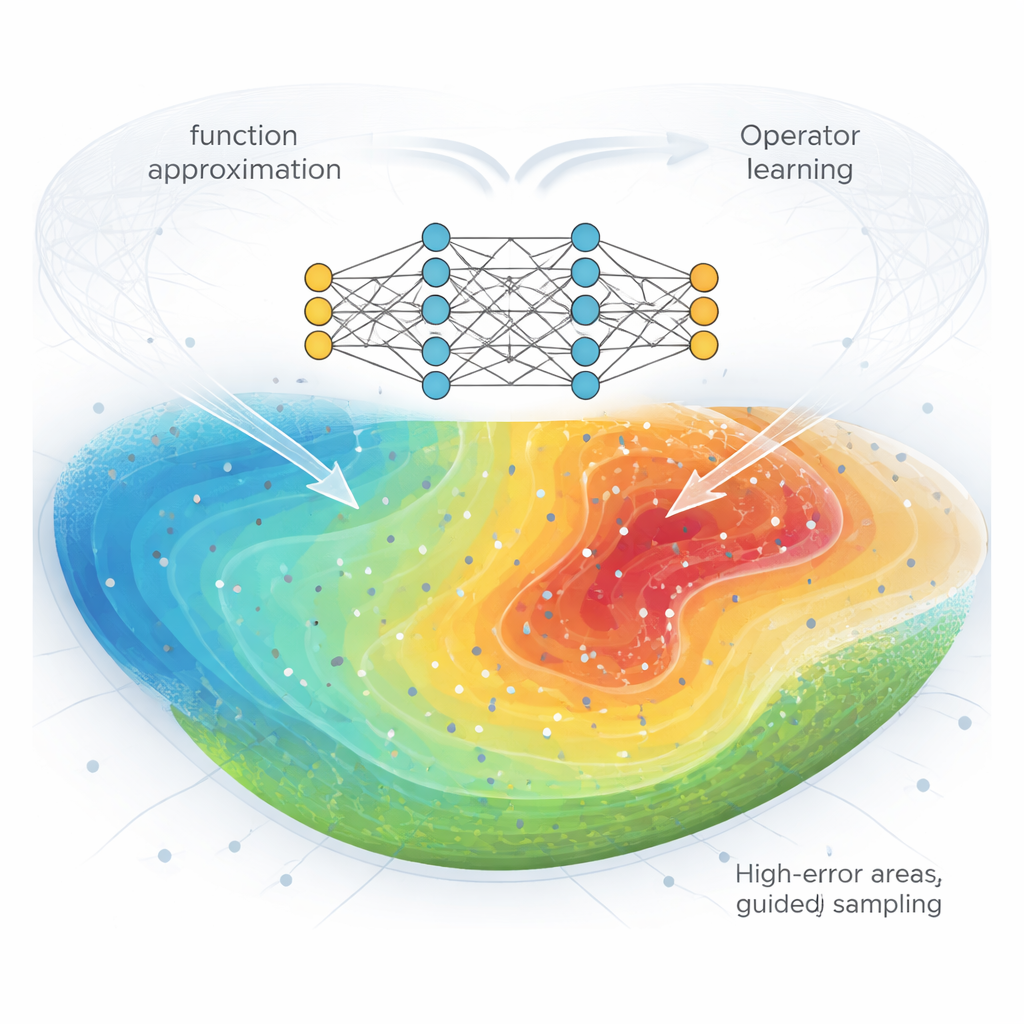

Os autores desenvolvem um arcabouço variacional que transforma essas heurísticas em uma receita principiada. A ideia chave é ver amostragem e ponderação como escolhas sobre qual distribuição de probabilidade no espaço (e sobre exemplos de treinamento) a rede deve priorizar. Eles introduzem uma família de funções de “potencial” que transformam o resíduo em um novo objetivo. Diferentes escolhas de potencial correspondem a prioridades distintas: um potencial exponencial leva a rede a reduzir seu pior erro isolado, enquanto um potencial quadrático enfatiza reduzir a dispersão, ou variância, do erro pelo domínio. Matematicamente, otimizar esses objetivos transformados leva, de forma natural, a amostrar com maior frequência regiões onde o resíduo atual é grande. O método resultante, chamado atenção variacional baseada em resíduo (vRBA), engloba muitos esquemas adaptativos existentes e fornece um caminho claro para inventar novos.

Estendendo para aprender mapas físicos inteiros

Solvedores de IA modernos visam cada vez mais aprender não apenas uma solução, mas um operador inteiro: um mapeamento de entradas como condições iniciais ou termos de força para campos espaço–tempo completos. Esse é o objetivo de arquiteturas de operador neural como DeepONet, Fourier Neural Operators (FNO) e U‑Nets condicionados no tempo. Aqui o desafio é duplo: existe variação entre diferentes funções de entrada e variação no espaço e no tempo dentro de cada exemplo. Os autores adaptam seu arcabouço a esse cenário produto combinando dois níveis de adaptividade. Primeiro, eles reponderam pontos espaciais dentro de cada exemplo para que áreas com resíduos altos tenham mais peso. Segundo, eles usam os resíduos acumulados para reamostrar preferencialmente exemplos de treinamento inteiros que são mais difíceis de aprender. Esse esquema híbrido pode ser inserido diretamente em modelos populares de aprendizado de operadores sem redesenhar sua arquitetura.

Detalhes mais nítidos, crescimento de erro mais lento

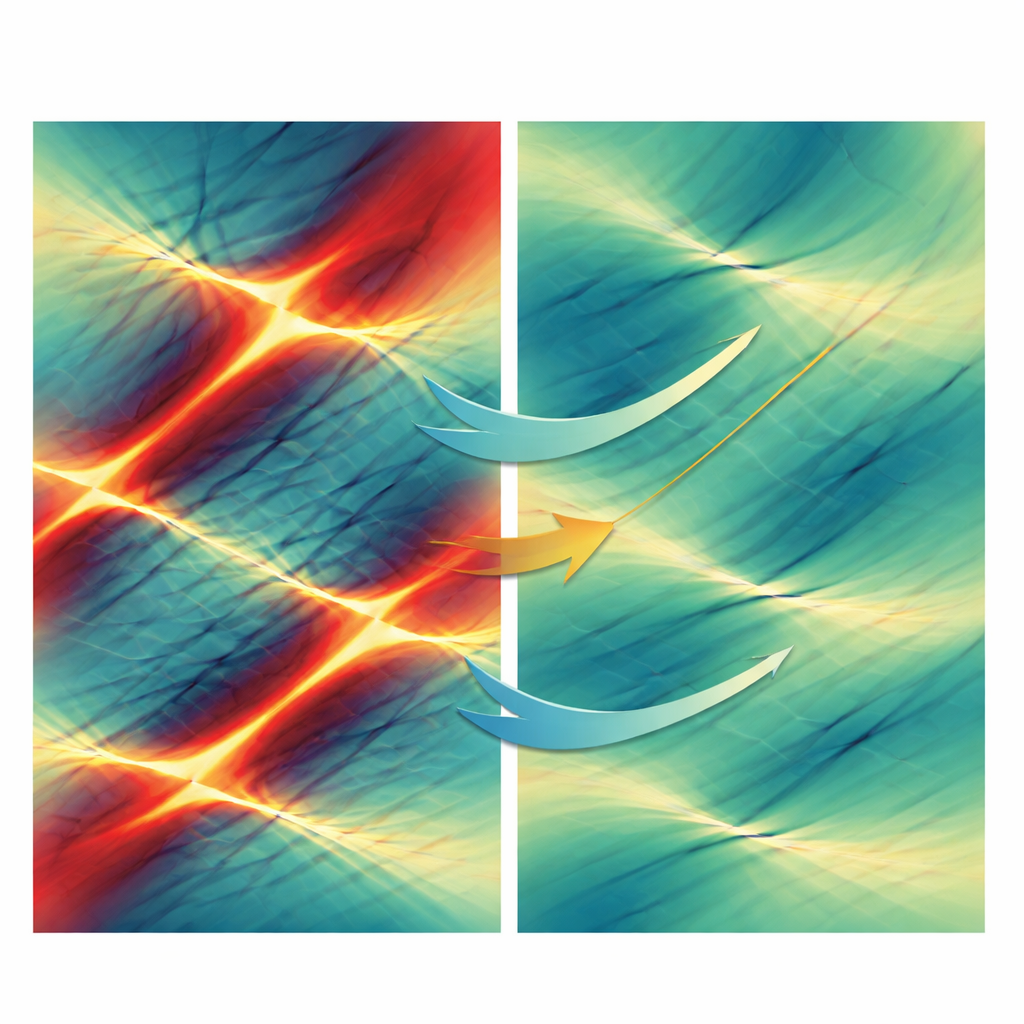

Em uma ampla bateria de benchmarks, a abordagem vRBA supera consistentemente o treinamento tradicional. Para PINNs, a equipe testa equações não lineares clássicas como Allen–Cahn, Burgers’ e Korteweg–De Vries. Alguns desses problemas são conhecidos por derrotar PINNs padrão, seja por camadas internas acentuadas ou pulsos de onda interagentes. Com vRBA, as mesmas redes convergem mais rápido e alcançam erro significativamente menor, e em casos difíceis onde a linha de base essencialmente falha, os métodos adaptativos recuperam soluções precisas. Para aprendizado de operadores, eles aplicam vRBA ao crescimento de bolhas em líquidos, fluxos em tubos de choque de alta pressão, turbulência bidimensional e propagação de ondas. Aqui, o benefício principal não é apenas um erro final melhor, mas um acúmulo de erros muito mais lento ao longo do tempo, crucial quando a saída do modelo é reinserida repetidamente como sua própria entrada.

Eliminando ruído no sinal de aprendizado

Os autores identificam esses ganhos em dois efeitos principais. Primeiro, ao mudar como pontos de treinamento são amostrados ou ponderados, vRBA reduz o ruído estatístico na perda estimada: lotes aleatórios de pontos oferecem um retrato mais confiável de quão bem a rede está se saindo no geral. Isso reduz diretamente o erro de discretização, a lacuna entre o objetivo contínuo ideal e o conjunto finito de pontos usado na prática. Segundo, o método melhora a relação sinal‑ruído dos gradientes que dirigem o aprendizado, de modo que diferentes regiões do domínio “concordem” mais sobre em que direção os parâmetros devem se mover. Como resultado, as redes escapam de fases lentas e indecisas de treinamento muito antes e entram em um regime onde o erro cai rapidamente. O arcabouço também esclarece quando estratégias agressivas — aquelas que penalizam fortemente os maiores resíduos — podem ajudar e quando podem desestabilizar o treinamento.

O que isso significa para a IA científica do futuro

Para não especialistas, a mensagem é que uma atenção mais inteligente aonde um solucionador de IA erra pode torná‑lo uma ferramenta muito mais confiável para ciência e engenharia. Em vez de depender de regras por tentativa e erro, este trabalho oferece um roteiro matemático para direcionar redes neurais às partes mais informativas de um problema, sejam frentes de choque, oscilações finas ou comportamentos em longo prazo. À medida que modelos científicos crescem em escala e são usados em contextos críticos para segurança, estratégias princípiadas para reduzir erro e estabilizar o aprendizado serão essenciais para transformar redes neurais poderosas em instrumentos científicos confiáveis.

Citação: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Palavras-chave: redes neurais informadas pela física, aprendizado de operadores, amostragem adaptativa, aprendizado de máquina científico, equações diferenciais parciais