Clear Sky Science · pt

Atenção visual humana e algorítmica em tarefas de direção

Por que isso importa na condução cotidiana

À medida que os carros ficam mais automatizados, uma questão central permanece: os sistemas autônomos realmente “veem” a estrada do mesmo modo que os humanos? Este estudo analisa como motoristas humanos e inteligências artificiais dirigem sua atenção visual no trânsito e mostra que adicionar cuidadosamente um traço de atenção semelhante à humana pode tornar os algoritmos de direção mais inteligentes e seguros — sem depender de modelos de IA gigantes e consumidores de energia.

Como os olhos humanos se movem na estrada

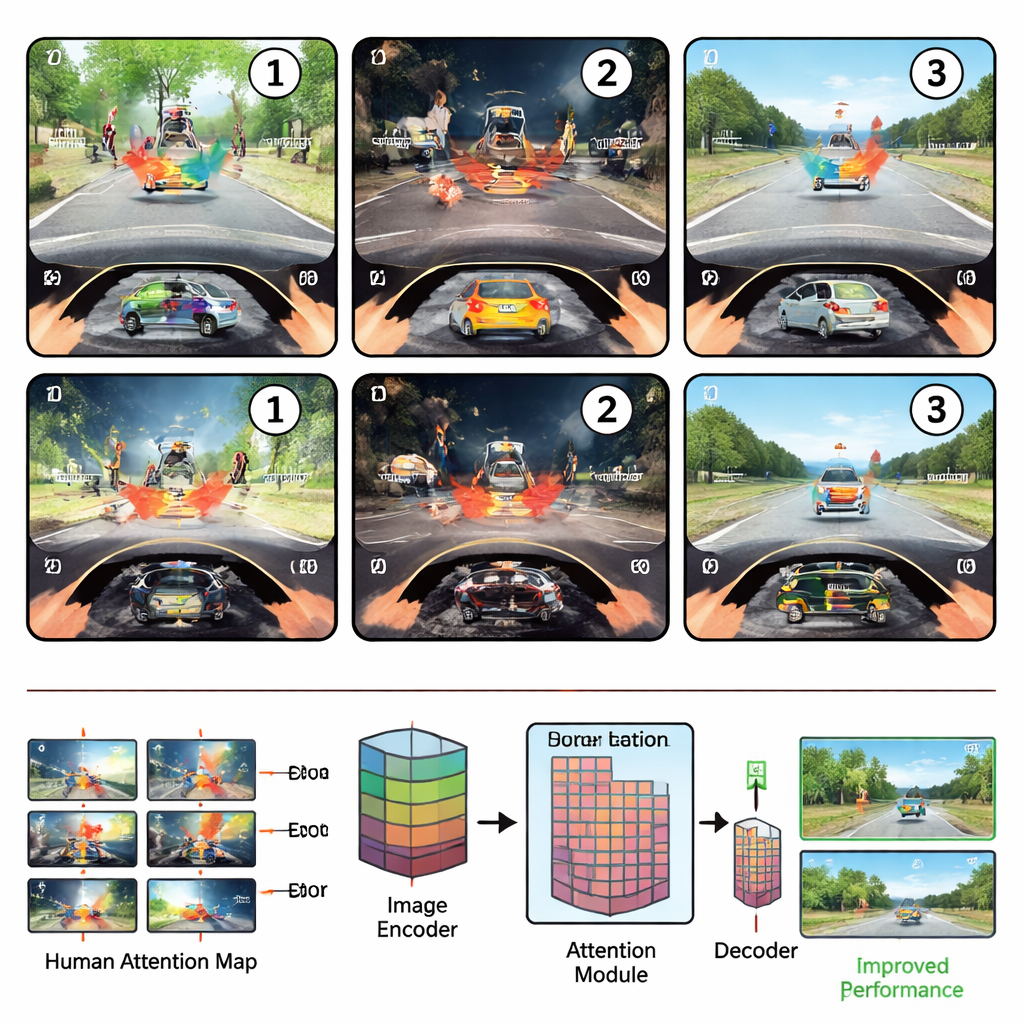

Os pesquisadores primeiro colocaram motoristas novatos e experientes em um ambiente de simulação de direção e rastrearam seus movimentos oculares enquanto realizavam três tarefas comuns de segurança: detectar perigos, julgar se era seguro fazer uma curva ou mudar de faixa, e identificar objetos estranhos ou fora do lugar. Eles descobriram que a atenção dos motoristas seguia um ritmo confiável em três etapas. Na fase de varredura, logo após a cena aparecer, os olhos percorrem amplamente o campo de visão, guiados principalmente pela localização dos elementos. Na fase de exame, a atenção fixa-se na única região mais informativa — como um pedestre atravessando ou um carro que bloqueia o caminho — e examina seus detalhes e significado. Finalmente, na fase de reavaliação, os motoristas comparam esse objeto-chave com outros, movendo o olhar para frente e para trás para confirmar sua decisão.

Onde as máquinas olham vs. onde as pessoas olham

A equipe então construiu um modelo de deep learning baseado em atenção para cenas de direção e comparou seus “mapas de atenção” internos com os derivados dos movimentos oculares humanos. Treinar o modelo em detecção geral de objetos tornou sua atenção um pouco mais semelhante à humana, mas ajustá-lo finamente para tarefas específicas de direção frequentemente o afastou dos padrões humanos, especialmente na rica fase de exame, centrada em significado. No geral, as correlações entre atenção humana e algorítmica permaneceram modestas, sugerindo que a IA de direção atual tem dificuldade em descobrir os princípios organizadores de onde e por que os humanos olham.

Ensinando carros a emprestar o foco humano

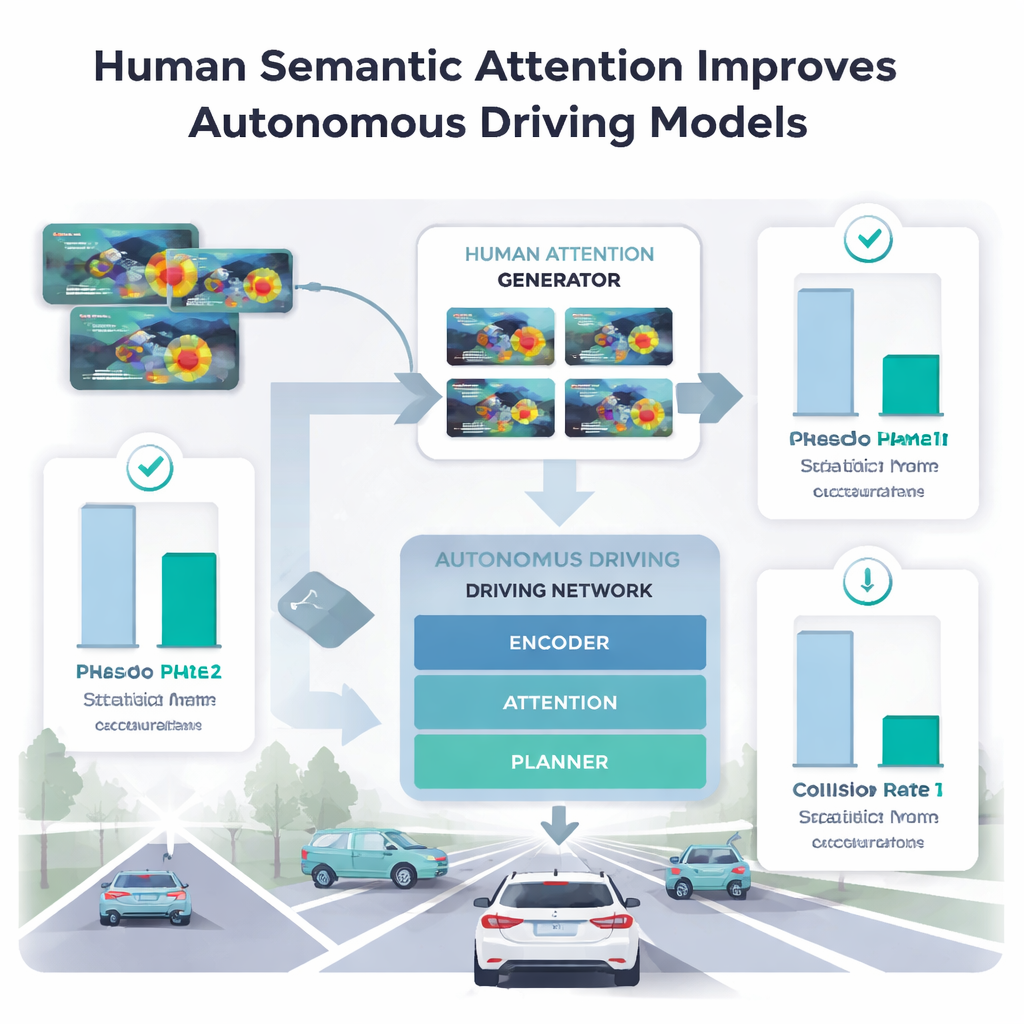

Para ver quais partes da atenção humana realmente ajudam as máquinas, os autores alimentaram diferentes fases do olhar humano em seu modelo de direção. Coletar diretamente dados de rastreamento ocular para milhões de imagens é impraticável, então eles treinaram um “gerador de atenção humana” separado em uma pequena amostra de apenas cinco motoristas. Esse gerador aprendeu a prever mapas de calor de atenção semelhantes aos humanos para novas cenas. Quando o modelo principal de direção usou apenas a fase espacial e inicial de varredura, seu desempenho em detecção de anomalias e planejamento de trajetórias muitas vezes piorou ou gerou caminhos que pareciam mais seguros, mas eram mais propensos a colisões. Em contraste, quando usou a fase de exame — em que os humanos se concentram na única região mais significativa — a precisão melhorou além de métodos anteriores que usavam o olhar de comprimento total, e as taxas de colisão em tarefas de planejamento diminuíram.

O que os grandes modelos visão-linguagem ainda perdem

Os pesquisadores também testaram grandes modelos visão–linguagem que respondem a perguntas sobre direção ou geram legendas detalhadas para cenas de rua em 3D. Para uma tarefa de perguntas e respostas que enfatiza raciocínio de alto nível, adicionar atenção humana ajudou pouco e às vezes prejudicou, o que indica que esses modelos já capturam grande parte do conhecimento abstrato necessário. Mas para uma tarefa exigente de legendagem que requer associar palavras precisas a objetos precisos, a atenção humana da fase de exame ainda trouxe ganhos significativos. Isso sugere que grandes modelos podem raciocinar bem em geral, mas ainda trombam ao ter que vincular estritamente palavras aos pontos exatos de uma cena visual movimentada — uma lacuna que o olhar humano pode ajudar a fechar.

O que isso significa para carros automatizados mais seguros

Em termos simples, o estudo argumenta que o que realmente separa as pessoas da IA de direção de hoje não é apenas onde olhamos, mas como julgamos instantaneamente o que importa em uma cena. Esse foco semântico compacto — quando examinamos a região que torna a situação segura ou perigosa — revela-se exatamente o sinal que muitos algoritmos não possuem. Ao aprender a imitar essa fase a partir de uma pequena quantidade de dados de rastreamento ocular, os sistemas de direção podem ganhar compreensão semelhante à humana de cenas rodoviárias sem depender apenas de modelos de IA cada vez maiores e mais caros. Esse “atalho semântico” pode ser uma forma eficiente de tornar os futuros carros automatizados mais confiáveis nas condições desordenadas e imprevisíveis do tráfego real.

Citação: Zheng, C., Li, P., Jin, B. et al. Human and algorithmic visual attention in driving tasks. npj Artif. Intell. 2, 23 (2026). https://doi.org/10.1038/s44387-026-00079-1

Palavras-chave: condução autônoma, atenção visual, rastreamento ocular humano, modelos visão-linguagem, segurança no trânsito