Clear Sky Science · pt

Agentes de IA na saúde: aplicações, avaliações e direções futuras

Por que assistentes digitais inteligentes importam na medicina

Hospitais estão atolados em dados, médicos estão sobrecarregados e pacientes querem respostas mais claras sobre sua saúde. Um novo tipo de inteligência artificial, baseado em modelos de linguagem de grande porte que conseguem ler e escrever como humanos, está sendo transformado em “agentes de IA” capazes de raciocinar em tarefas de múltiplas etapas. Este artigo de revisão explica como esses ajudantes digitais começaram a auxiliar no diagnóstico, nas decisões de tratamento, na papelada, nas conversas com pacientes e até na educação médica — ao mesmo tempo em que alerta sobre o que precisa ser feito para mantê‑los precisos, justos e seguros.

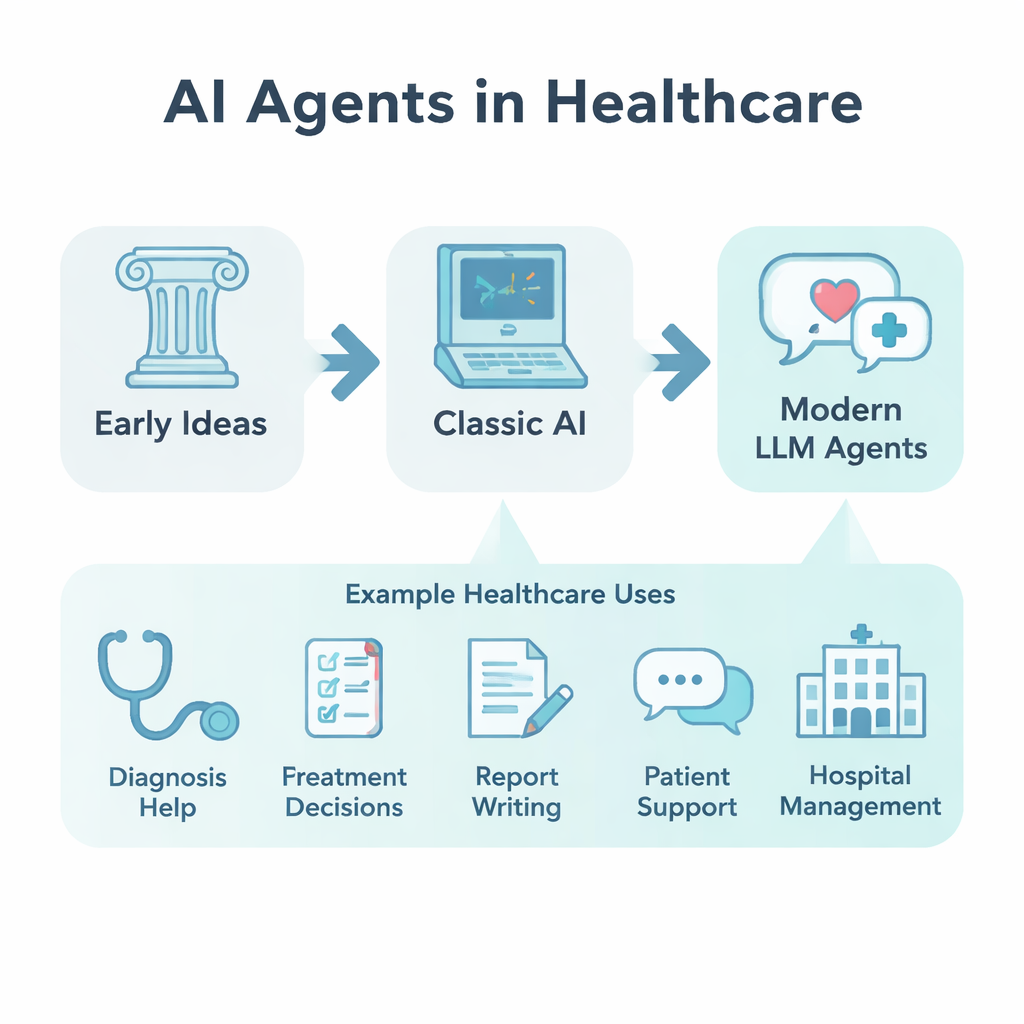

Dos experimentos mentais a colegas digitais práticos

A ideia de um “agente” que pode agir com metas e intenções remonta à filosofia antiga. Versões modernas apareceram com a inteligência artificial inicial, sistemas especialistas e, mais tarde, com aprendizado de máquina e aprendizado profundo, que permitiram aos computadores aprender padrões a partir de dados. A grande virada dos modelos de linguagem de grande porte (LLMs) após 2022 levou isso adiante: em vez de apenas responder perguntas, esses modelos agora podem planejar, lembrar passos anteriores e chamar outros softwares. Na saúde, isso significa que um agente de IA pode ler prontuários médicos, consultar diretrizes, redigir notas e sugerir próximas ações, comportando‑se menos como um motor de busca e mais como um colega digital júnior.

O que torna esses agentes diferentes da IA comum

Segundo a definição adotada no artigo, um agente de IA na saúde é mais do que um único modelo. Ele tem um LLM no seu núcleo, cercado por quatro habilidades-chave: planejamento, memória, uso de ferramentas e autorreflexão. O planejamento permite decompor uma tarefa médica complexa em passos menores. A memória permite acompanhar a história do paciente ou um longo processo de decisão. O uso de ferramentas significa que ele pode, por exemplo, puxar resultados de exames de um prontuário eletrônico ou buscar em uma base de dados médica. Módulos de autorreflexão verificam e revisam suas próprias respostas. Junto com fortes habilidades de linguagem e crescente capacidade de raciocínio lógico, essas competências tornam os agentes suficientemente flexíveis para transitar entre tarefas e especialidades médicas.

Como agentes de IA estão sendo testados no trabalho real de saúde

Pesquisadores agora estão construindo e simulando muitos tipos de agentes para ver onde eles ajudam mais. Alguns são projetados para apoiar o diagnóstico atuando em conversas entre médicos virtuais e pacientes, ou fazendo com que múltiplos agentes especialistas debatam um caso difícil. Outros focam em decisões de tratamento, combinando entradas de generalistas virtuais, especialistas e farmacêuticos para chegar a um plano compartilhado. Há agentes que redigem laudos de radiologia a partir de radiografias de tórax, ou traduzem achados técnicos para uma linguagem simples e acessível ao paciente. Sistemas no formato chatbot estão sendo pilotados para apoio em saúde mental, coaching para perda de peso e lembretes de medicação. Agentes adicionais ajudam a gerenciar prescrições, identificar efeitos colaterais de medicamentos, otimizar prontuários eletrônicos ou treinar estudantes de medicina com pacientes simulados realistas.

Avaliar se esses sistemas estão prontos para pacientes

Porque erros na medicina podem ser fatais, a revisão afirma que agentes de IA devem ser avaliados por mais do que apenas inteligência. Os autores agrupam os testes em duas camadas. Verificações básicas perguntam: as respostas são factualmente corretas? A redação corresponde a relatórios de especialistas? O agente conclui a tarefa de forma confiável, incluindo chamar as ferramentas certas? Verificações voltadas ao desenvolvimento avaliam velocidade, clareza e quão bem o sistema se comunica com as pessoas, incluindo respeito, empatia e equidade entre diferentes grupos de pacientes. Estudos comparam agentes tanto a outros modelos de linguagem de ponta quanto a médicos humanos, e reguladores na Europa, Reino Unido, China e em outros lugares estão começando a desenhar programas oficiais de “sandbox” para testar segurança, equidade e benefício clínico antes do lançamento.

Próximos passos: robôs, regras e confiança humana

Olhando adiante, o artigo destaca sete prioridades: conectar agentes a robôs físicos que possam agir no mundo real; combinar modelos de uso geral com modelos menores e especializados; ampliar a avaliação para incluir custos, eventos de segurança e satisfação do paciente; construir salvaguardas e supervisão mais fortes; incorporar proteções éticas e de privacidade; projetar para a confiança do usuário e feedback contínuo; e ajudar os profissionais de saúde a adaptar suas carreiras para trabalhar ao lado da IA em vez de serem substituídos por ela. Os autores concluem que agentes de IA podem se tornar parceiros poderosos na saúde, mas apenas se forem desenvolvidos, testados e governados com o mesmo cuidado que a sociedade exige de qualquer nova tecnologia médica.

Citação: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Palavras-chave: agentes de IA na saúde, modelos de linguagem de grande porte, suporte à decisão clínica, chatbots médicos, saúde digital