Clear Sky Science · pt

Melhorando o reconhecimento de entidades nomeadas em few-shot para grandes modelos de linguagem usando prompting dinâmico estruturado com geração aumentada por recuperação

Por que uma leitura mais inteligente de textos médicos importa

A medicina moderna gera oceanos de texto — desde notas de terapia intensiva até conversas online sobre uso de medicamentos. Ocultos nessas palavras estão indícios vitais sobre doenças, tratamentos e efeitos colaterais. Encontrar e rotular automaticamente esses trechos de informação, uma tarefa chamada “reconhecimento de entidades nomeadas”, pode ajudar pesquisadores a acompanhar surtos, identificar problemas com medicamentos mais cedo e apoiar médicos em tempo real. Mas sistemas tradicionais exigem grandes conjuntos de dados rotulados manualmente, que são caros de produzir e frequentemente inexistentes para problemas de saúde raros ou emergentes. Este estudo investiga como grandes modelos de linguagem, como os por trás dos chatbots atuais, podem ser guiados com prompts cuidadosamente desenhados e recuperação inteligente de exemplos para executar bem essa tarefa de rotulação mesmo quando estão disponíveis apenas algumas amostras anotadas.

Ensinando máquinas a identificar palavras importantes

Os autores se concentram no reconhecimento de entidades nomeadas biomédicas — encontrar menções a doenças, medicamentos, sintomas e impactos sociais em textos. Isso é difícil porque a linguagem médica é altamente especializada, varia por hospital ou subcampo e frequentemente envolve condições raras que aparecem apenas algumas vezes em qualquer corpus. Modelos de aprendizado de máquina existentes podem atingir desempenho próximo ao humano, mas tipicamente requerem grandes corpora bem anotados, caros de criar e compartilhar, especialmente sob regras rígidas de privacidade. O aprendizado few-shot, no qual modelos aprendem a partir de apenas algumas amostras rotuladas, oferece uma alternativa a esse gargalo. Grandes modelos de linguagem são especialmente promissores aqui porque podem aprender padrões diretamente a partir de instruções e exemplos fornecidos no prompt, sem precisar re-treinar seus pesos internos.

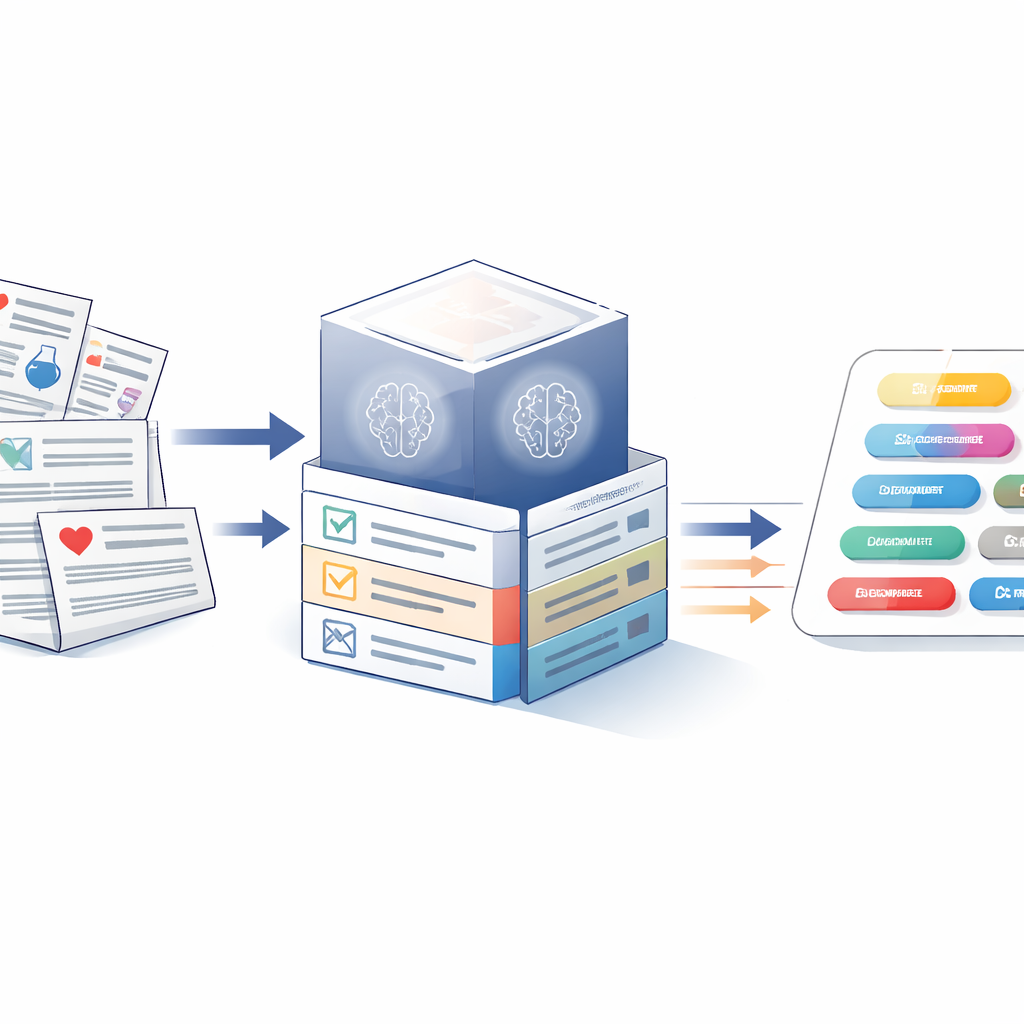

Construindo instruções melhores para modelos de linguagem

A primeira parte do trabalho projeta um prompt “estático” altamente estruturado — um bloco reutilizável de instruções e exemplos apresentado ao modelo para cada sentença que deve rotular. Em vez de simplesmente pedir ao modelo que marque entidades, o prompt é dividido em seis elementos: uma descrição clara da tarefa e definições dos tipos de entidade; uma breve descrição da origem e do tema do conjunto de dados; palavras de alta frequência típicas de cada entidade; conhecimento médico de fundo opcional; feedback resumido de erros anteriores do modelo; e um punhado de sentenças totalmente anotadas. A equipe testou esse framework com três grandes modelos de linguagem — GPT-3.5, GPT-4 e LLaMA 3-70B — em cinco conjuntos de dados biomédicos abrangendo prontuários clínicos, resumos científicos e postagens do Reddit sobre uso de opioides. A sobreposição cuidadosa desses componentes elevou as pontuações F1 (um equilíbrio entre precisão e recall) em cerca de 11–12 pontos percentuais em relação a um prompt básico, com o GPT-4 alcançando o melhor desempenho geral.

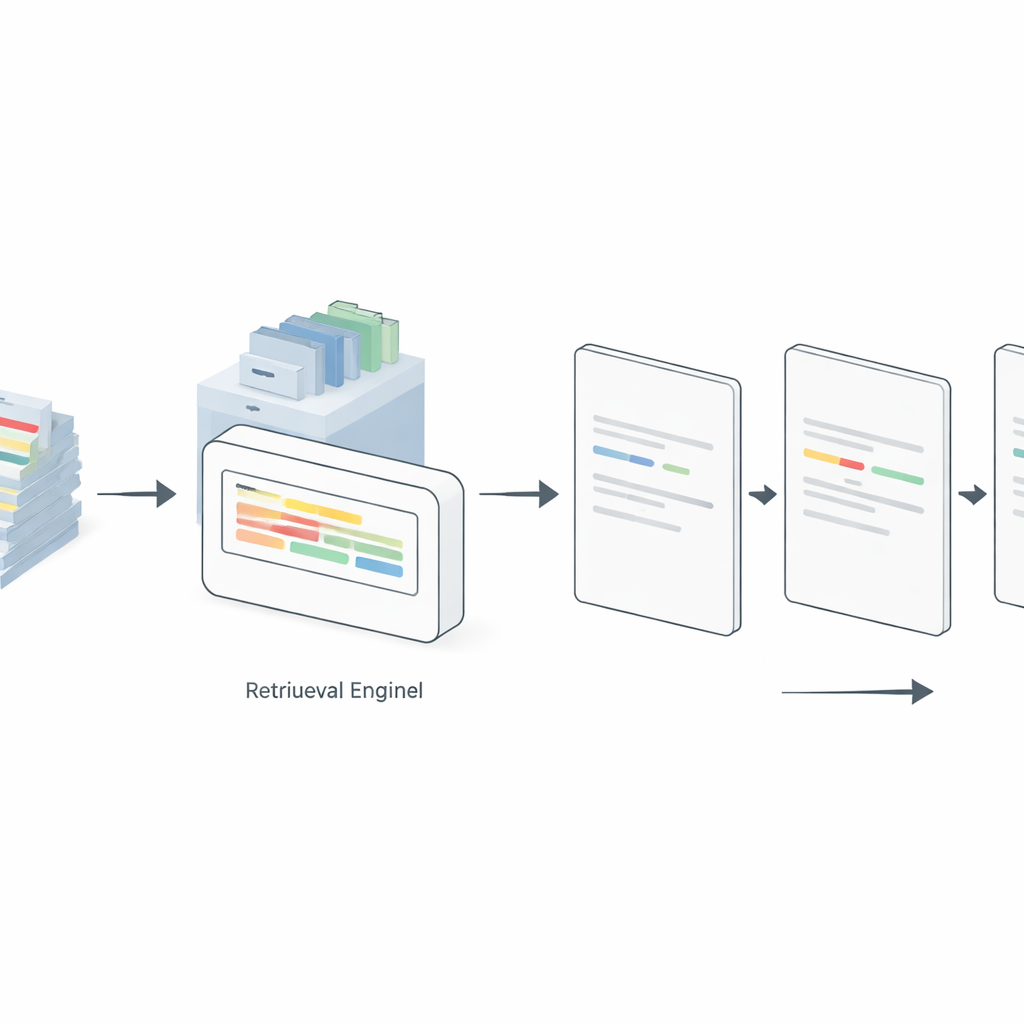

Permitindo que o modelo busque exemplos melhores em tempo real

No entanto, prompts estáticos sempre mostram os mesmos exemplos, mesmo quando eles não combinam bem com a nova sentença a ser rotulada. Para resolver isso, os autores introduzem uma estratégia de prompting “dinâmico” alimentada por geração aumentada por recuperação. Aqui, um mecanismo de recuperação separado indexa todos os exemplos anotados disponíveis. Para cada nova sentença de entrada, o sistema busca nesse conjunto os trechos anotados mais similares e insere apenas esses no prompt. O estudo compara vários métodos de recuperação, desde um esquema simples de frequência de termos (TF–IDF) até modelos de embedding neural, como Sentence-BERT (SBERT), ColBERT e Dense Passage Retrieval. Entre GPT-4, LLaMA 3 e um modelo de peso aberto chamado GPT-OSS-120B, selecionar dinamicamente exemplos relevantes superou consistentemente o prompting estático em configurações de 5, 10 e 20 shots. Surpreendentemente, o método simples TF–IDF frequentemente igualou ou superou abordagens mais complexas, especialmente em conjuntos de dados mais limpos e padronizados, enquanto o SBERT se destacou em textos mais ruidosos de mídias sociais.

Extraindo mais de menos exemplos rotulados

Como anotar texto médico é caro, os autores também investigaram quantos exemplos rotulados o mecanismo de recuperação precisa indexar para ser útil. Usando o LLaMA 3-70B, eles variaram o conjunto de recuperação de 50 exemplos até o conjunto de treinamento inteiro. O desempenho geralmente melhorou à medida que a base crescia, mas os ganhos se estabilizaram rapidamente: conjuntos de cerca de 100–200 exemplos alcançaram quase a mesma acurácia que indexar todos os dados disponíveis, muitas vezes dentro da margem de erro estatístico. Em alguns casos, bases extremamente grandes prejudicaram ligeiramente o desempenho, provavelmente porque introduziram mais exemplos irrelevantes ou confusos e alongaram o prompt. Essas descobertas sugerem que, quando pareado com um modelo de linguagem forte e prompts bem projetados, esforços de anotação modestos podem gerar reconhecimento robusto de entidades biomédicas, tornando a abordagem viável para doenças raras, novos conceitos clínicos ou instituições com recursos limitados.

O que isso significa para a medicina no mundo real

Em resumo, o estudo mostra que grandes modelos de linguagem podem identificar de forma confiável conceitos médicos importantes em textos usando apenas um punhado de exemplos anotados, desde que sejam guiados por prompts estruturados e um sistema de recuperação que traga os casos prévios mais relevantes. O GPT-4 oferece o melhor desempenho geral, enquanto modelos abertos e menores ainda se beneficiam substancialmente da mesma receita de prompting e recuperação. Para os praticantes, isso significa que não é necessário construir conjuntos de dados massivos sempre que um novo tipo de entidade ou preocupação de saúde surge; um conjunto compacto e cuidadosamente selecionado de exemplos, mais prompting inteligente, pode ser suficiente. À medida que os sistemas de saúde continuam a digitalizar notas e pacientes compartilham suas experiências online, essas ferramentas eficientes e adaptáveis podem facilitar muito a extração de conhecimento clinicamente útil do vasto e desordenado mundo do texto médico.

Citação: Ge, Y., Guo, Y., Das, S. et al. Improving few-shot named entity recognition for large language models using structured dynamic prompting with retrieval augmented generation. npj Artif. Intell. 2, 39 (2026). https://doi.org/10.1038/s44387-025-00062-2

Palavras-chave: reconhecimento de entidades nomeadas biomédicas, aprendizado few-shot, grandes modelos de linguagem, geração aumentada por recuperação, mineração de texto clínico