Clear Sky Science · pt

Análise de equidade das previsões de agressão por aprendizado de máquina em atendimento psiquiátrico agudo

Por que isso importa para pessoas reais

Hospitais estão recorrendo à inteligência artificial para identificar quais pacientes podem se tornar agressivos, na esperança de prevenir danos sem recorrer a contenções traumáticas. Mas se essas ferramentas de previsão forem injustas, elas podem agravar as desigualdades que já influenciam quem é visto como “perigoso”. Este estudo faz uma pergunta urgente: quando uma máquina ajuda a decidir quem é de alto risco em uma unidade psiquiátrica, ela trata todos os pacientes de forma igual?

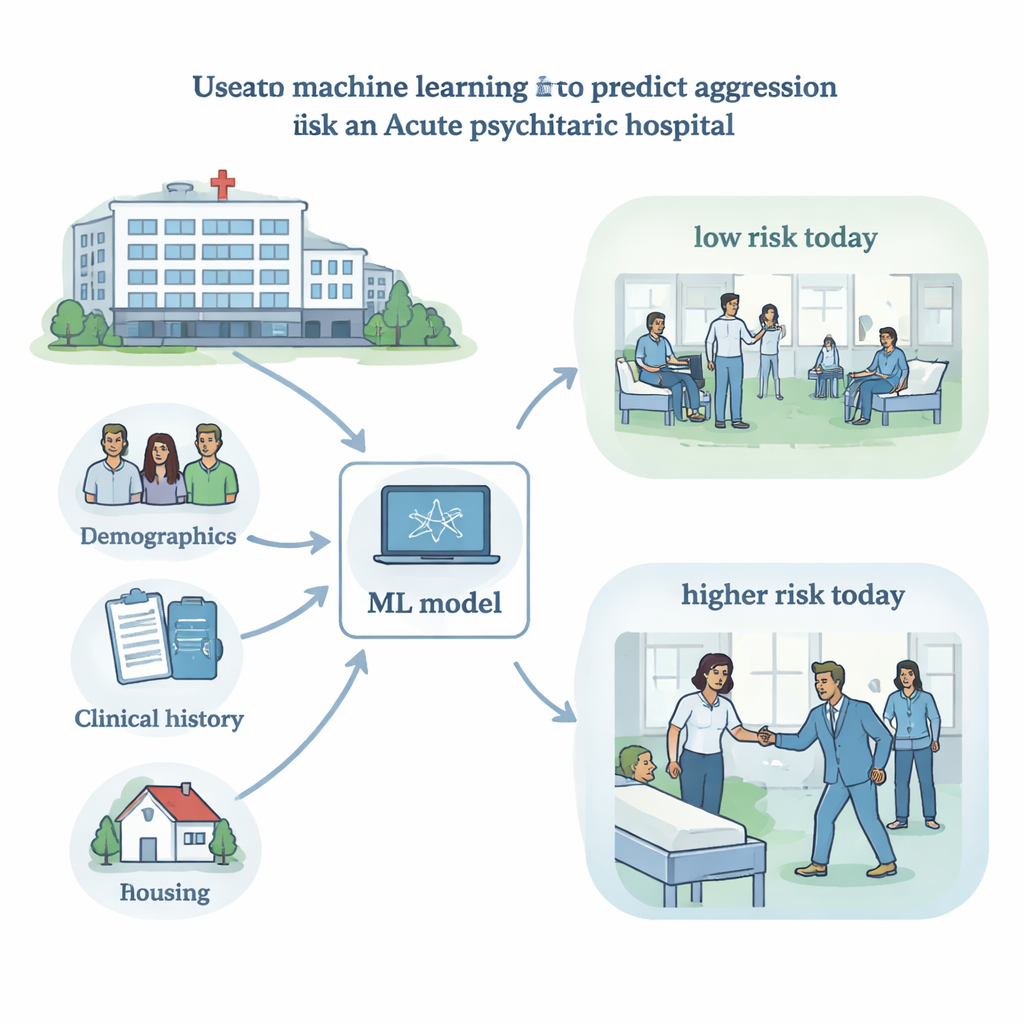

Usando dados hospitalares para sinalizar risco de curto prazo

Pesquisadores analisaram prontuários de mais de 17.000 pacientes tratados em unidades psiquiátricas agudas de um grande hospital psiquiátrico canadense entre 2016 e 2022. Para cada um de até três dias durante a internação, a equipe registrava uma lista de verificação padrão à beira do leito chamada Dynamic Appraisal of Situational Aggression (DASA), que avalia comportamentos como irritabilidade ou ameaças verbais que podem indicar agressão iminente. O grupo combinou essas pontuações com informações coletadas na admissão, como diagnóstico, idade, gênero, raça ou etnia, situação de moradia e como a pessoa chegou ao hospital, para treinar um modelo de aprendizado de máquina que previa se o paciente estaria envolvido em um incidente de agressão (incluindo uso de contenção ou isolamento) nas próximas 24 horas.

Como a ferramenta de previsão se saiu no geral

O sistema com melhor desempenho usou um método popular de aprendizado de máquina chamado random forest. Em dados de teste mantidos à parte, ele classificou corretamente dias de maior risco grande parte do tempo, atingindo uma “área sob a curva” de cerca de 0,81, comparável a ferramentas semelhantes em psiquiatria. Contudo, a agressão era rara — havia aproximadamente 33 dias sem incidentes para cada dia com um — então o modelo ainda deixou de prever muitos eventos verdadeiros e gerou alguns falsos positivos. Medidas de importância mostraram que fatores clínicos momento a momento, especialmente itens do DASA como irritabilidade e incidentes recentes prévios, contribuíram mais fortemente para as previsões do que apenas características demográficas. Isso significa que o modelo captou sinais clínicos relevantes, mas métricas de desempenho por si só não revelaram se ele era igualmente confiável para todos.

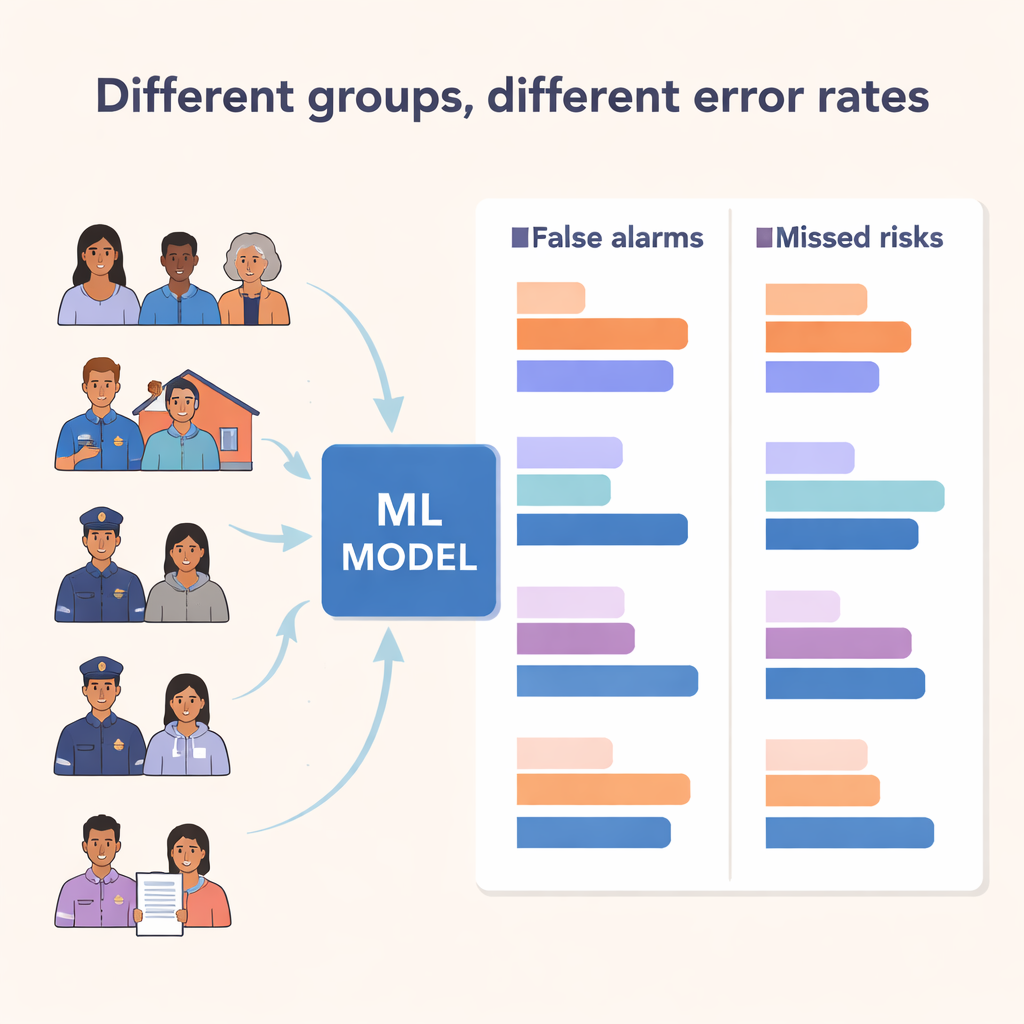

Erros desiguais entre diferentes grupos

O cerne do estudo foi uma checagem de equidade. A equipe focou em dois tipos de erro: falsos positivos, quando o modelo sinaliza risco mas nada acontece, e verdadeiros positivos, quando antecipa corretamente um incidente. Um modelo justo, segundo um padrão comumente usado chamado “probabilidades igualizadas” (equalized odds), deveria ter taxas similares de falsos positivos e verdadeiros positivos entre os grupos. Em vez disso, os pesquisadores encontraram grandes diferenças. Falsos positivos foram mais frequentes entre pacientes de origem do Oriente Médio e negros, homens, pessoas levadas ao hospital pela polícia e aqueles sem moradia ou em moradia assistida. Alguns grupos — como pacientes admitidos pela polícia ou com moradia instável — apresentaram tanto taxas maiores de detecção quanto mais falsos alarmes, sugerindo que o modelo foi ajustado para ser extra sensível a eles. Outros, como pacientes negros, experimentaram uma combinação preocupante: mais falsos alarmes e menor capacidade de identificar corretamente riscos reais.

Quando identidades se sobrepõem, as lacunas aumentam

Como as experiências das pessoas são moldadas por mais de uma característica ao mesmo tempo, os pesquisadores também examinaram identidades sobrepostas, particularmente a combinação de raça ou etnia com gênero. Aqui, o maior sinal de alerta apareceu entre homens do Oriente Médio, que tiveram a maior taxa de falsos positivos de todos os grupos, enquanto mulheres do Oriente Médio não apresentaram esse padrão. Homens negros e indígenas também enfrentaram falsos positivos elevados em comparação com mulheres da mesma origem. Esses padrões ecoam desigualdades bem documentadas no cuidado em saúde mental, como taxas maiores de intervenção policial, internação involuntária e diagnóstico equivocado entre determinados grupos racializados e entre homens. O sistema de aprendizado de máquina não criou essas desigualdades, mas aprendeu a partir de dados imersos nelas — e correu o risco de amplificá‑las nas decisões clínicas.

O que isso significa para o futuro da IA em psiquiatria

Os autores defendem que a análise de equidade deve ser tratada como uma verificação básica de segurança, não um extra opcional, antes de qualquer ferramenta preditiva ser colocada em prática. Observam que métodos técnicos de “desenviesamento” — como ajustar dados de treinamento ou definir limiares de alerta diferentes para grupos distintos — podem ajudar, mas são limitados se os registros subjacentes já refletem tratamento desigual e práticas coercitivas. Em última análise, decidir o que conta como um modelo “justo” não é apenas um problema matemático; é uma questão social e ética que exige consulta a pacientes, clínicos e comunidades. Este estudo mostra que, embora o aprendizado de máquina possa ajudar a identificar risco de agressão em curto prazo, ele também pode reproduzir silenciosamente racismo estrutural, sexismo e desigualdades habitacionais a menos que a equidade seja rigorosamente medida, debatida e abordada.

Citação: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Palavras-chave: equidade algorítmica, agressão psiquiátrica, aprendizado de máquina na saúde, injustiças em saúde, modelos de predição de risco