Clear Sky Science · pt

Todos os olhos, sem IMU: aprendendo atitude de voo apenas pela visão

Vendo como um inseto

Pequenos robôs voadores normalmente dependem de minúsculos sensores de movimento para se manterem estáveis, algo como um ouvido interno para máquinas. Mas insetos executam voos ágeis com hardware bem mais simples, apoiando‑se fortemente no que veem. Este estudo mostra que um drone pode fazer algo semelhante: voar de forma estável usando apenas um tipo especial de câmera e um cérebro artificial compacto, sem os sensores de movimento habituais. Essa mudança pode tornar drones do tamanho da palma da mão e em escala de inseto mais leves, baratos e resistentes.

Por que eliminar os sensores habituais?

O controle de atitude — manter o drone corretamente inclinado em relação à gravidade — é normalmente feito por uma unidade a bordo que mede aceleração e rotação. Esses sensores inerciais funcionam bem, mas adicionam peso, consomem energia e podem ser um ponto único de falha. Em contraste, muitos insetos voadores não têm um sensor de gravidade dedicado e, em vez disso, extraem pistas sobre sua inclinação a partir de como o mundo se move através dos olhos. Se robôs pudessem copiar esse truque, voadores muito pequenos poderiam precisar apenas da visão tanto para enxergar quanto para equilibrar, simplificando o projeto e facilitando miniaturizá‑los até o tamanho de insetos.

Uma câmera que só enxerga mudança

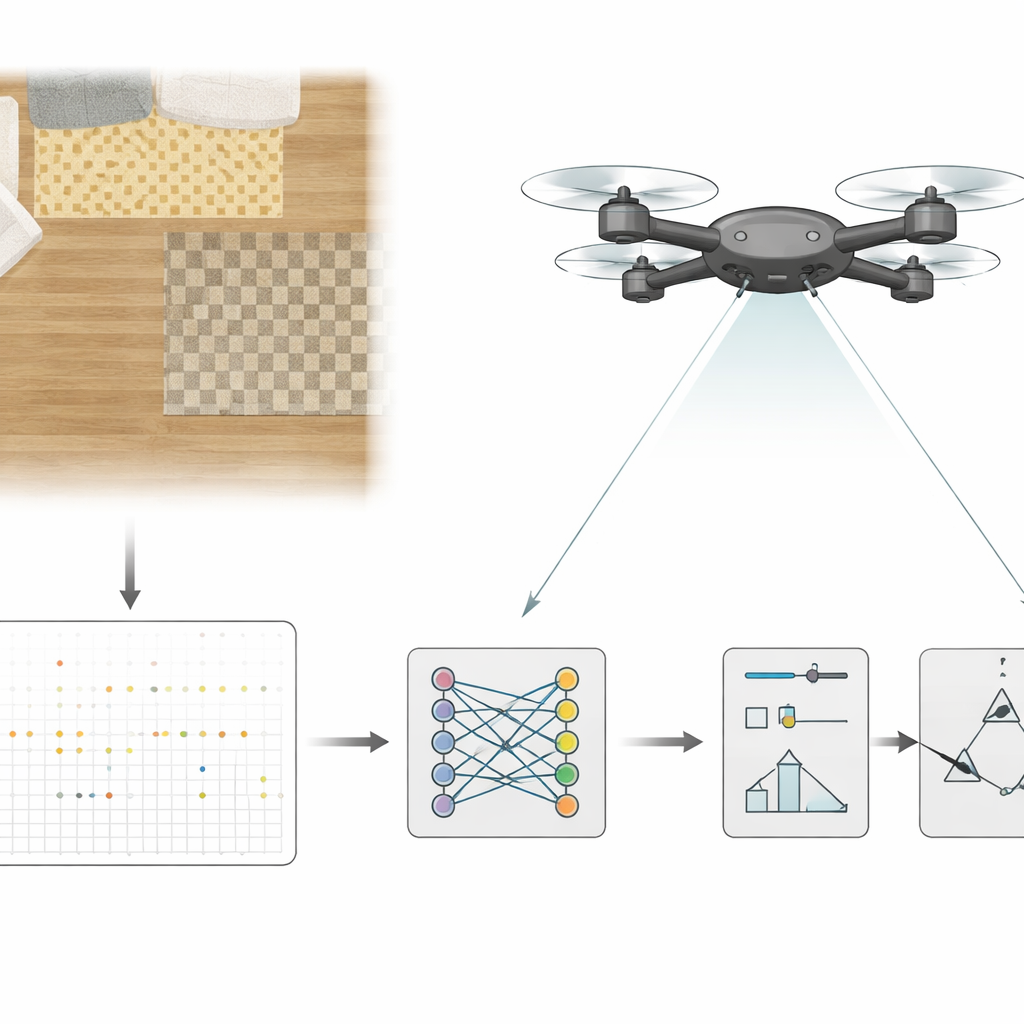

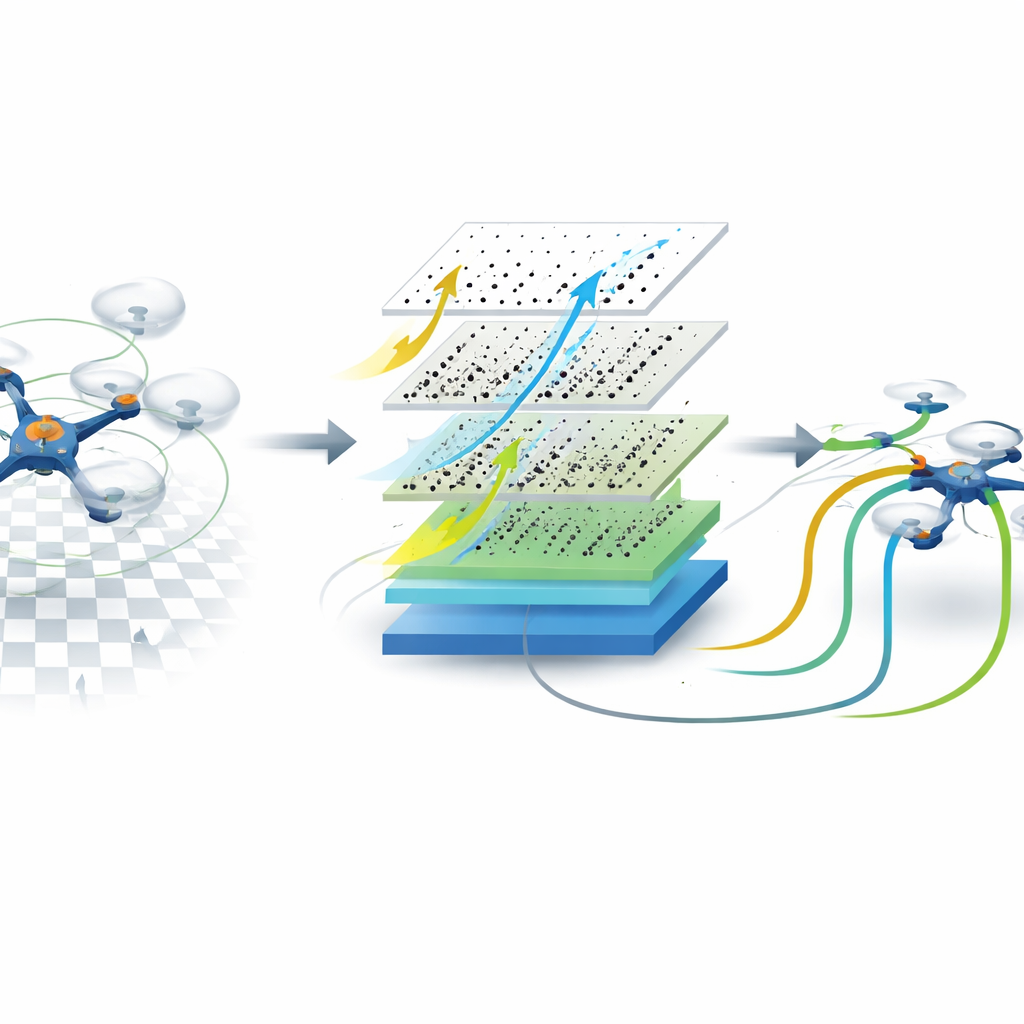

Em vez de uma câmera de vídeo padrão, os pesquisadores usam uma câmera baseada em eventos apontada para baixo a partir do drone. Em vez de enviar imagens completas em intervalos fixos, esse sensor reporta apenas pequenas mudanças de brilho em cada pixel, e o faz extremamente rápido. O fluxo de eventos é agrupado em fatias breves, cada uma cobrindo apenas cinco milésimos de segundo, e essas fatias são alimentadas a uma pequena rede neural convolucional recorrente rodando em um chip gráfico a bordo. Ao longo do tempo, a rede aprende a transformar padrões de mudança visual em estimativas da inclinação do drone e de quão rápido ele está girando, substituindo efetivamente a unidade de movimento tradicional no laço de controle.

Ensinando um drone a equilibrar só com visão

Para treinar esse cérebro artificial, a equipe primeiro voou seu quadrotor em uma arena interna enquanto ainda usava um conjunto convencional de sensores. Durante esses voos eles registraram o fluxo de eventos da câmera junto com os valores de inclinação e rotação estimados pelo controlador padrão. Em seguida, treinaram a rede, sob supervisão, para reproduzir esses valores apenas a partir dos dados visuais. Em testes posteriores, os papéis foram invertidos: o drone voou com as estimativas da rede fechando o laço, enquanto medições independentes de captura de movimento ou medições a bordo serviram apenas para avaliar o desempenho. O sistema manteve o drone pairando e seguindo trajetórias comandadas pelo piloto por minutos a fio, com a maioria dos erros de inclinação dentro de alguns graus e erros de rotação dentro de limites modestos, suficientes para voo estável.

Investigando a habilidade visual aprendida

Os pesquisadores sondaram o que faz esse controle apenas por visão funcionar melhor. Compararam diferentes projetos de rede, adicionaram ou removeram entradas extras como velocidades dos motores ou sinais de giroscópio, e variaram quanto do campo de visão da câmera era usado. Redes com memória — capazes de integrar informação visual ao longo do tempo — foram cruciais para seguir com precisão rotações rápidas, enquanto versões sem memória tiveram dificuldades. Um campo de visão amplo, que expõe pistas semelhantes ao horizonte nas bordas da imagem, apresentou os menores erros brutos em cenas familiares. Surpreendentemente, porém, forçar a rede a olhar apenas a parte central da imagem, onde tais pistas estáticas estão ausentes, fez com que ela dependesse mais de padrões de movimento em vez da aparência da cena. Embora isso reduzisse a precisão absoluta, melhorou a forma como o sistema se adaptava quando transferido para ambientes muito diferentes, sugerindo que uma sensação interna de movimento estava sendo aprendida.

Rumo a robôs voadores minúsculos, com visão em primeiro lugar

No geral, o trabalho mostra que um drone pode manter‑se ereto e controlável usando apenas o que vê, sem sensor inercial no laço. Ao emparelhar uma câmera de eventos com uma rede neural compacta, o sistema alcança a velocidade e a capacidade de resposta necessárias para controle em tempo real enquanto reduz peso e complexidade do hardware. Para leitores em geral, a mensagem principal é que futuras enxames de robôs voadores minúsculos, semelhantes a insetos, poderão equilibrar‑se e navegar usando um único olho inteligente, assim como os insetos, abrindo caminho para máquinas mais leves, energeticamente eficientes e capazes de explorar com segurança espaços confusos e imprevisíveis.

Citação: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Palavras-chave: controle de voo baseado em visão, drones com câmera de eventos, robótica bioinspirada, controladores por rede neural, VANTs em escala de inseto