Clear Sky Science · pt

Armamento acústico em tempo real facilitado por aprendizado de máquina em ambientes multi-meio de variação temporal rumo à manipulação de microbolhas guiada por ressonância magnética

Guiando pequenos transportadores de fármacos com som e imagens

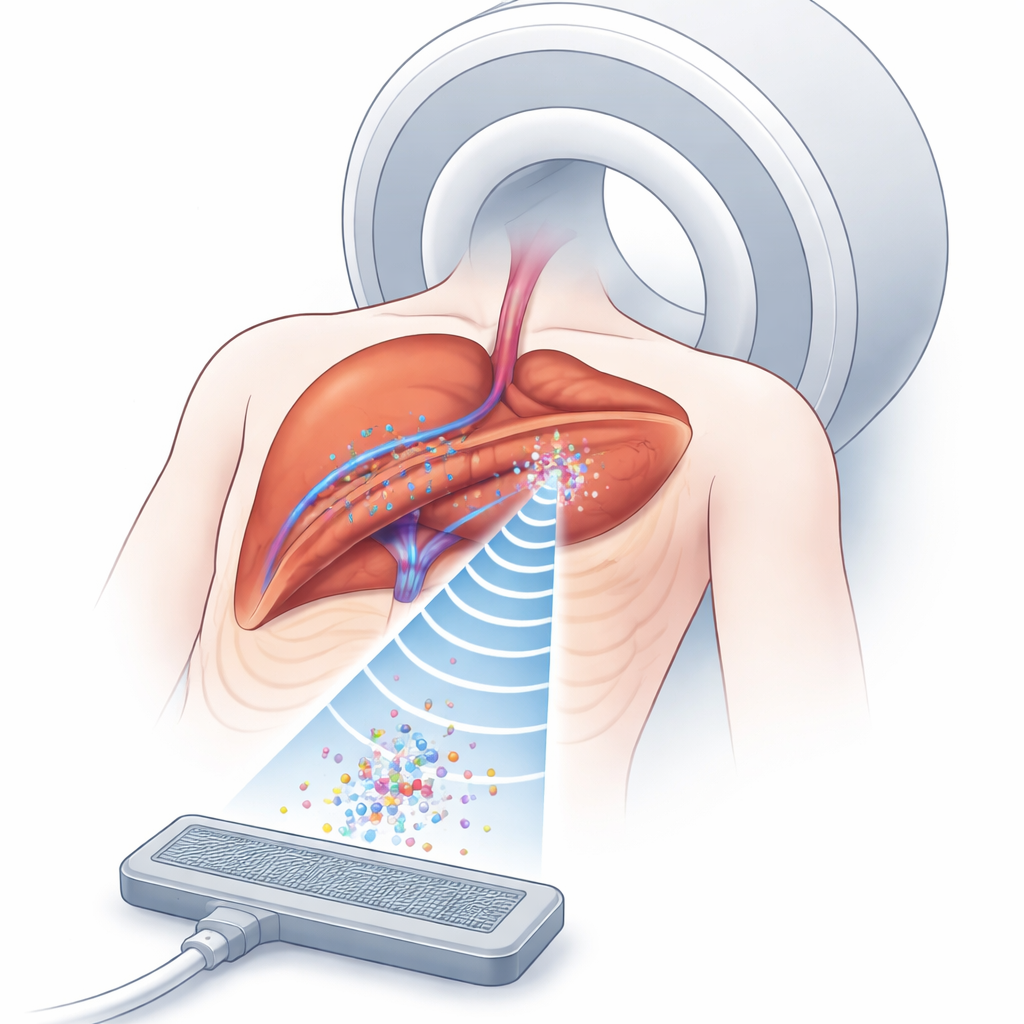

Tratamentos modernos contra o câncer dependem cada vez mais de transportadores inteligentes que entregam medicamentos diretamente aos tumores, poupando o tecido saudável. Este estudo explora um método futurista para dirigir esses transportadores dentro do corpo usando “armadilhas” de ultrassom guiadas por imagens de ressonância magnética (RM). Ao combinar ondas sonoras, imagem médica e aprendizado de máquina, os pesquisadores visam manter microbolhas microscópicas carregadas com fármacos estacionadas perto de tumores em movimento, mesmo com os deslocamentos causados pela respiração.

Por que prender microbolhas microscópicas é importante

Microbolhas carregadoras de fármacos circulam pelos vasos sanguíneos e podem liberar sua carga quando ativadas por ultrassom. O desafio é manter bolhas suficientes no lugar correto, por tempo suficiente, em regiões profundas do corpo. O ultrassom pode criar bolsões invisíveis de força — armadilhas acústicas — que seguram pequenos objetos em um meio fluido sem contato. A RM, por sua vez, consegue visualizar tanto o tecido quanto o padrão dos efeitos do ultrassom, mesmo dentro de órgãos. Juntar essas duas ferramentas oferece uma maneira de concentrar transportadores de fármacos ao redor de tumores com mais precisão do que apenas os medicamentos. Mas em pacientes reais, tecidos de diferentes tipos — gordura, músculo, órgãos e pulmões em movimento — desviam e distorcem as ondas sonoras, tornando muito difícil formar e manter uma armadilha estável exatamente na localização do tumor.

O problema de um corpo em camadas e em movimento

Em cenários simples como ar ou água, engenheiros já sabem como usar arranjos phased de emissores de ultrassom para empurrar, puxar e girar objetos minúsculos. Dentro do corpo, porém, o som precisa atravessar múltiplas camadas com densidades e velocidades diferentes, e as interfaces entre elas causam refração e distorção. Métodos computacionais tradicionais podem, em princípio, corrigir isso calculando quanto tempo o som leva para viajar de cada emissor até o ponto alvo. Mas tais abordagens subdividem o corpo em milhões de pequenos blocos e simulam a propagação de ondas por cada um — um processo extremamente demorado que só funciona se os tecidos permanecerem quase perfeitamente imóveis. Só a respiração pode deslocar tecidos abdominais por vários milímetros, tornando rapidamente qualquer solução pré-computada obsoleta.

Treinando um modelo para prever trajetórias do som

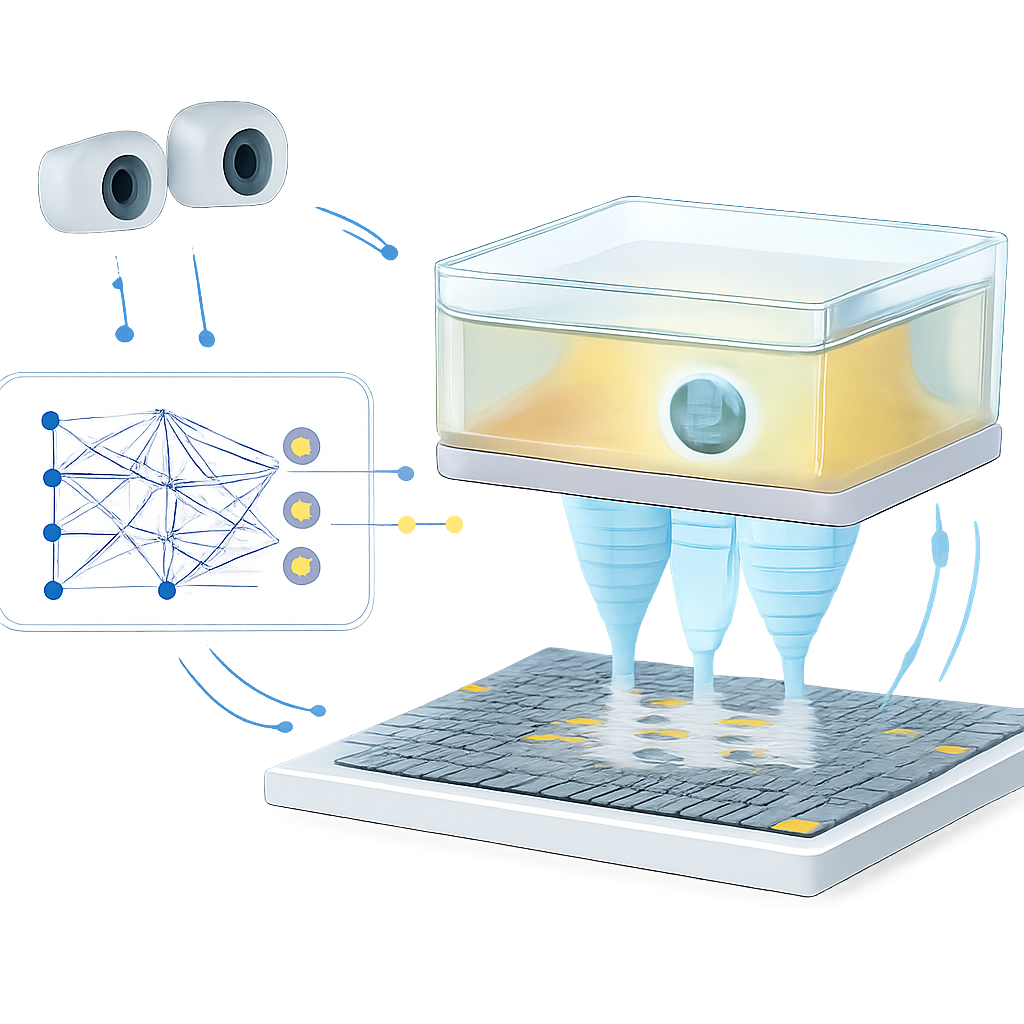

Os autores atacam esse gargalo com um modelo baseado em aprendizado que funciona como um atalho rápido: em vez de simular ondas sonoras a cada instante, eles treinam uma rede neural para prever quanto tempo cada pulso de ultrassom precisa para atingir um ponto alvo. Primeiro, constroem um ambiente virtual detalhado usando uma câmara preenchida de gás separada do ar por um filme plástico fino, imitando como o som passa por diferentes camadas de tecido. Com um simulador baseado em física, geram um conjunto de treinamento de tempos de viagem do som entre muitos alvos e um arranjo de ultrassom 14 por 14. Também permitem que a câmara se desloque em duas direções para imitar movimento, descrevendo sua posição por meio de três marcadores visuais, de modo semelhante a como marcadores visíveis por RM rastreariam a respiração de um paciente. A rede treinada aprende a mapear a posição desejada da armadilha mais a pose da câmara diretamente para o padrão de temporização necessário para os 196 emissores, alcançando precisão ao nível de microssegundos em cerca de 26 milissegundos.

Fechando o ciclo com visão e atualizações rápidas

Velocidade por si só não basta; a armadilha também precisa se adaptar quando o ambiente muda inesperadamente. Para demonstrar isso, a equipe constrói um sistema de controle em malha fechada. Câmeras estéreo observam uma pequena esfera de poliestireno mantida em suspensão pela armadilha acústica dentro da câmara em movimento. Quando a esfera deriva do alvo além de um limite pré-estabelecido, o sistema ajusta levemente a posição alvo, alimenta as coordenadas atualizadas e a pose da câmara no modelo de aprendizado e atualiza rapidamente o padrão de fase que dirige o arranjo. Em experimentos, o sistema consegue atualizar o padrão de fase até 15 vezes por segundo, guiando a esfera por trajetórias em forma de H, K e U com erro médio de cerca de 1 milímetro — comparável à precisão de posicionamento de alguns sistemas clínicos de ultrassom focalizado. O mesmo princípio de realimentação também reduz o tempo em que a esfera fica fora da posição pretendida quando a câmara se move, mostrando que o ciclo de controle pode compensar movimento e efeitos não modelados do filme plástico e da estrutura de suporte.

O que isso significa para tratamentos futuros

Para um público não especializado, a mensagem central é que os pesquisadores construíram uma espécie de “feixe de trator” remoto e sem contato que um dia poderia estacionar bolhas carregadas de fármacos perto de um tumor e mantê-las lá mesmo com a respiração do paciente. O modelo de aprendizado de máquina substitui simulações pesadas por um preditor rápido, enquanto câmeras (e, futuramente, marcadores visíveis por RM) informam ao sistema como o corpo está se movendo para que a armadilha seja reajustada em tempo real. Embora o trabalho atual use ar, gases e plástico em vez de tecidos reais, e levite uma esfera plástica em vez de microbolhas verdadeiras, ele demonstra controle em tempo real em um meio em camadas e em movimento. Com hardware mais potente, frequências de ultrassom mais altas e rastreamento de movimento baseado em RM, essa abordagem poderia evoluir para uma ferramenta clínica para terapias por ultrassom assistidas por robô e guiadas por RM que entregam fármacos de forma mais precisa e segura em regiões profundas do corpo.

Citação: Wu, M., Li, X. & Tang, T. Machine learning-facilitated real-time acoustic trapping in time-varying multi-medium environments toward magnetic resonance imaging-guided microbubble manipulation. Commun Eng 5, 52 (2026). https://doi.org/10.1038/s44172-026-00600-z

Palavras-chave: armamento acústico, terapia guiada por RM, liberação de fármaco por microbolhas, aprendizado de máquina em ultrassom, manipulação robótica não invasiva