Clear Sky Science · pt

Inferência baseada em simulação para física de neutrinos de alta precisão por meio de ajuste Monte Carlo com redes neurais

Ajustando os “olhos” dos telescópios de neutrinos

Experimentos futuros de neutrinos visam responder grandes questões sobre o universo, como a ordem de massas dos diminutos neutrinos e o mecanismo de explosão de estrelas. Para isso, seus detectores gigantes devem medir energia com precisão excepcional — muito além do que fórmulas didáticas simples conseguem oferecer. Este artigo mostra como ferramentas modernas de aprendizado de máquina podem ajudar a ajustar e validar as simulações complexas que conectam o que acontece dentro de um detector aos flashes de luz que realmente registramos.

Por que entender a resposta do detector é tão difícil

Em experimentos como o Jiangmen Underground Neutrino Observatory (JUNO), na China, neutrinos interagem em um enorme tanque de líquido que produz luz quando partículas atravessam. Essa luz é coletada por milhares de fotomultiplicadoras como pequenos pulsos elétricos, contados como “fótons-equivalentes” (photo-electrons). O desafio é converter essas contagens de volta para a energia original da partícula. Na prática, essa relação não é uma linha reta: depende da geometria do detector, do comportamento do líquido e de vários efeitos físicos interligados. Abordagens tradicionais dependiam de ajuste manual dos parâmetros da simulação até que os espectros simulados se parecessem, em termos gerais, com os dados de calibração — um método que se torna impraticável para experimentos modernos de alta precisão.

Ensinando redes neurais a emular o simulador

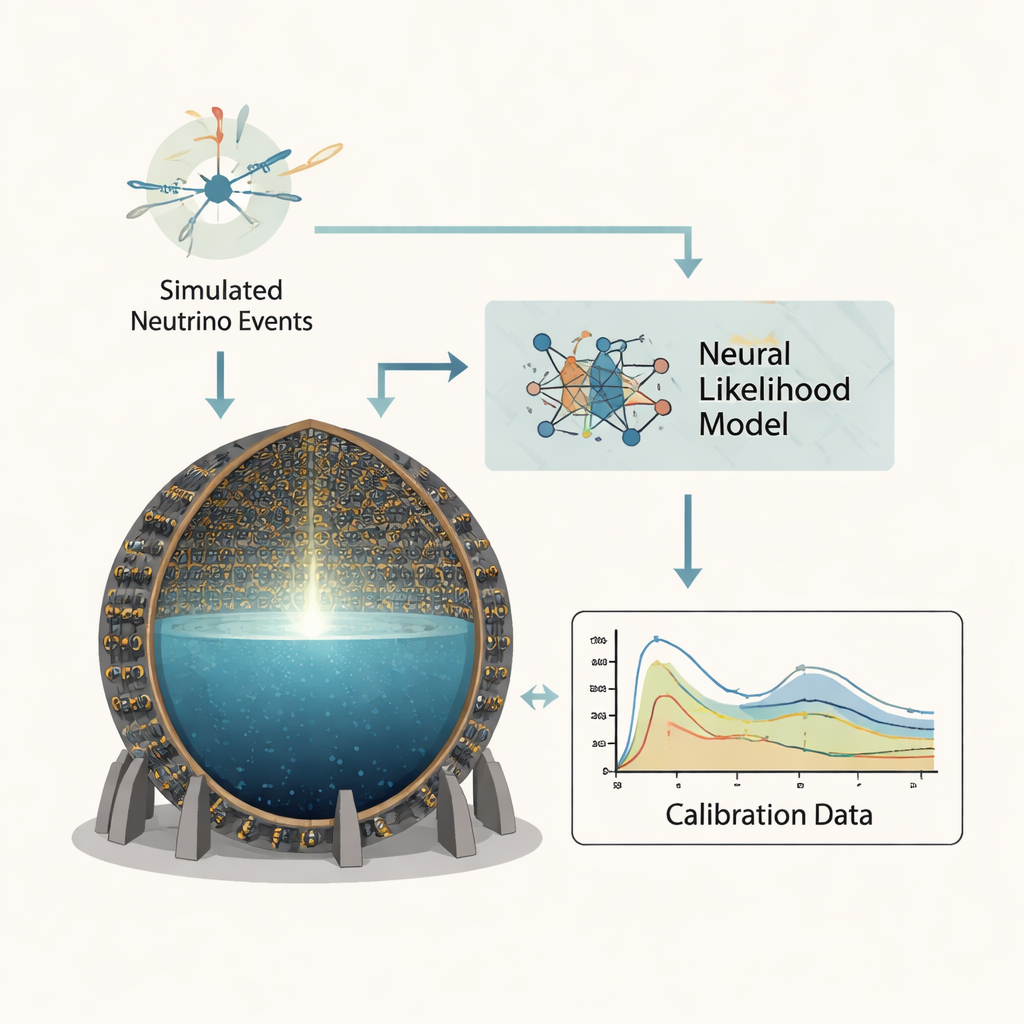

Os autores adotam uma estratégia conhecida como inferência baseada em simulação, em que, ao invés de tentar escrever uma fórmula matemática exata para a resposta do detector, deixam que as simulações e as redes neurais façam o trabalho pesado. Eles se concentram em três parâmetros-chave que governam como o JUNO converte energia verdadeira em luz detectada: um coeficiente que descreve como a produção de luz é “quenchada” em densidades de ionização elevadas, um rendimento de luz global que define o brilho médio, e um fator que controla a quantidade de luz de Cherenkov. Usando o software Monte Carlo oficial do JUNO, geraram cerca de um bilhão de eventos de calibração simulados a partir de cinco fontes radioativas posicionadas no centro do detector, cada evento resumido por um único número: a luz total coletada. Isso forma o conjunto de treinamento para redes neurais que aprendem quão provável é qualquer sinal de luz, para qualquer escolha dos três parâmetros.

DuAS lentes complementares de aprendizado de máquina

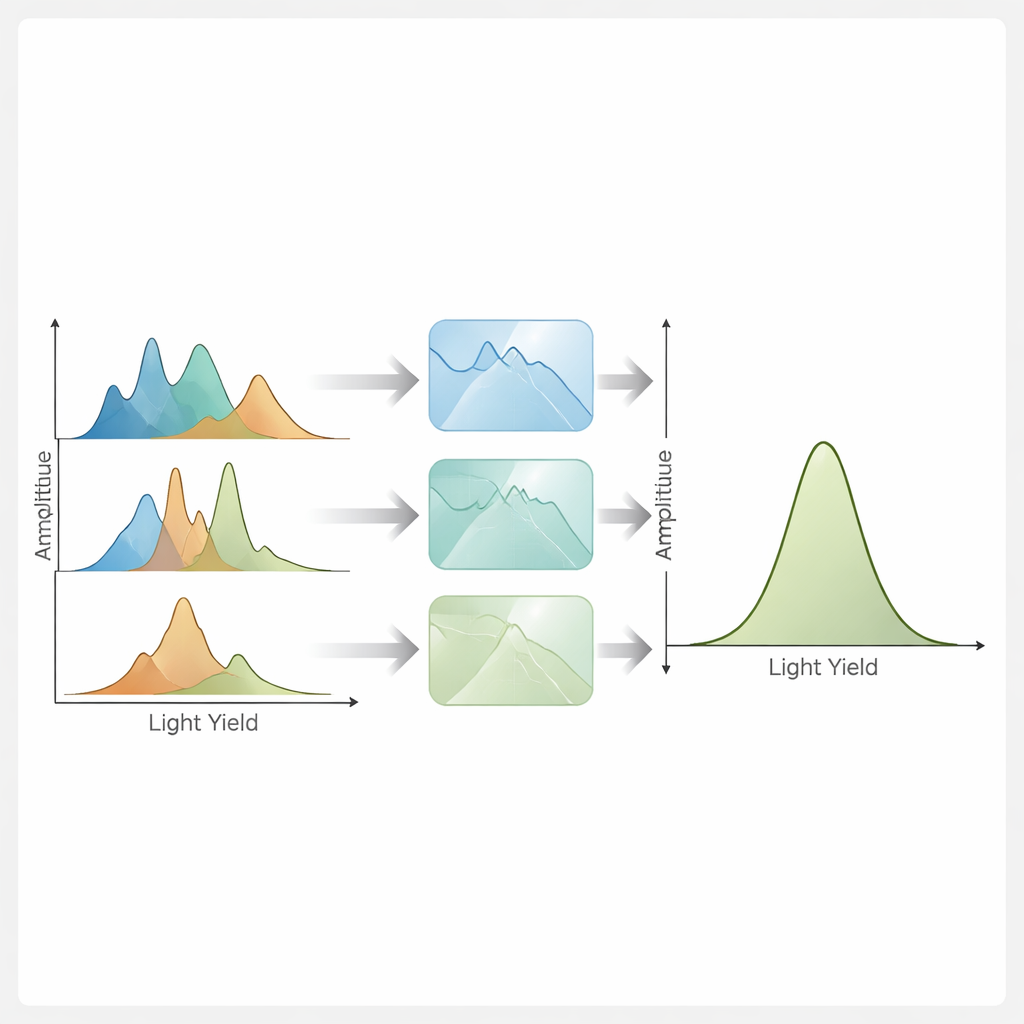

A equipe desenvolve dois “estimadores de verossimilhança” neurais complementares que aproximam a probabilidade de observar um dado sinal de luz para configurações específicas do detector. O primeiro, chamado Transformer Encoder Density Estimator, usa uma arquitetura transformer — a mesma família de modelos por trás de muitas ferramentas de linguagem — para prever diretamente um histograma finamente segmentado do espectro de luz para cada combinação de parâmetros e fonte. Isso apoia naturalmente análises estatísticas tradicionais por bins. O segundo, chamado Normalizing Flows Density Estimator, usa uma cadeia de transformações invertíveis para mapear os espectros complicados e com múltiplos picos em uma distribuição simples em forma de sino. Como essas transformações são matematicamente controladas, o método pode avaliar a probabilidade exata para cada evento não binned, possibilitando análises que usam toda a informação disponível nos dados.

Verificando precisão, exatidão e robustez

Para provar que essas ferramentas neurais são confiáveis, os autores as submetem a testes rigorosos. Primeiro, verificam se os modelos conseguem reproduzir os espectros simulados em milhares de combinações dos três parâmetros, usando várias distâncias estatísticas que comparam distribuições previstas e “verdadeiras”. Ambos os métodos seguem picos agudos e características espectrais sutis extremamente bem, com discrepâncias na ordem de poucos milésimos. Em seguida, inserem as verossimilhanças aprendidas em motores estatísticos estabelecidos — amostragem aninhada bayesiana, Markov chain Monte Carlo e minimização clássica — para recuperar os parâmetros originais da simulação a partir de conjuntos de dados simulados. Em uma ampla gama de valores de parâmetros e estatísticas de eventos, os parâmetros recuperados são não-viesados e as incertezas declaradas correspondem à dispersão real dos resultados. As incertezas diminuem com mais dados exatamente como esperado pela estatística básica de contagem, e os métodos capturam fielmente fortes correlações entre os parâmetros.

De meses de computação para segundos

Um resultado marcante é a aceleração computacional. Rodar simulações completas do detector com eventos suficientes para caracterizar cada ponto de parâmetro pode levar muitas horas por configuração em um processador convencional. Uma vez treinado, contudo, o modelo transformer pode gerar um espectro previsto em poucos milissegundos, e o modelo de normalizing flows pode avaliar probabilidades para dezenas de milhares de eventos em bem menos que um décimo de segundo. Isso torna realista vasculhar grandes espaços de parâmetros e quantificar incertezas sistemáticas que, de outra forma, seriam proibitivamente custosas, abrindo caminho para calibrações de detector mais detalhadas e confiáveis.

O que isso significa para experimentos futuros de neutrinos

Para não especialistas, a mensagem central é que este trabalho transforma simulações de detector complicadas e lentas em substitutos rápidos e precisos sem sacrificar o significado físico. Os três parâmetros ajustados ainda correspondem diretamente a propriedades reais do detector e do líquido, de modo que os resultados permanecem interpretáveis para os físicos. O estudo mostra que ambas as abordagens neurais conseguem determinar esses parâmetros com vieses extremamente pequenos e erros limitados principalmente pela quantidade de dados disponível. À medida que experimentos futuros como JUNO, DUNE e Hyper-Kamiokande avançam rumo a precisão subporcentual em medidas de neutrinos, métodos como estes serão essenciais para garantir que o que inferimos sobre o universo não seja limitado pelo quanto entendemos nossos detectores.

Citação: Gavrikov, A., Serafini, A., Dolzhikov, D. et al. Simulation-based inference for precision neutrino physics through neural Monte Carlo tuning. Commun Phys 9, 63 (2026). https://doi.org/10.1038/s42005-026-02499-6

Palavras-chave: detectores de neutrinos, aprendizado de máquina, ajuste Monte Carlo, fluxos normalizantes, inferência baseada em simulação