Clear Sky Science · pt

Combinar aprendizado federado e modelo itinerante aumenta desempenho e abre oportunidades para equidade digital em saúde

Por que compartilhar insights médicos sem compartilhar dados importa

A medicina moderna depende cada vez mais da inteligência artificial para encontrar padrões em exames e prontuários. Mas os dados dos pacientes são sensíveis e muitas vezes não podem sair do hospital onde foram coletados. Isso cria uma tensão: como hospitais ao redor do mundo podem colaborar para treinar ferramentas de IA poderosas sem enviar dados brutos de pacientes através de fronteiras ou para grandes servidores centrais? Este estudo apresenta uma nova maneira de fazer exatamente isso, visando não apenas a precisão, mas também a equidade entre hospitais bem equipados e clínicas menores, com poucos recursos.

DuAS maneiras de ensinar uma IA sem mover dados

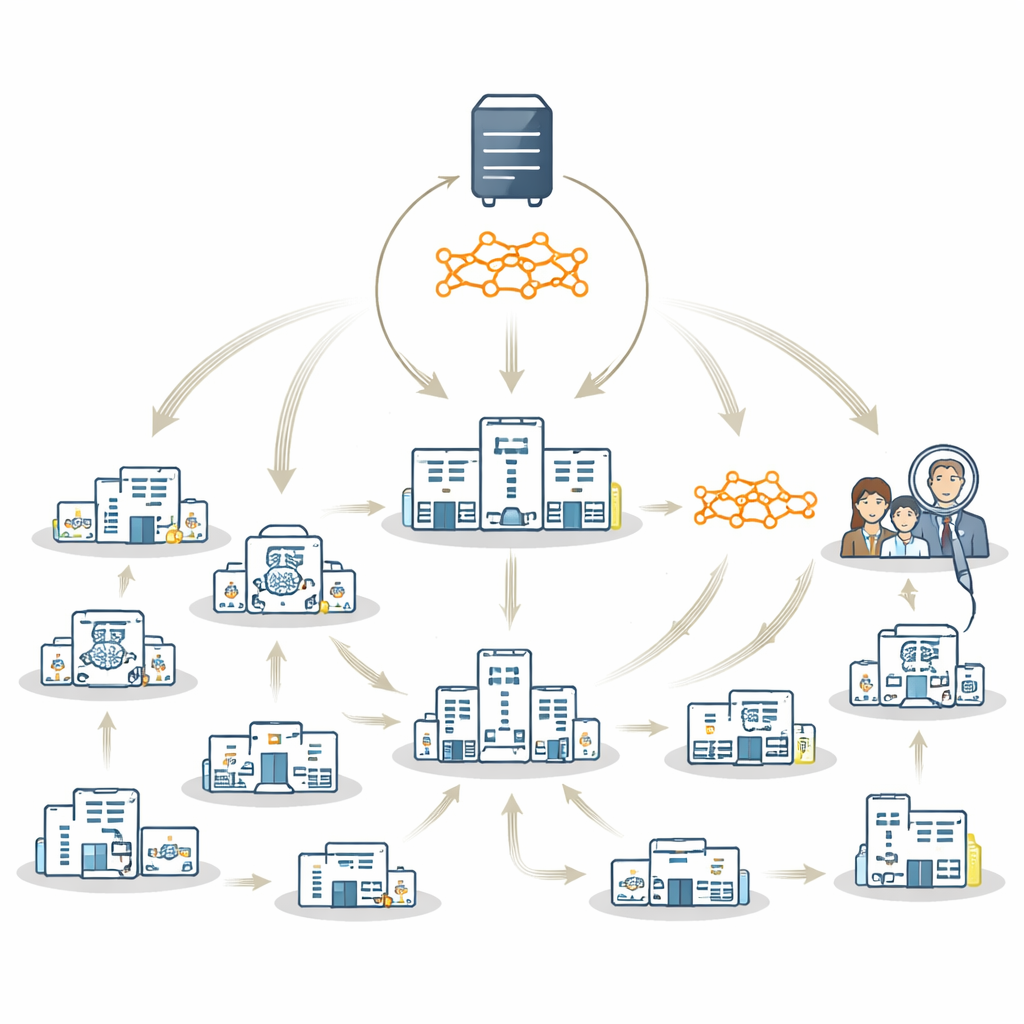

Hoje, duas estratégias principais permitem que hospitais treinem IA juntos mantendo os dados localmente. No aprendizado federado, cada hospital treina sua própria cópia local de um modelo em paralelo; esses modelos locais são então combinados em um modelo “global” compartilhado em um servidor central. Na abordagem de modelo itinerante, existe apenas um modelo que se desloca de hospital em hospital, treinando em cada local por sua vez. Ambos os métodos protegem a privacidade, mas cada um tem desvantagens. O aprendizado federado pode ter dificuldades quando alguns hospitais têm muito poucos dados ou não atendem a todos os tipos de pacientes; combinar modelos locais fracos ou desequilibrados pode gerar um modelo global ruim que reflete principalmente os grandes centros ricos. O modelo itinerante é mais robusto a esses desequilíbrios, mas pode ser mais lento e mais difícil de gerenciar.

Uma estratégia híbrida que usa o melhor dos dois mundos

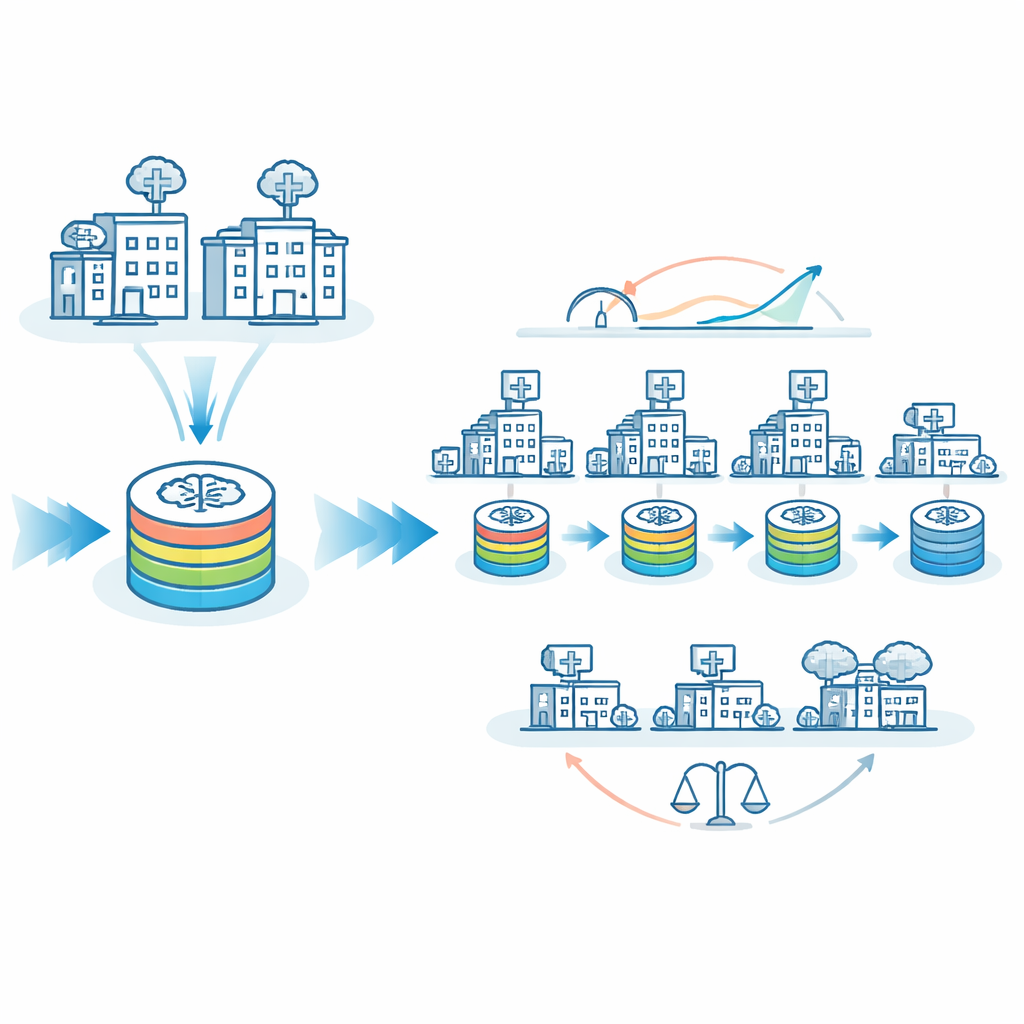

Os autores propõem o FedTM, um esquema de treinamento híbrido que mistura as forças do aprendizado federado e do modelo itinerante. O treinamento ocorre em duas fases. Primeiro vem uma fase de “aquecimento” em que apenas os maiores hospitais, com conjuntos de dados mais completos e equilibrados, treinam o modelo em paralelo usando técnicas padrão de aprendizado federado. Isso cria um modelo inicial robusto. Em seguida vem uma fase de “refinamento”, em que esse modelo aquecido visita cada local em sequência, incluindo clínicas muito pequenas que podem ter apenas algumas ressonâncias cerebrais ou até um único paciente. Nessa segunda fase, o modelo é atualizado gradualmente enquanto viaja, incorporando conhecimento de cada local sem nunca precisar que os dados saiam do controle local.

Testando o método em ressonâncias cerebrais de pacientes com Parkinson

Para colocar o FedTM à prova, os pesquisadores usaram 1.817 ressonâncias magnéticas cerebrais provenientes de 83 centros de imagem ao redor do mundo para treinar um sistema de IA capaz de distinguir pessoas com doença de Parkinson de indivíduos saudáveis. Trata‑se de um cenário particularmente desafiador: mais da metade dos centros contribuiu com menos de dez exames, apenas cerca de um terço tinham dados tanto de pacientes quanto de controles saudáveis, e os protocolos de imagem variavam muito. Nessas condições do mundo real, o aprendizado federado puro falhou em aprender bem a tarefa, enquanto o modelo itinerante puro teve desempenho melhor, mas ainda com espaço para melhoria. O FedTM, especialmente quando o aquecimento envolveu os sete maiores e mais equilibrados centros, superou claramente ambos: a área sob a curva ROC, uma medida padrão da qualidade da classificação, subiu de 77% com o modelo itinerante sozinho para cerca de 82% com o FedTM, com ganhos semelhantes em outras métricas clinicamente importantes como sensibilidade, especificidade e F1‑score.

Tornando a IA mais justa entre hospitais grandes e pequenos

Uma preocupação importante em IA médica é a equidade: um modelo funciona igualmente bem para pacientes de hospitais pequenos, rurais ou com poucos recursos tanto quanto para aqueles de grandes centros acadêmicos? A equipe analisou com que frequência a IA cometia previsões erradas em locais “maiores” versus “menores”. Com o modelo itinerante sozinho, as taxas de classificação incorreta diferiam cerca de 8 pontos percentuais entre esses grupos. Com o FedTM ajustado adequadamente, as taxas de erro para locais maiores e menores tornaram‑se quase idênticas, por volta de 26%. Em outras palavras, o modelo tornou‑se não apenas mais preciso no geral, mas também mais equilibrado. O FedTM também deslocou a maior parte do trabalho computacional para a fase de aquecimento em locais com mais recursos, reduzindo quase pela metade o número de ciclos de treinamento que os locais pequenos precisaram executar, ao mesmo tempo em que manteve o tempo total de treinamento semelhante.

O que isso significa para a saúde digital global

O FedTM oferece um caminho prático para ferramentas de IA que respeitam a privacidade, melhoram o desempenho e distribuem benefícios de forma mais justa pelo mundo. Ao permitir que até locais com pouquíssimos dados influenciem o modelo final, essa estrutura pode ajudar a garantir que pessoas em ambientes remotos ou com poucos recursos não sejam deixadas para trás quando novas ferramentas diagnósticas são desenvolvidas. Embora o estudo tenha se concentrado em um único tipo de exame cerebral e uma única doença, a abordagem pode, em princípio, ser adaptada a muitos outros problemas médicos. À medida que os sistemas de saúde adotam cada vez mais dispositivos móveis e wearables, e conforme as regulações enfatizam a soberania dos dados, estratégias híbridas como o FedTM podem se tornar fundamentais para construir IA médica confiável, inclusiva e responsável.

Citação: Souza, R., Stanley, E.A.M., Ohara, E.Y. et al. Combining federated learning and travelling model boosts performance and opens opportunities for digital health equity. npj Digit. Med. 9, 294 (2026). https://doi.org/10.1038/s41746-026-02483-y

Palavras-chave: aprendizado federado, modelo itinerante, doença de Parkinson, IA em imagens médicas, equidade em saúde