Clear Sky Science · pt

Definindo segurança operacional em sistemas de inteligência artificial clínica

Por que a IA segura na medicina importa

Hospitais estão adotando rapidamente a inteligência artificial para ler exames e sinalizar doenças, mas há uma pergunta que as pontuações de acurácia comuns não conseguem responder: quando é realmente seguro deixar a máquina tomar a decisão? Este artigo apresenta uma maneira prática de decidir quando os médicos podem confiar com segurança em um sistema de IA, quando devem ignorá‑lo e quando precisam examinar o caso mais de perto. O objetivo não é apenas construir algoritmos mais inteligentes, mas incorporá‑los ao cuidado diário de forma a proteger pacientes, reduzir exames desnecessários e aliviar a carga sobre os clínicos em vez de aumentá‑la.

De uma pontuação para três zonas de ação claras

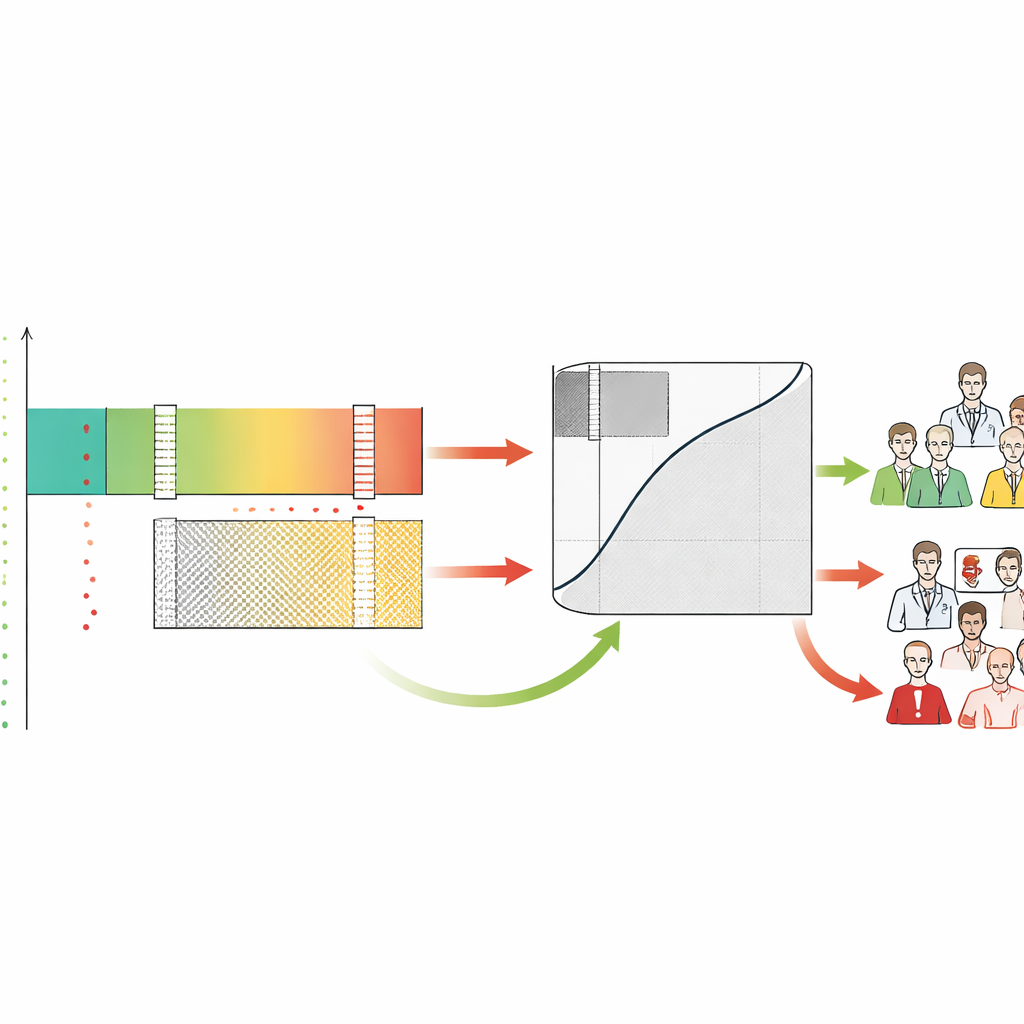

A maioria das ferramentas de IA médica gera uma única pontuação de risco, como a probabilidade de que uma mamografia indique câncer. Tradicionalmente, desenvolvedores avaliam essas ferramentas com uma curva que resume quão bem elas separam pacientes doentes de saudáveis no conjunto. Os autores argumentam que isso não é suficiente. Eles propõem a estrutura Safety‑Aware ROC (SA‑ROC), que parte das mesmas pontuações de risco, mas as reorganiza em três regiões práticas. Uma zona de "rule‑in" (confirmação) de pontuação alta contém pacientes cujos resultados são suficientemente confiáveis para desencadear uma ação, como acompanhamento urgente. Uma zona de "rule‑out" (descartação) de pontuação baixa contém pacientes cujos resultados são suficientemente confiáveis para ser seguro despriorizá‑los. Entre elas fica a "zona cinzenta" de incerteza, onde a IA não é confiável o bastante e um especialista humano deve revisar o caso.

Deixar que os clínicos definam a barra de segurança

Essencialmente, o SA‑ROC permite que clínicos e instituições definam suas próprias metas de segurança antecipadamente. Eles escolhem quão certos querem estar antes de agir sobre um resultado positivo (a probabilidade mínima aceitável de que um achado sinalizado seja realmente anômalo) e quão certos querem estar antes de relaxar diante de um resultado negativo (a probabilidade mínima aceitável de que um caso liberado seja realmente normal). Dadas essas metas, a estrutura busca nas pontuações do modelo os limites exatos que as satisfaçam. Pontuações acima do limite superior formam a zona segura de rule‑in, pontuações abaixo do limite inferior formam a zona segura de rule‑out, e tudo entre os limites torna‑se a zona cinzenta. A estrutura então quantifica quantos pacientes caem em cada região e quanto trabalho incerto — casos enviados de volta aos humanos — a IA deixa sem resolver.

Revelando diferenças ocultas entre IAs similares

Os autores mostram que dois sistemas de IA com acurácia tradicional quase idêntica podem se comportar de maneiras muito diferentes quando vistos por essa lente de segurança. Em simulações, modelos com o mesmo desempenho geral produziram tamanhos muito distintos de zonas de rule‑in, rule‑out e cinzenta dependendo de como suas pontuações estavam distribuídas. Um modelo pode se destacar em confirmar doença com alta confiança, enquanto outro pode se sobressair em liberar com segurança grande número de pacientes de baixo risco. Em um estudo de caso do mundo real envolvendo duas ferramentas aprovadas pela U.S. Food and Drug Administration para rastreamento de câncer de mama, o sistema com a pontuação padrão de acurácia mais alta foi na verdade pior para triagem de alta confiança. Na configuração de segurança mais rigorosa — permitindo nenhum câncer perdido no grupo de baixo risco — o sistema supostamente mais fraco removeu com segurança quase o dobro de mulheres da fila do radiologista. Assim, o SA‑ROC expõe uma espécie de "inversão de desempenho" que as métricas convencionais ocultam.

Compreendendo a tensão humano–IA e a carga de trabalho

Ao rotular cada caso como rule‑in, rule‑out ou cinzento, a estrutura também revela como médicos humanos se comportam nessas zonas. Os autores constataram que radiologistas frequentemente superestimavam casos que a IA julgava de baixo risco com segurança, gerando muitos alarmes falsos exatamente na região em que a máquina era mais confiável. Em contraste, tanto humanos quanto IA tiveram dificuldade na zona cinzenta, validando‑a como a área que realmente precisa de atenção especializada. O SA‑ROC captura o tamanho dessa zona cinzenta em um único número, que representa o custo da indecisão. Uma zona cinzenta pequena significa mais automação segura e menos carga de trabalho humano; uma zona cinzenta grande significa que muitos casos ainda exigem revisão manual cuidadosa e que o sistema pode aumentar o esgotamento em vez de aliviá‑lo.

Transformando regras de segurança em prática cotidiana

Além da medição, a estrutura foi desenhada como uma ferramenta de governança que transforma políticas em comportamento concreto da IA. Hospitais podem usá‑la de duas maneiras. Primeiro, podem especificar diretamente requisitos de segurança ou limites sobre quantos casos estão dispostos a enviar para a zona cinzenta e deixar que a estrutura calcule os limiares correspondentes. Segundo, podem atribuir valores e penalidades a diferentes desfechos — detectar um câncer, perder um, solicitar um exame desnecessário ou adiar para revisão humana — e fazer com que a estrutura busque a política que maximize o benefício geral. Essas estratégias podem ser ajustadas para metas muito diferentes, como programas de rastreamento em massa, encaminhamentos para especialistas ou coortes de pesquisa, todas usando o mesmo modelo subjacente.

O que isso significa para pacientes e clínicos

Em termos simples, este trabalho oferece uma forma de dizer não apenas "esta IA é precisa", mas "aqui está exatamente quando e como ela pode ser confiável na clínica". Ao segmentar as saídas da IA em regiões seguras, inseguras e incertas atreladas a promessas de segurança explícitas, o SA‑ROC ajuda sistemas de saúde a decidir quando máquinas podem agir por conta própria e quando humanos devem permanecer firmemente no controle. Ele ressalta que pontuações tradicionais de acurácia podem ser enganosas e que a segurança real depende de como um modelo se comporta nos extremos em que os erros são mais custosos. Se amplamente adotada e validada em cenários reais maiores, essa estrutura pode apoiar uma automação mais confiável, reduzir alarmes e exames desnecessários e transformar os casos mais difíceis para a IA — a zona cinzenta — em uma fonte focada de aprendizado e melhoria tanto para algoritmos quanto para a própria medicina.

Citação: Kim, YT., Kim, H., Bahl, M. et al. Defining operational safety in clinical artificial intelligence systems. npj Digit. Med. 9, 281 (2026). https://doi.org/10.1038/s41746-026-02450-7

Palavras-chave: inteligência artificial clínica, segurança operacional, imagem médica, suporte à decisão, estratificação de risco