Clear Sky Science · pt

Ajuste visual orientado por anatomia para compreensão multimodal do câncer de mama

Triagem mais inteligente para um câncer comum

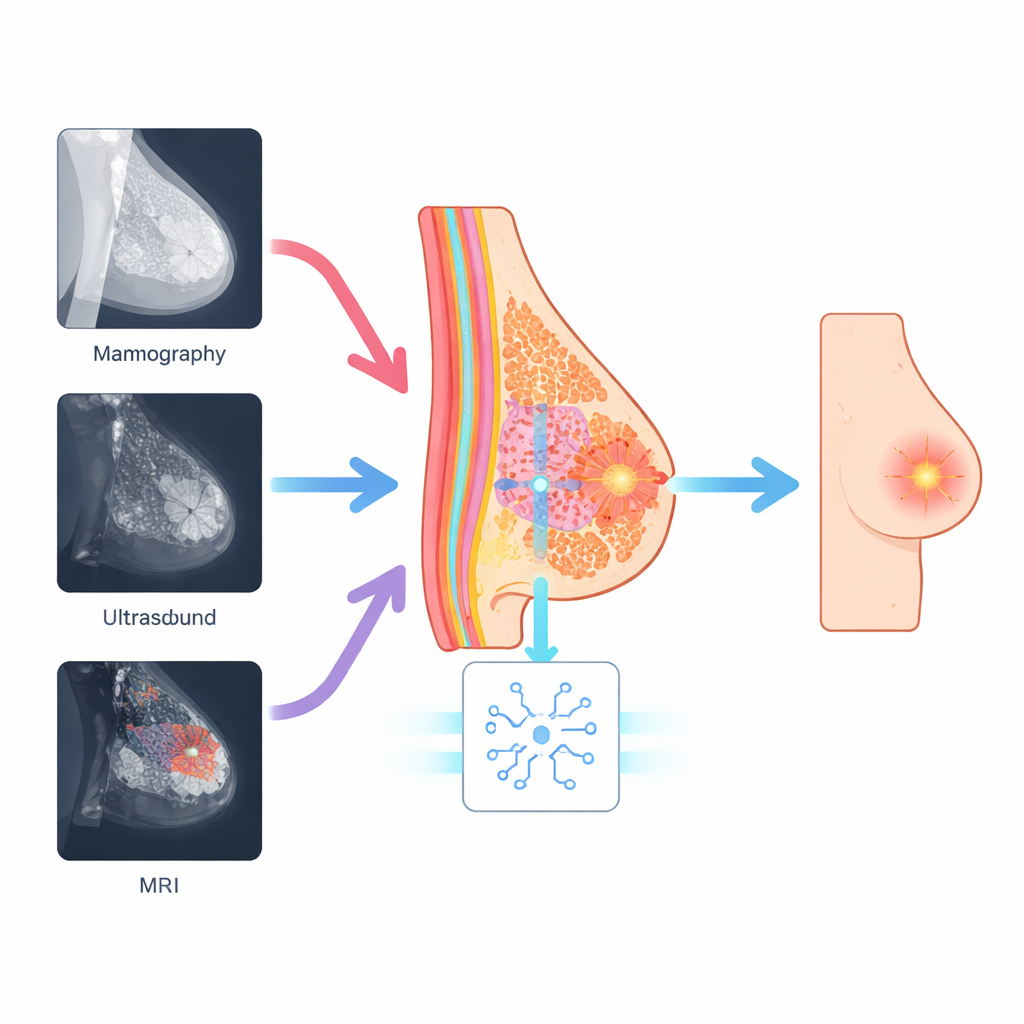

O câncer de mama é uma das principais causas de morte por câncer em mulheres, e os médicos dependem cada vez mais de programas de computador para ajudar a interpretar imagens médicas complexas. Mas mamografias, ultrassons e imagens por ressonância magnética mostram a mama de formas muito diferentes, o que torna difícil para os sistemas de inteligência artificial atuais manterem desempenho consistente entre aparelhos e hospitais. Este estudo apresenta uma nova abordagem de IA que "pensa" na anatomia subjacente da mama em vez de apenas nos padrões de intensidade de cada imagem, levando a uma detecção de áreas suspeitas mais precisa e mais consistente.

Por que diferentes exames confundem os computadores

Mamografia, ultrassom e ressonância magnética usam princípios físicos distintos para visualizar o interior da mama. Um câncer que aparece como um ponto brilhante no ultrassom pode se manifestar como uma sombra sutil na mamografia ou como uma área luminosa na RM. Muitos sistemas modernos de IA, incluindo poderosos transformadores de visão e modelos visão–linguagem, aprendem principalmente a partir da aparência geral da imagem. Eles frequentemente deixam passar detalhes pequenos, porém importantes, como microcalcificações ou bordas irregulares, e seu desempenho pode cair drasticamente ao ser transferido entre diferentes tipos de aparelhos ou entre hospitais. Essa lacuna entre as condições de treinamento e as clínicas do mundo real limita a confiança que os médicos depositam nessas ferramentas.

Usando a própria mama como guia

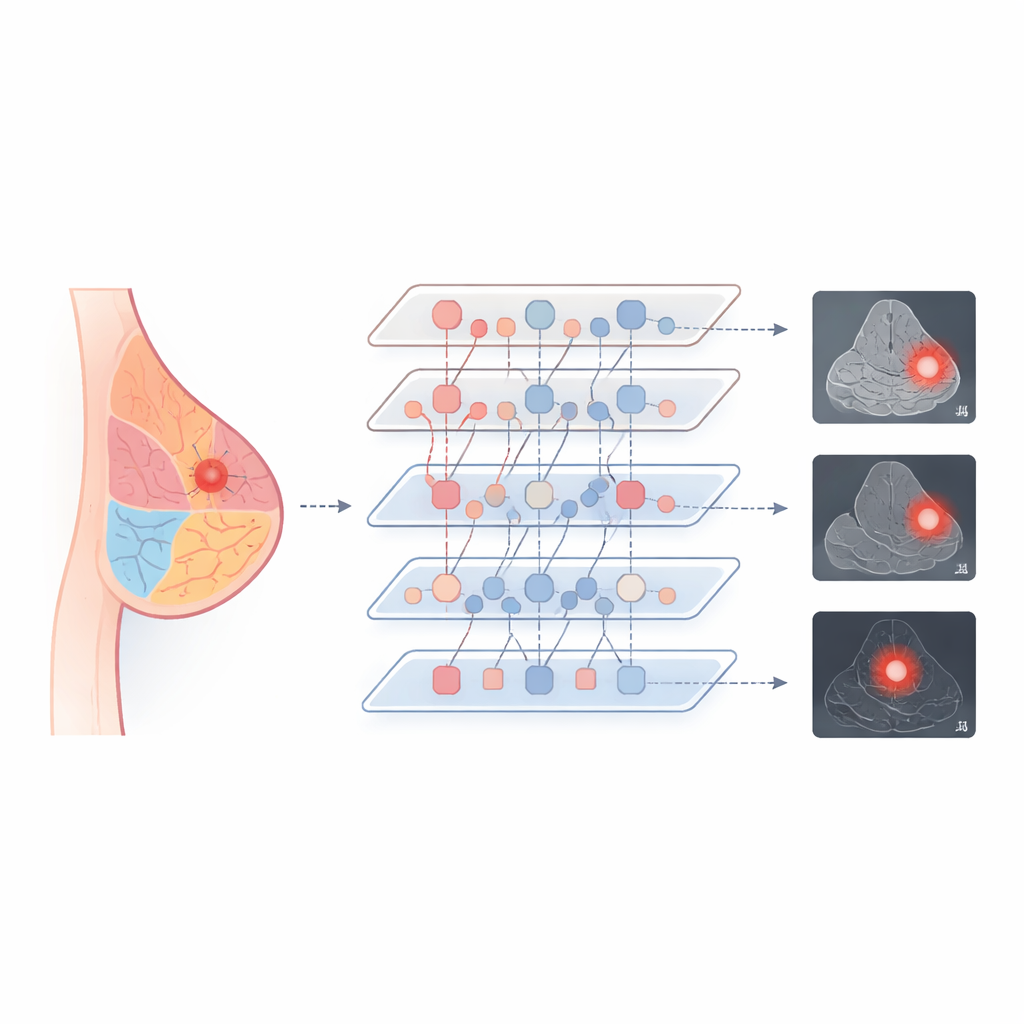

Os pesquisadores argumentam que, embora as imagens pareçam diferentes, a biologia da mama não muda entre os exames. Toda imagem ainda contém tecido glandular, gordura e estruturas ductais organizadas em um padrão reconhecível. Seu método, chamado Ajuste Visual por Prompt Orientado por Anatomia (A-VPT), incorpora esse mapa básico da mama diretamente no modelo de IA. Em vez de ajustar milhões de pesos internos, o sistema adiciona um pequeno conjunto de sinais extras de "prompt" que indicam à rede quais regiões de tecido estão sendo observadas. Esses prompts são gerados a partir de mapas anatômicos grosseiros ou pistas de tecido aprendidas e então injetados camada por camada em um transformador pré-treinado e congelado. Na prática, o modelo é constantemente lembrado de onde estão os ductos, as glândulas e a gordura, para que possa avaliar áreas suspeitas no contexto adequado.

Ensinando um sistema a falar muitas linguagens de imagem

Para fazer o modelo funcionar entre diferentes modalidades, a equipe projetou um esquema de treinamento que força a IA a tratar tecidos semelhantes de forma semelhante, não importa como eles sejam escaneados. Eles alinham as impressões internas de regiões adiposas, glandulares e ductais extraídas de mamografia, ultrassom e RM, aproximando-as em um espaço compartilhado. Quando há laudos textuais disponíveis, o sistema também vincula esses padrões de tecido a frases descritivas curtas, associando características visuais à linguagem médica. Durante o processamento, módulos de interação especializados permitem que os prompts anatômicos e as características da imagem troquem informações em ambas as direções, com uma etapa de gating que controla o quanto a anatomia influencia cada camada. Essa combinação ajuda o modelo a focar nas estruturas corretas mantendo estabilidade e eficiência.

Melhor precisão com um toque mais leve

Os autores testaram o A-VPT em três coleções conhecidas de imagens de mama que cobrem as três modalidades. Em comparação com redes profundas tradicionais e várias formas populares de fine‑tuning em grandes modelos, seu método alcançou as maiores pontuações tanto na classificação de lesões como benignas ou malignas quanto na delimitação de seus contornos. Foi especialmente eficaz quando solicitado a usar conhecimento de um tipo de exame para interpretar outro — por exemplo, treinar em mamografias e depois avaliar em ultrassom — situações em que métodos mais antigos frequentemente falhavam. Notavelmente, o A-VPT obteve esses resultados atualizando menos de 2% dos parâmetros do modelo, o que reduz as necessidades computacionais e facilita a implantação em hospitais reais. Visualizações de onde o modelo "olhou" mostraram que ele se concentrou em regiões glandulares e peritumorais realistas, sugerindo que suas decisões são compatíveis com o raciocínio dos radiologistas.

O que isso significa para pacientes e clínicas

Em termos simples, este trabalho demonstra que ensinar sistemas de IA sobre a anatomia básica pode torná‑los mais inteligentes e mais compreensíveis. Ao ancorar seu raciocínio na estrutura real da mama, o A-VPT é melhor em detectar e delinear tumores entre diferentes métodos de imagem, com menos ajustes e comportamento mais transparente. Se validada adicionalmente, essa estratégia pode apoiar uma triagem e diagnóstico mais consistentes em contextos diversos, desde grandes centros médicos até clínicas menores, e pode ser estendida para outros órgãos, como pulmão ou fígado. Em última análise, IAs conscientes da anatomia podem se tornar parceiras fundamentais na detecção mais precoce e confiável do câncer.

Citação: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

Palavras-chave: imagem do câncer de mama, IA médica, transformadores de visão, aprendizado cross-modal, prompts orientados por anatomia