Clear Sky Science · pt

Desempenho independente e colaborativo de grandes modelos de linguagem e profissionais de saúde em diagnóstico e triagem

Por que isso importa para sua próxima consulta

Quando você digita seus sintomas em um chatbot online ou pergunta a um aplicativo de IA o que pode estar acontecendo, você está usando o mesmo tipo de tecnologia que médicos estão agora testando em hospitais: grandes modelos de linguagem, ou LLMs. Este estudo faz uma pergunta simples, porém vital: quão bem essas ferramentas realmente diagnosticam doenças e decidem a urgência de um caso, em comparação com profissionais de saúde reais — e o que acontece quando os dois trabalham juntos?

Como os pesquisadores adotaram uma visão ampla

Os autores não testaram um único chatbot em uma única clínica. Em vez disso, combinaram evidências de 50 estudos distintos realizados ao redor do mundo entre 2020 e 2025. Esses estudos cobriram muitas especialidades, desde doenças oculares e exames cerebrais até atendimento de emergência. Em cada um, médicos e um ou mais LLMs receberam as mesmas descrições de casos de pacientes reais ou cuidadosamente elaborados. Os LLMs precisaram sugerir possíveis diagnósticos ou decidir quão rapidamente um paciente precisava de atendimento, enquanto os médicos faziam o mesmo. Em alguns estudos, os médicos também viram as sugestões da IA para avaliar se isso os ajudava a ter um desempenho melhor.

Quão bons são os sistemas de IA por conta própria?

Em todos os estudos, as ferramentas de IA frequentemente conseguiam incluir o diagnóstico correto em algum lugar da lista, mas normalmente ficavam aquém dos médicos quando forçadas a escolher apenas uma resposta. Quando apenas o palpite principal era contado, os LLMs foram, em média, cerca de 11% menos precisos que os profissionais de saúde. À medida que o número de palpites permitidos aumentava, essa diferença diminuía e eventualmente desaparecia — quando até dez diagnósticos possíveis eram permitidos, os sistemas de IA estavam pelo menos tão propensos quanto os médicos a incluir o correto. Para decisões de triagem — avaliar a urgência de um caso e o nível de cuidado necessário — IA e humanos tiveram desempenho semelhante no geral. Contudo, os resultados variaram bastante entre modelos individuais e configurações de teste, sugerindo que algumas ferramentas são muito mais confiáveis que outras.

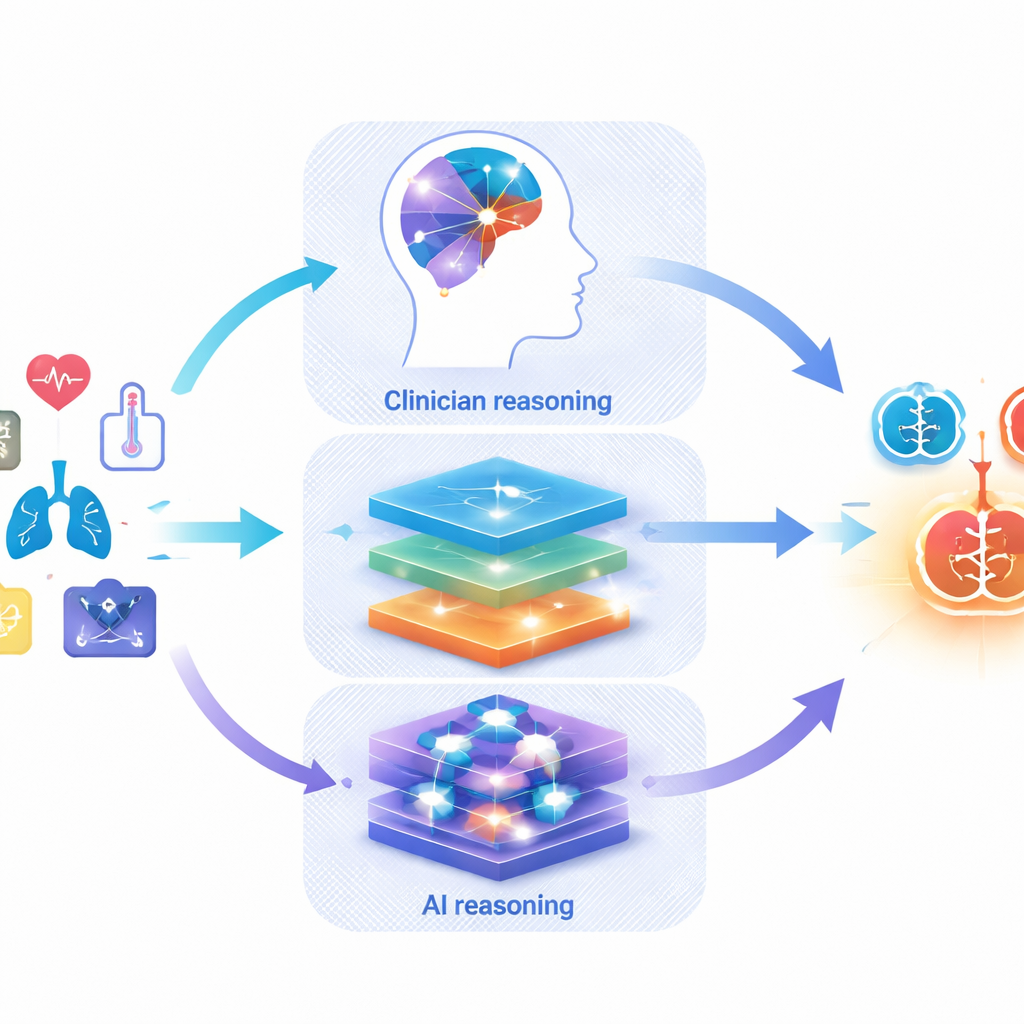

O que acontece quando os médicos usam a IA como colega?

Nove estudos analisaram diretamente a colaboração: médicos trabalharam primeiro sozinhos e depois repetiram a tarefa com ajuda de um LLM. Aqui a notícia foi encorajadora. Quando apoiados pela IA, os médicos foram mais precisos no geral, especialmente quando podiam indicar vários diagnósticos possíveis. Por exemplo, com a ajuda de um LLM, a precisão em listas curtas de candidatos melhorou cerca de 10–40%, dependendo do número de opções consideradas. Isso sugere que a IA é particularmente útil como parceira de brainstorming que amplia o conjunto de possibilidades e estimula os clínicos a considerar condições menos óbvias, enquanto o especialista humano ainda toma a decisão final.

Por que os resultados de hoje podem parecer melhores que na prática real

Embora os números pareçam promissores, os autores alertam que a maioria dos estudos existentes está longe do ideal. Muitos se basearam em resumos de casos estilo livro-texto ou em casos raros escolhidos para ensino, não nas histórias bagunçadas e incompletas que pacientes apresentam em clínicas reais. Apenas alguns usaram pacientes em tempo real. Detalhes sobre como os casos foram selecionados, como as ferramentas de IA foram configuradas e como as respostas foram julgadas frequentemente estavam ausentes. Informações visuais, como exames ou fotos de pele, foram usadas com menos frequência e, quando apenas imagens foram testadas, clínicos experientes claramente superaram a IA. Os pesquisadores também destacam que clínicos juniores e especialistas podem reagir de maneiras diferentes ao conselho da IA, e que questões como privacidade de dados, viés oculto e confiança excessiva nas sugestões da máquina permanecem em grande parte sem teste na prática diária.

O que isso significa para pacientes e o futuro do cuidado

No geral, o estudo sugere que chatbots e LLMs atuais não estão prontos para substituir seu médico, mas podem em breve tornar-se assistentes valiosos. Usados com sabedoria, podem ajudar a gerar listas mais amplas de diagnósticos possíveis e apoiar decisões mais precisas, especialmente quando os médicos permanecem no comando e tratam a IA como uma segunda opinião em vez de um veredito final. Antes que essas ferramentas sejam integradas à rotina de atendimento, porém, os autores defendem a necessidade de ensaios melhor desenhados em ambientes reais, padrões de relato mais claros e salvaguardas sólidas em torno de segurança, equidade e privacidade. Para os pacientes, isso significa que a IA pode, eventualmente, ajudar sua equipe de cuidado a pensar de forma mais ampla e agir mais rápido, mas qualquer sistema confiável precisa ser testado com o mesmo rigor que um novo medicamento ou dispositivo médico.

Citação: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Palavras-chave: IA para diagnóstico médico, triagem clínica, grandes modelos de linguagem, colaboração médico-IA, segurança em saúde digital